객체 탐지 모델을 이용한 영상 기반 퍼팅 거리 추정 기법

Copyright © 2026 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

기존 퍼팅 연습기는 압전 센서를 활용하지만, 센서 특성에 따른 인위적인 보정이 필요하다는 한계가 있다. 이를 해결하기 위해 본 연구는 디지털 카메라 및 컴퓨터 비전 기술을 활용한 퍼팅 거리 예측 방법을 소개한다. 제안 방법에서는 신호처리 및 딥러닝 기술을 비교하여 골프공 탐지 및 추적 모듈을 설계하고 관측된 속도를 퍼팅 거리로 환산하는 모듈을 추가하였다. 다양한 탐지 및 추적 방법을 비교한 결과, 탐지 모듈에서는 미세 조정한 YOLOv8 Large 신경망이 mAP@50 98.9%로 가장 높은 성능을 보였으며, 비교적 복잡한 구조임에도 평균 30.32 FPS의 실시간 처리 성능을 달성하여 탐지 정확도와 처리 속도 측면 모두에서 높은 효율을 보였다. 퍼팅 거리 추정 모듈은 베이지안 선형 회귀 모델이 비교적 우수한 성능을 보였다. 제안 방법은 기존 센서 기반의 한계를 극복하는 컴퓨터 비전 기술 기반 퍼팅 거리 예측 방법의 실효성을 입증한다.

Abstract

A conventional putting training device utilizes piezoelectric sensors, but they require artificial calibration due to sensor characteristics, posing a limitation. To address this issue, this study introduces a putting distance prediction method using a digital camera and computer vision technology. The proposed method compares signal processing and deep learning techniques to design a golf ball detection and tracking module, along with an additional module that converts the observed velocity into putting distance. Comparative analysis of various detection and tracking methods showed that a fine-tuned YOLOv8 Large neural network achieved the highest performance with an mAP@50 of 98.9% in the detection module and demonstrated real-time capability by achieving an average of 30.32 FPS despite its relatively complex architecture, indicating strong efficiency in both detection accuracy and processing speed. The Bayesian linear regression model demonstrated relatively superior performance in the putting distance estimation module. The proposed method validates the feasibility of computer vision-based putting distance prediction, overcoming the limitations of conventional sensor-based approaches.

Keywords:

Putting Distance Prediction, Golf Ball Tracking, Golf Ball Detection, Sports Technology, Sensor-Free MeasurementⅠ. 서 론

최근 컴퓨터 비전과 딥러닝 기술의 발전으로 다양한 분야에서 정밀한 분석과 자동화가 가능해지고 있으며, 스포츠 훈련 시스템에서도 효과적인 도구로 활용되고 있다[1][2]. 특히, 객체 탐지 및 추적 기술을 활용하면 운동 수행 과정을 보다 정밀하게 분석할 수 있어 스포츠 훈련과 성과 평가의 정확도를 높일 수 있다. 본 연구에서는 이러한 기술을 활용하여 골프 퍼팅 훈련을 위한 딥러닝 기반 퍼팅 거리 예측 방법을 제안한다.

퍼팅 연습기는 장소 제약 없이 집, 실내 연습장, 사무실 등에서 골프 연습을 수행할 수 있게 도와주는 휴대용 및 디지털 기반의 연습 도구이다. 내장된 압전 센서를 통해 골프공과 제품 사이에 발생하는 충격량을 감지하여 이를 거리로 환산함으로써, 사용자에게 정교한 퍼팅 연습 환경을 제공한다. 그러나, 제품에 내장된 압전 센서는 아날로그 측정 방식을 사용하기 때문에 센서마다 전자적 특성이 상이하며, 제품 개발 시 각 센서의 특성을 고려한 보정 작업이 필요하다. 또한, 아날로그 신호의 특성상 전자기적 간섭과 온도 변화로 인해 잡음이 추가될 수 있어, 이로 인해 측정 정확도가 저하될 가능성이 있다. 이러한 문제는 디지털 신호로 변환하는 과정에서 정보 손실을 초래하여 퍼팅 연습기의 신뢰성을 저하시킬 수 있다.

퍼팅 거리 측정을 위한 다양한 하드웨어 기반 기술도 연구되어 왔다. 예를 들어, 레이저 도트 포인터와 디지털 각도 센서를 활용하여 삼각함수를 기반으로 퍼팅 거리 및 라인 경사도를 계산하는 방식이 제안된 바 있다[3]. 해당 장치는 골프공과 목표 지점 간의 거리뿐만 아니라 경사 정보(예: 오르막/내리막, 좌우 기울기)를 종합적으로 제공하여 퍼팅 정확도를 향상시킬 수 있다. 그러나 이와 같은 장치는 별도의 장비 장착과 정교한 초기 설정이 필요하며, 센서 위치나 사용자 동작에 따른 간섭 가능성 등으로 인해 실내 연습 환경에서는 적용이 어렵고, 일반 사용자에게는 실용성이 떨어질 수 있다.

영상 기반 골프공 탐지에 대한 기존 연구도 일부 존재하지만, 대부분은 야외 필드 환경에서 스윙으로 타격된 골프공의 속도 및 방향[4], 혹은 궤적을 추적[5][6]하는 데 중점을 두고 있다. 이러한 연구들은 고속으로 이동하는 골프공을 분석하는 데 초점이 맞춰져 있으며, 실내 환경에서의 퍼팅 거리 예측을 목적으로 한 연구는 매우 드물다. 특히 YOLO와 같은 딥러닝 기반 객체 탐지 신경망을 활용하여 골프공을 실시간으로 인식하고, 관측된 속도를 바탕으로 퍼팅 거리까지 자동으로 예측하는 연구는 현재까지의 문헌에서 거의 확인되지 않는다.

발전된 디지털 카메라의 성능과 딥러닝 기반 객체 탐지 기술을 이용하는 영상 기반 접근법은 골프공의 움직임을 정밀하게 분석할 수 있으며, 다양한 환경에서도 안정적인 탐지가 가능하다는 점에서 효과적인 대안이 될 수 있다. 이에 본 논문에서는 디지털 카메라를 활용하여 골프 퍼팅 장면을 촬영하고, 객체 탐지 및 추적을 위해 신호 처리 기반과 딥러닝 기반 기술을 비교 분석하여 골프공을 정확하게 탐지 및 추적하는 알고리즘을 설계하였다. 또한, 관측된 속도를 바탕으로 퍼팅 거리를 예측하는 회귀 모델을 결합하였다. 제안 방법은 센서 기반 측정 방식의 인위적인 보정 작업 한계를 극복하고, 영상 기반의 퍼팅 거리 예측의 실효성 및 가능성을 보인다.

본 논문의 구성은 다음과 같다. 제2장에서는 본 연구에서 제안하는 퍼팅 거리 예측 프레임워크의 전체적인 개요를 제시하고, 이를 구성하는 두 가지 핵심 모듈인 객체 탐지 모듈과 거리 추정 모듈의 세부 구조를 설명한다. 특히 객체 탐지 모듈에서는 골프공을 정확히 탐지하고 위치 정보를 추출하는 과정을, 거리 추정 모듈에서는 탐지된 정보를 바탕으로 실제 퍼팅 거리를 예측하는 회귀 기반 기법을 다룬다. 제3장에서는 제안된 방법의 성능을 검증하기 위한 다양한 실험을 수행하고 그 결과를 분석한다. 여기에는 딥러닝 기반 탐지 신경망과 전통적 추적 알고리즘의 조합 성능 평가, YOLOv8을 활용한 탐지 정확도 실험, 실시간성 평가를 위한 FPS 비교 실험, 회귀 모델별 오차 비교 실험 등이 포함된다. 마지막으로 제4장에서는 본 연구의 결론을 제시하고, 향후 연구 방향에 대해 논의한다.

Ⅱ. 제안 방법

1. 개요

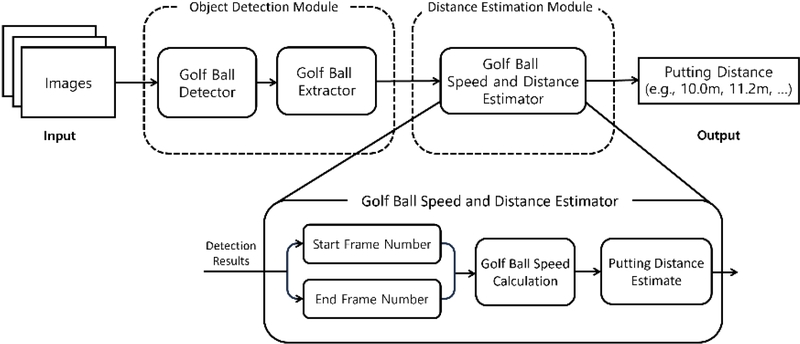

본 논문에서 제안하는 방법은 골프공을 탐지하기 위한 객체 탐지 모듈(Object Detection Module)과 탐지 결과를 기반으로 거리를 추정하는 거리 추정 모듈(Distance Estimation Module)로 구성되며, 전체 알고리즘 구조는 [그림 1]에 묘사된다.

먼저, 객체 탐지 모듈은 골프 퍼팅 장면이 포함된 동영상이 입력되었을 때, 객체 탐지 및 추적 알고리즘을 적용하여 골프공을 탐지하고, 탐지된 골프공의 Bounding Box 좌표와 프레임 번호를 추출하여 거리 추정 모듈로 전달한다. 거리 추정 모듈은 객체 탐지 모듈로부터 전달받은 프레임 번호를 통해 골프공의 속도를 계산하며, 회귀(Regression) 모델[7]을 이용해 퍼팅 거리를 추정해 출력한다. 각 모듈에 대한 세부적인 설명은 2.2절과 2.3절에서 다룬다.

2. 객체 탐지 모듈

객체 탐지 모듈은 입력된 동영상에서 골프공을 탐지하는 골프공 탐지기(Golf Ball Detector)와 골프공의 속도 계산에 필요한 골프공의 위치 정보와 프레임 정보를 추출하는 골프공 추출기(Golf Ball Extractor)로 구성되며, 추출된 정보는 이후 거리 추정 모듈로 전달한다. 본 연구에서는 골프공 탐지기(Golf Ball Detector)를 설계하기 위해, 다음 세 가지 접근 방법을 분석하고, 실험을 통해 가장 우수한 방법을 선택한다.

첫 번째 방법은 딥러닝 기반 탐지 신경망을 사용하여 골프공을 탐지한 후, 탐지된 골프공의 정보를 신호처리 기반 추적 알고리즘에 전달하여 지속적으로 추적하는 방법이다. 탐지를 위한 신경망으로는 속도와 정확성을 균형 있게 제공하며, 다양한 크기의 객체를 효과적으로 탐지할 수 있는 YOLOv8의 Large 신경망[8]을 사용하며, 신호처리 기반 추적 알고리즘으로 CSRT(Channel and Spatial Reliability Tracker), Median Flow, MOSSE(Minimum Output Sum of Squared Error)를 비교한다.

YOLOv8은 이전 YOLO 신경망[9-14] 대비 경량화된 구조와 향상된 Feature Aggregation 방식을 통해 속도와 정확성을 균형 있게 제공하며, 다양한 크기의 객체를 효과적으로 탐지할 수 있는 장점을 가진다. 그 중 Large 신경망은 더 많은 파라미터와 복잡한 계층 구조를 통해 고난이도의 탐지 작업에서 높은 정확도를 제공하며, 특히 골프공과 같이 작고 빠르게 움직이는 물체를 높은 정확도로 탐지하기 때문에 YOLOv8의 Large 신경망을 사용한다.

CSRT[15]는 채널과 공간 신뢰도를 활용해 객체의 가림 현상이나 빠른 움직임에도 효과적으로 동작한다는 특징을 가지는 추적 알고리즘이다. Median Flow[16]는 Optical Flow를 기반으로 객체의 특징점을 추적하며, 양방향 추적 결과를 비교해 신뢰도를 평가한 뒤 이상치를 제거하고, 남은 특징점들의 중앙값으로 객체의 위치를 계산하는 알고리즘으로, 변화하는 조명 조건과 급격한 움직임에 대해 안정적이라는 특징을 갖는다. MOSSE[17]는 실시간 객체 추적을 목표로 한 고속 필터 기반 학습 방법으로, 다양한 환경 변화에도 강인하다는 특징이 있다.

첫 번째 방법의 수행 단계는 다음과 같다. 먼저, 딥러닝 기반 탐지 신경망인 YOLOv8 Large 신경망을 활용하여 입력 동영상의 첫 번째 프레임에서 골프공을 탐지한다. 탐지된 결과는 골프공 추출기에 의해 Bounding Box 좌표 형태의 골프공 위치 정보와 함께 프레임 정보가 추출되어 거리 추정 모듈로 전달된다. 이후, 탐지된 골프공의 정보는 신호처리 기반 추적 알고리즘을 통해 지속적으로 추적한다. 딥러닝 추적 방법을 활용하지 않고 신호처리 기반 추적 방법을 사용하는 이유는 딥러닝의 과도한 계산 비용을 줄이기 위함이다. 추적 성공 여부는 Flag값을 통해 모니터링된다. 이 Flag는 추적기의 초기화 상태를 나타내며, 추적기가 성공적으로 골프공을 추적하고 있는 경우 True로 설정된다. 반면, 추적이 실패하거나 추적 대상을 잃어버린 경우 False로 설정된다. Flag값이 False가 되면, YOLOv8 Large 신경망이 다시 호출되어 골프공을 재탐지함으로써 추적 기능을 보완한다.

두 번째 방법과 세 번째 방법은 딥러닝 탐지 신경망을 활용하여 매 프레임의 골프공을 탐지하는 방법으로, 별도의 추적 알고리즘을 사용하지 않는다. 두 방법의 차이점은, 두 번째 방법은 딥러닝 탐지 신경망의 사전 학습된 신경망을 그대로 사용한 반면, 세 번째 방법은 사전 학습된 신경망을 미세 조정하여 활용한 점이다. 두 방법 모두 앞서 소개된 첫 번째 방법과 동일하게 YOLOv8을 사용한다.

구체적으로, 두 번째 방법에서는 YOLOv8 Large 신경망의 사전 학습된 가중치를 사용하며, 이 가중치는 COCO (Common Objects in Context) 데이터셋[18]으로 학습된 것이다. COCO 데이터셋에는 80개의 객체 클래스가 포함되어 있으며, 그 중 ‘sports ball’ 클래스를 이용하여 골프공을 탐지한다.

세 번째 방법은 두 번째 방법과 달리, YOLOv8 Large 신경망을 미세 조정하여 사용한다. 사전 학습된 신경망은 골프공 탐지가 가능하지만, 골프공에 특화되어 있지 않아 탐지 성능이 부족할 수 있다. 이를 개선하기 위해 기존 COCO 데이터셋의 ‘sports ball’ 클래스로 학습된 YOLOv8 Large 가중치를 기반으로 Roboflow에서 제공하는 골프공 데이터셋[19]을 활용하여 골프공 탐지에 적합하도록 신경망을 미세 조정한다.

두 방법 모두 딥러닝 기반 탐지 신경망만을 사용하여 매 프레임마다 골프공을 탐지하며, 골프공의 위치 정보와 프레임 정보는 골프공 추출기를 통해 추출된 후 거리 추정 모듈로 전달된다.

골프공 추출기는 탐지된 골프공 객체 정보에서 골프공의 위치 데이터를 추출하고, 골프공 속도 측정을 위한 프레임 번호를 선정하여 거리 추정 모듈로 전달한다. 골프공의 위치 데이터는 탐지된 객체의 Bounding Box 형식으로 제공하며, 이는 프레임 내 골프공을 감싸는 사각형의 중심 x 좌표, 중심 y 좌표, 너비(width), 높이(height)로 구성된다.

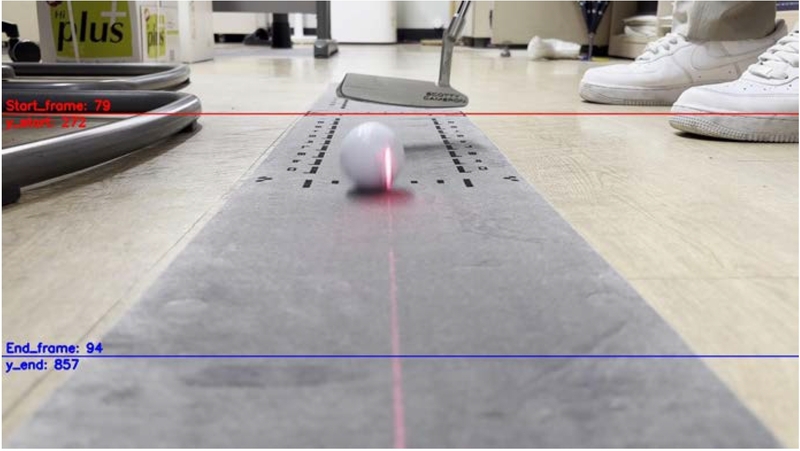

골프공의 프레임 정보는 골프공이 움직이기 시작한 시점인 시작 프레임 번호(Start Frame Number)와 퍼팅 연습기에 도달하기 직전에 대한 종료 프레임 번호(End Frame Number)로 이루어져 있다. 시작 프레임 번호는 골프공의 y 좌표가 급격히 변화하는 시점을 골프공이 움직이기 시작한 순간으로 간주하여 결정한다. [그림 2]는 골프공의 속도를 측정할 구간의 프레임 번호와 골프공의 y 좌표를 보여준다. 테스트 영상의 해상도는 1920x1080이며, [그림 2]의 테스트 영상에서 시작 프레임은 79번째 프레임으로 검출되었고, 골프공의 y 좌표는 272였다. 94번째 프레임에서 종료 프레임으로 결정되었으며 y 좌표는 857이었다. 종료 프레임 번호는 골프공의 y 좌표가 미리 설정된 임계값을 초과하는 시점으로 정의된다. 이 임계값은 퍼팅 연습기와 디지털 카메라로 자체 촬영한 총 51개의 퍼팅 동영상을 이용하여 설정하였으며, 각 동영상에서 골프공의 시작 시점과 종료 시점을 개별적으로 확인한 후, 종료 시점에서의 y 좌표값을 추출하여 그 평균을 임계값으로 사용한다.

3. 거리 추정 모듈

거리 추정 모듈은 객체 탐지 모듈에서 전달받은 정보를 기반으로 골프공의 속도를 계산하고, 속도 정보를 기반으로 거리 추정을 수행한다.

골프공 속도 계산(Golf Ball Speed Calculation)은 골프공 추출기로부터 전달받은 골프공의 위치 정보와 프레임 정보를 활용하여 수행한다. 골프공 속도 계산식은 다음과 같다.

| (1) |

골프공의 속도(v)는 시작 프레임 번호(Fs)와 종료 프레임 번호(Fe)의 번호 차이와 동영상의 초당 프레임 속도인 30을 이용해 골프공 이동 시간을 계산하고, 퍼팅 연습기와 골프공 간의 거리(d)를 이용하여 산출된다. d는 퍼팅 연습기의 설치 환경에 따라 달라질 수 있으며 본 연구에서는 0.835m로 설정한다.

골프공의 퍼팅 거리 추정을 위해, 세 가지 회귀 모델을 비교 실험한 후 가장 낮은 평균 절대 오차(MAE, Mean Absolute Error)를 보인 모델을 최종적으로 선정하였다. 실험에 사용된 회귀 모델은 로버스트 회귀(Robust Regression)[20], 베이지안 선형 회귀(Bayesian Linear Regression)[21], 다항 회귀(Polynomial Regression)[22]로, 각 모델에 골프공의 속도를 입력하여 거리를 출력하도록 설계한다.

로버스트 회귀 모델은 데이터에 이상치(outliers)가 존재할 경우, 이상치의 영향을 최소화하여 보다 안정적인 회귀 분석을 수행할 수 있도록 설계된 방법이다. 데이터마다 가중치(weight)를 부여하며, 이상치로 간주되는 데이터는 낮은 가중치를 할당받는다. 본 실험에서는 Huber 손실 함수를 사용하여 잔차가 작은 경우에는 제곱 손실을, 잔차가 큰 경우에는 선형 손실을 적용하였다. Huber 손실 함수 L(r)는 식 (2)와 같이 정의된다.

| (2) |

여기서, r은 실제값과 예측값 사이의 차이, 즉 오차(error)를 나타낸다. 이 함수에서는 이상치로 간주되는 전환점을 결정하며, 본 논문에서는 실험적으로 δ = 1.53으로 설정한다.

베이지안 선형 회귀는 베이지안 방법론을 적용한 선형 회귀 모델로, 파라미터에 대해 사전 확률(prior)을 설정하고, 이를 바탕으로 데이터에 대한 사후 확률(posterior)을 갱신하는 방식으로 예측을 수행한다. 이 모델은 예측값에 대한 불확실성을 정량적으로 나타낼 수 있으며, 예측의 신뢰도 또한 함께 제공할 수 있다는 특징이 있다. 모델은 식 (3)과 같은 선형 방정식으로 표현된다. 여기서 y는 퍼팅 거리, X는 골프공의 속도, β는 회귀 계수, α-1는 회귀 계수에 대한 정규 분포의 분산이다. 회귀 계수 β의 사후 평균(μβ)은 다음과 같이 계산된다.

| (3) |

최종 예측()은 회귀 계수의 사후 평균을 기반으로 계산된다.

| (4) |

다항 회귀 모델은 입력 변수와 출력 변수 간의 관계가 선형적이지 않을 경우, 다항식을 사용하여 비선형 관계를 모델링하는 회귀 방법이다. 이 모델은 선형 회귀의 확장 형태로, 높은 차수의 다항식을 사용하여 더욱 복잡한 관계를 모델링할 수 있다. 본 연구에서는 데이터의 특성을 고려하여 다항식 차수 d를 10으로 설정하였다. 다항 회귀는 식 (5)와 같이 표현된다. y는 예측하고자 하는 출력값이고, x는 입력값을 나타낸다. βi는 각 항의 회귀 계수(coefficient)이며, ϵ는 실제 값과 모델이 예측한 값의 차이를 나타내는 오차항이다.

| (5) |

이와 같이 세 가지 회귀 모델을 실험하여, 각 모델의 평균 오차를 비교하고, 퍼팅 거리 예측에서 가장 우수한 성능을 보인 모델을 선정한다.

Ⅲ. 실험 결과

1. 실험 환경

본 연구에서는 골프공 탐지 신경망의 미세 조정 및 탐지 성능 평가의 목적으로 퍼팅 연습기로 퍼팅하는 모습을 디지털 카메라로 직접 촬영하여 동영상 데이터셋을 구축하였다. 데이터셋은 총 51개의 동영상으로 구성되며, 각 동영상은 1920x1080 해상도와 평균 약 8초 길이를 갖는다. 모든 동영상은 다양한 거리를 타격하는 퍼팅 동작을 포함하며, 각 동영상에는 퍼팅 거리(m)와 시작 및 종료 프레임 번호를 함께 기록하였다. 동영상 데이터셋은 학습 데이터 32개, 검증 데이터 9개, 실험 데이터 10개로 분할하였으며, 실험 데이터는 성능 평가에만 사용하였다. 또한, 탐지 신경망의 일반화 성능을 확인하기 위해 기존 데이터셋 외에 추가적으로 다른 배경에서 촬영한 unseen 퍼팅 동영상 4개를 사용하였다.

YOLOv8 탐지 신경망의 학습에는 퍼팅 동영상 데이터셋의 모든 동영상을 프레임 단위로 추출하여 학습용 이미지 데이터셋으로 변환하였다. 결과적으로 학습 데이터는 7,415장, 검증 데이터는 2,124장, 실험 데이터는 2,222장의 이미지로 구성되었다. 또한, 과적합을 완화하고 다양한 배경에서의 학습 성능을 향상시키기 위해 Roboflow에서 제공하는 골프공 데이터셋[19]을 추가로 사용하였다. 해당 데이터셋은 학습 데이터 2,198장, 검증 데이터 226장, 실험 데이터 171장으로 구성된다. 두 데이터셋을 병합하여 총 14,356장의 학습 데이터를 생성하였으며, 이를 활용해 YOLOv8 신경망의 ‘sports ball’ 클래스를 ‘golf ball’ 클래스에 맞게 미세 조정 학습하였다. 미세 조정 학습을 위한 하이퍼파라미터를 다음과 같이 설정하였다. 학습률은 1.0e-06, epoch 수는 50으로 설정하였으며, AdamW 옵티마이저와 모멘텀(momentum) 0.937을 사용하였다. 이미 최적화가 잘 되어 있는 사전 학습된 신경망을 활용하므로 학습률을 낮게 설정하고 epoch 수를 최소화하여 과도한 가중치 변화와 과적합을 방지하였다. 또한, 가중치 감소(weight decay)를 적용할 수 있는 AdamW 옵티마이저를 사용하여 신경망의 일반화 성능을 향상시키고자 하였다.

회귀 모델 학습에는 동영상 데이터셋에서 기록된 퍼팅 거리와 시작 및 종료 프레임 번호로 골프공의 속도를 계산한 데이터를 사용하였다. 학습 데이터는 퍼팅 동영상 데이터셋의 train과 valid 데이터를 합쳐 27개로 구성하였고, test 데이터 10개는 성능 평가에 사용되었다. 이를 통해 퍼팅 거리와 골프공 속도의 관계를 모델링하고, 거리 예측 성능을 평가하였다. 학습 및 실험은 AMD Ryzen 9 5950X CPU와 NVIDIA GeForce RTX 2080 Ti(11GB VRAM) GPU를 사용하였다.

2. 실험 결과

[표 1]에서는 YOLOv8 Large 신경망과 신호처리 기반 추적 알고리즘의 조합 탐지 성능을 나타낸다. 실험 결과에 따르면, 골프공 탐지 신경망으로 YOLOv8 Large, 신호처리 기반 추적 알고리즘으로 Median Flow를 사용한 조합이 평균 70.6%로 가장 높은 탐지 성능을 보였다. 반면, 신호처리 기반 추적 알고리즘으로 CSRT와 MOSSE를 사용한 경우 mAP@50이 각각 평균 43.3%와 23.8%로 낮은 성능을 기록하였다.

Median Flow는 빠른 움직임과 상대적으로 일정한 크기의 객체를 안정적으로 추적하는 데 적합한 특성을 가지고 있어 퍼팅 환경에서 높은 탐지 성능을 보였다. 반면, CSRT와 MOSSE는 급격한 크기 변화나 위치 변동에 적응하는 데 한계가 있어, 골프공의 크기와 움직임이 달라질 경우 추적 성능이 저하되는 모습을 보였다.

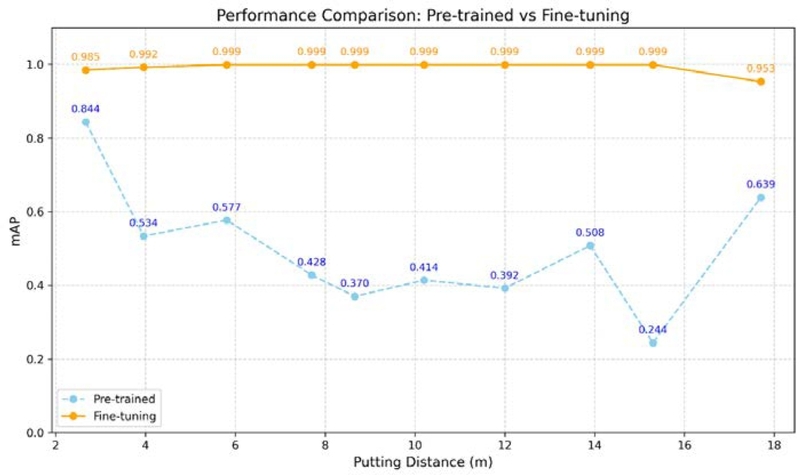

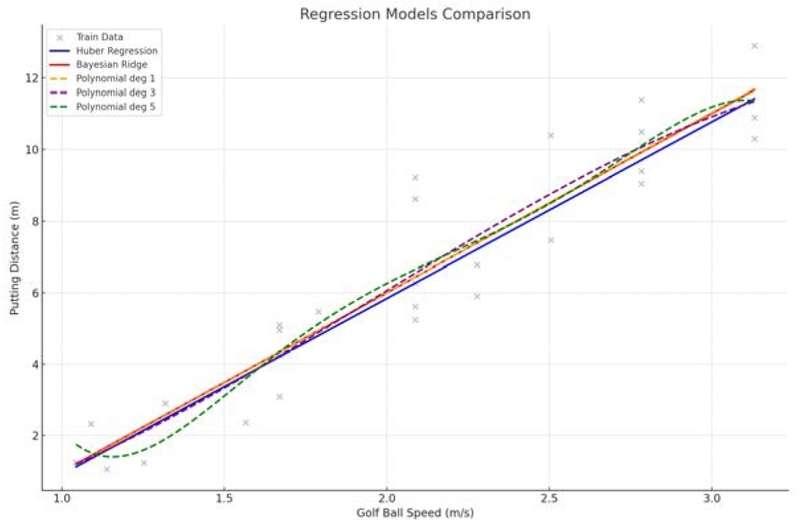

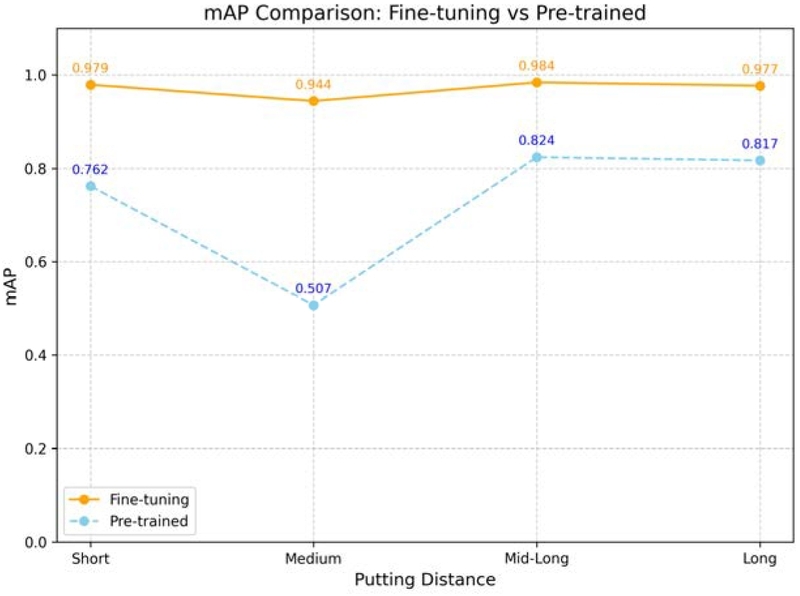

[표 2]는 사전 학습된 YOLOv8 Large 신경망과 미세 조정 훈련된 YOLOv8 Large 신경망의 탐지 성능을 보여준다. 사전 훈련 신경망의 mAP@50은 평균 49.5%로, 골프공의 속도가 빠를수록 탐지 성능이 낮아지는 경향을 확인할 수 있다. 반면, 미세 조정 훈련 신경망의 mAP@50은 평균 98.9%로, 거의 모든 골프공을 성공적으로 탐지하며, 골프공 속도가 빨라져도 높은 mAP@50을 유지하는 모습을 보여준다. [그림 3]은 YOLOv8 Large의 사전 훈련 신경망과 미세 조정 훈련 신경망의 mAP@50을 비교한 그래프이다.

다만, 미세 조정 훈련 신경망의 mAP@50 성능이 평균 98%로 매우 높게 나온 점은 과적합(overfitting)의 가능성을 시사한다. 본 연구를 위해 구축한 자체 데이터셋은 실내 퍼팅 환경을 촬영한 영상으로, 고정된 배경으로 인해 변수가 적어 과적합이 발생하기 쉬운 조건이다. 퍼팅 연습기는 주로 실내에서 사용되지만, 사용자에 따라 환경이 변화할 수 있으므로 다양한 배경에서 성능이 일정하게 유지되는 일반화 성능이 요구된다.

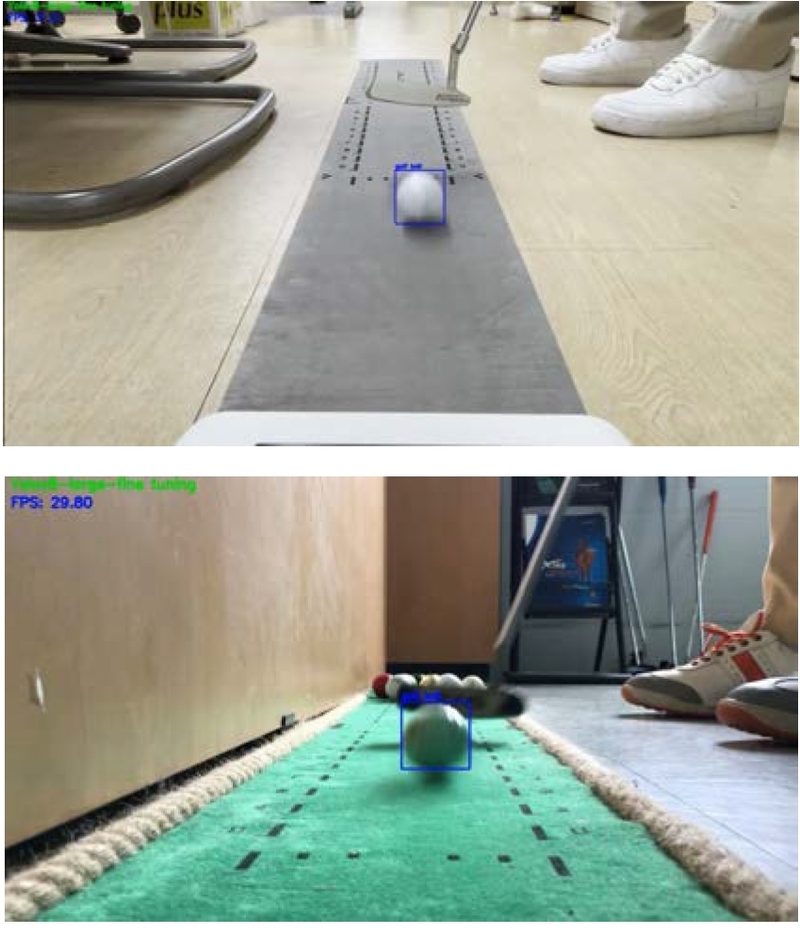

그러나 unseen 퍼팅 동영상에 대해서도 신경망이 안정적으로 골프공을 탐지하는 결과는, 단순한 과적합이 아닌 일반화된 성능을 보였음을 시사한다. [표 3]에서는 미세 조정 신경망이 실내 환경과 다른 배경에서도 높은 성능을 보였음을 확인할 수 있다. 따라서 미세 조정 신경망은 실내 퍼팅 환경에서 신뢰할 수 있는 탐지 성능을 제공한다고 평가할 수 있다. [그림 4]는 Unseen 퍼팅 동영상에 대한 YOLOv8 Large의 사전 훈련 신경망과 미세 조정 훈련 신경망의 mAP@50을 비교한 그래프이다. 배경이 다른 데이터셋에서도 미세 조정된 신경망이 사전 학습된 신경망보다 높은 mAP@50을 유지하는 모습을 보여준다. [그림 5]는 서로 다른 데이터셋에서 YOLOv8 Large의 미세 조정 신경망에 의한 탐지 결과를 보인다.

Comparison graph of mAP@50 between the pre-trained and fine-tuned models of YOLOV8 on the unseen dataset

[표 4]는 YOLOv8 Large 모델과 전통적인 신호처리 기반 추적 알고리즘을 조합했을 때의 FPS 성능을 비교한 결과이다. YOLOv8 Large 신경망을 단독 사용 시 평균 30.32 FPS를 기록하며 실시간 처리 기준인 30 FPS를 충족하였다. 반면, CSRT, Median Flow, MOSSE와 같은 신호처리 기반 추적 알고리즘을 함께 사용할 경우 각각 16.20, 20.68, 21.92 FPS로 처리 속도가 눈에 띄게 감소하였다.

이는 YOLOv8이 탐지한 골프공의 바운딩 박스 좌표를 추적기의 입력으로 전달한 후, 추적 알고리즘이 이를 기반으로 연속적인 프레임에서 추적을 수행하는 구조이기 때문이다. 특히 이러한 추적기들은 CPU 기반으로 동작하므로, GPU를 활용하는 딥러닝 기반 탐지기보다 상대적으로 연산 속도가 느릴 수밖에 없다. 그럼에도 불구하고 YOLOv8 Large는 비교적 무거운 구조임에도 단독으로 실시간 처리 성능을 확보할 수 있어, 실제 응용 환경에서도 충분히 활용 가능함을 시사한다.

[표 5]는 각 회귀 모델별 실제 거리와의 평균 오차를 나타낸다. 가장 적은 오차를 보인 모델은 베이지안 선형 회귀 모델로, 평균 오차는 1.53m이다. 1차 다항 회귀 모델, 2차 다항 회귀 모델, 로버스트 회귀 모델 순으로 각각 1.54m, 1.59m, 1.60m의 평균 오차를 기록하였다. 이는 데이터가 전반적으로 선형적인 구조를 가지며, 표본 수가 적고 일부 노이즈가 존재하는 특성상, 단순한 회귀 모델이 더 높은 예측 안정성과 일반화 성능을 보였음을 시사한다. 한편, 다항 회귀 모델은 차수가 증가할수록 평균 오차가 점진적으로 커지는 경향을 보였다. 특히 5차 다항 회귀는 평균 오차가 13.264m로, 다른 모델들과 비교해 월등히 큰 오차를 기록하였다. 이는 고차항이 학습 데이터의 패턴에 지나치게 민감하게 반응하여, 테스트 데이터에 대한 일반화 성능이 크게 저하되었음을 의미한다.

[그림 6]은 학습 데이터에 대해 로버스트 회귀, 베이지안 선형 회귀 그리고 1차, 3차, 5차 다항 회귀 모델을 적용한 예측 결과를 시각화한 것이다. 전체적으로 베이지안 선형 회귀 모델은 학습 데이터의 분포를 잘 따라가며 안정적인 예측 선을 형성하였고, 1차 다항 회귀 또한 선형적인 경향을 잘 반영하였다. 반면, 5차 다항 회귀는 일부 구간에서 급격한 곡률 변화를 보이며 과적합된 경향을 보인다.

Ⅳ. 결 론

본 연구에서는 디지털 카메라와 컴퓨터 비전 기술을 활용한 퍼팅 거리 예측 방법을 제안하였다. 기존 퍼팅 연습기는 압전 센서를 활용하지만, 센서 보정이 필요하고 환경적 요인에 취약하다는 한계가 있었다. 이를 극복하기 위해 본 연구에서는 YOLOv8 Large 신경망을 활용한 객체 탐지 모듈과 회귀 모델을 적용한 거리 추정 모듈을 개발하였다.

실험 결과, 미세 조정된 YOLOv8 Large 모델이 mAP@50 98.9%의 성능을 보여 최적의 탐지 방법으로 선정되었으며, 퍼팅 거리 추정에서는 베이지안 선형 회귀 모델이 가장 낮은 평균 오차(1.5347m)를 기록하며 우수한 성능을 보였다. 또한, YOLOv8 Large는 비교적 복잡한 구조임에도 불구하고 평균 30.32 FPS의 실시간 처리 성능을 달성하여, 탐지 정확도와 처리 속도 측면 모두에서 뛰어난 효율을 보였다. 일반화 성능을 평가하기 위해 unseen 환경에서도 실험을 진행한 결과, 미세 조정된 탐지 모델이 높은 성능을 유지하며 기존 센서 기반 방식의 한계를 극복할 가능성을 입증하였다.

본 연구의 결과는 골프 퍼팅 훈련 시스템에서 컴퓨터 비전 기반의 거리 예측 방법이 실용적 대안이 될 수 있음을 보여준다. 향후 연구에서는 탐지 신경망의 경량화 및 실시간 처리 최적화를 통해 실제 제품 적용 가능성을 높이는 것을 목표로 하며, 퍼팅 거리 데이터의 정밀한 분석을 통해 회귀 모델의 예측 성능을 더욱 개선하는 방향으로 연구를 확장할 계획이다.

References

-

J. Park, “The Methodology of the Golf Swing Similarity Measurement Using Deep Learning-Based 2D Pose Estimation,” Journal of The Korea Society of Computer and Information, Vol.28, No.1, pp.39-47, 2023.

[https://doi.org/10.9708/jksci.2023.28.01.039]

- J. Smith and M. Johnson, “Deep Learning-Based Player Tracking and Recognition in Sports,” Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach, USA, pp. 1234-1242, 2019.

- J. Ko, K. Kim, S. Lee, J. Kim, S. Jeong, and J. Kim, “Measurement of Golf Ball Speed and Launch Angle Using 24 ㎓ FM-CW Doppler Radar,” Journal of Broadcast Engineering, Vol.22, No.3, pp.123-124, June 2017.

- Korea Intellectual Property Office, Putting Distance Measuring Device and Method Using the Same, KR101596626B1, Korea, 2015.

-

R. Baidya and S. Lee, “Tracking The Trajectory of a Golf Ball Based on Hough Transform and YOLO” Journal of Broadcast Engineering, Vol.26, No.1, pp.42–52, Jan. 2021.

[https://doi.org/10.23019/kingpc.17.2.202104.004]

-

X. Zhang, T. Zhang, Y. Yang, Z. Wang, and G. Wang, “Real-time Golf Ball Detection and Tracking Based on Convolutional Neural Networks,” Proceedings of the 2020 IEEE International Conference on Systems, Man, and Cybernetics (SMC), pp. 2945–2950, Oct. 2020.

[https://doi.org/10.1109/SMC42975.2020.9283312]

-

G. James, D. Witten, T. Hastie, and R. Tibshirani, “An Introduction to Statistical Learning with Applications in R”, Springer, New York, pp.1-426, 2013.

[https://doi.org/10.1007/978-1-4614-7138-7_1]

- Ultralytics, “YOLOv8: A Cutting-Edge Object Detection Model,” GitHub Repository, Available: https://github.com/ultralytics/ultralytics, , accessed Jan. 13, 2025.

-

J. Redmon, S. Divvala, R. Girshick, and A. Farhadi, “You Only Look Once: Unified, Real-time Object Detection,” Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Boston, USA, pp. 779-788, 2015.

[https://doi.org/10.1109/CVPR.2016.91]

-

J. Redmon and A. Farhadi, “YOLO9000: Better, Faster, Stronger,” Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, USA, pp. 6517-6525, 2016.

[https://doi.org/10.1109/CVPR.2017.690]

- J. Redmon and A. Farhadi, “YOLO v3: An Incremental Improvement,” Available at: https://pjreddie.com/media/files/papers/YOLOv3.pdf, [Accessed Mar. 13, 2020].

- A. Bochkovskiy, C.-Y. Wang, and H.-Y. M. Liao, “YOLOv4: Optimal Speed and Accuracy of Object Detection,” arXiv preprint arXiv:2004.10934, , 2020. [Online]. Available: https://arxiv.org/abs/2004.10934

- C. Li, L. Li, H. Jiang, K. Weng, Y. Geng, L. Li, Z. Ke, Q. Li, M. Cheng, W. Nie, Y. Li, B. Zhang, Y. Liang, L. Zhou, X. Xu, X. Chu, X. Wei, and X. Wei, “YOLOv6: A Single-Stage Object Detection Framework for Industrial Applications,” arXiv preprint arXiv:2209.02976, , 2022. [Online]. Available: https://arxiv.org/abs/2209.02976

-

C.-Y. Wang, A. Bochkovskiy, and H.-Y. M. Liao, “YOLOv7: Trainable Bag-of-Freebies Sets New State-of-the-Art for Real-Time Object Detectors,” arXiv preprint arXiv:2207.02696, , 2022. [Online]. Available: https://arxiv.org/abs/2207.02696

[https://doi.org/10.1109/CVPR52729.2023.00721]

-

A. Lukežič, T. Vojíř, L. Čehovin, J. Matas, and M. Kristan, “Discriminative Correlation Filter with Channel and Spatial Reliability,” Proceedings of IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, Hawaii, USA, pp. 6309–6318, 2017.

[https://doi.org/10.1109/CVPR.2017.515]

-

Z. Kalal, K. Mikolajczyk, and J. Matas, “Forward-Backward Error: Automatic Detection of Tracking Failures,” Proceedings of the International Conference on Pattern Recognition (ICPR), Istanbul, Turkey, pp. 2756–2759, 2010.

[https://doi.org/10.1109/ICPR.2010.675]

-

D. S. Bolme, J. R. Beveridge, B. A. Draper, and Y. M. Lui, “Visual Object Tracking using Adaptive Correlation Filters,” Proceedings of IEEE Conference on Computer Vision and Pattern Recognition (CVPR), San Francisco, USA, pp. 2544-2550, 2010.

[https://doi.org/10.1109/CVPR.2010.5539960]

-

T.-Y. Lin, M. Maire, S. Belongie, J. Hays, P. Perona, D. Ramanan, P. Dollár, and C. L. Zitnick, “Microsoft COCO: Common Objects in Context,” Proceedings of European Conference on Computer Vision (ECCV), Zurich, Switzerland, pp. 740–755, 2014.

[https://doi.org/10.1007/978-3-319-10602-1_48]

- “GolfBallDetector Computer Vision Project,”, Available: https://universe.roboflow.com/mrinmoy-bhadra-lojma/golfballdetector, , accessed Dec. 26, 2025.

-

P. J. Huber, “Robust Estimation of a Location Parameter,” The Annals of Mathematical Statistics, Vol. 35, No. 1, pp. 73-101, 1964.

[https://doi.org/10.1214/aoms/1177703732]

- C. M. Bishop, Pattern Recognition and Machine Learning, Springer, New York, pp.152–161, 2006.

-

E. Ostertagová, “Modelling Using Polynomial Regression,” Procedia Engineering, Vol. 48, pp. 500-506, Dec. 2012.

[https://doi.org/10.1016/j.proeng.2012.09.545]

- 2025년 : 국립한밭대학교 정보기술대학 정보통신공학과 학사

- 2025년 ~ 현재 : 국립한밭대학교 소프트웨어융합대학원 지능미디어공학과 석사과정

- ORCID : https://orcid.org/0009-0009-9298-1195

- 주관심분야 : 컴퓨터 비전, 기계 학습, 딥러닝

- 2024년 : 국립한밭대학교 정보기술대학 정보통신공학과 학사

- 2024년 ~ 현재 : 국립한밭대학교 소프트웨어융합대학원 지능미디어공학과 석사과정

- ORCID : https://orcid.org/0009-0008-2532-0322

- 주관심분야 : 컴퓨터 비전, 기계 학습, 딥러닝

- 2023년 : 국립한밭대학교 정보기술대학 정보통신공학과 학사

- 2025년 : 국립한밭대학교 소프트웨어융합대학원 지능미디어공학과 석사

- 2025년 ~ 현재 : 윌러스표준기술연구소 주임연구원

- ORCID : https://orcid.org/0009-0003-5855-2692

- 주관심분야 : 영상처리, 영상압축, 비디오압축, 신호처리, 컴퓨터 비전, 딥러닝

- 1997년 : 경북대학교 전자공학과 학사

- 1999년 : 한국과학기술원 전기전자공학과 석사

- 2004년 : 한국과학기술원 전기전자공학과 박사

- 2004년 ~ 2010년 : 한국전자통신연구원 방송미디어연구부 선임연구원

- 2010년 ~ 현재 : 한밭대학교 정보기술대학 지능미디어공학과 교수

- ORCID : https://orcid.org/0000-0002-7594-0828

- 주관심분야 : 영상처리, 비디오압축, 컴퓨터 비전, 딥러닝