증강현실을 활용한 광산지형정보 3차원 가시화 기술

Copyright © 2026 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

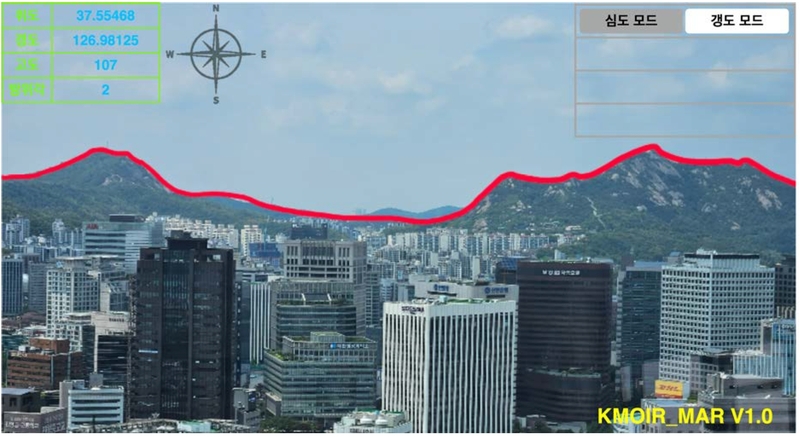

본 연구는 광산 지리정보시스템(Mine Geographic Information System, MGIS) 데이터를 현장에서 직관적으로 활용하기 위한 모바일 증강현실 기반 3차원 가시화 시스템을 제안한다. 제안 시스템은 사용자의 위치·자세를 추정해 갱도 중심선·실태조사 등 MGIS 레이어를 GeoJSON으로 경량화하여 실시간으로 중첩하고, 클라우드로 최신 정보를 현장에서 즉시 공유한다. 핵심은 DEM(Digital Elevation Model) 데이터를 Mesh로 변환해 생성한 360° 스카이라인 LUT(LookUp Table)와 SegFormer로 추출한 스카이라인을 ZNCC/NCC(Zero-mean Normalized Cross-Correlation/Normalized Cross-Correlation)로 정합하여 방위각을 정밀 보정한다. BVH(Bounding Volume Hierarchy) 인덱싱과 수 kB급 LUT로 모바일에서 30-60Hz를 달성하며, GNSS(Global Navigation Satellite System)가 불안정한 산악 환경에서도 안정적인 3D 오버레이 기준을 제공해 안전 점검·실태조사의 공간 이해도와 업무 효율을 높인다.

Abstract

We present a mobile augmented reality (MAR) system for in-situ 3D visualization of Mine Geographic Information System (MGIS) data. The system estimates user pose and overlays key MGIS layers—such as tunnel centerlines and field survey records—after converting them into lightweight GeoJSON, while cloud synchronization enables immediate access and updates on site. Our core technique converts a DEM into a mesh to build a 360° skyline look-up table (LUT); we then refine yaw by correlating this LUT (ZNCC/NCC) with the skyline extracted from the input image using SegFormer. With BVH indexing and a few-kilobyte LUT, the system achieves real-time updates at 30-60Hz on mobile devices. This vision-based yaw correction stabilizes the reference for MGIS 3D overlays even in mountainous areas where GNSS is unreliable, improving spatial understanding and operational efficiency for safety inspection and field surveys.

Keywords:

Mobile Augmented Reality (MAR), Mine Geographic Information System (MGIS), Skyline Matching, DEM-based Pose Estimation, Real-time 3D VisualizationⅠ. 서 론

국내외에서는 디지털 트윈·스마트마이닝 전환과 함께 현장 안전 점검·자산관리 업무에 AR/VR을 접목하려는 연구와 도입이 활발하다[1]. 그러나 이질적인 MGIS/센서 데이터, 산악·지하 환경의 GNSS 불안정, 대용량 3D 지형·갱도 데이터의 모바일 렌더링 제약 등으로 현장에서의 ‘직접 활용’은 여전히 제한적이다[2]. 이런 GNSS 제약을 보완하기 위해 카메라 영상과 지도·지형 데이터를 결합하는 비전 기반 내비게이션/보조 시스템 연구도 활발히 진행되고 있다[3]. 예를 들어, 도시 협곡(urban canyon) 환경에서 파노라마 영상을 이용한 스카이라인 기반 위치 추정을 수행하는 Skyline2GPS 기법이 제안되었고[4], 산악 사진과 디지털 표고 모델(DEM)을 정합해 산봉우리 후보를 식별하고 카메라 위치를 추정하는 연구도 보고되었다[5]. 또한, 산악 지형에서 DEM으로부터 생성한 스카이라인과 관측 영상을 정합하여 방위각을 보정하는 방법[6], 파노라마 스카이라인을 이용해 구릉지(hilly area)에서 고속으로 위치를 추정하는 기법[7] 등은 스카이라인과 DEM을 결합한 위치·자세 추정의 잠재력을 보여준다. 그럼에도 불구하고 이러한 연구 결과가 광산지리정보시스템(MGIS)과 직접 연계되어, 현장 정문가가 활용 가능한 모바일 증강현실 기반 광산 정보 시스템으로 구현된 사례는 아직 제한적이다.

광산 정보를 현장에서 직접 활용할 수 있다면 그 활용 가치는 현저히 높아질 수 있으나, 현재까지는 광산 지적 정보를 현장 상황과 실시간으로 연계하여 제공하는 서비스가 미비한 실정이다. 때문에 현장 전문가들이 광산 정보가 담긴 일지, 보고서, 2차원 지도에 의존하여 현장 감식을 진행하고 있으며, 지하 갱도 구조나 갱구 위치, 과거 실태조사 내역을 머릿속에서 3차원으로 재구성해야 하는 어려움이 존재한다. 이는 복잡한 갱도 구조와 지형 변화가 큰 산악 환경에서 작업 안전성과 운영 효율성을 저해하는 요인으로 작용한다. 따라서 갱도 구조, 갱구 위치, 실태조사 내역 등 주요 공간 정보를 2차원 평면이 아닌 3차원 공간 위에서 직관적으로 제시하고, GNSS 오차가 존재하더라도 안정적으로 위치와 방향을 정렬해 줄 수 있는 기술적 대안이 필요하다.

본 연구에서는 이러한 한계를 극복하기 위해 모바일 증강현실(Mobile Augmented Reality, MAR) 기반의 3차원 가시화 시스템을 제안한다. 제안 시스템은 사용자의 실제 위치와 방향을 추정한 뒤, 광산지리정보시스템(Mine Geographic Information System, MGIS) 데이터를 현실 공간 위에 중첩 가시화하여 현장에서의 실시간 정보 인식과 의사결정 과정을 직관적으로 지원하도록 설계되었다. 이를 위해 기존의 단순 지리정보시스템(Geographic Information System, GIS) 3차원 시각화를 넘어서, 디지털 표고 모델(Digital Elevation Model, DEM) 데이터를 Mesh로 변환하여 생성된 산 능선(스카이라인) 지형 정보를 입력 영상과 정합함으로써 현재 위치와 방위를 보정하는 모듈을 도입하였다. 이와 유사하게, 선행 연구들에서는 산악 지형에서 스카이라인과 DEM을 정합하여 방위각 보정을 수행하거나[6], 파노라마 스카이라인을 활용해 위치를 추정하는 기법[7]을 제안해 왔다. 본 연구는 이러한 스카이라인 정합 기반 기법을 MGIS 레이어와 결합된 모바일 AR 환경에 통합함으로써, 단순한 카메라 포즈 추정을 넘어 광산 속성 정보의 정밀한 공간 중첩까지 동시에 달성하도록 설계된 점에서 차별성을 가진다.

또한, 본 연구에서 사용하는 DEM 데이터는 국토지리정보원(National Geographic Information Institute, NGII)에서 제공하는 한국 표고 모델을 기반으로 하며[8], 이를 Mesh 형태로 변환하여 360° 스카이라인 룩업 테이블(Look-Up Table)을 생성하고, 실제 카메라 영상에서 추출한 스카이라인과의 상관도를 계산함으로써 GNSS가 불안정한 산악 지형에서도 높은 정확도의 실시간 위치 및 자세 추정을 가능하게 한다. 나아가, 기존 연구들이 주로 특정 지형에서의 포즈 보정 또는 위치 추정 성능에 초점을 맞추었다면[4][5][6][7], 본 연구는 이러한 비전·지형 기반 정합 모듈을 MGIS 데이터, 실태조사 이력, 현장 속성 정보와 유기적으로 통합하여 실제 광해방지사업 및 안전 점검 업무에 투입 가능한 AR 시스템으로 구현했다는 점에 의의가 있다.

궁극적으로 본 연구는 스마트 글래스 및 모바일 기기에서 현장 중심의 3차원 공간 정보 가시화와 정밀 위치 인식이 가능한 통합형 광산 정보 시스템을 구축하는 것을 목표로 한다. 제안 시스템은 광해방지사업 수치 정보와 MGIS 레이어를 현장에서 신속하게 조회·비교할 수 있도록 지원하고, 위치·방위 보정 모듈을 통해 GNSS 오차를 줄임으로써, 향후 광산 실태조사 및 안전관리 업무 효율화를 크게 향상시킬 것으로 기대된다.

Ⅱ. 국내 외 기술 동향

해외에서는 광산 활동 및 지하 시설물 관리를 위해 3차원 공간 이미지를 구축하여 현장 모니터링에 도입하기 시작하였으나, 한국은 약 5,400여 개의 광산이 전국 산악지에 산재되어 있어 전국 단위의 세밀한 3차원 이미지화에는 한계가 존재한다. 이러한 상황에서 국내 외에서는 지리정보시스템(Geographic Information System, GIS)과 증강현실(Augmented Reality, AR) 기술의 결합을 통해 현실 공간의 지리 정보를 정밀하게 시각화하고, 이를 실시간으로 활용 가능한 3차원 공간정보 서비스로 확장하기 위한 다양한 연구가 활발히 진행되고 있다[9][10][11]. Bazargani 등[9]의 연구는 GIS-AR 통합 응용 사례를 도시 계획, 환경 모니터링, 내비게이션, 시설 관리 등으로 분류하고, AR 장치를 통해 GIS 레이어를 실세계 영상 위에 중첩하는 다양한 시스템 구조와 장·단점을 정리하였다. Ma 등[10]의 연구는 모바일 단말의 카메라 영상과 실내 지도 데이터를 결합하여, 맵 매칭-비전 트래킹-경로 안내 UI로 이어지는 파이프라인을 제안함으로써, 지도 데이터와 카메라 좌표계를 일치시키는 AR 내비게이션 구조를 구체적으로 보여준다. 한편, Cozman과 Krotkov[11]의 연구는 야외 시나리오에서 시각적 랜드마크를 이용해 원격 조종 루나로버의 위치를 추정하는 방법을 제안하여, 카메라 영상에서 추출한 특징과 사전에 구축된 지형 모델을 대응시키는 비전 기반의 위치 추정 개념을 초기의 단계에서 제시하였다. 이러한 연구들은 공통적으로, 지도의 좌표계와 카메라의 좌표계를 정합하여 3D 정보를 영상 위에 정확히 배치하는 것이 GIS-AR 응용의 핵심이라는 점을 보여준다.

한편, 영상·센서 데이터와 지형·지도 정보를 정합하여 보다 정밀한 위치·자세 추정을 수행하려는 시도도 병행되고 있다. Zhu 등[12]의 연구는 비디오 스트림에서 추출한 스카이라인과 3D 도시 모델 및 GIS 데이터에서 생성한 참조 스카이라인을 정합하는 기법을 제안하여, 조명·계절 변화에도 강건한 영상-GIS 등록을 구현하였다. 이 연구에서는 각 프레임에서 하늘-지형(건물) 경계를 추출한 뒤 이를 1차원 각도-고도 곡선으로 표현하고, GIS 기반 3D 모델에서 렌더링한 스카이라인과의 유사도를 계산하여 카메라의 외부 파라미터를 추정한다. Carle 등[13]의 연구는 지상 LiDAR 스캔을 궤도 고도맵(DEM)과 매칭하여 행성 탐사 로버의 장거리(global) 위치를 추정하는 방법을 제시하였으며, DEM에서 생성한 가상 관측과 실제 LiDAR 포인트클라우드를 정합하는 여러 매칭 전략을 비교하였다. 이어서 Furgale 등[14]의 연구는 다양한 전역 위치 추정 알고리즘을 비교·분석하여, 행성 탐사 시나리오에서 DEM·고도맵과 실측 센서 데이터를 결합한 위치 인식 프레임워크가 어떤 장단점을 가지는지 체계적으로 정리하였다. 이들 연구는, 스카이라인·고도맵·지형 경계와 같은 대규모 지형 구조를 센서 관측과 정합하여 위치·자세를 보정하는 접근이 도심·산악·행성 탐사 등의 다양한 도메인에서 효과적임을 보여준다.

최근 연구 동향에서는 특히 스카이라인 및 지평선을 활용하여 GNSS가 불안정한 환경에서 방위각과 위치를 보정하는 기법들이 SOTA 수준으로 발전하고 있다. Pan 등[7]의 연구는 파노라마 스카이라인을 이용해 구릉지에서 빠르게 위치를 추정하는 방법을 제안하였다. 이 방법은 DEM으로부터 360° 파노라마 스카이라인 LUT를 미리 생성한 뒤, 입력 영상에서 추출한 스카이라인 곡선을 1차원 각도-고도 시퀀스로 변환하고, 회전 이동시키며 상관계수 기반 유사도를 계산하여 최적 위치·방위각 후보를 찾는 구조를 취한다. Nagy 등[6]의 연구는 산악 지형에서 스카이라인 정합을 통해 방위각(azimuth) 오차를 정밀하게 보정하는 방법을 제안하였다. 여기서는 DEM에서 생성한 참조 스카이라인과 관측 스카이라인의 차이를 최소화하는 최적화 문제로 방위각을 추정함으로써, 초기 나침반·GNSS 헤딩 값의 편향을 몇 도 수준으로 줄일 수 있음을 실험적으로 보였다. Bouyssounouse 등[15]의 연구는 행성 탐사 및 야외 로봇 내비게이션을 대상으로, 지평선·스카이라인과 같은 지형 경계를 이용하여 로버의 orientation을 추정하는 알고리즘을 제안하였다. 이 알고리즘은 카메라 영상에서 추출한 지평선을 DEM 기반 시뮬레이션 지평선과 정합하여, 고도가 크게 변하는 환경에서도 자세 추정의 안정성을 확보하는 것을 목표로 한다. 이러한 스카이라인·지평선 기반 연구들은, 지형 윤곽을 1차원 신호로 단순화하면서도 장거리 구조 정보를 유지하여, GNSS를 보조·대체할 수 있는 강력한 정합 단서로 활용할 수 있음을 공통적으로 보여준다.

도심 환경에서는 GNSS가 고층 건물로 인해 빈번히 교란되기 때문에, 시멘틱 정보를 활용한 비전 기반의 위치 추정 연구도 함께 제안되고 있다. Lee 등[16]의 연구는 스마트폰 카메라 영상과 의미 분할 결과를 결합한 Semantic Visual Positioning Service(VPS)를 제안하여, 건물·도로·지면과 같은 의미 클래스별 특징을 지도 정보와 연결함으로써 도심 환경에서의 위치 정확도를 향상시켰다. 이와 같이, 스카이라인·DEM 기반 정합[6][7][12][13][14][15]과 시멘틱 지도 기반 VPS[16]는 서로 다른 도메인에서 발전해 온 연구 흐름이지만, 카메라 영상에서 추출한 고수준 구조·의미 정보를 지리 공간 데이터와 정합하여 위치·자세를 정밀 보정한다는 공통된 목표를 가진다.

이러한 연구 성과들은 실측 데이터와 시뮬레이션 환경을 연계하여 도시 및 산업 인프라의 관리 효율성을 향상시키고 있다. 특히 산악 지형 및 산업 현장을 대상으로 하는 실외형 모바일 AR 서비스 연구가 확장되면서, 실제 지면의 고도·형상 정보를 정밀하게 반영하기 위해 DEM과 도메인별 GIS 데이터를 융합하는 기술이 주목받고 있다. 파노라마 스카이라인을 이용해 구릉지에서 빠르게 위치를 추정하는 기법[7], 산악 지형에서 스카이라인 정합을 통해 방위각을 정밀하게 보정하는 방법[6], 그리고 행성 탐사와 야외 로봇 내비게이션에서 지평선·스카이라인 경계를 이용하여 기기의 orientation을 추정하는 연구[15]는 스카이라인 기반 정합의 GNSS 보조 및 대체 기술로서 실질적인 잠재력을 지님을 시사한다. 본 연구는 이러한 DEM·스카이라인 정합 기반 기법을 광산지리정보시스템(MGIS)과 결합하여, 모바일 AR 환경에서 갱도 중심선, 갱구 위치, 실태조사 정보 등을 정밀하게 중첩하는 통합형 시스템으로 확장한다는 점에서 기존 연구와 차별점을 가진다. 나아가, 국토지리정보원의 한국 DEM[8]을 기반으로 실제 산악 지형을 반영한 360° 스카이라인 LUT를 구축하고, 이를 모바일 디바이스에서 실시간으로 활용 가능하도록 경량화함으로써, 향후 산업 현장의 안전 관리, 실태조사, 지형 변화 감지 등 다양한 응용 분야에서 높은 활용 가능성을 제시한다.

Ⅲ. MAR 기술 적용

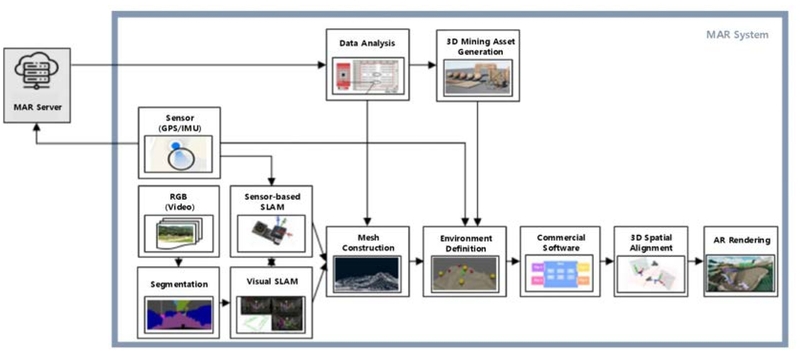

전체 시스템은 그림 1과 같은 과정으로 진행되는데, 이는 크게 두 가지 과정으로 구성된다. 첫째, GPS 센서 정보와 산 능선 정합을 통해 사용자의 현재 위치 및 자세를 정밀하게 추정하고[17], 이동 경로는 SLAM 기술을 활용하여 실시간으로 추적한다[18]. 둘째, 이렇게 산출된 위치 정보를 기반으로 MGIS 데이터를 3차원 공간에 정합하여 시각화한다. 이를 통해 현장 실무자는 주변 광산 정보를 AR 환경에서 입체적으로 확인할 수 있으며, 안전 점검 및 실태조사 과정에서 공간적 이해도를 높인다.

1. MGIS 데이터 분석

MGIS는 폐광산의 갱도 구조, 갱구 위치, 갱도 중심선 등과 같은 핵심 공간 정보뿐만 아니라, 지반 침하, 수질오염, 산지 및 토양 복원 등 광산 주변에서 발생할 수 있는 다양한 환경 요소에 대한 속성 정보를 포함한다. MGIS는 석탄광, 금속광, 비금속광 등 광종별 구분에 따라 상이한 형태의 공간 지표를 제공하며, 특히 수십만 개 수준의 객체로 구성된 갱도 중심선은 지면 아래 갱도의 3차원 구조를 가장 효과적으로 표현할 수 있는 핵심 데이터로 평가된다. 본 연구에서는 모바일 증강현실(Mobile AR, MAR) 기반 현장 가시화의 실효성을 극대화하기 위해, 실제 현장 실태조사 기록과 MGIS 내의 갱내도 데이터 레이어를 주요 시각화 대상으로 선정하였다. 이를 통해 실태조사 과정에서 기존 정보 대비 변화된 위치, 범위, 상태를 공간적으로 직관적으로 확인하고, 현장 중심의 대응 능력을 향상시키고자 한다.

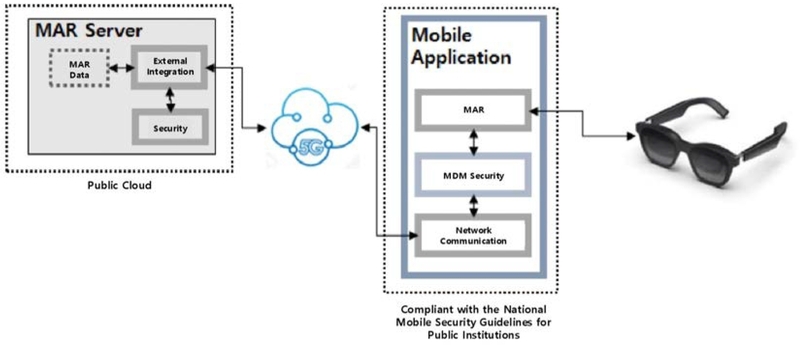

AR 환경에서의 효율적 활용을 위해 폴리곤, 라인, 포인트의 공간 정보를 목적에 맞게 구조화하고, GeoJSON 기반의 경량 표현 포맷으로 변환하여 모바일 환경에서도 부하 없이 실시간 렌더링이 가능하도록 데이터 구조를 최적화하였다. 또한 그림 2와 같이 MGIS 데이터를 클라우드 서버 기반으로 관리하여, 현장에서 작업자가 사용하는 AR 글래스 및 모바일 디바이스와 실시간 양방향 동기화를 지원한다.

Mobile Application에서 캡쳐한 사진과 IMU 센서 정보, GPS 값을 함께 서버로 넘기면, 서버에서는 사진에서 Skyline을 추출하고, 추출한 Skyline Mesh의 Skyline을 매칭하여 방위각을 보정해 다시 AR 글래스로 보내 화면에 매칭 결과를 출력한다.

이를 통해 사용자는 최신 실태조사 정보와 갱도 지표를 현장에서 즉시 조회할 수 있으며, 신규 조사 결과는 서버에 반영되어 다른 사용자 단말에서도 동일하게 확인할 수 있다. 이러한 클라우드 기반 데이터 관리 구조는 광산 안전 점검 및 유지보수 프로세스의 반복성을 고려할 때 높은 활용성과 확장성을 제공한다.

2. GPS 및 Mesh화를 통한 산 능선 추출

산악 환경에서는 지형의 윤곽을 반영하는 산 능선 정보를 안정적으로 확보하는 것이 중요하며, 이는 후속 단계에서 DEM 기반으로 생성된 360° 지형 윤곽과의 비교를 통해 사용자의 방위각을 산출하기 위한 핵심 요소로 활용된다. 이를 위해 먼저 입력 RGB 영상 I에 대해 SegFormer 기반 의미론적 분할을 수행하여 각 픽셀(x,y)에 대한 클래스 맵 C(x,y)를 얻는다[19]. 영상 상단 y ∈ [0,9]구간에서 가장 자주 등장하는 클래스를 하늘 csky레이블 로 정의하고, 이를 이용해 하늘 마스크Sky(x,y)와 비하늘 마스크 NS(x,y)를 식 (1), (2)와 같이 정의한다.

| (1) |

| (2) |

연결 성분 분석을 통해 화면 외곽과 연결되지 않은 작은 고립 영역을 제거함으로써, 실제 산 능선과 무관한 고립 객체나 내부 반사와 같은 비지형적 요소를 배제한다. 정제된 비하늘 마스크에서 각 x열 마다 NS(x,y)인 최초의 y위치를 산 능선 후보 y*(x)로 정의하며, 이는 식 (3)과 같다.

| (3) |

일부 열에서 스카이라인 후보가 존재하지 않는 경우에는 선형 보간을 통해 누락된 값을 보완하고, 1차원 이동 평균 커널 k를 적용하여 계단 형태의 잡음을 완화한 최종 산 능선 궤적 를 얻는다. 이 과정은 식 (4)와 같이 표현된다.

| (4) |

이와 같은 전처리 과정을 통해 영상 내 최상단 윤곽선만을 안정적으로 선별하여 고품질의 산 능선 정보를 를 추출할 수 있다. 그러나 픽셀 좌표계에서 만으로는 DEM 기반 3차원 정보와 직접적으로 정합하기 어렵기 때문에, 이를 카메라 좌표계의 고도각(elevation angle) 표현으로 변환하는 절차가 필요하다.

먼저 카메라의 수평/수직 화각 Fh와 Fv주점 좌표 (cx,cy)를 이용하여, 산 능선이 위치한 열 좌표 xi에 대한 정규화된 이미지 방향 성분 (ui,vi)를 계산한다. 이를 통해 각 열에 대한 투영 방향을 카메라 내부 파라미터에 맞게 보정할 수 있으며, 이 과정은 식 (5)와 같이 정의된다.

| (5) |

계산된 (ui,vi)를 이용하여 카메라 좌표계 기준의 3차원 레이 방향 벡터 di = [ui,vi,1]T를 구성하고, 이를 단위 벡터가 되도록 정규화한다. 정규화된 di는 각 열 xi에서 관측된 산 능선 픽셀에 대응하는 카메라 기준 시선 방향을 의미하며, 이 정의는 식 (6)에 해당한다.

| (6) |

다음으로 IMU 센서를 통해 얻은 roll, pitch 정보를 활용하여 카메라의 기울기를 보정한다. Roll, pitch 각도에 기반해 회전 행렬 R을 구성하고, 이를 레이 벡터 di에 곱함으로써 중력 기준 좌표계에서의 보정된 시선 방향 를 얻는다. 이 단계는 카메라가 수평에서 기울어진 상태로 촬영된 경우에도, 산 능선을 실제 지형 기준의 고도각으로 변환할 수 있도록 해 주며, 관련 관계식은 식 (7), (8)로 정리된다.

| (7) |

| (8) |

보정된 시선 방향 로부터 수평면에 대한 고도각 αi를 계산하여 각 열 xi에 대응하는 산 능선의 고도 정보를 얻는다. 이는 의 수직 성분과 수평 성분의 비를 이용해 아크탄젠트 형태로 정의되며, 구체적인 계산식은 식 (9)에 해당한다.

| (9) |

마지막으로 각 열에 대해 계산된 고도각 αi들을 열 인덱스 순서대로 나열하여, 식 (10)과 같은 1차원 고도각 시퀀스 U를 정의한다. 이 U는 이미지 기반 산 능선을 각도 도메인에서 표현한 관측 스카이라인으로, 이후 DEM 기반 360° 지형 윤곽 LUT와의 ZNCC 정합 단계에서 직접 사용된다. 이러한 식 (10)은 관측 스카이라인과 DEM 스카이라인 간의 일관된 좌표계 정합을 보장한다.

| (10) |

이어서는 DEM을 Mesh화하여 360° 산 능선을 추출하였다. 먼저 DEM을 OBJ 파일로 변환하여 불러온 뒤, 이전 단계에서 산출한 GPS 좌표를 Mesh 좌표계로 정규화하고, 관측 지점에 카메라를 배치하였다. 카메라의 pitch와 roll을 0으로 초기화한 상태에서 0°-359° 방위각을 일정한 각도 간격 Δϕ로 균일 샘플링하여 각 방위각 ϕm을 다음과 같이 정의한다.

| (11) |

각 방위각 ϕm에 대해 관측점p0 = [x0,y0,z0]T에서 시작하여 수평면 상의 단위 벡터 V(ϕm)방향으로 나아가는 레이 rm(t)를 정의하고, 이를 이용해 Mesh와의 교차를 탐색한다. 이 때 레이는 식 (12)와 같이 표현된다.

| (12) |

t > 0에 대해 rm(t)가 Mesh와 처음 교차하는 파라미터 를 찾는다. 해당 교차점 은 으로 정의되며, 관측점과 교차점 사이의 벡터로부터 고도각 βm을 다음과 같이 계산한다.

| (13) |

이렇게 얻어진 βm은 방위각 ϕm방향에서 DEM 지형이 형성하는 산 능선의 고도각을 의미하며, 전체 방위각에 대해 계산된 은 360° 산 능선의 기본 샘플 시퀀스를 이룬다.

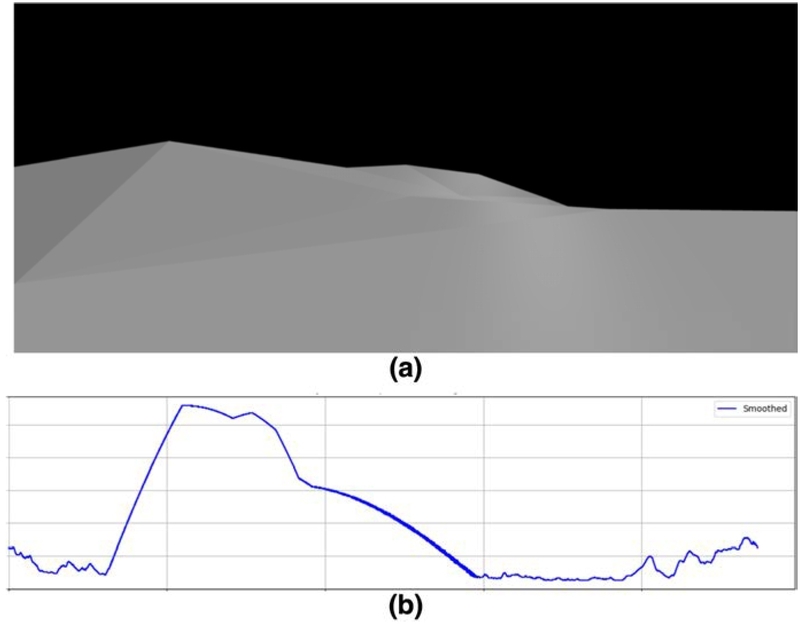

지형의 계단 현상과 누락을 줄이기 위해, 고도각 시퀀스 {βm}에 대해 연속 샘플 보간과 1차원 필터링을 적용하여 스무딩된 산 능선 을 얻는다. 이를 일반화된 가중 이동 평균 형태로 표현하면 다음과 같다.

| (14) |

여기서 wk는 Savitzky-Golay 필터 또는 단순 이동 평균 커널 계수이며, 2K + 1개 이웃 샘플을 이용해 국소적으로 곡선을 평활화한다. 스무딩된 고도각 시퀀스 {}는 과 같이 표현되는 360° Skyline LUT의 핵심 데이터로 사용된다. LUT는 정규화 및 양자화 과정을 거쳐 수 kB 규모로 경량화되며, Mesh는 원거리 단순화와 BVH 인덱싱을 적용하여 Raycasting 비용을 줄임으로써 모바일 환경에서도 약 30 – 60Hz 수준의 업데이트 속도를 확보하였다.

최종적으로 구성된 LUT S는 앞 절에서 정의한 이미지 기반 관측 스카이라인 U와의 ZNCC 및 서로 상관 기반 정합[6]에 사용되며, yaw(방위각) 보정을 통해 GPS가 불안정한 산악 환경에서도 시각 기반의 정밀한 방향 추정이 가능하게 한다. 이렇게 추정된 방위각은 이후 MGIS 3D 오버레이를 위한 기준 좌표를 안정적으로 제공하여, 현장 작업자의 공간 인지와 안전 점검 효율을 향상시킨다[20].

3. 산 능선 정합 및 시각화

입력 이미지에서 추출한 스카이라인 고도각 시퀀스와, DEM으로부터 얻은 360° 산 능선 LUT 를 각각 1차원 각도 시퀀스로 표현한 뒤, 제로-평균 정규화 상관계수(ZNCC)를 이용하여 최적 방위각을 추정한다. 먼저 스마트폰 센서로부터 얻은 초기 방위각 추정값 ψ0을 LUT의 인덱스 c로 대응시키고, 이 주변에서만 정합을 수행하기 위해 탐색 인덱스 집합 I를 다음과 같이 정의한다.

| (15) |

그 다음 각 후보 시작 인덱스 s ∈ I에 대해, DEM 기반 LUT S에서 이미지 스카이라인 길이 N과 동일한 원형 구간 SS를 추출한다.

360° Skyline extracted by Mesh, (a) Meshized DEM data (viewing angle 60°), (b) extracted 360° Skyline from Mesh

이 때 SS는

| (16) |

와 같이 정의되며, 원형 인덱싱을 통해 360° 전 방향에 대해 연속적인 부분 시퀀스를 얻을 수 있다. 이미지 스카이라인 시퀀스 U와 DEM 부분 시퀀스 SS사이의 유사도는 제로-평균 정규화 상관계수(ZNCC)로 계산한다. 여기서 를 각각 U와 SS의 평균이라 할 때, ZNCC 점수 ρ(s)는 다음과 같이 정의된다.

| (17) |

ZNCC는 스카이라인 시퀀스의 전체적인 형상 패턴에 집중하며, 상수 항에 대한 불변성을 가지므로(수직 방향 오프셋·잔여 pitch 등) 이미지 밝기나 전체적인 고도 편차에 둔감하다. 마지막으로 모든 후보 s ∈ I에 대해 ρ(s)를 계산하고, 최댓값을 주는 시작 인덱스s*와 이에 대응하는 yaw의 추정값 를 다음과 같이 구한다.

| (18) |

여기서 Δϕ는 DEM LUT의 방위각 해상도이며, ρ* = ρ(s*)는 최적 정합에 해당하는 상관계수이다. 결과적으로 는 입력 이미지의 관측 스카이라인과 DEM 기반 360° 산 능선 사이의 정합에 의해 보정된 카메라 방위각을 의미하며, 초기 스마트폰 센서로 취득한 방위각을 정밀하게 보정할 수 있다. 또한 상관계수 기반 정합은 급격한 장면 변화에서도 스카이라인 형상 패턴에 주로 의존하므로 안정적인 추정이 가능하며, 산악 지형과 같이 GNSS가 불안정한 환경에서도 카메라 방향 추정의 신뢰도와 정밀도를 높여 위치 추정 및 MGIS 3D 오버레이의 기준 좌표를 안정적으로 제공한다.

Ⅳ. 실험 및 결과

본 연구에서 제안한 알고리즘은 크게 두 가지 측면에서 실험을 통해 평가하였다.

(1) Skyline의 정확도, (2) 추출된 Skyline과 DEM 기반 Mesh를 이용한 방위각 보정 정확도이다.

즉, 먼저 입력 영상에서 Skyline이 얼마나 정확하게 추출되는지를 평가하고, 이후 이렇게 얻은 Skyline과 DEM Mesh 간의 일치도를 기반으로 추정한 방위각이 실제 방위각과 얼마나 잘 일치하는지를 정량적으로 측정하였다.

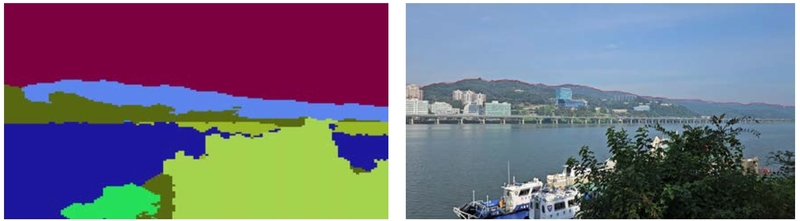

우선 Skyline Segmentation 정확도 평가는, 실제 산 능선을 기준으로 픽셀 단위로 수작업 어노테이션을 수행하여 Ground Truth Skyline 마스크를 생성한 뒤, 제안한 알고리즘이 적용된 Segmentation 결과와 비교하는 방식으로 진행하였다.

본 연구의 실험에는 두 종류의 실제 야외 촬영 데이터셋을 사용하였다. 첫 번째는 서울 천호 한강공원에서 강 건너편 아차산 능선을 촬영한 사진들이며, 두 번째는 남산공원에서 남산 일대를 촬영한 사진들이다. 모든 데이터는 동일한 기기 환경을 유지하기 위해 갤럭시 S23 일반 모델의 기본 카메라를 사용하여 1배(1x) 줌 상태에서 촬영하였으며, 별도의 디지털 줌이나 후처리 보정을 적용하지 않은 원본 영상을 기반으로 Skyline Segmentation 및 방위각 보정 실험을 수행하였다.

총 50장의 테스트 이미지를 대상으로, Pixel Accuracy와 IoU 지표를 계산하여 성능을 비교하였다. 여기서 제안하는 방법은 SEgmentation 모델의 출력 뒤에 하늘 영역 잡음을 제거하는 후처리 알고리즘을 결합한 형태이며, 후처리 유무에 따른 성능 차이도 함께 분석하였다.

표 1은 SegFormer[20], SAM[21], OneFormer[22]에 제안하는 하늘 잡음 제거 알고리즘을 결합한 모델(SegFormer + Our, SAM + Our, OneFormer + Our)에 대해 Pixel Accuracy와 IoU를 비교한 결과를 보여준다. 해당 결과로부터, 같은 후처리 알고리즘을 적용하더라도 SegFormer 기반 모델(SegFormer + Our)이 SAM + Our, OneFormer + Our 보다 더 우수한 성능을 보임을 확인할 수 있다.

또한, 표 1에는 후처리를 적용하지 않은 단일 Segmentation 모델들(SegFormer, SAM, OneFormer)의 Skyline 추출 결과도 함께 기재하였다. 이 경우, 모든 모델에서 후처리를 적용한 경우보다 Pixel Accuracy와 IoU가 전반적으로 감소하는 경향을 보였으며, 이를 통해 제안하는 하늘 잡음 제거 알고리즘이 실제로 Skyline Segmentation 성능 향상에 기여하고 있음을 확인하였다. 다음으로, Mesh와 추출한 Skyline을 일치시켜 계산한 방위각과, IMU 센서로부터 얻은 보정되지 않은 방위각을, 실제 촬영 당시 기록한 실제 방위각과 비교하여 보정 정확도를 평가하였다.

표 2는 각 방법에 대해 50장의 이미지에서 얻은 방위각 정확도의 평균값을 정리한 것이다. 여기서 정확도는 각도 오차를 기반으로 다음과 같이 정의하였다.

(1) 예측 방위각이 참값과 정확히 일치할 때: 정확도 100%

(2) 예측 방위각이 참값과 90° 차이가 날 때: 정확도 50%

(3) 예측 방위각이 참값과 180°(정반대 방향) 차이가 날 때: 정확도 0%

즉, 0° 오차에서 100%, 180° 오차에서 0%가 되도록 각도 오차를 0~180° 범위에서 선형적으로 정규화하여 정확도를 산출한 뒤, 50개의 측정 결과를 평균한 값이 표 2의 수치이다.

표 2의 결과를 통해, 본 연구에서 제안한 Skyline 기반 방위각 보정 알고리즘이 IMU 단독 사용에 비해 일관되게 더 높은 정확도를 제공함을 확인할 수 있다. 보정을 수행하지 않은 경우에도 IMU 센서만으로 대체로 올바른 방위각을 추정하지만, 주변 자성 물체나 스마트폰 자체의 센서 오류로 인해 간헐적으로 큰 오차가 발생하는 사례가 나타났다. 반면, 제안한 방법은 이러한 경우에도 Skyline matching을 통해 DEM Mesh와 실제 Skyline을 정합함으로써 방위각을 보다 정확한 값으로 근사하여, 전체적으로 더 높은 정확도와 신뢰성 있는 결과를 제공하였다.

제안하는 전체 파이프라인(세그멘테이션, Skyline 추출, DEM 기반 Mesh 정합 및 방위각 보정까지 포함)이 단일 이미지를 처리하는데 소요되는 평균 시간은 약 53초 수준이다. 이는 일반적인 야외 측량·탐사 시나이로에서 사용자가 촬영 후 수십 초 이내에 보정된 방위각 정보를 확인할 수 있는 정도의 성능을 보여주어, 실제 현장 활용에서 큰 문제가 없는 수준임을 보여준다. 한편, 제안하는 방법은 극단적인 기상 및 조명 환경에서는 성능 저하를 보이는 한계가 있다. 특히, 짙은 안개나 미세먼지로 인해 산 능선의 윤곽이 거의 보이지 않는 경우, 또는 강한 역광으로 인해 하늘과 산 능선의 명암 대비가 매우 낮아지는 경우에는 SEgmentation 단계에서 Skyline 자체를 안정적으로 추출하기 어렵다. 이와 같은 상황에서는 DEM Mesh와의 정합 과정에서도 신뢰할 수 있는 대응점을 확보하지 못하므로, 결과적으로 방위각 추정 오차가 크게 증가하는 경향을 보인다. 이러한 극단적 환경에 대한 강인성을 향상시키는 것은 향후 연구 과제로 남는다.

Ⅴ. 결 론

본 연구에서는 모바일 증강현실 환경에서 MGIS 공간 정보를 현장에서 직관적으로 활용하기 위한 통합형 3차원 가시화 시스템을 제안하였다. 이를 위해 MGIS의 다양한 공간 및 속성 정보를 정제하고, 갱도 중심선과 실태조사 기록을 기반으로 AR에 적합한 경량 데이터 구조를 설계했으며, 클라우드 서버 기반 관리 체계를 통해 AR 글래스 및 모바일 디바이스와의 실시간 동기화를 구현하여 데이터의 최신성과 접근성을 확보하였다.

시스템의 핵심 요소로는 GPS 및 IMU 센서를 통한 초기 위치 산출, 의미론적 분할을 활용한 산 능선(Skyline) 추출, 디지털 표고 모델(DEM)의 Mesh화로 생성한 360° 지형 윤곽과의 정합을 통한 정밀 방위각 보정이 포함된다. 이는 기존 2차원 지도 기반 해석의 한계를 보완하고, SLAM과의 결합을 통해 이동 시에도 안정적인 자세 추정을 가능하게 하며, 능선 형상 패턴 기반 정합은 광량 변화 및 비지형 객체와 영상 노이즈에 강건하여 GPS 신호가 불안정한 산악 지형에서도 높은 공간 정합 정확도를 제공한다.

제안된 시스템은 현장 실무자가 AR 글래스를 통해 갱도 구조, 갱구 위치, 실태조사 포인트 등의 정보를 입체적으로 시각화함으로써, 지형 이해도 향상, 점검 효율 증대, 대응 의사결정 가속화에 기여할 수 있다. 특히 광해방지사업에서 요구되는 신속형, 추적성, 비교 가능성을 현장에서 즉시 확보할 수 있다는 점에서 높은 실무적 가치를 지닌다.

Acknowledgments

이 논문은 2025년 한국광해광업공단으로부터 연구비를 지원받아 수행된 사업임

References

-

J. Suh, “Utilization of Augmented and Virtual Reality Technologies in Geoscience and Mining,” Journal of the Korean Society of Mineral and Energy Resources Engineers, Vol.56, No.5, pp.468–479, 2019.

[https://doi.org/10.32390/ksmer.2019.56.5.468]

-

J. Tang, C. Gong, F. Guo, Z. Yang, and Z. Wu, “Automatic geo-localization framework without GNSS data,” IET Image Processing, Vol.16, No.8, pp.2180–2195, 2022.

[https://doi.org/10.1049/ipr2.12482]

-

P.-J. Duh, Y.-C. Sung, L.-Y. F. Chiang, Y.-J. Chang, and K.-W. Chen, “V-Eye: A vision-based navigation system for the visually impaired,” IEEE Transactions on Multimedia, Vol.23, pp.1567–1580, 2021.

[https://doi.org/10.1109/TMM.2020.3001500]

-

S. Ramalingam, S. Bouaziz, P. F. Sturm, and M. Brand, “SKYLINE2GPS: Localization in urban canyons using omni-skylines,” Proceedings of the IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS 2010), pp.3816–3823, 2010.

[https://doi.org/10.1109/IROS.2010.5649105]

-

R. Fedorov, P. Fraternali, and M. Tagliasacchi, “Mountain peak identification in visual content based on coarse digital elevation models,” Proceedings of the 3rd ACM International Workshop on Multimedia Analysis for Ecological Data (MAED 2014), pp.7–11, 2014.

[https://doi.org/10.1145/2661821.2661825]

-

B. Nagy, “A new method of improving the azimuth in mountainous terrain by skyline matching,” PFG – Journal of Photogrammetry, Remote Sensing and Geoinformation Science, Vol.88, pp.121–131, 2020.

[https://doi.org/10.1007/s41064-020-00093-1]

-

Z. Pan, J. Tang, T. Tjahjadi, and F. Guo, “Fast geo-location method based on panoramic skyline in hilly area,” ISPRS International Journal of Geo-Information, Vol.10, No.8, Article 537, 2021.

[https://doi.org/10.3390/ijgi10080537]

- National Geographic Information Institute (NGII), Digital Elevation Model of Korea, NGII Open Data, Korea, 2024. Available: https://map.ngii.go.kr/ms/map/NlipMap.do?tabGb=total

-

J. S. Bazargani, M. Zafari, A. Sadeghi-Niaraki, and S.-M. Choi, “A survey of GIS and AR integration: Applications,” Sustainability, Vol.14, No.16, Article 10134, 2022.

[https://doi.org/10.3390/su141610134]

-

W. Ma, S. Zhang, and J. Huang, “Mobile augmented reality based indoor map for improving geo-visualization,” PeerJ Computer Science, Vol.7, Article e704, 2021.

[https://doi.org/10.7717/peerj-cs.704]

-

F. G. Cozman and E. P. Krotkov, “Position estimation from outdoor visual landmarks for teleoperation of lunar rovers,” Proceedings of the 3rd IEEE Workshop on Applications of Computer Vision (WACV ’96), Sarasota, FL, USA, pp.156-161, 1996.

[https://doi.org/10.1109/ACV.1996.572046]

-

S. Zhu, M. Pressigout, M. Servières, L. Morin, and G. Moreau, “Skyline matching: A robust registration method between video and GIS,” Usage, Usability, and Utility of 3D City Models – European COST Action TU0801, EDP Sciences, Article 03007, 2012.

[https://doi.org/10.1051/3u3d/201203007]

-

P. J. F. Carle, P. T. Furgale, and T. D. Barfoot, “Long-range rover localization by matching LiDAR scans to orbital elevation maps,” Journal of Field Robotics, Vol.27, No.3, pp.344-370, 2010.

[https://doi.org/10.1002/rob.20336]

-

P. T. Furgale, P. J. F. Carle, and T. D. Barfoot, “A comparison of global localization algorithms for planetary exploration,” Proceedings of the 2010 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS 2010), pp.4964-4969, 2010.

[https://doi.org/10.1109/IROS.2010.5649051]

-

X. Bouyssounouse, A. V. Nefian, A. Thomas, L. J. Edwards, M. C. Deans, and T. Fong, “Horizon based orientation estimation for planetary surface navigation,” Proceedings of the 2016 IEEE International Conference on Image Processing (ICIP), pp.4368-4372, 2016.

[https://doi.org/10.1109/ICIP.2016.7533185]

-

M. J. L. Lee, L.-T. Hsu, and H.-F. Ng, “Semantic VPS for smartphone localization in challenging urban environments,” Sensors, Vol.21, No.18, Article 6137, 2021.

[https://doi.org/10.3390/s21186137]

-

G. Baatz, O. Saurer, K. Köser, and M. Pollefeys, “Large scale visual geo-localization of images in mountainous terrain,” Proceedings of the 12th European Conference on Computer Vision (ECCV 2012), LNCS 7573, pp.517-530, 2012.

[https://doi.org/10.1007/978-3-642-33709-3_37]

- J. Kook, “OpenVSLAM-based cooperative mobile AR system architecture,” Journal of the Semiconductor & Display Technology, Vol.21, No.1, pp.136-141, 2022. Available: https://koreascience.kr/article/JAKO202211935362493.page

-

E. Xie, W. Wang, Z. Yu, A. Anandkumar, J. M. Alvarez, and P. Luo, “SegFormer: Simple and efficient design for semantic segmentation with transformers,” Advances in Neural Information Processing Systems (NeurIPS 2021), 2021.

[https://doi.org/10.48550/arXiv.2105.15203]

-

A. Mertan, D. J. Duff, and G. Unal, “Single image depth estimation: An overview,” Digital Signal Processing: A Review Journal, Vol.123, Article 103441, 2022.

[https://doi.org/10.1016/j.dsp.2022.103441]

-

N. Ravi, V. Gabeur, Y.-T. Hu, R. Hu, C. Ryali, T. Ma, H. Khedr, R. Rädle, C. Rolland, L. Gustafson, E. Mintun, J. Pan, K. V. Alwala, N. Carion, C.-Y. Wu, R. Girshick, P. Dollár, and C. Feichtenhofer, “SAM 2: Segment anything in images and videos,” arXiv preprint arXiv:2408.00714, , 2024.

[https://doi.org/10.48550/arXiv.2408.00714]

-

J. Jain, J. Li, M. T. Chiu, A. Hassani, N. Orlov, and H. Shi, “OneFormer: One transformer to rule universal image segmentation,” Proceedings of the 2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR 2023), pp.2989-2998, 2023.

[https://doi.org/10.1109/CVPR52729.2023.00292]

- 2024년 : 가천대학교 물리학과 졸업 (이학사)

- 2024년 : 가천대학교 소프트웨어학과 졸업 (복수전공)

- 2024년 ~ 현재 : 한양대학교 컴퓨터소프트웨어학과 석사과정 재학

- ORCID : https://orcid.org/0009-0009-5053-0230

- 주관심분야 : 컴퓨터 비전/그래픽스, VPS(Visual Positioning System), 센서 퓨전, 씬그래프, VLM(비전언어모델)

- 2025년 : 한림대학교 소프트웨어학부 콘텐츠IT학과 졸업 (공학사)

- 2025년 : 한림대학교 소프트웨어학부 빅데이터학과 졸업 (복수전공)

- 2025년 ~ 현재 : 한양대학교 컴퓨터소프트웨어학과 석사과정 재학

- ORCID : https://orcid.org/0009-0009-5508-3863

- 주관심분야 : 컴퓨터 비전/그래픽스, 게임공학, 3D모델링, 3D재구성, IT/미디어 콘텐츠, 가상현실

- 2017년 : 한양대학교 컴퓨터소프트웨어학과 석사과정 졸업 (공학 석사)

- 2017년 ~ 현재 : 한양대학교 컴퓨터소프트웨어학과 박사과정 재학

- 현재 : ㈜시어스랩

- ORCID : https://orcid.org/0009-0001-9988-7363

- 주관심분야 : 컴퓨터 비전/그래픽스, 증강현실, 가상현실

- 2003년 : 조선대학교 일반대학원 졸업 (공학 석사)

- 2007년 : 기술사(지질 및 지반)

- 2008년 ~ 현재 : 한국광해광업공단 기술연구원 차장

- ORCID : https://orcid.org/0000-0002-8691-8298

- 주관심분야 : 광해방지기술개발, IT&ASI 융합연구

- 1987년 : 서울대학교 전자공학과 졸업(학사)

- 1989년 : 서울대학교 전자공학과 졸업(석사)

- 1995년 : 서울대학교 전자공학과 졸업(공학 박사)

- 1992년 ~ 1994년 : 일본 BHK 방송기술연구소 객원 연구원

- 1995년 ~ 1996년 : 한국방송개발원(현 한국콘텐츠진흥원) 선임연구원

- 1996년 ~ 1999년 : 일본 ATR지능영상통신연구소 연구원

- 1999년 ~ 현재 : 한양대학교 공과대학 교수

- ORCID : https://orcid.org/0000-0003-1000-4067

- 주관심분야 : 컴퓨터 비전/그래픽스, 증강현실, 가상현실, HCI