실시간 다중 채널 영상 분석 시스템을 위한 VLM 기반 자연어 질의응답 시스템 연구

Copyright © 2026 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

디지털 감시 및 모니터링 시스템의 급속한 발전과 함께 실시간 다중 채널 영상 분석에 대한 수요가 급증하고 있다. 본 연구에서는 Vision Language Model(VLM)과 Large Language Model(LLM)을 활용하여 실시간 다중 채널 영상 분석 시스템에 자연어 질의응답 기능을 통합한 시스템을 제안하고, 다양한 방법을 비교 실험하였다. 제안된 시스템은 레거시 영상 분석 시스템과 연동하여 메타데이터와 다중 이미지를 VLM을 통해 텍스트로 변환한 후, 이를 벡터 데이터베이스에 저장한다. 자연어 질의응답 모듈은 질의 분류, Text-to-SQL 변환, Retrieval Augmented Generation(RAG) 기반 응답 생성의 다층 구조로 설계되었다. 10개의 최신 VLM 모델에 대한 성능 비교 실험을 vLLM 환경에서 수행하였으며, 정성적 및 정량적 방법을 사용하여 평가하였다. RAG 최적화 기법으로는 리랭커, 하이브리드 검색, 질의 재구성 방법 등 다양한 조합에 대한 검색 정확도를 RAGAS를 통해 평가하였다. 본 연구는 실시간 영상 분석 분야에서 VLM 기반 자연어 인터페이스의 실용적 구현 방안을 제시하여, 향후 지능형 감시 시스템 발전에 기여할 것으로 기대한다.

Abstract

The rapid advancement of digital surveillance and monitoring systems has led to a surge in demand for real-time multi-channel video analysis. This study proposes a system that integrates natural language query-response capabilities into a real-time multi-channel video analysis system by utilizing Vision Language Models (VLMs) and Large Language Models (LLMs), and conducts comparative experiments using various methods. The proposed system interfaces with legacy video analysis systems to convert metadata and multiple images into text via the VLM, storing this in a vector database. The natural language query-response module is designed with a multi-layered structure comprising query classification, Text-to-SQL conversion, and Retrieval Augmented Generation (RAG)-based response generation. Performance comparisons of 10 state-of-the-art VLM models were conducted in the vLLM environment and evaluated using both qualitative and quantitative methods. For RAG optimization techniques, search accuracy was evaluated using RAGAS for various combinations of re-ranking, hybrid retrieval, and query reformulation methods. This study presents a practical implementation approach for VLM-based natural language interfaces in real-time video analysis, expected to contribute to the future development of intelligent surveillance systems.

Keywords:

VLM, LLM, RAG, Multi-Channel Video Analysis SystemⅠ. 서 론

현대 사회에서는 영상 감시 및 모니터링 시스템의 중요성이 날로 커지고 있다. 특히 스마트 시티, 산업 안전 관리, 교통 모니터링 등 다양한 분야에서 실시간 다중 채널 영상 분석에 대한 수요가 증가하고 있다. 트랜스패런시 마켓 리서치에 따르면 영상 감시 시장은 2023년 82조 원에서 2027년 146조 원으로, 국내 시장도 4조 4,156억 원에서 5조 4,672억 원으로 성장할 것으로 예상된다. 기존의 레거시 영상 분석 시스템들은 주로 객체 탐지, 행동 인식, 이상 탐지 등의 특정 작업에 특화되어 있다. 대표적인 기능으로는 객체 검출(Object Detection), 객체 추적(Object Tracking), 행동 인식(Action Recognition) 등이 있으며, 이러한 시스템들은 구조화된 알람 및 로그 데이터를 생성하는 데 중점을 두고 있다. 객체 검출은 컴퓨터 비전 분야의 핵심 기술 중 하나로, 영상 내에서 객체의 위치와 범주를 동시에 식별하는 기술이다. 특히, YOLO(You Only Look Once)[1]는 실시간 객체 검출 분야에서 혁신적인 발전을 이끌어 왔다. 이후 YOLOv2[2], YOLOv3[3]를 거쳐 최신 YOLOv8[4]에 이르기까지 지속적으로 발전하고 있다. 객체 추적은 시간적으로 연속된 프레임에서 동일한 객체를 식별하고 그 이동 궤적을 추적하는 기술이다. 단순히 매 프레임마다 객체를 검출하는 것을 넘어, 프레임 간 객체의 동일성을 유지하며 고유 ID를 부여한다. 대표적인 추적 알고리즘으로는 SORT (Simple Online and Realtime Tracking)[5]과 Deep-SORT[6]가 있다. SORT는 칼만 필터(Kalman Filter)를 사용하여 객체의 다음 위치를 예측하고, 헝가리안 알고리즘(Hungarian Algorithm)을 통해 검출된 객체와 기존 추적 객체를 최적으로 매칭한다. 이후 딥러닝 기법이 적용된 DeepSORT는 SORT의 기본 구조에 외관 특징을 추가하여 가림 현상이나 일시적 검출 실패 상황에서도 안정적인 추적을 가능하게 한다. 딥러닝을 이용한 다중 객체 추적 방법으로 ByteTrak[7], BoT-SORT[8], StrongSORT[9] 등 다양한 방법이 존재한다. 영상 행동 인식은 동영상으로부터 인간의 행동을 자동으로 식별하고 분류하는 컴퓨터 비전 기술로, 최근 Vision Transformer(ViT) 기반 접근법이 기존의 CNN 기반 방법론을 빠르게 대체하고 있다. 전통적인 CNN 구조는 합성곱 연산을 통해 지역적 시공간 특징을 추출하는 반면, 트랜스포머는 self-attention 메커니즘을 활용하여 전역적 시공간 의존성을 효과적으로 모델링할 수 있다. Shaikh et al.[10]은 행동 인식 분야에서 CNN에서 Transformer로의 패러다임 전환을 포괄적으로 분석하며, 멀티모달 데이터 통합과 시공간 표현 학습에서 Transformer의 우수성을 입증했다. 한편, Xiao et al.[11]은 자기지도 학습(self-supervised learning)을 Vision Transformer에 접목한 Enhanced Visual Industrial Sequence Transformer를 제안하여, 레이블이 제한된 산업 환경에서도 높은 행동 인식 정확도를 달성했다. 이러한 레거시 이벤트 감지 기능은 실시간 처리가 최적화되어 있으며, 각 이벤트에 대해 미리 정의된 규칙과 임계값을 가지고 있다. 예를 들어, 침입이나 쓰러짐과 같은 사건은 일정한 패턴으로 정의되어 있어 빠른 트리거 동작이 가능하다. 또한 기존 시스템은 실제 운영 환경에서 오랜 검증을 거쳤기 때문에 보안 등 민감한 분야에서 신뢰할 수 있다. 그러나 이러한 레거시 영상 분석 시스템들은 사용자가 자연어로 표현하는 복잡하고 맥락적인 질의에 대해 직관적인 응답을 제공하는 데 한계를 보인다. 현재 영상 분석 시스템이 직면한 주요 문제점은 다음과 같다. 첫째, 접근성의 문제로 전문 지식을 가진 운영자만이 효과적으로 시스템을 활용할 수 있다. 둘째, 질의의 복잡성으로 인해 SQL(Structured Query Language)과 같은 구조화된 질의 언어를 사용해야 하므로 복잡한 조건을 포함한 검색이 어렵다. 셋째, 맥락 이해의 부족으로 단순한 키워드 매칭 방식만으로는 사용자의 의도를 정확히 파악하기 어렵다. 마지막으로, 대용량 다중 채널 영상 데이터를 실시간으로 처리하면서 자연어 질의에 즉각적으로 응답하는 데 한계가 있다. 자연어 질의응답은 LLM과 VLM의 발전을 통해 기존 한계를 극복할 수 있는 새로운 가능성을 제시한다. 특히 VLM은 이미지 및 영상 데이터를 텍스트로 변환하는 능력이 크게 향상되었으며, LLM은 자연어 질의에 대한 이해와 응답, 보고서 자동화 등에서 뛰어난 성능을 보이고 있다. RAG와 벡터 데이터베이스의 결합은 대규모 멀티모달 데이터에서 효율적이고 정확한 정보 검색 및 응답 생성을 가능하게 한다. 하지만 VLM/LLM 방식은 높은 컴퓨팅 리소스를 요구하고, 초기 구축 비용과 아직 검증되지 않은 신뢰성 확보의 문제가 존재한다. 본 연구에서는 레거시 영상 분석 시스템의 장점과 VLM/LLM 기술의 장점을 효과적으로 통합하는 하이브리드 아키텍처를 설계하여, 기존 실시간 영상 분석의 결과 정보인 메타데이터와 영상 정보를 동시에 VLM에 적용한다. 본 연구에서는 실시간 다중 채널 영상 데이터를 자연어로 질의할 수 있는 인터페이스를 구축하고, 다양한 VLM 모델의 성능을 종합적으로 비교하여 최적의 모델 선택 기준을 제시한다. 또한 다양한 RAG 기반 검색 시스템을 비교하여 응답 정확도를 평가함으로써, 핵심 구성 요소인 VLM과 RAG 기법의 시스템 효율성과 성능을 검증하고자 한다. 본 논문의 구성은 본론에서 시스템 아키텍처, 최신 동향 및 관련 연구, 실험 및 고찰을 거쳐 결론 및 향후 연구로 기술한다.

Ⅱ. 본 론

1. 시스템 아키텍처

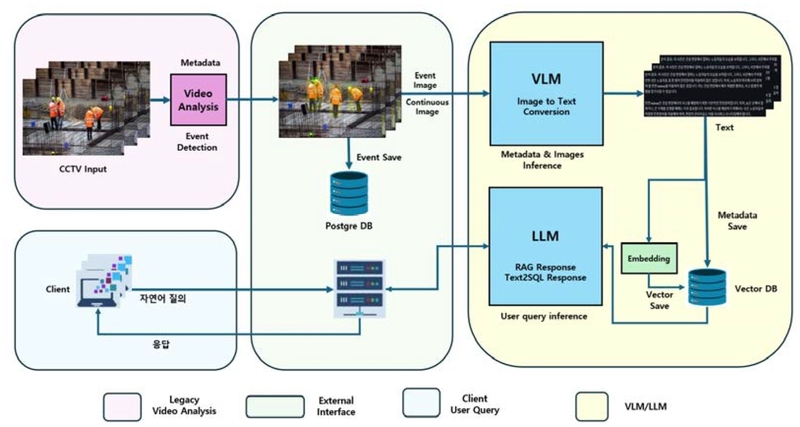

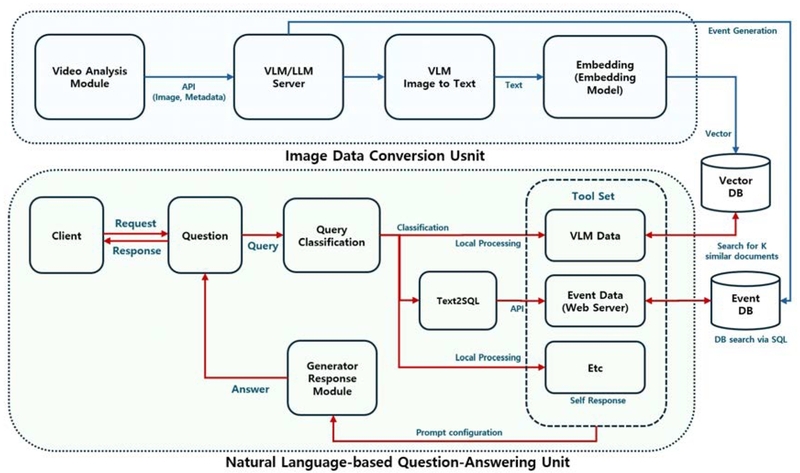

제안하는 시스템은 크게 영상 분석 모듈, VLM 변환 모듈, 벡터 데이터베이스, 자연어 질의응답 모듈로 구성된다. 각 모듈은 마이크로서비스 아키텍처로 설계되어 독립적인 확장과 유지보수가 가능하도록 구성되었다. 시스템의 데이터 흐름은 다음과 같다. 먼저, 다중 채널에서 수집된 영상 데이터는 레거시 영상 분석 시스템을 통해 기본적인 메타데이터(객체 탐지 결과, 이벤트 정보, 시간 정보 등)를 생성한다. 메타데이터와 프레임들은 VLM을 통해 자연어 설명으로 변환되며, 이는 임베딩 과정을 거쳐 벡터 데이터베이스에 저장된다. 사용자의 자연어 질의가 입력되면, 질의 분류 모듈(Query Classification Module)이 이를 분석하여 적절한 처리 경로로 라우팅한다. 사용자 질의가 데이터베이스 정보 질의일 경우 Text2SQL 모듈을 활용해 SQL 쿼리를 생성하고, 데이터베이스에서 정보를 추출하여 답변한다. Text2SQL 모듈은 사용자의 자연어 질의를 구조화된 SQL 쿼리로 자동 변환하는 작업으로, 데이터베이스 접근성을 향상시키는 기술이다. 본 논문에서는 PostgreSQL 데이터베이스에 SQL 쿼리를 이용하여 데이터 정보를 확인할 수 있다. 화면 정보 질의일 경우 RAG 기법 사용하여 답변을 한다. RAG는 대규모 언어모델의 생성 능력과 외부 지식 베이스의 검색 기능을 결합한 하이브리드 AI 아키텍처이다. 지능형 영상 분석 시스템에서 RAG는 VLM을 통해 추출된 텍스트가 벡터 정보로 변환되고, 변환된 벡터 정보는 벡터 데이터베이스에 저장된 정보는 시맨틱 검색을 통해 관련 영상 메타데이터를 찾아내고, 이를 바탕으로 정확하고 맥락에 부합하는 답변을 생성할 수 있다. 본 논문에서는 사용자의 질문을 벡터화하고 벡터 데이터베이스에서 가장 유사한 벡터를 검색하고, 이를 기반으로 LLM이 답변을 생성한다. 그 외 질문은 자체 응답하거나 답변 불가로 처리하며, 일반적인 대화, 시스템 정보, 답변 불가 질의에 대해 LLM이 응답한다. 전체 시스템 구조를 이해하기 쉽게 그림 1은 단순화된 시스템 구조를 보여준다.

기존 레거시 시스템과의 호환성을 보장하기 위해 표준화된 API 인터페이스를 설계하였다. 레거시 시스템에서 생성되는 데이터는 JSON 형식으로 표준화하여 처리하며, 실시간 스트리밍을 위해 REST API를 사용하여 구현하였다. 메타데이터 스키마는 시간 정보(타임스탬프, 시간대), 공간 정보(채널 ID, 위치 좌표, 영역 정보), 객체 정보(탐지된 객체 유형, 바운딩 박스, 신뢰도), 이벤트 정보(이벤트 유형, 심각도)로 구성된다. 구조화된 메타데이터는 벡터 데이터베이스의 메타데이터 필드에 저장되며, 자연어 질의 시 필터 정보로 활용된다.

그림 2는 전체 시스템의 상세한 시스템 구조를 보여준다.

2. 최신 동향 및 관련 연구

VLM은 시각 정보와 언어를 결합한 멀티모달 모델로, 다량의 이미지와 텍스트 데이터를 학습하여 시각과 언어 정보를 동시에 처리할 수 있다. 이미지와 텍스트를 함께 입력받아 두 요소 간의 관계를 학습함으로써, 이미지를 보고 설명하거나 질문에 답변할 수 있다. 최근 VLM은 단순한 이미지 캡셔닝을 넘어 추론 능력(Reasoning), 다중 이미지 처리(Multi-Image Processing), 동영상 이해(Video Understanding) 등 다양한 기능으로 발전하고 있다. 특히 경량화된 모델들이 발전하면서 에지 디바이스에서의 활용 가능성도 높아지고 있다. 본 연구에서 사용된 모델들은 이러한 추세를 반영하여 다양한 크기와 구조를 가진 모델들로 선정하였다. 실시간 처리를 고려해 파라미터 수가 적은 소형 모델과 온프레미스 환경에서 동작 가능한 오픈 소스 모델을 채택하였다. 선정된 모델은 Gemma3[12], InternVL3[13], Qwen2.5[14], Hyper CLOVAX[15], Deepseek-vl2[16], SmolVLM2[17], Phi-3.5 vision[18]이다.

LLM은 자연어 처리 분야에서 혁명을 일으키며 다양한 분야에 활용되고 있다. 하지만 LLM은 정보의 최신성 부족, 잘못된 정보 제공, 편향된 응답 생성 등의 한계점을 가지고 있다. 이러한 한계를 극복하기 위해 RAG[19] 기술이 등장하였다. RAG는 LLM의 강력한 텍스트 생성 능력과 외부 지식 베이스를 결합한 혁신적인 접근 방식이다. 이 기술은 인덱싱, 검색, 생성이라는 세 가지 주요 요소를 결합하여 사용자가 원하는 답변을 생성할 때 학습된 데이터에만 의존하지 않고 외부 데이터셋을 활용할 수 있도록 한다. RAG는 언어 모델의 생성 능력과 외부 지식 검색의 장점을 결합하여 더 정확하고 상황에 맞는 응답을 제공할 수 있다.

2.2.1 임베딩 및 벡터화

임베딩은 텍스트를 고차원 벡터로 변환하여 시스템이 의미론적으로 유사한 데이터를 검색하고 관리할 수 있도록 하는 과정이다. 고차원 벡터 간의 유사도는 코사인 거리(Cosine Distance) 또는 유클리디안 거리(Euclidean Distance)를 통해 계산한다. 본 연구에서는 MTEB(Multi-lingual, v2)[20]에서 다국어에 우수한 성능을 보이고, 적은 수의 파라미터를 가진 Qwen/Qwen-Embedding-0.6B, intfloat/multilingual-e5-large-instruct, google/embeddinggemma-300m, BAAI/bge-m3 등을 선정하여 비교 평가한다.

2.2.2 데이터 인덱싱

인덱싱은 임베딩된 벡터를 빠르게 검색할 수 있도록 데이터베이스에 저장하는 과정이다. 벡터 데이터베이스에는 여러 종류(Qdrant[21], Pinecone[22], Chroma[23], Weaviate[24])등이 있다. 본 연구에서는 Qdrant를 활용한다. Qdrant는 고성능 설계, 고급 필터링, 유연한 배포, 하이브리드 검색, 양자화 기능, 보안 기능 등의 특징을 갖추고 있다.

2.2.3 RAG 최적화

RAG는 검색 단계의 정확성이 답변 품질을 좌우한다. 단순히 가장 유사한 벡터를 찾는 것을 넘어, 검색된 결과를 정제하고 재조합하는 다양한 기법들이 최근 연구되고 있다. 리랭커(Reranker)는 임베딩 유사도를 구하는 일반 벡터 검색과 달리, 크로스 엔코더(Cross-Encoder) 기반으로 질의-문서 간 유사도를 직접 계산하여 검색된 상위 n개의 문서들의 순위를 다시 조정하는 방법이다. 본 연구에서는 적은 수의 파라미터를 갖는 Qwen/Qwen3-Reranker-0.6B, BAAI/bge-reranker-v2-m3, jina-reranker-v2-base-multilingual 등의 모델을 선정하여 비교 평가하였다. HyDE[25](Hypothetical Document Embeddings)은 사용자의 질의를 기반으로 LLM이 가상의 문서를 생성하고, 이 가상 문서의 임베딩을 이용해 검색을 수행하는 방법이다. Multi-hop Reasoning[26]은 여러 개의 문서를 결합하여 복잡한 질의에 대한 답변을 도출하는 방법이다. Contextual Compression[27]은 검색된 문서에서 불필요한 정보를 제거하고 핵심 내용만 압축하여 LLM에 전달하는 방법이다. Self Query Retriever[28]는 주어진 사용자의 질문을 벡터 데이터베이스를 조회할 필터링 질의로 변환하여 검색하는 방식이다. 본 연구에서는 질의 분류 모듈에서 사용자 질문을 JSON 구조로 출력하여 벡터 데이터베이스에서 필터링에 활용할 수 있는 가능한 구조를 구축하였다. 질문 확장(Query Expansion) 기법 중 질문 재구성(Query Reformulation) 방법[29]은 LLM을 활용하여 원래 질문을 다양한 형태로 재작성하는 방식으로, 동의어 확장, 질문 명확화, 관련 키워드 추가 등 여러 방법을 통해 쿼리를 변형하여 검색의 다양성과 정확도를 향상시킨다. 하이브리드 검색은 밀집 검색과 희소 검색 두 가지 방식을 융합하여 검색 정확도를 높이는 방법으로, 밀집 벡터 기반 검색은 의미적 유사성에 강점이 있고, 희소 기반 검색은 벡터는 정확한 키워드 매칭에 강점을 가진다. 이처럼 서로 다른 특성을 지니고 있어 상호 보완적인 효과를 발휘한다. 본 연구에서는 질문 재구성과 하이브리드 검색 기법을 적용하여 비교 평가를 수행하였다.

2.3.1 N-gram 매칭 방식

N-gram, BLEU(Bilingual Evaluation Understudy), ROUGE(Recall-Oriented Understudy for Gisting Evaluation), METEOR(Metric for Evaluation of Translation with Explicit ORdering) 등은 문장에서 동일한 단어나 구절이 얼마나 일치하는지를 기반으로 하는 평가 방식이다. 이들은 의미적 유사성을 반영하지 못하고 문맥을 고려하지 않으며, 동의어나 문장 변형을 적절히 처리하지 못하는 한계가 존재한다. N-gram은 텍스트 내에서 연속된 N개의 단어나 문자로 구성된 시퀀스를 의미하며, 기계 번역, 텍스트 요약 등의 평가에서 참조 문장과 생성된 문장의 유사도를 측정하는 데 사용된다. BLEU는 기계 번역 결과를 평가하기 위해 사용되는 자동 평가 지표로, 정밀도(Precision)를 강조한다. ROUGE는 자동 텍스트 요약 및 문장 생성 모델 평가에 주로 사용되는 지표로, 재현율(Recall)을 중심으로 한다. 마지막으로 METEOR는 기계 번역 품질 평가를 위해 개발된 지표로, BLEU의 단점을 보완하기 위해 만들어졌다. 단순한 단어 매칭 외에도 어간 추출, 동의어 매칭, 패러프레이징 등 다양한 언어학적 요소를 고려한다.

2.3.2 BERT(Bidirectional Encoder Representations from Transformers)-Score

BERT-Score[30]는 BERT와 같은 사전 학습된 언어 모델을 활용하여 텍스트 간 의미적 유사성을 평가한다. BLEU나 ROUGE와 달리 단순한 단어 매칭이 아니라 문맥적 유사성을 고려하여 보다 인간의 평가에 가까운 결과를 제공한다.

2.3.3 LLM 기반의 평가 방식

고성능 LLM을 활용하여 사전에 정의된 평가 기준과 프롬프트에 따라 다른 LLM의 응답 품질과 프롬프트의 적합성을 평가하는 방식이다. 점수화 기준을 설정하고, 프롬프트를 통해 다양한 평가 항목(정확성, 유창성, 일관성 등)을 지정하여 정성적인 기준에 따라 LLM을 통해 평가를 진행한다. 본 연구에서는 VLM 결과에 대한 정성적 평가와 질의 분류 모델의 질문 합성 데이터 생성 검증, 그리고 RAG 성능 테스트를 위한 질문 합성 데이터 생성 검증에 활용된다.

2.3.4 LLM 기반의 RAG 평가 방식

RAGAS는 RAG 성능 평가를 위한 다양한 지표를 제공하는 오픈 소스 프레임워크이다.

표 1은 RAGAS에서 평가하는 RAG 평가 지표의 분류를 나타낸다. 표 2는 RAG 평가 요소를 보여준다. 본 연구에서는 컨텍스트의 정밀도와 신뢰성을 기반으로 평가를 수행한다.

Ⅲ. 실험 및 고찰

1. VLM 성능 평가

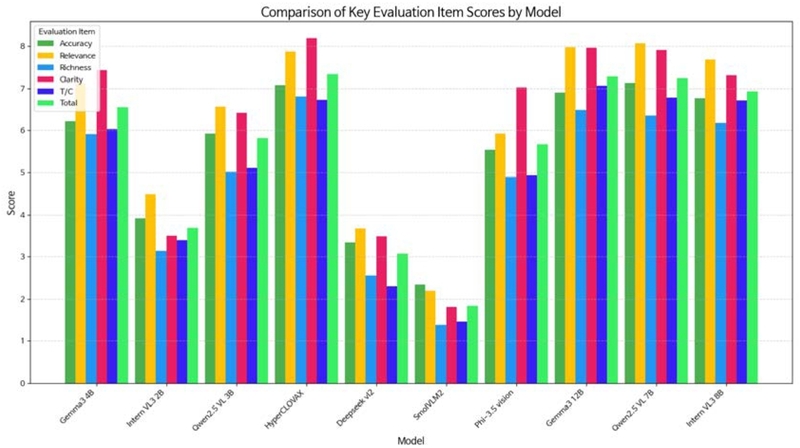

실험 환경은 OS: Ubuntu 22.04, CPU: AMD Ryzen 7 5800X, GPU: NVIDIA GeForce RTX 3090(24G)를 사용하였다. vLLM은 LLM의 추론 및 배포를 가속화하기 위한 오픈소스 라이브러리로, 모델 추론 중 반복적으로 참조되는 데이터를 캐싱하기 위해 키-값 캐시(KV Cache)를 활용한다. vLLM은 기본적으로 전체 GPU 메모리의 90%를 할당하여 모델 추론과 키-값 캐시를 처리하지만, gpu_memory_utilization을 0.6으로 설정하여 최대 GPU 메모리 사용량이 14.4G를 넘지 않도록 제한하였다. 실험에 사용된 VLM 모델은 InternVL3-2B/8B, Gemma-3-4/12B, DeepSeek-VL2, PaliGemma2-3B, HyperCLOVAX-SEED-Vision-3B, Qwen2.5-VL-3B/7B, SmolVLM2-2.2B 등이다. 비교적 모델 크기가 큰 gemma-3-12B, Qwen2.5-VL-7B, InternVL3-8B는 4비트 양자화를 적용하였으며, max_tokens는 1200으로 설정하여 테스트하였다. 본 연구의 목적은 서로 다른 경량 VLM이 동일 조건에서 실시간 반복 추론 시 나타내는 정확도-지연-안정성 간의 트레이드오프를 계량화하고, vLLM 기반 다채널 서빙에서 동시성 확장성과 출력 일관성을 체계적으로 측정하는 것이다. 이를 위해 동일 이미지를 5초 간격으로 10분 동안 반복 제시하였으며, 실시간 다중 채널 VLM 변환 성능 비교를 위해 영어 답변, 한글 답변, 단일 이미지, 다중 이미지(5초 간격) 등 다양한 실험을 수행하였다. 모든 모델 출력은 동일한 프롬프트와 이미지를 사용하여 정성적 평가와 정량적 평가를 진행하였다. 정성적 평가는 각 VLM의 생성 결과를 GPT-4o를 활용해 정확성, 관련성, 명확성, 풍부성, 그리고 다중 이미지에서의 시간적 일관성(T/C) 등을 0~10점 척도로 평가한 후, 평균 점수를 산출하였다. 추론 시간(e_time)은 16채널 동시 추론 시간을 기반으로 총 시간 ÷ 16으로 계산하였다. 정량적 평가는 동일 프롬프트로 GPT-4o가 생성한 결과를 정답으로 삼아 평가하였다. 표 3은 15초 간격으로 단일 이미지에 대해 VLM이 영어로 답변했을 때의 평가 결과를 나타낸다. 표 3에서는 InternVL3, Qwen2.5, Hyper CLOVAX, Deepseek-vl2 모델이 추론 시간이 짧으면서도 전체 성능이 우수한 것을 확인할 수 있다. 또한, 파라미터 수가 많은 모델은 추론 속도가 매우 느려 실제 실시간 적용이 어려워 보인다.

Evaluation results when VLM’s responses to single images were provided in English at 15-second intervals

표 4는 15초 간격으로 단일 이미지에 대한 VLM의 한글 답변 평가 결과를 나타낸다. 표 4에서는 영어 답변에서 우수한 성능을 보인 InternVL3, Qwen2.5, Hyper CLOVAX, Deepseek-vl2 모델들이 추론 속도에서는 좋은 결과를 나타냈으나, 정성적 평가의 종합 점수에서는 Hyper CLOVAX 모델을 제외하고는 만족스러운 성과를 거두지 못했다. 이러한 원인은 모델의 파라미터 수가 적고, 한국어에 특화되어 있지 않기 때문으로 보인다.

Evaluation results when VLM’s responses to a single image were provided in Korean at 15-second intervals

표 5는 15초 간격으로 촬영한 총 5장의 이미지를 5초 간격으로 입력하여, 다중 이미지에 대한 VLM의 영어 답변 평가 결과를 나타낸다. 또한, 다중 이미지 입력 시 시간적 일관성도 평가 항목에 포함하였다. 표 5의 결과 역시 위 실험과 마찬가지로 InternVL3, Qwen2.5, Hyper CLOVAX, Deepseek-vl2 모델들이 우수한 성능을 나타냈다. 다중 이미지에서의 시간적 일관성 평가 항목에서는 InternVL3, Qwen2.5, Hyper CLOVAX 모델이 높은 점수를 기록하였다. 추론 속도와 성능을 종합적으로 InternVL3 2B 모델이 가장 뛰어난 성능을 보임을 확인할 수 있다.

Evaluation results when VLM responses to multiple images were provided in English at 15-second intervals

표 6은 15초 간격의 이미지를 VLM이 한글로 답변했을 경우의 평가 결과를 나타낸다. 평가 결과, 다중 이미지의 추론에서의 영어 답변에서는 InternVL3-2B, Qwen2.5-VL-3B, HyperCLOVAX, Deepseek-vl2 모델이 짧은 추론 시간과 우수한 성능을 보였다. 그러나 한글 답변의 경우에는 HyperCLOVAX이 뛰어난 성능을 나타냈다. 또한 시간적 일관성 평가 항목 역시 HyperCLOVAX에서 가장 좋은 성능을 나타냈다. 이러한 원인은 HyperCLOVAX 모델이 한국어에 특화되어있지 않기 때문인 것으로 보인다. 본 연구에서는 한글 답변에서 가장 우수한 성능을 보인 HyperCLOVAX를 채택하였다. 하지만 16채널, 5개의 영상 처리 시 추론 시간이 16 × 2.08 = 33.28초로 나타나 15초 간격의 실시간 처리가 어려운 것으로 확인되었다. 이러한 문제점을 해결하고자 본 연구에서는 실시간 처리를 위해 3개의 영상과 2개의 영상에 대한 추가 실험을 진행하였다. 표 6에서 HyperCLOVAX 항목에 Images에 이미지 개수가 3개, 2개인 항목을 추가하여 실험한 결과를 포함하였다. 3개의 영상일 경우 16 × 1.29 = 20.64초, 2개의 영상일 경우 16 × 0.84 = 13.44초가 소요되었다. 16채널 실시간 다중 채널 서비스를 위해 본 연구에서는 15초 간격으로 5초 단위의 2개 영상에 대해 VLM을 통한 텍스트 변환 방식을 선택하였다.

Evaluation results when VLM responses to multiple images were provided in Korean at 15-second intervals

그림 3은 15초 간격으로 촬영한 총 5장의 이미지를 5초 간격으로 배열하여, VLM 답변이 한글일 경우 각 모델별 정성적 평가 점수를 직관적으로 이해할 수 있도록 막대 차트로 나타낸 것이다.

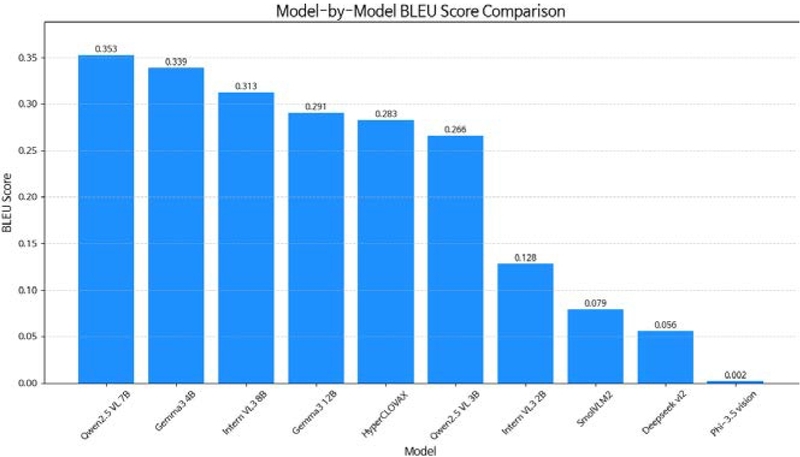

각 모델의 정량적 평가는 표만으로는 쉽게 구분하기 어려워, 막대 차트를 활용하여 직관적으로 이해할 수 있도록 하였다. 그림 4는 15초 간격으로 촬영한 총 5장의 이미지를 5초 간격으로 배열하여, 다중 이미지에 대한 VLM의 한글 답변을 기준으로 각 모델별 정량적 평가인 BLEU 점수를 성능이 높은 순서대로 나타낸 것이다.

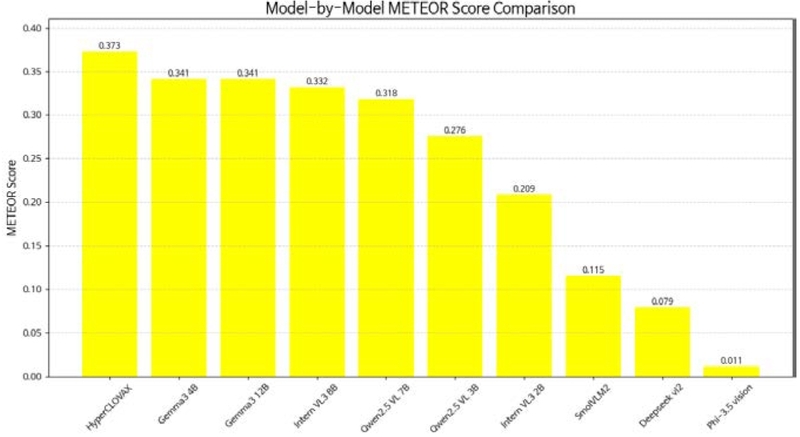

그림 5는 15초 간격으로 촬영한 총 5장의 이미지를 5초 간격으로 배열하여, 다중 이미지에 대한 VLM 답변이 한글일 경우 각 모델별 정량적 평가인 METEOR 점수를 성능이 높은 순서대로 나타낸 것이다.

본 연구에서는 추가로, 실시간 추론 시간을 단축하기 위한 방법으로 배치 크기에 따른 추론 시간을 테스트하였다.

표 7은 HyperCLOVAX를 단일 이미지 기반으로 하여 배치 크기를 다양하게 변경하며 추론 시간을 측정한 결과이다. 배치 크기가 커질수록 채널별 속도가 빨라지는 것을 확인할 수 있다. 그러나 실험 결과, 배치 크기가 16을 초과할경우 성능 향상이 크게 나타나지 않아, 배치 크기를 16으로 설정하였다.

종합적으로 정리하면, 실시간 다중 채널 영상 분석 시스템을 위한 VLM 기반 자연어 질의응답 시스템 평가에서, 레거시 영상 분석을 통해 생성된 메타데이터와 영상 데이터를 활용하여 프롬프트를 생성하고, VLM을 통해 텍스트로 변환하는 과정에서 중요한 요소로 추론 시간과 정성적·정량적 평가 결과를 도출하였다. 그중 HyperCLOVAX가 가장 우수한 성능을 보였으며, 현재 시스템에서 실시간 처리가 가능한 경우는 배치 크기 16일 때, 2장의 이미지를 동시에 입력한 경우이기 때문에 해당 방법으로 적용하여 추가 실험을 진행하였다.

2. 질의 분류 모듈 성능 평가 및 선택

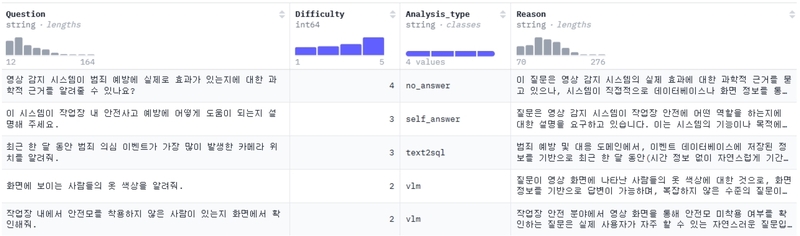

질의 분류 모듈의 성능 평가를 위해서는 다수의 질의와 질의 분류에 대한 정답 데이터셋이 필요하다. 본 연구에서는 질의 분류 데이터셋을 GPT-4.1을 활용한 합성데이터셋으로 구축하였다. 다양한 도메인과 난이도로 구분하였으며, 질문 유형을 먼저 제시한 후 질문을 생성하도록 하였다. 생성된 질문에 대한 평가를 거쳐 총 500개의 데이터셋을 확보하였고, 이를 바탕으로 소형 LLM 모델을 대상으로 테스트를 진행하였다. 출력은 JSON 포맷으로 구조화하였다. 그림 6은 질의 분류 평가를 위해 생성된 합성 데이터셋을 보여준다. 생성된 합성 데이터셋을 기반으로 다양한 LLM 모델의 정확도 및 추론 시간을 측정하였다. 질의 분류 모델은 다른 응답의 스트리밍 방식 이전에 동작하기 때문에 사용자의 대기 시간이 발생하며, 따라서 가능한 한 짧은 시간이 중요하다. 본 실험은 한국어에 강한 소형 LLM 모델을 대상으로 실험이 진행되었다.

표 8은 다양한 모델에 대한 질의 분류 평가 실험 결과를 나타낸 것이다. 본 연구에서는 실험 결과 성능이 가장 우수한 Qwen4-4B 모델을 선택하였다. 실험 결과, 소형 모델에서는 추론 결과가 JSON 포맷으로 구조화된 출력 생성 시 오류가 자주 발생하였으며, 프롬프트 항목에서 멀티턴 대화에 대한 질의 재생성과 필터링 적용을 위해 특정 채널이나 특정 기간 등에 대한 처리가 항목 생성에 어려움을 초래하는 것으로 나타났다.

3. Text2SQL 모델

Text2SQL 모델은 자연어 질의를 SQL 데이터 조회 언어로 변환하는 작업이다. 본 연구에서는 Qwen2.5-Coder-7B 모델[31]을 선택하였다. 이 모델의 주요 특징은 Qwen 시리즈 중 가장 작은 모델임에도 불구하고 뛰어난 코딩 성능(HumanEval 88.4%)을 보이며, 오픈소스라는 점이다. 또한 SQL 벤치마크(Spider)에서 82.0%의 성능을 기록하여, 적은 파라미터 수를 가진 LLM 모델중 SQL 변환 능력이 우수한 모델이다.

4. RAG 성능 비교

RAG 성능 평가를 위해 15초 간격으로 촬영된 5초 단위의 2개 영상에서 추출한 VLM 기반 텍스트 정보(총 608개)를 활용하여, GPT-4.1을 이용하여 합성 질문을 총 500개의 합성 질문을 생성하였다. 질문은 단일 텍스트 정보와 다중 텍스트 정보를 각각 8:2 비율로 생성하였으며, 생성된 질문을 GPT-4.1을 통해 검증하여 최종적으로 439개를 선정하였다. 그림 7은 RAG 성능 평가를 위해 생성된 질문들을 보여준다.

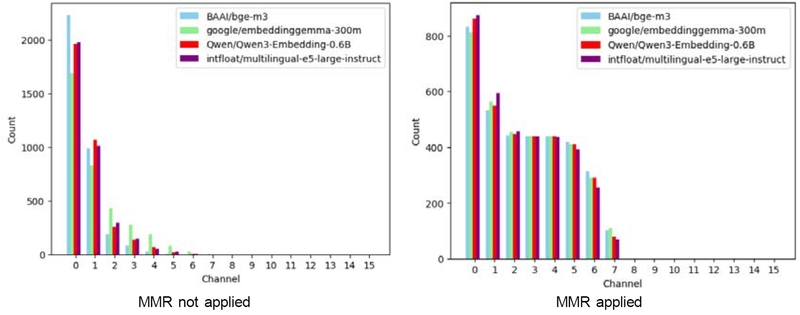

사용자 질의에 대한 유사성 검색 시 top_k를 8개로 지정하여 각각의 벡터 임베딩을 활용해 질의를 수행할 경우, 특정 채널에 집중되는 현상을 확인할 수 있다. 영상은 연속적인 이미지로 구성되어 있기 때문에, 질문이 특정 채널의 연속된 이미지와 유사할 가능성이 높다. 그러나 본 시스템은 다중 채널을 사용하므로, 채널에서 참조 텍스트가 선택되기를 기대한다. 본 연구에서는 MMR을 적용하여 문서의 관련성과 다양성을 동시에 고려하는 방법을 사용한다. 각 채널별로 top_k를 3개로 지정하고, 16채널일 경우 총 16×3 = 48개의 유사한 텍스트를 기반으로 MMR 방법을 적용한다. 48개의 유사한 텍스트를 MMR 기반으로 순위를 재정렬한 후 상위 8개를 선택한다. 그림 8은 16채널에서 top_k 3개를 적용했을 때, 유사 텍스트로 선택된 상위 채널 수를 보여준다. 특정 채널에 집중되지 않고 다양한 채널에 분포되는 결과를 나타낸다. 본 연구에서는 각 채널별 top_k 3개, 총 16×3 = 48개의 유사한 텍스트를 확보한 후, 해당 텍스트에 대해 리랭커를 적용하여 유사도를 기반으로 하여 16개를 추출하고, 최종적으로 MMR 방법을 통해 5개의 문서를 선정한다.

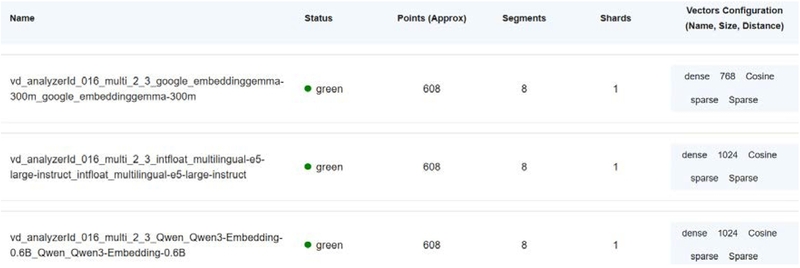

임베딩 벡터 모델로는 BAAI/bge-m3, google/embeddinggemma-300m, Qwen/Qwen3- Embedding–0.6B, intfloat/multilingual-e5-large-instruct 총 4개를 사용하였으며, 리랭커 모델로는 Qwen/Qwen3-Reranker-0.6B, BAAI/bge-reranker-v2-m3, jinaai/jina-reranker-v2-base-multilingual을 활용하여 비교하였다. 그림 9는 Qdrant 벡터 데이터베이스에 VLM을 통해 변환된 텍스트가 벡터로 저장된 모습을 보여준다.

평가는 RAGAS를 이용하여 컨텍스트 정밀도와 신뢰도를 측정하였다. 표 9는 RAGAS를 통한 RAG 평가 결과를 나타낸다. 0.25, 0.5, 0.75는 데이터를 크기 순서로 정렬했을 때 4분위 수에 해당하는 25%, 50%, 75%를 의미한다. 전체(total)는 0.5 구간의 값인(context precision + faithfulness)/2의 평균이다. 최종 결과, 임베딩 모델이 BAAI/bge-m3일 경우 성능이 가장 우수했으며, 리랭커 모델은 큰 차이를 보이지 않았다. 다양한 임베딩 모델과 리랭커를 이용한 비교는 RAG 평가를 위해 생성된 데이터셋의 질문, 임베딩 벡터 모델과 리랭커를 통한 벡터 검색을 통한 참고 텍스트, 그리고 참고 텍스트를 기반으로 한 RAG 답변에 대해 이루어졌으며, 해당 답변에 사용한 LLM 모델은 질의 분류 모델에서 사용한 Qwen/Qwen3-4.0B을 사용하였다. BAAI/bge-m3는 MTEB에서 제로 샷 성능 99%를 기록하며, 파라미터 수는 5억 6,800만, 임베딩 크기는 1024, 최대 토큰 수는 8194를 갖는다. 본 연구에서는 리랭커 모델로 BAAI/bge-reranker-v2-m3, 임베딩 모델로 BAAI/bge-m3을 선정하여 추가 실험을 진행한다.

임베딩, 리랭커, 답변 모델을 선정한 후 추가적인 성능 개선을 위해 세 가지 방법을 제안한다. 이 추가 방법들은 실시간 성능에 영향을 주지 않는 방식으로 선정되었다. 첫 번째는 질의 확장 방법인 질의 재구성, 두 번째는 하이브리드 검색, 마지막으로 두 가지 방법을 모두 적용했을 경우에 대해 RAGAS를 통한 RAG 평가를 진행하였다. 질의 재구성은 질의 분류 모델에서 동시에 수행 가능하기 때문에 추론 시간에 영향을 미치지 않는다. 표 10은 세 가지 방법을 각각 테스트한 결과를 나타낸다. 실험에 사용된 텍스트를 기반으로 질문을 생성하였고, 생성된 질문을 통한 RAG 답변으로 평가하였기 때문에 유사한 단어나 의미의 다양성을 파악하기 위해 추가 데이터를 활용하여 실험을 진행하였다. 본 연구에서는 AIHUB[32]의 이상행동 CCTV 영상을 추가 데이터로 구축하였다. 이상행동 CCTV 영상은 12가지 이상행동(폭행, 싸움, 절도, 기물 파손, 실신, 배회, 침입, 투기, 강도, 데이트 폭력 및 추행, 납치, 주취 행동)을 포함하여, 총 700시간(8,400컷)의 비디오 데이터셋이다. 해당 데이터는 4~5분 분량의 동영상으로 총 400개를 5초 간격으로 분석하여 VLM을 통해 텍스트로 변환하고 변환하였고, 텍스트를 임베딩 벡터를 통해 벡터로 변환한 후 벡터 데이터베이스에 임의의 채널에 랜덤하게 저장하였다.

AIHUB의 추가 데이터셋을 사용하지 않은 경우, 질의 재구성을 통한 질문은 컨텍스트 정밀도 향상에 도움이 되지만 신뢰성에는 떨어지는 것으로 나타났다. 이러한 이유로 컨텍스트 정밀도는 검색된 문서가 질문과 관련이 있는지를 평가하는 지표이며, 신뢰성은 답변이 검색된 문서(컨텍스트)에서 제공된 정보를 기반으로 얼마나 정확하게 생성되었는지를 평가하는 지표이다. 따라서 AIHUB에서 검색에 사용되는 후보 벡터의 수가 많아진 것이 원인으로 보인다.

하이브리드 방법은 밀도 기반 방법과 큰 차이가 없었다. 이는 질문의 단어가 전문 용어가 아닌 단순한 단어들의 조합이기 때문으로 보인다. 반면, AIHUB의 추가 데이터셋을 사용할 경우, 질의 재구성에 따른 컨텍스트 정밀도가 크게 향상되는 것을 확인할 수 있다.

Ⅳ. 결론 및 향후 연구

본 시스템은 다중 채널 서빙 환경이기 때문에 소요 시간이 중요한 요소로 작용한다. 모델 선정 시에는 가급적 소요 시간을 고려하여 소형 모델을 선택하였으며, 또한 영상 보안 시스템 특성상 온프레미스 환경(폐쇄망)에서 적용 가능한 오픈소스 모델을 사용하였다. 본 연구 결과를 종합하면, VLM의 성능은 CLOVAX-Vision이 가장 우수하였고, 질의 분류 모델과 질의 응답에는 Qwen3-4.0B 모델을 활용하였으며, RAG 기반 답변을 위해 임베딩 벡터와 리랭커로 bge 모델을 사용하였다. RAG 성능 개선을 위해 질의 재구성 및 하이브리드 방법 등을 도입하여 RAGAS 평가를 통해 성능을 검증하였다. 본 연구 결과는 영상 보안 및 산업 안전 관리 등의 분야에 직접적으로 활용될 수 있다. 특히 기존 CCTV 시스템을 운영하는 조직들이 대규모 시스템 교체 없이도 AI 기술의 이점을 실용적으로 활용할 수 있는 실용적인 방안을 제시한다. 또한 본 연구에서 개발한 VLM 성능 평가 방법론과 RAG 최적화 기법은 다른 멀티모달 AI 시스템 개발에도 적용 가능하며, 특히 실시간 처리가 중요한 응용 분야에서 유용한 참고 자료가 될 것이다. 오픈소스 기반 구현과 상세한 성능 분석 결과는 연구 재현성을 높이고 후속 연구를 촉진하는 데 기여할 것으로 기대된다. 향후 연구의 영상에서 실시간 처리를 위해 채널 수를 줄이고 고성능 GPU를 활용하여 1초 단위 평가를 수행할 예정이다. 또한, 중요 정보만을 추출하는 영상 요약과 시간적인 정보를 기반으로 한 이상행동 탐지 등, 레거시 영상 분석에서 처리하지 못했던 부분에 대한 연구를 지속할 계획이다.

Acknowledgments

본 연구는 과학기술정보통신부 및 정보통신기획평가원의 2026년도 실감콘텐츠핵심기술개발 사업으로 수행되었음 (과제명: 증강현실기반 RAG 재난안전 통합플랫폼 개발, 과제번호: RS-2025-02219484, 기여율: 100%)

References

-

J. Redmon, S. Divvala, R. Girshick, A. Farhadi. “You Only Look Once: Unified, Real-Time Object Detection” arXiv:1506.02640, , May. 2016.

[https://doi.org/10.1109/CVPR.2016.91]

-

J. Redmon, A. Farhadi. “YOLO9000: Better, Faster, Stronger” arXiv:1612.08242, , Dec. 2016.

[https://doi.org/10.1109/CVPR.2017.690]

-

J. Redmon, A. Farhadi. “YOLOv3: An Incremental Improvement. arXiv:1804.02767, ” Apr. 2018.

[https://doi.org/10.48550/arXiv.1804.02767]

-

R. Varghese and S. M. “YOLOv8: A Novel Object Detection Algorithm with Enhanced Performance and Robustness” 2024 International Conference on Advances in Data Engineering and Intelligent Computing Systems (ADICS), Chennai, India, pp. 1-6 2024.

[https://doi.org/10.1109/ADICS58448.2024.10533619]

-

A. Bewley, Z. Ge, L. Ott, F. Ramos, B. Upcroft. “Simple Online and Realtime Tracking” arXiv:1602.00763, , Jul. 2017.

[https://doi.org/10.1109/ICIP.2016.7533003]

-

N. Wojke, A. Bewley, D. Paulus. Simple Online and Realtime Tracking with a Deep Association Metric. arXiv:1703.07402, , Mar. 2017.

[https://doi.org/10.1109/ICIP.2017.8296962]

-

Y. Zhang, P. Sun, Y. Jiang, D. Yu, F. Weng, et al. “ByteTrack: Multi-Object Tracking by Associating Every Detection Box” arXiv:2110.06864, , Apr. 2022.

[https://doi.org/10.1007/978-3-031-20047-2_1]

-

N. Aharon, R. Orfaig, B. Bobrovsky. “BoT-SORT: Robust Associations Multi-Pedestrian Tracking” arXiv:2206.14651, , Jul. 2022.

[https://doi.org/10.48550/arXiv.2206.14651]

- Y. Du, Z. Zhao, Y. Song, Y. Zhao, Fei Su, Tao Gong, Hongying Meng. StrongSORT: Make DeepSORT Great Again. arXiv:2202.13514, , Feb. 2023.

-

M. B. Shaikh, S. M. S. Islam, D. Chai, N. Akhtar. “From CNNs to transformers in multimodal human action recognition: A survey” arXiv:2405.15813, , May 2024.

[https://doi.org/10.1145/3664815]

-

Y. Xiao, H. Xiang, T. Wang and Y. Wang, “Enhanced Industrial Action Recognition Through Self-Supervised Visual Transformers” in IEEE Access, vol. 12, pp. 134133-134143, 2024.

[https://doi.org/10.1109/ACCESS.2024.3455749]

-

Gemma Team, A. Kamath, J. Ferret, S. Pathak et al. “Gemma 3 technical report” arXiv:2503.19786, , Mar 2025.

[https://doi.org/10.48550/arXiv.2503.19786]

-

J. Zhu, W. Wang, Z. Chen, Z. Liu, S. Ye, L. Gu et al. “InternVL3: Exploring advanced training and test-time recipes for open-source multimodal models” arXiv:2504.10479, , Apr 2025.

[https://doi.org/10.48550/arXiv.2504.10479]

-

A. Yang, B. Yu, C. Li, D. Liu, F. Huang, H. Huang et al. “Qwen2.5-1m technical report” arXiv:2501.15383, , Jan 2025.

[https://doi.org/10.48550/arXiv.2501.15383]

-

K.M. Yoo, J. Han, S. In, H. Jeon, J. Jeong, J. Kang et al. “HyperCLOVA X technical report” arXiv:2404.01954, , Apr 2024.

[https://doi.org/10.48550/arXiv.2404.01954]

-

Z. Wu, X. Chen, Z. Pan, X. Liu, W. Liu, D. Dai et al. “DeepSeek-VL2: Mixture-of-Experts vision-language models for advanced multimodal understanding” arXiv:2412.10302, , Dec 2024.

[https://doi.org/10.48550/arXiv.2412.10302]

-

A. Marafioti, O. Zohar, M. Farré, M. Noyan et al. “SmolVLM: Redefining small and efficient multimodal models” arXiv:2504.05299, , Apr 2025.

[https://doi.org/10.48550/arXiv.2504.05299]

-

M. Abdin, J. Aneja, H. Awadalla, A. Awadallah et al. “Phi-3 Technical Report: A Highly Capable Language Model Locally on Your Phone” arXiv:2404.14219, , Aug 2024.

[https://doi.org/10.48550/arXiv.2404.14219]

-

P. Lewis, E. Perez, A. Piktus, F. Petroni et al. “Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks” arXiv:2005.11401, , Apr 2021.

[https://doi.org/10.48550/arXiv.2005.11401]

- Embedding Leaderboard MTEB(Multilingual, v2) https://huggingface.co/spaces/mteb/leaderboard

-

S. Ockerman, A. Gueroudji, S.Y. Oh, R. Underwood et al. “Exploring Distributed Vector Databases Performance on HPC Platforms: A Study with Qdrant.” arXiv:2509.12384, , Sep 2025.

[https://doi.org/10.1145/3731599.3767404]

- A. Ingber, E. Liberty. “Accurate and Efficient Metadata Filtering in Pinecone's Serverless Vector Database” ICML 2025

- Chroma https://www.trychroma.com

- Weaviate https://weaviate.io

-

L. Gao, X. Ma, J. Lin, J. Callan. “Precise Zero-Shot Dense Retrieval without Relevance Labels” arXiv:2212.10496, , Dec 2022.

[https://doi.org/10.18653/v1/2023.acl-long.99]

-

H. Liu, Z. Wang, X. Chen, Z. Li, F. Xiong, Q. Yu et al. “HopRAG: Multi-hop reasoning for logic-aware retrieval-augmented generation.” arXiv:2502.12442, , May 2025.

[https://doi.org/10.18653/v1/2025.findings-acl.97]

-

S. Verma. “Contextual compression in retrieval-augmented generation for large language models: A survey.” arXiv:2409.13385, , Oct 2024.

[https://doi.org/10.48550/arXiv.2409.13385]

-

Q. Tang, J. Chen, Z. Li, B. Yu, Y. Lu, H. Yu et al. “Self-Retrieval: End-to-end information retrieval with one large language model.” arXiv:2403.00801, , Nov 2024.

[https://doi.org/10.48550/arXiv.2403.00801]

-

X. Wang, C. Macdonald, I. Ounis. “Deep reinforced query reformulation for information retrieval.” arXiv:2007.07987, , Jul 2020.

[https://doi.org/10.48550/arXiv.2007.07987]

-

T. Zhang, V. Kishore, F. Wu et al. “BERTScore: Evaluating Text Generation with BERT” arXiv:1904.09675, , Feb 2020.

[https://doi.org/10.48550/arXiv.1904.09675]

-

B. Hui, J. Yang, Z. Cui, J. Yang, D. Liu, L. Zhang et al. “Qwen2.5-coder technical report.” arXiv:2409.12186, , Nov 2024.

[https://doi.org/10.48550/arXiv.2409.12186]

- AiHub https://www.aihub.or.kr

- 2011년 2월 : 서울과학기술대학교 NID융합기술대학원 석사

- 2020년 3월 ~ 현재 : 서울과학기술대학교 IoT 융복합 기술 연구소 책임 연구원

- 2020년 9월 ~ 2023년 2월 : 서울과학기술대학교 나노IT디자인융합대학원 정보통신미디어공학전공 박사수료

- ORCID : https://orcid.org/0000-0003-0822-9857

- 주관심분야 : 컴퓨터비전, 생성형 AI

- 1984년 2월 : 한국항공대학교 전자공학과 공학사

- 1986년 2월 : 연세대학교 전자공학과 공학석사

- 1991년 2월 : 연세대학교 전자공학과 공학박사

- 1991년 3월 ~ 1996년 9월 : 삼성전자 신호처리연구소 선임연구원

- 2016년 1월 ~ 2017년 12월 : 서울과학기술대학교 나노IT디자인융합대학원 원장

- 1999년 8월 ~ 현재 : 서울과학기술대학교 스마트ICT융합공학과 교수

- 2006년 1월 ~ 2007년 8월 : Georgia Institute of Technology Dept.of Electrical and Computer Engineering, Visiting Scholar

- ORCID : https://orcid.org/0000-0002-7055-5568

- 주관심분야 : 컴퓨터비전, 지능형실감미디어