언리얼 엔진 환경에서의 실사 기반 배경 생성 효율성 비교: 3D 가우시안 스플래팅과 리얼리티스캔을 중심으로

Copyright © 2026 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

본 연구는 고비용·고난도의 버추얼 프로덕션 배경 제작 한계를 극복하기 위해, 실사 데이터 기반의 3D 가우시안 스플래팅(3DGS) 제작 방식을 제안한다. 기존의 표준 도구인 리얼리티스캔(RealityScan)은 포인트 클라우드 방식의 특성상 3차원 구현 시 표면 열화와 시각적 불완전성을 보이는 한계가 있었다. 이에 대한 대안으로 3DGS를 적용하여 시티 샘플, 학교 건물, 그리고 천안 독립기념관 ‘겨레의 탑’ 등 세 가지 환경에서 비교 실험을 수행하였다. 특히 대형 구조물인 겨레의 탑 실험에서는 약 5,700장의 이미지를 학습하여 실무 적용성을 면밀히 검증하였다. 연구 결과, 3DGS는 PSNR, SSIM, LPIPS 등 주요 정량 지표에서 비교군 대비 일관되게 우수한 성능을 기록하였으며, 이를 통해 실사 기반의 고품질 가상 배경 제작 기술로서의 타당성을 입증하였다.

Abstract

This study proposes a real-image-based 3D Gaussian Splatting (3DGS) production approach to overcome the high cost and technical complexity associated with conventional virtual production background creation. The standard tool commonly used in this domain, RealityScan, relies on point-cloud-based reconstruction, which often leads to surface degradation and visual incompleteness when generating three-dimensional representations. As an alternative, 3DGS was applied and evaluated through comparative experiments across three environments: a city sample, a school building, and the “Tower of the Nation” at the Cheonan Independence Hall. In particular, the experiment involving the large-scale structure of the Tower of the Nation utilized approximately 5,700 images for training, enabling a rigorous assessment of practical applicability. The results demonstrate that 3DGS consistently outperforms the comparison method across key quantitative metrics, including PSNR, SSIM, and LPIPS, thereby validating its effectiveness as a high-quality, real-image-based virtual background generation technique suitable for virtual production workflows.

Keywords:

Virtual Production (VP), 3D Gaussian Splatting (3DGS), Unreal Engine, Photographic Multi-View Reconstruction, RealityScanⅠ. 서 론

오늘날 영화, 드라마 같은 고품질 영상 콘텐츠 제작에서 컴퓨터 그래픽(Computer Graphics, CG) 기술은 핵심 요소이다. 이러한 경향은 대형 자본이 투입되는 할리우드는 물론 국내 영상 산업에서도 보편적으로 나타나고 있다. CG 기술이 영상 제작의 핵심으로 부상했음에도 불구하고, 고질적인 두 가지 문제점을 안고 있다. 첫째는 높은 제작 비용이다. 일례로, CG 기술이 집약된 영화 ‘아바타: 물의 길’의 경우, 초당 제작비가 약 2억 3천 5백만 원에 달하는 것으로 알려져 있다[1]. 둘째는 결과물의 예측 불가능성(unpredict- ability)이다. 특히 후자의 경우, 창작자가 최종 결과물을 확신하지 못한 채 촬영에 임해야 하므로 예술적 완성도를 온전히 확보하기 어렵게 만드는 불안 요소로 작용한다. 이로 인해 오늘날 영화 중심의 고화질 콘텐츠 제작에서 사전 시각화(previsualization)의 비중이 크게 증가하여, 제작 비용은 더 상승하였다.

최근 이같은 비용 및 완성도의 문제를 동시에 해결하기 위한 대안으로 버추얼 프로덕션(virtual production, VP) 기술이 주목받고 있다. VP는 다양한 형태로 구현될 수 있으나, 현재 영상 제작 업계에서는 게임엔진인 에픽 게임즈(Epic Games) 사의 언리얼 엔진(Unreal Engine)을 활용하는 방식이 사실상의 표준(de facto standard)이 되었다. 언리얼 엔진을 활용한 VP는 실시간 렌더링(real-time rendering) 기술을 기반으로, 촬영 현장에서 가상의 배경과 실제 배우 및 소품을 즉시 결합하여 시각화하는 제작 방식이다. 이는 후반 작업(post-production) 의존도를 획기적으로 낮추고, 현장에서 감독과 촬영팀이 최종 결과물을 예측하며 창의적인 의사 결정을 내릴 수 있도록 지원한다. 특히 대형 LED 스크린을 활용하여 환경을 구성하는 인 카메라 VFX(In-Camera VFX) 방식이 대표적으로 활용된다[2].

언리얼 엔진 기반의 VP 기술은 국내 영상산업에서도 영화, 드라마, 광고 등 다방면에 걸쳐 적극적으로 도입되고 있다. 인기 걸그룹 에스파의 뮤직비디오는 게임엔진의 실시간 구현 능력을 활용하여 제작된 디지털 휴먼을 포함하고 있으며[4], 넷플릭스 드라마 ‘고요의 바다(The Silent Sea, 2021)’도 대형 LED 월 기반 VP를 사용하였다. 이는 고비용의 후반 작업을 최소화하고 창작의 유연성을 확보하는 VP의 장점을 보여주는 사례이다.

이같은 VP 시스템의 구현 및 운영에 있어 가상 배경의 생성은 필수 선행 조건이다. VP는 실시간 렌더링 환경 내에서 실제 촬영 요소와 가상 환경을 결합하는 제작 방식이므로, 실재하는 듯한 배경 데이터가 근간이 되어야 한다. 이러한 가상 환경은 전적으로 컴퓨터 그래픽 기술을 기반으로 구축되며, 고품질의 3D 모델링, 텍스처링 및 라이팅 기술이 동원된다.

최근 주목받고 있는 3D 가우시안 스플래팅(3D Gaussian Splatting, 3DGS) 기술은 이러한 기존 제작 방식의 약점을 완화할 수 있는 대안으로 부상하고 있다. 3DGS는 다수의 3차원 가우시안 분포를 활용하여 장면을 표현하는 방식으로, 기존의 폴리곤 기반 모델링 없이도 사실적인 3D 표현을 가능하게 한다. 특히 다중 시점 영상 데이터로부터 직접 장면을 재구성할 수 있어 모델링 전문 인력에 대한 의존도를 줄이고, 데이터 기반의 자동화된 배경 생성이 가능해 제작 효율성을 높인다. 이러한 3DGS의 가장 큰 강점은 실시간성(real-time rendering)과 실사에 가까운 고품질 시각화를 동시에 달성한다는 점이다. 기존의 뉴럴 렌더링 기법들이 높은 계산량으로 인해 실시간 적용에 제약을 받았던 것과 달리, 3DGS는 효율적인 데이터 구조와 최적화된 렌더링 파이프라인을 통해 VP 환경에서 요구되는 실시간 합성을 효과적으로 지원한다[5].

3DGS 기반 VP 배경 생성은 두 가지 강점을 지니고 있다. 첫째, 실사 촬영하는 포토그래메트리(photogrammetry)라는 강점을 지닌다. 실제 촬영된 다중 시점 영상을 입력으로 활용할 수 있어, 현실감 있는 배경을 빠르게 구축할 수 있다. 이는 전통적인 3D 모델링 방식에서 발생하는 비용의 문제를 최소화할 수 있다. 둘째, 기존 촬영 중심 제작자에게 친숙한 워크플로우를 제공한다. 기존의 3D 모델링 및 게임엔진 기반 워크플로우는 CG 전문 인력을 필수로 요구하며, 이는 전통적인 연출, 촬영, 편집 제작 인력에게 높은 진입 장벽으로 작용한다. 반면, 3DGS는 여러 시점에서 캡처된 2D 이미지 데이터를 기반으로 3D 장면을 재구성한다. 따라서 기존 콘텐츠 제작자가 익숙한 사진 촬영 방식의 데이터 획득을 통해 3D 배경을 용이하게 생성할 수 있다.

이 같은 3DGS는 VP의 핵심 과제인 제작 비용 절감, 제작 효율성 증대, 그리고 예측 가능한 결과물 확보라는 세 가지 요구를 동시에 충족시킬 수 있는 강력한 잠재력을 지니고 있다. 본 연구는 이러한 가능성을 실증적으로 탐구하고, 모델링 공정 없는 VP 배경 생성 방식으로서, 3DGS의 실질적인 활용 가능성을 연구하고자 한다.

본 연구는 다음과 같이 구성된다. 제2장에서는 VP의 제작과정을 살펴보고 가상 배경 생성의 필수 조건인 3D 모델링의 문제점을 제시한다. 제3장에서는 포인트 클라우드(point cloud), NeRF(Neural Radiance Fields) 등 2D 촬영 포토그래메트리 기반 3D 변환 기술의 동향을 정리하고, 3DGS의 핵심 원리를 바탕으로 VP 배경 생성에의 적용 가능성을 논의한다. 제4장에서는 3DGS를 활용하여 제작한 독립기념관 실제 현장 배경의 사례를 제시하고, 기존에 언리얼 엔진에서 사용하는 리얼리티스캔(RealityScan)과 비교하여 우수성을 비교, 검증하였다. 마지막으로 제5장에서는 연구 결과를 종합하고, 현재 기술 수준에서 시네마급 상업 콘텐츠 대신 방송용 교양 프로그램과 같은 영역에서의 활용 가능성을 제시하며, 향후 발전 방향에 대한 기대를 정리하고자 한다.

Ⅱ. 버추얼 프로덕션 현황과 모델링 기반 배경 생성의 문제점

본 장에서는 현재 영상 제작 업계에서 사실상의 표준으로 자리 잡은 언리얼 엔진 기반 버추얼 프로덕션 기반 콘텐츠 제작과정에 대해 알아보고자 한다. 현재의 작업 방식과 더불어 가상 배경 생성을 위한 3D 모델링 과정에서 발생하는 기술적, 인력적 한계점을 중점적으로 제시한다.

1. 게임엔진 기반 버추얼 프로덕션의 시작

2010년대 후반 이후 게임엔진의 급속한 발전은 영화·방송 제작 패러다임에 큰 영향을 주었다. 게임엔진은 실시간 랜더링, 상호작용이 핵심이다. 그중에서도 언리얼 엔진과 유니티(Unity)가 시장을 양분하고 있다. 유니티는 2021년 웨타 디지털(Weta Digital)을 인수하며 영상 산업 진출을 시도하였으나, 현재까지 영상 콘텐츠 분야에서 뒤지고 있다. 언리얼이 영화 산업에 본격적으로 도입된 계기는 실시간 렌더링 기술의 고도화이다. 2000년대 후반 엔비디아(Nvidia)의 연산 기술이 향상되면서 게임엔진의 실시간 처리 성능이 기존의 오프라인 렌더링 품질에 근접하게 되었고, 영화 제작자들이 게임엔진을 사전 시각화나 배경 합성 등에 실험적으로 도입하기 시작하였다.

국내에서는 방송과 예능 프로그램에서 게임엔진을 활용한 초기 사례들이 등장하였다. 2018년 MBC 예능 프로그램 ‘두니아-처음 만난 세계’는 ‘언리얼 버라이어티’라는 개념으로, 프로그램 내에 ‘게임 야생의 땅: 듀랑고의 세계’를 언리얼 엔진을 통해 재구성하였다. 또한 2020년 방영된 다큐멘터리 ‘너를 만났다’는 언리얼 엔진 기반의 가상현실 기술을 활용하여 세상을 떠난 인물을 디지털 휴먼으로 재현함으로써, 국내 방송 제작 환경에서 게임엔진의 가능성을 보여준 대표적인 사례로 평가된다[6].

한편, 2019년 에픽게임즈는 시그래프(SIGGRAPH)에서 VP 기능을 공식 발표하며 게임엔진의 활용 범위를 영화 촬영 단계로 확장시켰다. 발표 당시 공개된 데모 영상에서는 LED 월을 이용한 인-카메라 VFX 기술을 선보였으며, 이는 실시간 글로벌 일루미네이션(Lumen) 기술과 결합되어 사실적 조명과 반사를 재현하는 새로운 제작 패러다임을 제시하였다.

이후 VP 기술은 만달로리안(The Mandalorian, 2019) 제작에 적용되며 전 세계 영화 산업에 큰 반향을 일으켰다[7]. LED 월에 구현된 가상 배경은 카메라의 움직임에 따라 즉시 갱신되며, 실시간으로 광원 반사를 재현하였다. 이를 통해 전통적인 후반 합성 의존도를 낮추고, 촬영 현장에서 곧바로 최종 영상 수준의 결과물을 확인할 수 있게 되었다. 국내에서도 엑스온(XON Studios)의 승리호, 비브스튜디오스(VIVE Studios)의 고요의 바다 등에서 VP가 도입되었으며, 이후 광고·드라마·영화 등으로 그 적용 범위가 확대되고 있다[8].

2. 버추얼 프로덕션 워크플로우

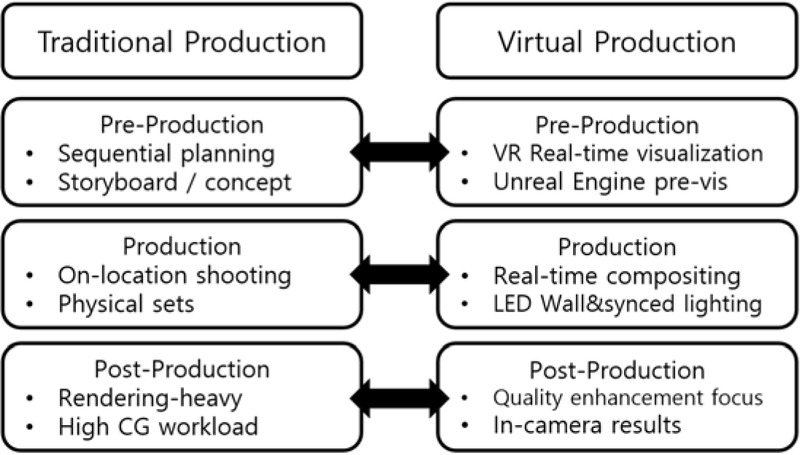

VP는 단순한 장비나 소프트웨어의 도입에 따른 기술적 진보에 그치는 것이 아니라, 제작자 간 역할과 공정 간 워크플로우가 실시간으로 상호 연동되는 통합적 제작 생태계(integrated production ecosystem)로 규정된다. 전통적 제작 방식이 프리프로덕션-프로덕션-포스트프로덕션으로 이어지는 선형적·단일 흐름 구조를 취했던 것과 달리, VP에서는 이러한 단계들이 비선형적이며 동시적으로 병행·통합되어 운영된다. 특히 과거 후반 작업 영역에 머물렀던 시각효과 및 디지털 처리 부문이 사전 기획 단계에서부터 핵심적인 역할을 수행하는 등, 프리프로덕션 단계의 비중과 중요성이 현저히 확대되고 있다[9]. 그림 2에 전통적인 제작과정과 VP 기반 제작과정을 비교하였다.

VP는 LED 월, 게임엔진, 카메라 트래킹 시스템을 기반으로 가상 공간과 실사 촬영을 실시간으로 결합하는 제작 방식이다. 전통적인 후반 합성 방식과 달리, 사전 기획 단계에서부터 통합된 제작 워크플로우를 요구한다. VP의 제작과정은 크게 사전 제작, 가상 공간 제작, 촬영, 후반 제작의 네 단계로 구성된다. 프리프로덕션 단계에서는 콘텐츠의 장면 특성과 촬영 요구 조건에 따라 2D, 2.5D, 3D, 360 HDRI 등 가상 배경 유형을 결정한 후, 사전 시각화를 통해 가상 공간 활용 가능성과 기술적 제약을 세밀하게 검토하는 절차가 필수적이다. 이 단계에서 기존 기획 단계에서 사용되지 않는 VR(virtual reality)을 사용한다는 점이다.

가상 배경 제작 단계에서는 선택된 제작 방식에 따라 데이터를 생성하며, 방식 간 기술적 요구도가 크게 다르다. 2D 방식은 단순 배경 제작에 적합하지만 현장 수정이 제한적이며, 2.5D는 시차 스크롤 기반 깊이감을 제공하여 3D 대비 제작 효율성이 높다. 반면 3D 방식은 게임엔진 기반 모델링 기술을 활용한 레벨 디자인 재현으로 가장 높은 유연성과 현실감을 제공하나, 데이터 최적화와 고사양 장비가 필요하다. 360 HDRI는 전 방향 가상 공간을 구현하여 카메라 이동 제약을 최소화하는 방식으로, 볼륨형 스튜디오에서 가장 효과적이다. 영화, 드라마 같은 고화질 콘텐츠 제작에는 모델링 기반 제작에 대부분 의존한다. 이는 실사 스캔 기반으로 생성된 레벨의 디테일이 낮기 때문이다. 특히 언리얼 엔진에서 사용하는 리얼리티스캔의 성능은 낮은 편이다.

프로덕션 단계에서는 카메라 트래킹을 통해 실제 카메라의 움직임과 가상 카메라를 동기화하고, 가상 배경 내·외부 빛 환경 기반 값을, LED 월의 배경과 조명 효과에 실시간 적용한다. 이 단계는 VP 워크플로우의 핵심으로, 조명·반사·카메라 이동이 가상 배경과 밀접하게 결합된다. 후반 제작 단계는 색보정과 밝기 조정 등 최소한의 보정 중심으로 축소되며, 대다수 시각 정보는 프로덕션 단계에서 이미 완성되는 것이 VP의 강점이다.

결과적으로 VP의 워크플로우는 가상 배경 제작 방식, LED 스튜디오 유형, 촬영 조건이 상호 연동된 통합적 구조로 운영되며, 각 단계에서의 정확한 기술 선택과 사전 시각화가 전체 제작 품질을 결정하는 핵심 요인으로 작용한다.

3. 버추얼 프로덕션의 모델링 중심 제작 방식 한계

앞서 살펴본 바와 같이 VP는 LED 월, 게임엔진, 카메라 트래킹 시스템의 연동을 통해 실시간 합성을 구현함으로써 전통적 후반 합성 중심 제작 방식이 갖는 예측 불가능성과 시간·비용 부담을 완화하는 대안으로 활용되고 있다. 그러나 이러한 장점에도 불구하고, 현행 VP 제작 파이프라인은 여전히 고난도 3D 모델링 공정에 기반하고 있어, 실무 적용 단계에서 구조적 한계를 드러내고 있다.

첫째, 3D 모델링 기반 자산 제작의 비용·시간 부담이다. 3D 방식의 VP 배경 구축은 폴리곤 모델링, 텍스처링, 머티리얼, 라이팅 등 전통적인 CG 파이프라인을 그대로 수행해야 하며, 이는 다수의 전문 인력과 장기간의 제작 기간을 요구한다. 특히 장편 영화나 드라마와 같이 다수의 로케이션과 대규모 세트가 필요한 경우, 각 장면에 필요한 3D 환경을 개별적으로 구축해야 하므로 제작비가 크게 증가한다.

실제 문경 버추얼 프로덕션 스튜디오를 위한 K-헤리티지 디지털 에셋 구축 사례에서도 약 5개월 동안 600개 이상의 개별 에셋과 복수의 환경을 제작하기 위해 포토그래메트리·LiDAR 기반 하이브리드 스캔, 대규모 자동화 파이프라인, 모듈러 모델링, 커스텀 에디터 툴, 전용 에셋 라이브러리 및 버전 관리 시스템 등 복합적인 기술 체계를 적용해야 했다. 이는 일반적인 영화·드라마 제작 환경에서 3D 모델링 기반 VP 배경 제작이 상당한 인력 부담과 비용 증가 요인으로 작용함을 보여주는 대표적 사례이다[10].

둘째, 전문 인력 의존도와 기술 격차 문제가 존재한다. 고품질 VP 환경 구현을 위해서는 게임엔진 운용 능력뿐 아니라 하이폴리 모델링, PBR 기반 재질 설계, 엔진 최적화 등 고도화된 CG 기술 역량이 필수적이다. 이러한 기술적 요구는 촬영 중심의 정통 영화·방송 제작자에게 높은 진입 장벽으로 작용하며, 결과적으로 VP 활용을 소수의 대형 스튜디오 또는 전문 VFX 회사 중심으로 제한하는 구조를 형성한다[11].

셋째, 실사 기반 공간의 질감 및 디테일 재현의 한계가 있다. 노후 건물, 비정형 자연 지형, 생활 공간과 같이 복잡한 디테일을 갖는 실사 환경은 3D 모델링만으로는 재현 비용이 크게 증가한다. 이같은 작업은 대부분 포토그래메트리 기반 실사 스캔 후, 노이즈 제거, 토폴로지 재구성, UV 언랩, 텍스처 매핑, 메시 최적화 등 복잡한 후처리 작업을 필요로 한다. 이러한 특성 때문에 고해상도 실사 표현이 요구되는 영화·드라마 제작에서는 여전히 수작업 기반의 하이엔드 CG 공정에 대한 의존도가 높은 상황이다[12].

정리하면 VP는 촬영 현장에서 실시간 시각화와 효율성을 향상시켰으나, 근간을 이루는 3D 모델링 중심의 제작 방식은 시간, 인력 측면에서 비용을 증가시킨다. 이같은 문제 해결을 위해 촬영 중심 데이터만으로도 고현실감 3D 공간을 신속하게 복원하고, 별도의 모델링 과정 없이 실시간 렌더링 환경에 직접 활용할 수 있는 새로운 3D 표현 방식이 요구된다. 이러한 맥락에서 포인트 클라우드 재현 기법, NeRF 그리고 3DGS는 기존 모델링 공정을 대체 또는 축소할 수 있는 대안으로 주목받고 있다.

III. 언리얼 엔진에서 실사 기반 배경생성 연구

1. 포인트 클라우드 기반 실사 재현 방식

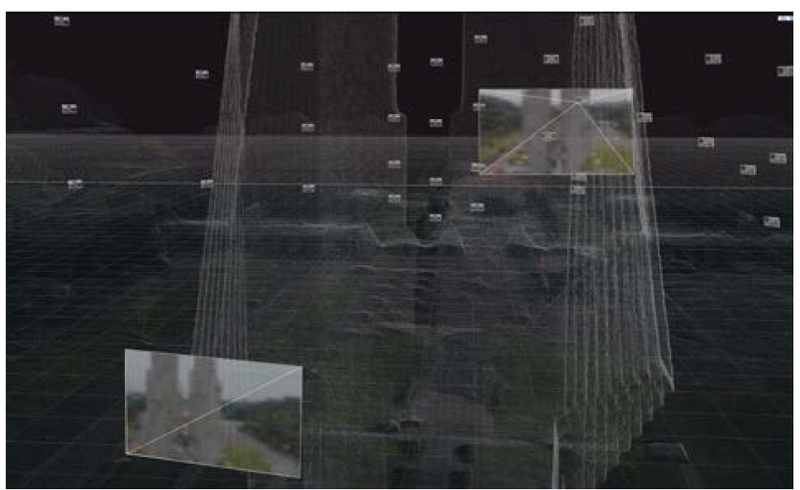

포인트 클라우드는 현실 공간의 기하학적 정보를 3차원 좌표를 가진 점들의 집합체로 기록하는 데이터 구조이다. 실사 기반의 3D 환경을 신속하게 디지털화할 수 있다는 명확한 이점으로 인해, VP, 디지털 트윈, VR 등 실감형 콘텐츠 제작의 초기 데이터 확보 단계에서 핵심적인 기술로 자리 잡고 있다. 전통적인 폴리곤 모델링 방식과 달리, 포인트 클라우드는 센서 또는 다중 시점 영상을 통해 공간의 깊이와 형상을 직접 취득한다. 따라서 복잡한 수동 모델링 과정을 거치지 않고도 구조적 특징을 즉각적으로 획득할 수 있다는 효율성을 지닌다. 그러나 본질적으로 불연속적인 점 데이터의 집합이기 때문에 표면의 연속성 유지, 정교한 텍스처 재현, 그리고 시각적 완성도 측면에서 태생적인 한계를 지닌다. 특히 고해상도 실사 출력이 필수적인 VP 환경에서는 이를 보완하기 위한 복잡한 후처리 공정이 동반되어야 한다. 그림 3은 포인트 클라우드 스캔 데이터를 언리얼 엔진에서 시각화한 사례로, 모델링 기반 배경에 비해 사실감이 제한적임을 확인할 수 있다[13].

LiDAR 방식은 레이저 펄스를 이용해 절대적 거리를 측정하므로 기하학적 정확도가 매우 높고 외부 광원 조건의 영향을 덜 받는다. 대규모 건축물이나 실외 공간 스캔에서 안정적인 구조 데이터를 확보하는 데 유리하지만, 반사체나 투명 재질에서의 신호 손실과 제한적인 RGB 정보 확보라는 단점이 있다. 따라서 시각적 실재감이 중요한 VP 환경에서는 포토그래메트리의 텍스처를 LiDAR 데이터에 입히는 하이브리드 방식이 주로 사용되나, 장비의 높은 비용과 운용 난이도가 실무적 제약으로 작용한다.

언리얼 환경에서 포인트 클라우드의 활용은 성능과 품질 사이의 갈등을 야기한다. 폴리곤 기반 엔진인 언리얼에서 점군 기반 데이터를 네이티브로 렌더링할 경우 텍스처와 표면 연속성이 부족하여 사실감이 떨어진다. 또한 수천만 개의 점군을 실시간 렌더링할 때 발생하는 GPU 부하는 VP 촬영에 필요한 안정적인 프레임레이트 확보를 방해한다. 언리얼 엔진에서 사용하는 나나이트(Nanite)를 활용한 메쉬 변환 방식 역시 최적화와 UV 재정비 등 추가 공정이 수반되므로 즉각적인 제작 환경 투입에 한계가 있다.

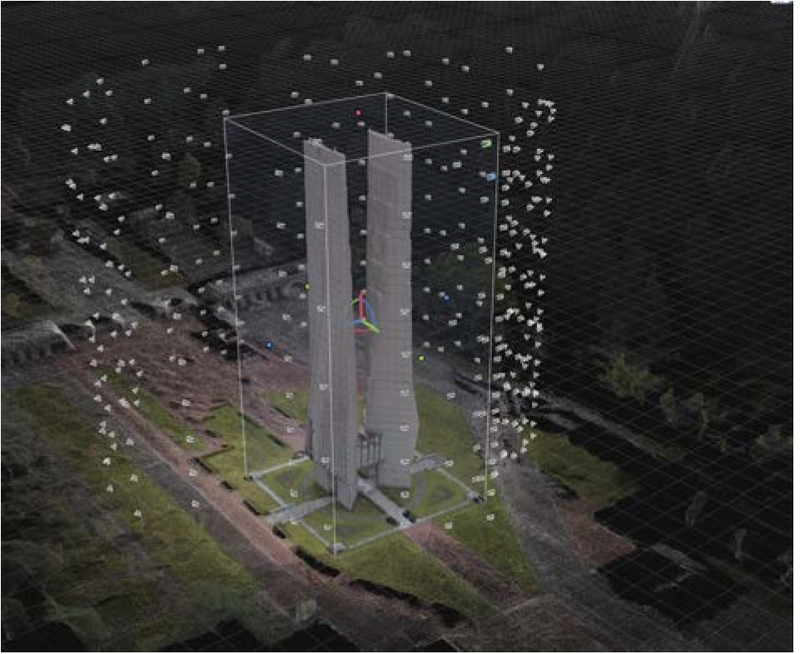

에픽게임즈에서 제공하는 리얼리티스캔은 라이다와 포토그래메트리를 통합 지원하며 메쉬 및 텍스처 자동화 기능을 통해 편의성을 극대화했으나, 고품질 VP 배경으로 직접 활용하기에는 퀄리티가 제한적이다. 그림 4에 리얼리티스캔으로 생성한 점군 데이터가 보인다.

본 논문에서는 이러한 기존 방식의 한계를 극복하기 위해, 현재 언리얼 엔진의 표준적 워크플로우인 리얼리티스캔의 점군 생성 방식의 대안으로, 3DGS를 도입함으로써 실시간성 유지와 고품질 실사 재현이라는 두 가지 목표를 동시에 달성할 수 있음을 논증하고자 한다.

2. NeRF 기반 배경 생성

NeRF는 다중 시점에서 촬영된 2D 영상으로부터 장면의 기하 구조와 광학적 특성을 학습하여 새로운 시점의 영상을 합성하는 신경 렌더링 기법이다. NeRF는 장면을 메시 혹은 점군 구조로 표현하는 기존 재현 방식과 달리, 3차원 위치와 시선 방향을 입력으로 하여 해당 지점의 밀도(density)와 방사복사율(radiance)을 출력하는 5차원 연속장 함수(continuous 5D coordinate)로 장면을 재현한다.

이러한 표현 방식은 실사 영상에서 관찰되는 미세 질감, 표면 연속성, 투과 및 차폐 관계를 자연스럽게 모델링할 수 있어, 기존 포인트 클라우드나 메시 기반 접근에서 발생하는 텍스처 불연속, 구명, 노이즈 문제를 근본적으로 완화한다[14].

그러나 NeRF는 구조적으로 실시간 렌더링을 전제로 설계된 기술이 아니며, 이는 VP의 실시간 카메라 추적 렌더링(In-camera VFX) 환경에서 가장 큰 제한 요소로 작용한다. 볼륨 렌더링 특성상 픽셀 단위 연산량이 매우 크고, 계층적 샘플링으로 인해 전체 프레임 처리 시간이 증가한다. 원본 NeRF는 단일 장면 학습에 수 시간에서 수십 시간이 소요되며, 하나의 프레임을 생성하는 데도 수 초에서 수 분이 필요해, LED 월 기반 촬영에서 요구되는 30~60fps의 실시간 프레임레이트를 제공하기 어렵다. 이를 개선하기 위해 Instant-NGP, FastNeRF 등 다양한 가속화 모델이 제안되었지만, 여전히 고속 렌더링을 위한 품질 저하가 발생하며 VP 촬영용 고품질 배경으로 바로 적용하기에는 한계가 존재한다[15][16].

3. 3D Gaussian Splatting 기반 배경 생성

3DGS는 NeRF 이후 등장한 신경 기반 장면 재현 기술의 대표적 진전으로, 실시간 렌더링 성능과 고품질 시각화를 동시에 달성할 수 있는 특징이 있다. 3DGS는 연속적인 방사 필드를 신경망으로 학습하는 NeRF와 달리, 장면을 수많은 3차원 가우시안의 집합으로 표현하는 구조를 채택한다. 각 가우시안은 위치, 색상, 밀도, 방향성 및 공분산 등의 파라미터로 정의되며, 이를 이미지 평면으로 투영(splatting)하는 방식으로 렌더링이 이루어진다. 이러한 구조는 광선별 반복 샘플링에 의존하는 NeRF와 비교하여 계산 복잡성이 낮고, GPU 기반 병렬화에 최적화되어 있다는 점에서 실시간 영상 합성 환경과의 적합성이 크다[17].

구체적으로 3DGS는 장면을 점이 아닌, 공간적 확산을 가진 가우시안 분포의 프리미티브로 모델링한다. 각 가우시안은 공분산 행렬을 통해 공간 상의 크기, 범위, 방향성을 나타내며, 복잡한 형상을 연속적으로 근사할 수 있다. 렌더링 과정에서는 개별 가우시안이 카메라 공간으로 투영되어 타원 형태의 스플랫으로 화면에 표현되며, 이 과정에서 색상과 투명도는 가중 혼합되어 최종 픽셀 색상을 구성한다. 학습 단계에서는 가우시안의 위치, 크기, 회전, 색상, 투명도 등의 파라미터가 목표 이미지와의 오차 최소화를 위해 엔드투엔드(End-to-End) 방식으로 직접 최적화된다. 이는 복잡한 MLP 신경망을 학습하고 추론해야 하는 NeRF와의 가장 큰 구조적 차이이자, 3DGS의 높은 연산 효율성과 빠른 학습 속도를 가능하게 하는 핵심 요소이다.

3DGS는 NeRF 대비 명확한 기술적 우위를 갖는다. 첫째, 볼륨 렌더링과 샘플링 과정이 제거됨으로써 NeRF 대비 수십에서 수백 배 빠른 실시간 렌더링이 가능하며, 이는 버추얼 프로덕션 촬영 환경에서 요구되는 프레임레이트를 충분히 충족한다. 둘째, 가우시안 파라미터만을 최적화하므로 학습 효율성이 매우 높다. 셋째, 이산적 표현 방식 덕분에 메모리 사용량이 적고 GPU 병렬성에 최적화되어 대규모 장면에서도 안정적인 구동이 가능하다. 마지막으로 시각적 품질 측면에서도 NeRF와 동등하거나 능가하는 결과를 제공하며, 시점 변경 시 발생하는 지오메트리 에일리어싱이나 멀티뷰 미스매치와 같은 아티팩트가 상대적으로 적다는 강점이 있다.

이러한 장점을 바탕으로 3DGS를 언리얼 엔진에 적용하려는 시도는 크게 두 가지 형태로 구분된다. 첫째는 외부 3DGS 렌더러에서 실시간으로 생성한 장면을 언리얼 엔진의 서드파티 형태로 접속하여 인카메라 실시간 렌더링을 제공하는 방식이다. 조셋(Jawset) 사의 포스트샷(postshot)이나 Volinga 사의 볼링가 스윗(Volinga Suite) 등이 대표적이며, 특히 볼링가 스윗은 가우시안 공분산 등을 통해 노멀 정보를 추정하여 3DGS 데이터에 실시간 라이팅 정보를 수정하고 반영할 수 있는 솔루션을 선보이고 있다. 그림 5에 볼링가 스윗을 활용해 언리얼 게임엔진에서 조명 정보를 변환하는 모습이 보인다.

Lighting adjustment in Unreal Engine using Volinga Suite (L) 3DGS-generated data (R) Relit 3DGS scene

둘째는 언리얼 엔진의 커스텀 렌더링 시스템을 활용하여 3차원 가우시안을 엔진 내에서 직접 스플래팅하는 통합 방식이다. 이 방식은 실시간 렌더링 성능을 유지하면서 가우시안 기반 고유의 부드러운 시각적 연속 표현력을 보존하는 것을 목표로 한다. 최근 공개된 깃허브 기반의 3DGS 플러그인들은 언리얼 엔진 내에서 고속 장면 재현이 가능하다는 것을 입증하며, 버추얼 프로덕션 등 실시간 그래픽 환경에서의 3DGS 활용 가능성을 크게 확장하고 있다. 본 논문에서는 이러한 3DGS의 기술적 이점을 활용하여 기존 리얼리티스캔 기반 워크플로우를 개선하고, 고품질의 실시간 버추얼 프로덕션 배경을 구현하는 방안을 제시하고자 한다[18].

Ⅳ. 3DGS를 이용한 VP 배경 제작

본 연구에서는 3DGS의 화질적 우수성을 객관적으로 검증하기 위하여 언리얼 엔진의 ‘시티 샘플(City Sample)’ 프로젝트를 활용한 비교 실험을 먼저 수행하였다. 실험을 위해 해당 샘플 내 특정 경로에서 720p 해상도의 이미지 900장을 추출하여 기준이 되는 원본 이미지를 확보하였다. 이는 실제 촬영 시 발생할 수 있는 센서 노이즈나 환경적 변수를 배제하고, 알고리즘 간의 순수한 재구성 성능을 정밀하게 비교하기 위한 통제된 실험 환경을 구축하기 위함이다. 3DGS의 학습 및 렌더링에는 포스트샷을 활용하였으며, 이를 통해 생성된 결과물을 대조군인 리얼리티스캔 모델링 데이터와 정량적으로 비교 분석하였다.

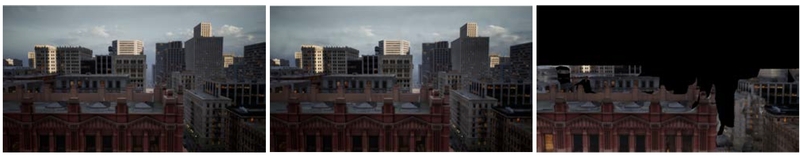

화질 측정의 정확성을 확보하기 위해 전체 900장의 프레임 중 5장 간격으로 총 180장의 이미지를 표본으로 선정하여 정량적 지표를 산출하였다. 측정 결과, 3DGS는 PSNR (Peak Signal-to-Noise Ratio), SSIM(Structural Simil-arity Index Measure), LPIPS(Learned Perceptual Image Patch Similarity) 모든 항목에서 리얼리티스캔 방식보다 우세한 성능을 기록하였으며 표 1에 정리하였다. 이러한 결과는 3DGS가 새로운 시점 합성 기술로서 기존의 메쉬 기반 복원 방식보다 실사에 가까운 재구성 능력을 갖추고 있음을 보여주는 선행 연구들의 결과와 동일하다. 그림 6에는 실험 과정에서 도출된 이미지 예시를 제시하여 시각적 차이를 명시하였다.

Comparison of rendered images in the City Sample (Left) Ground Truth (Middle) 3DGS (Right) RealityScan

분석 과정에서 리얼리티스캔의 정량적 수치가 상대적으로 낮게 나타난 주요 원인 중 하나는 데이터 처리 방식의 차이에 기인한다. 리얼리티스캔은 일정 거리 이상의 원경 지오메트리를 유효한 모델링 범위에서 제외해, 빈 공간으로 처리하는 특성을 지닌다. 이로 인해 원본 이미지와 비교 시 원경 부분에서 데이터 손실이 발생하게 되며, 이는 전체적인 화질 지표 하락의 결정적인 요인으로 작용하였다. 반면 3DGS는 가우시안 분포를 통해 원경의 시각적 정보까지 연속적으로 학습하여 재현하기 때문에, 넓은 범위를 포함하는 장면에서도 시각적 일관성과 충실도를 안정적으로 유지함을 확인할 수 있었다.

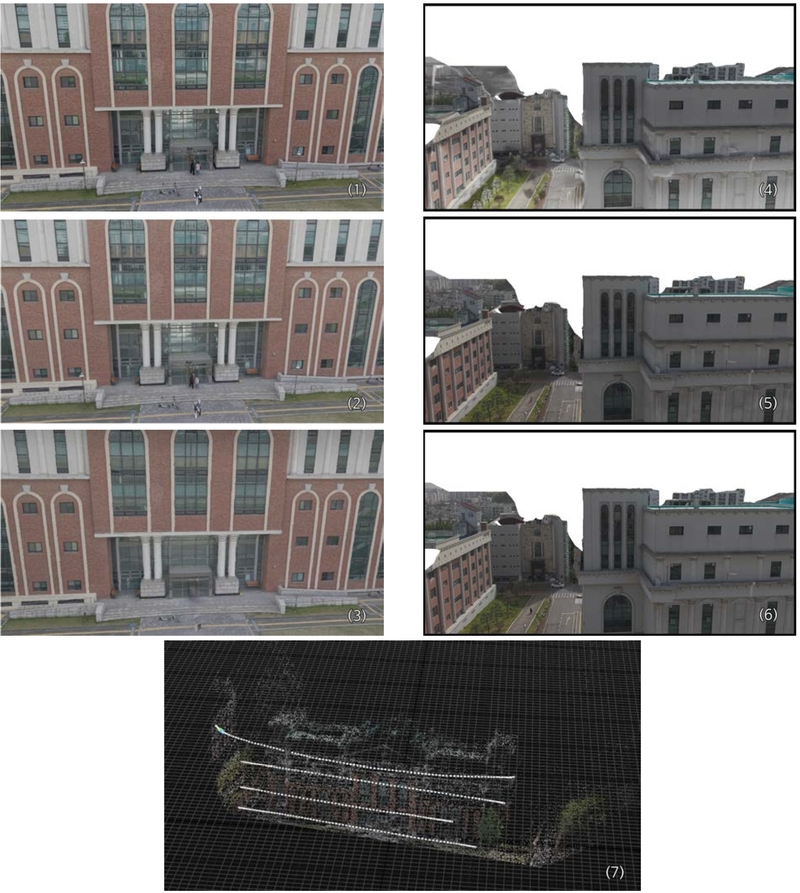

앞선 시티 샘플 실험에서 나타난 리얼리티스캔의 데이터 손실 문제를 보완하고 실무적인 비교를 수행하기 위하여, 두 번째 실험에서는 학교 건물을 대상으로 한 실사 촬영 데이터로 검증을 진행하였다. 실사 획득은 드론을 이용하였다. 본 실험의 핵심은 리얼리티스캔이 재구성하지 못한 빈 공간이 화질 지표에 미치는 편향을 제거하기 위하여, 기하 정보가 생성되지 않은 영역을 원본 실사 이미지 및 3DGS 결과물에 동일하게 마스킹(masking) 처리하여 비교 범위를 유효 영역으로 한정하는 방식을 채택한 것이다.

본 실험을 위해 실제 학교 건물을 다각도에서 촬영한 총 387장의 720p 해상도 이미지를 데이터셋으로 구축하였으며, 이 중 정량적 분석의 객관성을 확보하기 위하여 129장의 프레임을 표본으로 추출하여 지표를 측정하였다. 실험의 전체 결과는 표 2에 정리하였으며, 그림 7에서는 원본 샘플 이미지와 마스킹 처리를 포함한 단계별 비교 과정을 시각적으로 제시하였다. 분석 결과, 3DGS는 리얼리티스캔 대비 PSNR에서 약 3.56dB 높은 수치를 기록하였으며, SSIM과 LPIPS 지표에서도 일관된 우세를 보였다.

Example images used in the school building experiment and the RealityScan experiment scene(1) Example image from the original drone footage of the school building (2) Image processed by 3DGS (3) Image processed by RealityScan (4) Example of the white masked region in RealityScan (5) Example of applying the white mask to the 3DGS image (6) Example of the ground truth image with the white mask applied (7) Experimental scene using RealityScan

세 번째 실험은 실제 콘텐츠 제작 워크플로우를 고려하여 천안 독립기념관의 ‘겨레의 탑’을 실험 대상으로 선정하였다. 겨레의 탑은 국내에서 높은 인지도를 가진 역사적·상징적 구조물로서, 일반 관람객에게 시각적 형태와 공간 구성이 매우 익숙한 대상이다. 이러한 특징은 배경 재현 시 발생할 수 있는 미세한 형태 왜곡이나 색채 이질감을 쉽게 인지하게 하므로, 3DGS 기반 배경 생성의 정확성 및 실사 재현도를 엄격하게 평가하기에 최적의 조건을 갖추고 있다. 촬영은 사전에 공식적인 허가를 득한 후, 관람객의 입장이 시작되기 전 시간대에 통제 요원의 감독하에 안전하게 진행되었다.

데이터 획득 과정에서는 VP 합성을 염두에 두고 자연광 조건을 세밀하게 통제하였다. 강한 직사광선은 구조물 표면에 짙은 그림자를 형성하여 다른 CG 배경과 피사체 간의 조명 불일치나 이질적인 그림자 문제를 야기할 수 있다. 이를 방지하기 위해 구름양이 많아 산란광이 풍부한 흐린 날씨와 이른 아침 시간대를 선택하여 촬영을 수행하였다. 드론을 활용하여 획득한 데이터셋의 예시는 그림 8에 제시하였다.

Drone-based data acquisition at the Tower fo the Nation: Vertical movement and full 360-degree orbital capture

분석 방법은 앞선 실험들과 동일한 절차를 따랐다. 우선 원본 실사 이미지를 기준으로 3DGS 렌더링 영상과 리얼리티스캔 결과물을 1차적으로 비교하였으며, 이후 공정한 평가를 위해 리얼리티스캔에서 모델링되지 않은 빈 공간을 기준으로 동일한 영역을 마스킹 처리하여 2차 정량 측정을 수행하였다. 720p 화질로 358장의 이미지를 활용한 실험 결과 값을 표 3에 정리하였다.

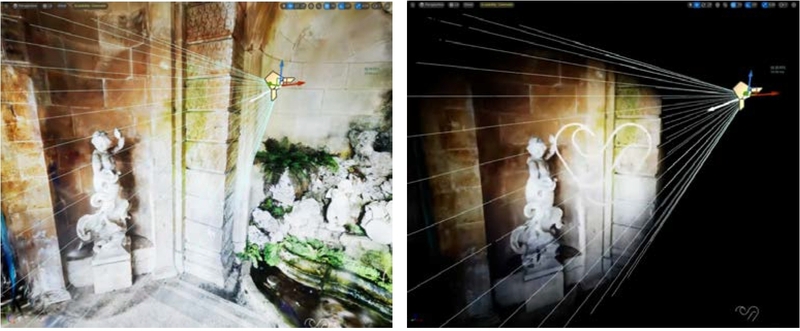

분석의 실무적 효용성을 높이기 위해, 리얼리티스캔 소프트웨어 내에서 그림 9와 같이 관심 영역(ROI)을 설정하고, 해당 영역 이외의 배경을 마스킹 처리하여 정량적 측정을 수행하였다. 이는 배경의 하늘이나 불필요한 노이즈가 수치에 미치는 영향을 배제하고, 핵심 피사체인 구조물의 재현 품질만을 집중적으로 평가하기 위함이다.

실험 결과, 3DGS는 PSNR 39.82dB, SSIM 0.91, LPIPS 0.08이라는 매우 우수한 지표를 기록하였다. 동일한 관심 영역 내에서 측정된 리얼리티스캔의 결과, PSNR 35.20dB, SSIM 0.87, LPIPS 0.16과 비교했을 때, PSNR 기준 약 4.62dB의 유의미한 격차를 보이며 화질적 우위를 입증하는 수치이다. 이는 대형 구조물의 표면 질감과 자연광에 의한 미세한 명암 변화를 3DGS가 훨씬 더 사실적으로 재현하고 있음을 시사하며, 버추얼 프로덕션 배경으로서의 활용 가능성이 매우 높음을 방증한다. 상세한 비교 결과는 표 4에 제시하였다. 최종적으로 VP 활용을 위해 약 5,700장의 이미지를 활용해 3DGS 훈련을 하였고, 언리얼 엔진에서 구현한 장면이 그림 10에 보인다.

Quantitative comparison of the Tower of the Nation within the Region of Interest (ROI) defined in RealityScan

Ⅴ. 결 론

본 연구는 전통적인 3차원 모델링 기반의 VP 배경 제작 방식에서 탈피하여, 실사 촬영 데이터만으로 가상 배경을 신속하게 생성할 수 있는 3DGS의 실무적 활용 방안을 제시하였다. 특히 영화나 드라마 제작을 주도해 온 기존의 2D 기반 촬영 인력이 별도의 고도화된 CG 전문 역량을 보유하지 않고도 직관적으로 접근할 수 있는 제작 파이프라인을 구축하는 데 주안점을 두었다. 이는 기술적 장벽으로 인해 버추얼 프로덕션 도입을 망설였던 실무 현장에 새로운 제작 가능성을 제안했다는 점에서 그 의의가 있다.

실험 결과, 3DGS를 통해 재현된 장면은 에픽게임즈의 리얼리티스캔 기반 결과물과 비교했을 때 표면의 미세한 디테일과 색 재현력 측면에서 우수한 품질을 나타냈다. 그러나 3DGS는 그 구조적 특성상 객체 단위의 개별 편집이나 정교한 조명 재설정, 재질 조정 등 전통적인 3D 그래픽 제작에서 요구되는 세밀한 제어가 어렵다는 문제점은 여전히 남아있다. 이러한 분석 결과는 3DGS가 현 시점의 기술 수준으로는 시네마급 고화질 콘텐츠 제작 공정 전체를 즉각적으로 대체하기에는 다소 미흡한 측면이 있음을 시사한다.

그럼에도 불구하고 3DGS는 빠른 제작 속도와 현장 중심의 공간 재구성, 그리고 실사 기반의 압도적인 사실성을 바탕으로 방송 교양, 뉴스, 탐사 보도와 같은 신속한 제작 환경에서는 충분히 실용적인 대안 기술이 될 수 있음을 확인하였다. 특히 사건·사고 현장의 재구성과 같이 제한된 시간 내에 실용적인 사실성을 확보해야 하는 콘텐츠 영역에서 3DGS의 활용 가치는 매우 높게 평가된다. 최근 뉴스 제작 환경에서 언리얼 엔진의 활용 비중이 지속적으로 증가하고 있다는 점을 고려할 때, 3DGS와 엔진 간의 연동성은 향후 실무적 시너지를 극대화할 수 있는 핵심 요소가 될 것이다.

상업적 소프트웨어의 발전 가능성 또한 고무적이다. 최근 볼링가를 비롯한 전문 개발사들이 3DGS 데이터에 조명 재설정 기능을 부여할 수 있는 기술을 지속적으로 선보이고 있으며, 이는 향후 가우시안 데이터의 조명 반응성과 편집 가능성이 점차 확장될 것임을 예고한다. 이러한 기술적 진보는 3DGS가 지닌 정적인 한계를 극복하고 보다 역동적인 프로덕션 환경으로 진입하는 교두보가 될 것으로 기대된다.

종합적으로 볼 때, 3DGS는 완전한 시네마급 실사 합성을 즉시 실현하기에는 초기 단계에 있으나, 상세 수준(LOD)에 대한 요구가 상대적으로 낮거나 신속한 배경 구축이 최우선인 실무 환경에서는 매우 강력한 실용적 도구로 평가된다. 향후 연구에서는 조명 일관성 확보, 동적 장면의 적용, 그리고 객체 단위의 편집 기능 확장 등 3DGS의 현 실무적 한계를 보완하기 위한 기술적 고도화가 중요한 과제로 다루어져야 할 것이다.

Acknowledgments

This Research was supported by the Korea Nazarene University Research Grants 2025.

References

-

H. Choo, I. Jin, S. Jeong, J. Kim, and K. Kong, “Deep Learning-Based 2.5D Asset Generation Techniques for Virtual Production,” Journal of Broadcast Engineering, Vol.29, No.6, pp.1010-1025, November 2024.

[https://doi.org/10.5909/JBE.2024.29.6.1010]

- N. Kadner, Virtual Production Field Guide, Epic Games, 2021. Available: https://cdn2.unrealengine.com/VP-Field-Guide-Vol-1-and-2.pdf, (accessed Nov. 19, 2025).

- M. Kim, Domestic and Global Virtual Production Studio Construction Trends, KCA Media Issue Trend, 2023. Available: https://www.kca.kr/Media_Issue_Trend/vol47/sub02_04.html, (accessed Nov. 19, 2025).

-

G. Park and S. Cho, “A Study on Music Video Production Using Green Screen-Based Virtual Production,” Journal of the Korea Contents Association, Vol.25, No.5, pp.153-163, May 2025.

[https://doi.org/10.5392/JKCA.2025.25.05.153]

-

B. Kerbl, G. Kopanas, T. Leimkuhler, and G. Drettakis, “3D Gaussian Splatting for Real-Time Radiance Field Rendering,” ACM Transactions on Graphics, Vol.42, No.4, pp.1191-1203, July 2023.

[https://doi.org/10.1145/3592433]

- C. Kim, “Current Status of Film Production Based Game Engine,” Broadcasting and Media, Vol.30, No.1, pp.35-43, January 2025.

-

Lee, D, “Virtual Production and Intensified Visual Effects : Focusing on the Case Analysis of The Mandalorian Series,” Journal of Digital Contents Society, Vol.23, No.7, 1191-1203, July 2022.

[https://doi.org/10.9728/dcs.2022.23.7.1191]

- X. Yu, A Comparative Study on Korean and Chinese Science Fiction : For <Space Sweepers> and <Wandering Earth>, Master’s Thesis of Dankook University, Yongin, South Korea, 2023.

-

B. C. Cho, I. Kim, and B. Jang, “Technological and Human Resource Integration in 3D Scanning-Based Virtual Production: A User Experience Evaluation,” Journal of Broadcast Engineering, Vol.30, No.5, pp.725-734, September 2025.

[https://doi.org/10.5909/JBE.2025.30.5.725]

- J. Yim, Transforming Traditional Spaces into Real-Time Content: Unreal Engine Implementation Cases of K-Heritage, YouTube, Available: https://youtu.be/xTdqaRchwQs?si=SQ-8vzRoWP7nhQfc, (accessed Nov. 15, 2025).

- C. Jung, S. Cho, and B. Park, Domestic and Global Trends and Prospects of Virtual Production, Korean Film Council (KOFIC), pp.26-30, 2023.

-

H. J. Kim, J. Y. Choi, A. R. Oh, and H. K. Jee, “Trends in High-Resolution 3D Data Generation Technologies,” Electronics and Telecommunications Trends, Vol.37, No.3, pp.64-73, June 2022.

[https://doi.org/10.22648/ETRI.2022.J.370307]

-

D. Kim and C. Kim, “Distance Fields Based Point Cloud Enhancing Using Transformer,” Journal of Broadcast Engineering, Vol.29, No.3, pp.321-329, May 2024.

[https://doi.org/10.5909/JBE.2024.29.3.321]

-

B. Mildenhall, P. P. Srinivasan, M. Tancik, J. T. Barron, R. Ramamoorthi, and R. Ng, “NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis,” Communications of the ACM, Vol.65, No.1, pp.99-106, Jan. 2022.

[https://doi.org/10.1145/3503250]

-

T. Muller, A. Evans, C. Schied, and A. Keller, “Instant Neural Graphics Primitives with a Multiresolution Hash Encoding,” ACM Transactions on Graphics, Vol.41, No.4, pp. 1-15, July 2022.

[https://doi.org/10.1145/3528223.3530127]

-

S. Garbin, M. Kowalski, M. Johnson, J. Shotton, and J. Valentin, “FastNeRF: High-Fidelity Neural Rendering at 200 FPS,” Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV), Montreal, Canada, Oct. 2021.

[https://doi.org/10.1109/ICCV48922.2021.01408]

- S. Park, S. Cho, and J. Seo, “Latest Trends and Status of 3D Technologies,” Broadcasting and Media, Vol.30, No.3, pp.11-19, July 2025.

- Gaussian Splatting for Unreal Engine, https://github.com/Italink/GaussianSplattingForUnrealEngine, (accessed Nov. 20, 2025).

- 2008년 8월 : 중앙대학교 첨단영상대학원 공학석사

- 2011년 11월 : 중앙대학교 첨단영상대학원 공학박사

- 2013년 3월 ~ 현재 : 나사렛대학교 방송시각영상디자인학부 부교수

- ORCID : https://orcid.org/0000-0001-9421-8622

- 주관심분야 : 3D Content, VR content, Cinema Technology, Entertainment Technology