XR 환경의 다중 감각 정합성을 위한 UX 설계 전략

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

본 연구는 XR과 AI가 융합된 환경에서 시각·청각·제스처 등 다양한 인간 감각과 물리적 환경, 그리고 시스템이 생성하는 가상 정보환경 간 상호작용 과정에서 발생하는 레이턴시(지연)로 인한 모달 간의 시퀀스 불일치를 사용자 관점에서 해소하여 인지적 혼란을 줄이는 대안을 제시하는 것을 목적으로 한다. 이를 위해 감각 간 정합성 회복을 중심으로 한 사용자 경험 기반 UX 시스템 설계 전략을 개발했다. 특히 단순한 물리적 감각 정합성보다, 맥락적 의미 구성과 예측 가능성에 기반한 인터페이스 설계가 인지 정합성을 보완하고 사용자의 몰입도와 시스템 신뢰성을 높이는 데 더 효과적임을 강조한다. 본 연구는 기술 개발을 위한 선행 전략 연구로서, 내러티브 기반 맥락 정보 제공과 시각 자극의 시간적 암시를 활용한 실시간 대응 전략을 제안하며, 이를 온디바이스 AI 기반 예측 인터페이스를 갖춘 개념 모델로 구체화하였다. 이를 통해 향후 XR-AI 통합 시스템의 인간 중심 UX 설계 기반 마련과 XR 기술의 실질적 상용화에 기여하고자 한다.

Abstract

This study aims to address the cognitive dissonance caused by sequence mismatches resulting from latency in the interaction between multiple human senses—such as vision, hearing, and gestures—the physical environment, and the virtual information environment generated by systems in XR-AI converged contexts. To achieve this, this study propose a user experience (UX)-based system design strategy that focuses on restoring cross-sensory coherence. Rather than prioritizing mere physical sensory alignment, the proposed approach emphasizes contextual meaning construction and predictability, which are shown to more effectively enhance cognitive coherence, user immersion, and system reliability. As a preliminary strategic study for future technology development, the research suggests narrative-based contextual information delivery and temporal cues in visual stimuli as methods to induce emotional responses and facilitate real-time adaptation. These strategies are embodied in a conceptual model featuring an on-device AI-powered predictive interface. The contribution lies in establishing a foundation for human-centered UX design in XR-AI integrated systems and supporting the practical commercialization of XR technologies.

Keywords:

Latency Compensation, Predictive Interface, XR-UX, Human-centered InterfaceⅠ. 서 론

1. 연구 배경

XR 경험 설계에서 인간의 멀티모달(다감각) 간 조율과 균형은 몰입감 있는 경험을 제공하는 측면에서 핵심적이다. 특히 각각의 감각 입출력의 동기화는 실감 경험의 본질적 요소이며, 감각 간 불일치는 몰입을 저해하는 주요 요인으로 작용한다[1]. 또한 몰입환경의 지속성은 사용자가 어지러움 같은 신체적 거부감을 최소화할 때 확보된다. 따라서 XR 환경에서 감각 간의 조율(coherence)과 균형(balance)이 사용자의 인지 기반의 몰입에 미치는 영향을 분석하고 이를 정량적·정성적으로 평가할 수 있는 기준과 모델의 제시가 필요하다. 이러한 모델을 기반으로 XR 설계의 표준화를 추진할 수 있으며, 나아가 XR 기술의 상용화에도 기여할 수 있다. 본 연구는 이를 위한 초기 전략 연구로서 방향성을 제공하는 데 의의가 있다.

2. 연구 목적 및 방법론

본 연구의 목적은 AR-AI 융합 환경에서 발생하는 시각, 청각, 촉각, 신체 움직임 등 다중 감각 자극 간 불일치로 인한 사용자의 인지 혼란을 완화하고, 감각 간 정합성(coherence & balance)을 확보하기 위한 사용자 경험(UX) 설계 전략을 제시하는 데 있다. 특히 XR 기기에서 현실과 가상 간 감각 정보의 시간적·공간적 불일치를 상상 유도, 서사적 맥락 제공, 시각적 UI 암시 등 인지적 보정 메커니즘을 활용해 보완하고자 한다.

또한 온디바이스 AI를 활용하여 사용자 상태를 실시간으로 인식하고, 감각 결핍을 감성적 인터페이스로 보완함으로써 인지 기반 감각 정합 UX 전략을 실증적으로 설계하고 평가하는 기준을 마련하는 것이 주요 목적이다.

이 논문의 방법론은 문헌·이론 분석 → UX 개념 모델링(Conceptual Modeling) → 수식 기반 보정 모델링(Mathematical Adjustment Modeling)을 통해 개념 검증의 네 단계를 거쳐, XR 다중감각 정합 UX 설계 전략을 제시하는 탐색적·개념적 연구 방법론을 적용하였다.

Ⅱ. 가상, 물리 혼합 환경에서의 감각 정합성

1. XR 환경에서의 감각 충돌로 인한 사이버 멀미

XR 환경에서 가장 일반적으로 알려진 사용자 불편 요소 중 하나는 감각 간 불일치(sensory conflict)에서 비롯되는 사이버 멀미(Cyber-sickness)이다[2]. 특히 AR 안경을 통해 현실과 가상이 동시에 지각되는 상황에서, 시각 자극과 신체가 다른 시간에 움직이는 경우 전정기관과 불일치가 발생한다. 이러한 불일치는 뇌의 예측 시스템을 교란하여 사이버 멀미 증후군을 유발한다[3]. 이는 인간의 감각만의 문제가 아닌 인지적 해석의 문제로, 몰입감(presence)과 이질감(uncanniness)의 균형에 영향을 미친다[5]. 일반적 불일치 상황에서 사람의 뇌는 감각 간 100~300ms 오차는 자동으로 합성 보정할 수 있으나[4] 그 이상이 되면 정보 처리 임곗값을 초과하여 멀미 반응이 유발된다.

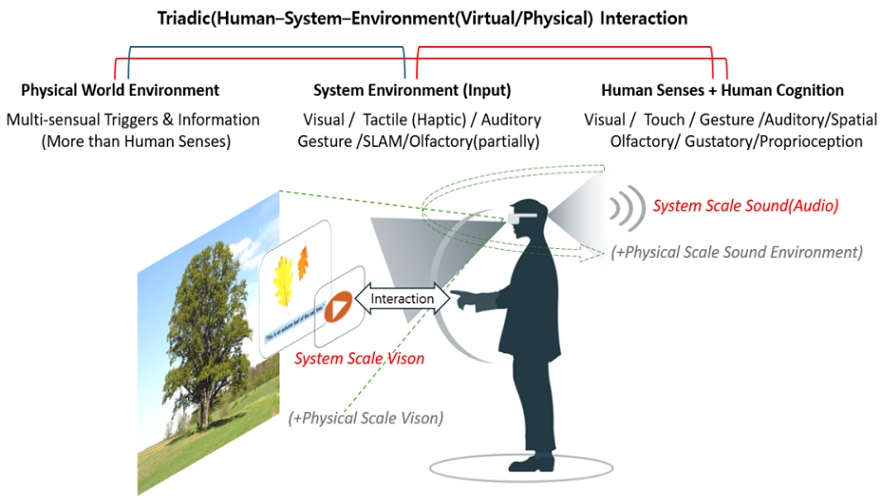

그림 1은 물리적 환경과 시스템이 제공하는 가상 인터페이스상에서의 다중 감각 간, 그리고 시스템이 제공하는 인지 자극 데이터와의 상호작용을 설명하는 그림이다. 기존의 스마트폰과는 달리 삼차원 공간환경에 대한 정보들도 포함되어 모든 오브제와의 다자 간의 상호작용이 운영되고 다양한 감각 기반 상호작용의 정합성이 요구되는 복잡한 상호작용의 환경이다.

2. 감각 정합성과 인지적 조화

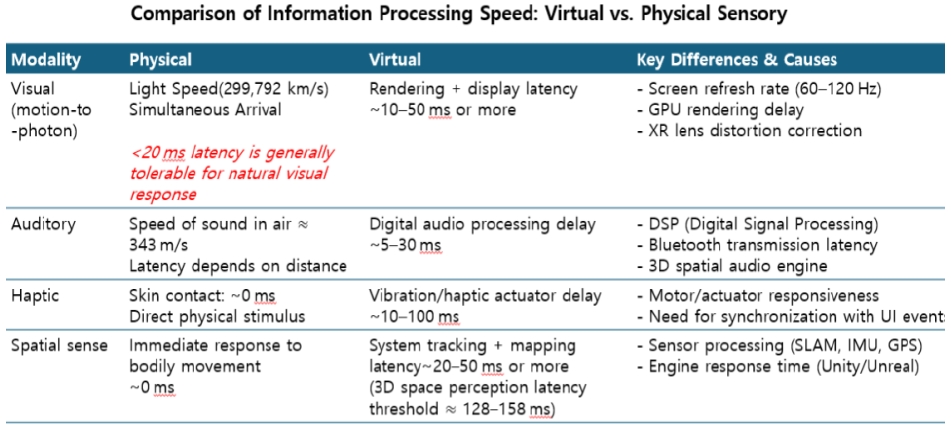

그림 2는 사람이 가진 각 감각에 대한 물리 자극과 가상 자극의 정보 처리 지연(latency)을 비교한 것으로 몰입형 인터페이스 및 XR 환경에서 인간 감각의 정합성(sensory coherence)을 정량적으로 분석한 것으로 시스템의 임곗값과 인간의 신체가 가진 임곗값과의 차이를 보여준다.

물리적 시각(Visual) 자극은 빛의 속도(299,792 km/s)로 거의 실시간 전달되며, 인간은 <20ms 수준의 지연까지는 자연스럽게 수용할 수 있다. 반면, 가상 환경에서는 GPU 렌더링, 디스플레이 출력, 렌즈 왜곡 보정 등의 요소로 인해 10~50ms 이상의 시각 지연이 발생한다[6]. 가상 오디오 사운드나 음악, 대화 음성이 50ms를 초과하는 경우 만족도와 몰입감이 급격히 저하된다[7][8]. 또한 3D 공간음향의 지연 감지 임계치는 약 128~158ms로 보고된다[9].

청각에 비해 촉각(Haptic)은 매우 빠르다. 물리적 촉각은 피부 접촉 시 0ms에 가까운 반응을 보인다. 반면, 가상 햅틱의 경우 진동 모터 또는 액추에이터의 물리 구동 시간과 UI 이벤트 동기화 지연으로 인해 10~100ms의 반응 지연이 발생한다. 특히 공간 내 객체의 위치나 깊이를 분석하는(processing) 과정이 실시간성을 저해하는 경우 사용자는 공간적 혼란이나 인지적 불일치를 경험할 수 있다[10].

XR 시스템 설계 시, 감각별로 허용할 수 있는 지연 임곗값(latency threshold)을 고려한 감각 동기화 및 정합성 유지 전략은 필수적이다. 특히 시각은 20ms, 청각은 50ms, 공간 감각은 50ms 이하의 지연 유지가 몰입형 인터페이스 설계의 핵심 조건이며[11], 이를 초과하면 사용자 경험의 품질은 급격히 저하될 수 있다.

III. 감각-인지 정합 지원 UX 모델

1. 몰입형 콘텐츠 경험에서의 인지 정합성

표 1은 감각-인지 부정합을 유발하는 주요 요인과 이를 기술적 완성도의 문제가 아닌 사용자 수용 측면에서 어떻게 경험하는지를 정리한 것이다. 즉, 기존 연구의 결과를 토대로 사용자가 감각적 불일치로 인해 어지러움과 같은 인지적 혼란과 신체적 불편을 겪는 원인을 정리하였다.

다감각 지각은 단일 감각 자극 이상의 의미를 형성할 수 있는 기술 정합성의 핵심적인 상호작용 요소이다[17]. 그러나 몰입형 기술에 대한 학술적 관심은 꾸준히 증가해 왔음에도 불구하고, 관련 연구의 실증적 결과를 기반으로 한 통합적 분석은 아직 충분히 이루어지지 않았다[18].

XR 환경에서의 지속 가능한 몰입형 사용자 경험(Immersive UX) 설계에서 필요한 개념 중 하나는 ‘존재감(presence)’이다. 존재감은 “비매개(non-mediation)의 환상”으로 정의되며, 사용자가 가상 환경을 현실처럼 받아들이도록 만드는 핵심은 감각 정보 그 자체가 아니라 감각이 자연스럽게 인식되도록 설계되는 데 있다[18]. 따라서 몰입은 단순한 시청각 정보의 제공만으로는 완성되지 않으며, 오히려 인지 구조 내에서의 통합감(coherence)이 결정한다.

인지불일치의 주요 원인은 사용자에게 제시되는 감각 정보 간 불일치에 기인한다[19]. 이러한 정합성 문제를 해결하기 위한 대안으로 시각 기반 감각 대체 설계가 이미 활용되고 있다. 예를 들어, 촉각 피드백이 결여된 상황에서도 시각적 은유(visual metaphor)를 적용함으로써 촉각 자극을 성공적으로 대체할 수 있으며[20], 이는 사용자의 인지 체계를 만족시키는 기술적 설계 방법으로 기능한다.

실시간 반응성은 AR 인터페이스의 몰입성과 상호작용 감각을 유지하는 데 필수적이다[21]. 그러나 감각이 완전히 일치하지 않더라도, 인지 구조가 연속성과 의미를 부여한다면 사용자는 가상 세계 몰입감을 유지할 수 있다[22]. 이는 실제 감각 자체보다 인지적으로 정합된 인터페이스 흐름과 내러티브 구조가 사용자 경험에서 더 중요한 역할을 수행할 수 있음을 뒷받침한다.

2. AI-예측 기반 사용자 몰입감 유도 인터페이스

인지적 관점에서 사용자의 상상을 유도하는 인터페이스에 관한 연구는 최근의 주제가 아니다[23]. 비록 기술적 정합성이 완전하지 않아 감각 자극 간 일치가 불완전하더라도, 사용자가 예측 가능한 방식으로 상호작용 신호와 인터페이스가 제공하는 정보를 해석할 수 있을 때 인지적 정합성(cognitive coherence)은 확보될 수 있다. 이러한 설계를 실현하기 위해서는 온디바이스 AI 기반의 실시간 인터페이스 조정 기술이 핵심적으로 요구된다. 예를 들어, 애플의 Vision Pro는 정합성을 높이기 위해 예측 기반 시나리오를 적용하여 시각 레이턴시를 약 11ms까지 낮춘 바 있다. 또한 시선 데이터만으로 사용자의 선택 의도(selection intention)를 실시간으로 예측하는 Bayesian 기반 ML 모델을 제안한 연구에서는 높은 정확도(정확도 0.97, F1 0.96)를 달성한 사례가 있다[24].

따라서 XR 콘텐츠의 몰입도는 인지 예측성, 감성 몰입 등 인간 중심의 총체적 설계 요소를 기반으로 한 전략적 기술 개발과 적용을 통해 강화될 수 있다. 결국 사용자는 실제 감각 정보 자체보다 인지적으로 해석된 감각 정합성을 바탕으로 몰입 여부를 결정하게 된다.

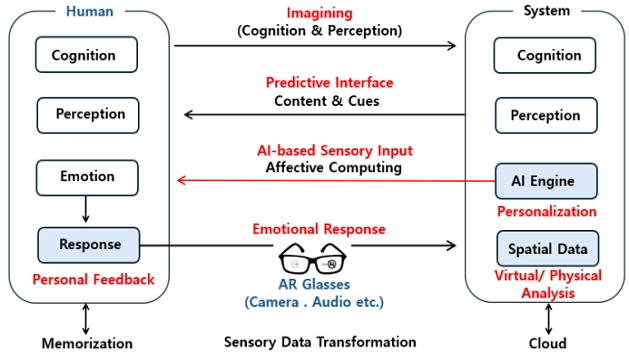

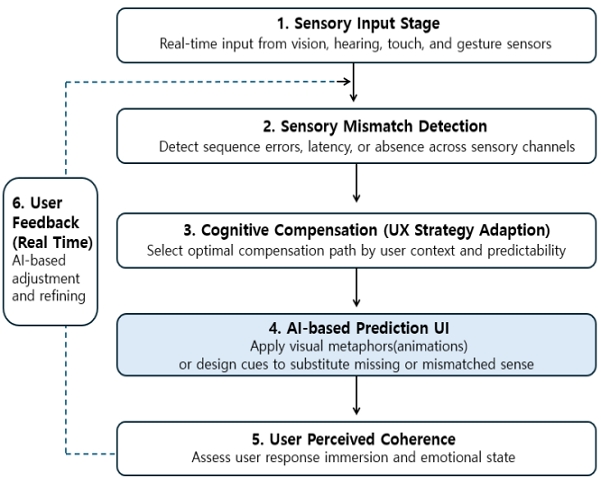

그림 4는 본 연구에서 제안하는 ‘감각-인지 정합 지원 UX 모델’이다. 지연(latency) 및 감각 간 비 동기화를 보완하는 설계 대응 전략구조[25]는 감각 손실이나 오차가 발생해도 사용자의 몰입 유지를 가능케 하는 핵심 설계 방식을 응용한 것이다.

본 연구의 ‘감각-인지 정합 지원 UX 모델’은 XR과 같이 물리 세계와 가상 세계가 공존하는 확장 현실 환경에서, 사용자의 감각적 입력과 인지적 해석 간의 상호작용을 AI 기반 실시간 조정 메커니즘을 통해 지원한다.

이를 통해 감각 불일치를 인간의 감성 기반 인지를 통해 보완하고, 사용자가 어지럼증을 유발하지 않는 임곗값 내에서 몰입 경험을 유지할 수 있도록 의도적인 지연을 유발하도록 설계되었다. 본 모델은 사용자(Human)와 시스템(System)의 상호작용 관계를 중심으로 구성되며, 각 인지적·지각적 프로세스의 연동 방식을 시각적으로 구조화하였다.

사용자 측면에서는 ‘Cognition(인지)–Perception(지각)–Emotion(감성)’으로 이어지는 일련의 인지 처리 흐름이 작동한다. 사용자는 시스템으로부터 감각 정보를 수용하는 동시에, 자신의 감각 기억과 예측과 같은 인지 작용을 통해 이를 해석한다. 해석된 정보는 지각 과정을 거쳐 감정 상태와 몰입 수준을 결정한다. 이러한 인지–지각–감성의 흐름은 단순한 수동적 반응에 그치지 않고, 실시간으로 시스템에 영향을 미치는 정보 및 피드백 신호로 작용한다.

사용자 측면에서는 ‘Cognition(인지)–Perception(지각)–Emotion(감성)’으로 이어지는 일련의 인지 처리 흐름이 작동한다. 사용자는 시스템으로부터 감각 정보를 입력받는 동시에, 자신의 감각 기억과 예측과 같은 인지 과정을 통해 이를 해석한다.

해석된 정보는 지각 단계를 거쳐 감정 상태와 몰입 수준을 결정한다. 이러한 인지–지각–감성의 흐름은 단순한 수동적 반응이 아니라, 실시간으로 시스템에 영향을 주는 정보 및 피드백으로 기능한다.

본 연구가 제안하는 시스템은 사용자에게 감각 정보(Sensory Input)를 제공하고, 사용자는 인지적 예측(Cognitive Imagination)을 통해 보완하거나 정서적 반응(Emotional Response)으로 소통한다. 이러한 반응은 다시 시스템에 의해 분석되어 콘텐츠 조정 또는 인터페이스 재설정에 반영된다. 그림 4는 그림 3의 구조를 기반으로, 솔루션 중심의 단계를 구체화한 것으로, 본 연구에서 도출한 예측 기반 상호작용 시스템의 요구사항을 시각적으로 보여준다.

3. XR 사용자 경험을 위한 보정 수식

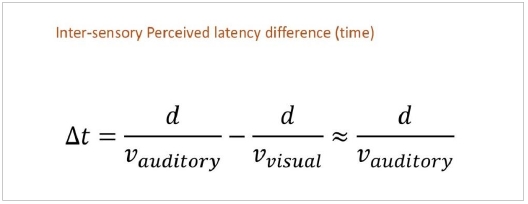

다음은 시각과 청각 간 지연 불일치를 보정하기 위한 XR UX 인터페이스 모델을 추론하는 과정을 나타낸다. 청각 입력은 디지털 신호 처리(DSP) 및 전송 과정에서 일반적으로 5~30ms의 지연이 발생하는 반면, 시각 입력은 거의 실시간으로 처리된다. 이러한 속도 차이는 인지적 불일치를 유발하여 사용자의 몰입도를 저하시킬 수 있다.

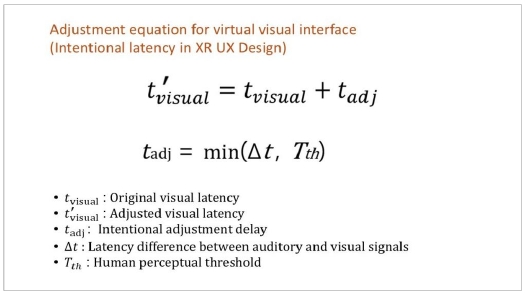

이를 해결하기 위해 본 연구에서는 시각 신호에 의도적 ‘지연(𝑡𝑎𝑑𝑗)’을 삽입하여 ‘조정된 시각 인터페이스 효과’를 추가하여 청각 입력과 지연시간을 줄여주면서 정렬되도록 설계하였다. 그림 6에서 보이는 것처럼 여기에서 보정 값은 실제 지연량(Δ𝑡)과 사용자가 수용 가능한 임곗값(𝑇𝑡h) 중 작은 값을 선택하여 산출된다.

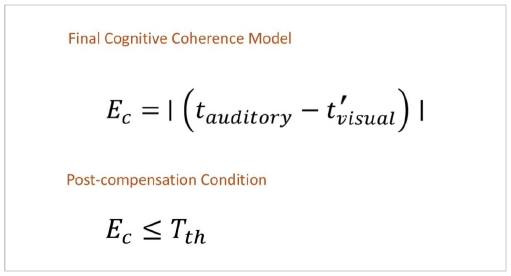

최종적으로 사용자가 지각하는 정합성의 불일치(𝐸𝑐)는 그림 7의 조건을 만족한다.

이를 통해 최종적으로 사용자가 체감하는 인지적 불일치(𝐸𝑐)는 사용자가 수용 가능한 임곗값(𝑇𝑡h) 이하로 유지하여 만족감을 높이고 몰입 환경을 제공한다.

결과적으로 본 모델은 감각 정보의 결핍이나 불일치 상황에서도 사용자가 정합성을 체감하도록 유도하는 사용자 중심 설계 전략을 제시한다. 이는 단순한 감각 정보의 전달을 넘어, 감정과 인지적 예측을 통합하는 사용자 경험 설계 방식을 제공한다. 또한 본 모델은 AI가 단순 기술이 아니라 UX 설계 패러다임 전환하는 것을 가능하게 해 주는 도구로서 기반한다.

Ⅳ. 결 론

본 연구는 인간이 경험하는 감각 불일치를 정합하기 위해 감각과 뇌 간의 인지적 타협 과정에 주목하였다. 이를 바탕으로 AR-AI 융합 환경에서 발생하는 감각 간 불일치 문제를 해결하기 위한 전략적 접근으로서 감각–인지 정합 UX 프레임워크를 제안하였다. 특히 인지를 통한 감각 보완 메커니즘에 기반한 ‘AI 기반 ‘전환 유도 인터페이스’(AI–based Attentional Redirection UI)’를 도입하여, 다감각 환경에서의 인지적 보정 가능성을 개념 모델로 제안하였다.

제안된 프레임워크는 기존 감각 충돌 이론과 몰입형 인터페이스 설계의 선행 연구를 토대로, 예측 중심, 맥락 기반, 정서 적응형 UX 전략을 핵심 요소로 한다. 또한 기술적 제약으로 인해 감각 자극 간 동기화가 어려운 상황에서, UX 측면에서 의도된 정서적 접근을 통한 의도된 지연을 통해 정합성을 유지하는 설계 전략이 될 수 있다. 또한 XR 기반의 인터페이스 기술에서는 사용자의 인지적 조건과 니즈에 기반한 기술 설계가 핵심 기술 과제임을 강조함으로써 사람 중심의 기술 개발 전략을 지향하고, 인간–AI 기반 기계 상호작용(Human-AI based Machine Interaction, HAMI) 환경에서 감각-인지 기반 UX 전략을 수립하기 위한 이론적·실천적 기초를 제공한다.

본 연구는 후속 연구로서 현재 전략을 반영하여 설계된 프로토타입을 실제 사용자들을 대상으로 테스트 진행 중이며 테스트 결과를 반영하여 부족한 연구의 실증성을 보완할 예정이다.

References

-

M. Slater and M. V. Sanchez‑Vives, “Enhancing our lives with immersive virtual reality,” Frontiers in Robotics and AI, vol. 3, p. 74, 2016.

[https://doi.org/10.3389/frobt.2016.00074]

-

A. R. Allred, A. R. Gopinath, and T. K. Clark, “Validating sensory conflict theory and mitigating motion sickness in humans with galvanic vestibular stimulation,” Communications Engineering, vol. 4, p. 78, 2025.

[https://doi.org/10.1038/s44172-025-00417-2]

- J. T. Reason and J. J. Brand, Motion Sickness, Academic Press, 1975.

- B. E. Stein and M. A. Meredith, The Merging of the Senses, MIT Press, 1993.

-

M. Slater and S. Wilbur, “A framework for immersive virtual environments (FIVE): Speculations on the role of presence in virtual environments,” Presence: Teleoperators and Virtual Environments, vol. 6, no. 6, pp. 603–616, 1997.

[https://doi.org/10.1162/pres.1997.6.6.603]

-

M. Warburton et al., “Measuring motion-to-photon latency for sensorimotor experiments with virtual reality systems,” Behavior Research Methods, vol. 55, pp. 3658–3678, 2023.

[https://doi.org/10.3758/s13428-022-01983-5]

- S. M. LaValle, Virtual Reality, Cambridge University Press, 2020.

-

A. Schmid et al., “Measuring the just noticeable difference for audio latency,” in Proc. 19th Int. Audio Mostly Conf. (AM '24), ACM, New York, NY, USA, pp. 325–331, 2024.

[https://doi.org/10.1145/3678299.3678331]

- T. Bolkart et al., “Perceptual thresholds in 3D spatial audio rendering,” ACM Transactions on Applied Perception, vol. 20, no. 1, 2023.

- M. Mine et al., “Latency and perception in VR: Design strategies,” in Proc. IEEE Virtual Reality Conf., 2019.

-

R. Tachibana and K. Matsumiya, “Accuracy and precision of visual and auditory stimulus presentation in virtual reality in Python 2 and 3 environments for human behavior research,” Behavior Research Methods, vol. 54, no. 2, pp. 729–751, 2022.

[https://doi.org/10.3758/s13428-021-01663-w]

-

D. M. Hoffman, A. R. Girshick, K. Akeley, and M. S. Banks, “Vergence–accommodation conflicts hinder visual performance and cause visual fatigue,” Journal of Vision, vol. 8, no. 3, p. 33, 2008.

[https://doi.org/10.1167/8.3.33]

-

J. J. LaViola, “A discussion of cybersickness in virtual environments,” ACM SIGCHI Bulletin, vol. 32, no. 1, pp. 47–56, 2000.

[https://doi.org/10.1145/333329.333344]

- R. Rzayev and J. Steuer, “Lighting discrepancy in AR: A predictor of presence?,” IEEE Trans. Visual. Comput. Graphics, vol. 27, no. 11, pp. 4334–4343, 2021.

- H. Fujimoto and N. Kawai, “Multisensory conflict in AR and its effect on discomfort: Temporal synchrony as a key factor,” Int. J. Human–Computer Interaction, vol. 34, no. 11, pp. 1059–1068, 2018.

- K. M. Stanney, K. S. Hale, I. Nahmens, and R. S. Kennedy, “What to expect from immersive training: Physiological and perceptual responses to virtual environments,” Ergonomics, vol. 46, no. 6, pp. 528–549, 2003.

-

C. Spence, “Senses of place: Architectural design for the multisensory mind,” Cogn. Res. Princ. Implic., vol. 5, no. 1, p. 46, 2020.

[https://doi.org/10.1186/s41235-020-00243-4]

-

A. Suh and J. Prophet, “The state of immersive technology research: A literature analysis,” Computers in Human Behavior, 2018.

[https://doi.org/10.1016/j.chb.2018.04.019]

-

M. Slater and S. Wilbur, “A framework for immersive virtual environments (FIVE): Speculations on the role of presence in virtual environments,” Presence: Teleoperators and Virtual Environments, vol. 6, no. 6, pp. 603–616, 1997.

[https://doi.org/10.1162/pres.1997.6.6.603]

-

W. T. Schuemie et al., “Research on presence in virtual reality: A survey,” CyberPsychol. Behav., vol. 4, no. 2, pp. 183–201, 2002.

[https://doi.org/10.1089/109493101300117884]

- B. Eberhardt, H. Bubb, and M. Sabbagh, “Visual metaphors for haptic substitution in automotive UX design,” Procedia CIRP, vol. 50, pp. 461–466, 2016.

-

M. Billinghurst, A. Clark, and G. Lee, “A survey of augmented reality,” Found. Trends Hum.–Comput. Interact., vol. 8, no. 2–3, pp. 73–272, 2015.

[https://doi.org/10.1561/1100000049]

-

M. Gonzalez-Franco and J. Lanier, “Model of illusions and virtual embodiment,” Front. Psychol., vol. 8, p. 1125, 2017.

[https://doi.org/10.3389/fpsyg.2017.01125]

- T Jo, HJ Lee, S Chun, IK Lee, “Predicting Selection Intention in Real-Time with Bayesian-based ML Model in Unimodal Gaze Interaction”, arXiv preprint arXiv:2411.06726, , 2024

-

C. Sas and R. Chopra, “MeditAid: A wearable adaptive neurofeedback-based system for training mindfulness state,” Personal Ubiquitous Comput., vol. 19, no. 7, pp. 1169–1182, 2015.

[https://doi.org/10.1007/s00779-015-0870-z]

- 2005년 : University of London, Goldsmiths College, Research Fellow

- 2013년 : Brunel Univ. (UK), School of Design & Engineering, Design Innovation & Strategy 전공 (Ph.D)

- 2013년 ~ 2016년 : Hunan Univ. China 디자인학부 조교수

- 2016년 9월 ~ 현재 : 홍익대학교 (세종) 디자인컨버전스학부 부교수

- ORCID : https://orcid.org/0000-0002-7717-2412

- 주관심분야 : UX Research, Human-centered Design, HCI