디지털 장소성 구현을 위한 포토그래메트리-라이다 융합 3D 스캔 파이프라인 연구

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

본 연구는 Edward Relph의 장소성 이론과 Zook 및 Graham의 코드화된 공간 개념을 적용하여 물리적 공간의 문화적 정체성을 디지털 환경으로 재현하는 포토그래메트리-라이다 융합 3D 스캔 파이프라인을 구축하였다. 방송·미디어 특화 교육기관 캠퍼스를 대상으로 한 실증 연구에서 4단계 데이터 융합 프로세스를 통해 단독 방식 대비 수준별 인식률 26% 포인트, 포인트 정밀도 15∼18% 포인트 향상을 달성하였다. 또한, QEM 기반 최적화를 통해 원본 대비 5% 폴리곤으로 축소하면서도 평균 프레임률 183% 향상을 보였다. 본 연구에서 제안한 파이프라인은 인문학적 장소성 이론을 디지털 환경에 적용한 학제간 접근법으로서, 실감형 콘텐츠 제작에서 인문학적 가치와 기술적 효율성을 동시에 추구하는 새로운 방향성을 제시한다.

Abstract

This study establishes a photogrammetry-LiDAR fusion 3D scanning pipeline for reproducing the cultural identity of physical spaces in digital environments, applying Edward Relph's theory of placeness and Zook and Graham's concept of coded space. An empirical study targeting the campus of a broadcasting and media specialized educational institution achieved significant improvements through a four-stage data fusion process: level-based recognition rates increased by 26 percentage points and point precision improved by 15∼18 percentage points compared to individual methods. Additionally, QEM-based optimization demonstrated a 183% improvement in average frame rate while reducing polygon count to 5% of the original. The proposed pipeline represents an interdisciplinary approach that applies humanistic theories of placeness to digital environments, presenting a novel direction that simultaneously pursues humanistic value and technical efficiency in immersive content production.

Keywords:

Digital Placeness, 3D Scan Asset, Photogrammetry-LiDAR Fusion, LOD Optimization, Immersive ContentⅠ. 서 론

실감형 콘텐츠 제작 기술과 함께 3D 스캐닝(3D Scanning) 기술은 디지털 복원, 문화유산 기록, 게임 개발, 시각효과(VFX), 가상현실(VR), 증강현실(AR) 등 다양한 산업 분야에서 핵심적인 데이터 획득 및 3D 모델링 도구로 확산되고 있다[1].

3D 스캐닝 기술은 4K 이상의 고화질과 정밀도를 바탕으로 실제 세계의 사물을 디지털 공간으로 복원함으로써, 창의적인 아이디어 구현을 가능하게 한다. 이러한 기술은 가상현실과 증강현실 기술과 같은 몰입형 기술(Immersive Technologies)과 융합하여 사용자에게 몰입감과 상호작용성을 제공하며 새로운 경험을 선사하기도 한다[2][3].

특히 3D 스캐닝 기술은 수작업 기반의 전통적인 3D 모델링 대비 시간과 비용을 절감하면서도 높은 정밀도와 사실감을 제공함으로써, 실감형 콘텐츠 제작에서 콘텐츠의 몰입감과 품질 개선을 동시에 실현할 수 있다[4].

그러나 3D 스캐닝을 통해 획득된 데이터는 대용량의 고해상도 정보를 포함하고 있다. 이러한 기술적 특성은 실시간 환경에서 GPU 부하, 프레임 저하, 데이터 병목 현상 등을 유발할 수 있으며, 전체 워크플로우의 안정성과 효율성을 저해하는 주요 요인으로 지적된다[5].

최근, Nerf(Neural radiance Fields) 기술과 Gaussian Splatting 기술이 주목받고 있지만 고품질 UHD 방송 제작 환경에 실질적으로 적용하기에는 한계가 있다[6][7].

본 연구의 목적은 포토그래메트리(Photogrammetry)와 라이다(LiDAR) 융합 기반 3D 스캔 데이터의 정합 성능 향상을 통해 ‘디지털 장소성(Digital Placeness)’ 구현을 위한 기술적 프레임 워크를 제시하고, 이를 바탕으로 실감형 콘텐츠 제작에 적용 가능한 최적화 파이프라인을 개발하는 것이다. 이를 위해 2장에서는 관련 기술과 ‘장소성(Placeness)’ 이론에 대한 선행 연구를 검토하고 이론적 분석 틀을 구축하며, 이어지는 3장에서는 포토그래메트리-라이다 융합 워크플로우 및 에셋 전처리 과정에 대해 설명한다. 4장에서는 최적화 실험과 성능 평가 결과를 바탕으로 LOD(Level of Detail) 제어 전략의 효과를 분석하고, 마지막으로 5장에서는 연구의 종합적 시사점과 한계, 향후 과제를 논의한다.

II. 선행 연구 분석 및 이론적 프레임 워크

1. 배경 에셋 최적화 기술의 한계와 이론적 검토

3D 스캐닝 기술은 물리적 공간을 고정밀 디지털 자산으로 변환하는 핵심 기술로, 특히 실감형 콘텐츠 제작 분야에서 현실감 있는 ‘디지털 장소성’ 구현을 위한 필수적 도구로 주목받고 있다. 단 몇 번의 스캐닝을 통해서 물리적 공간의 형상 정보를 쉽고 정확하게 취득할 수 있게 해 주는 혁신적인 기술이기 때문이다[8].

3D 스캐닝 기술은 스캐닝 방법에 따라 고정식(Stationary), 이동식(Mobile), 접촉식(Contact)과 비접촉식(Non-Contact) 3D 스캐닝으로 구분할 수 있다[9]. 접촉식 3D 스캐닝은 탐촉자로 불리는 프루브(Probe)로 물체에 직접 닿게 해서 측정을 하는 방식이다.

비접촉식 3D 스캐닝은 기본 방식으로 장거리, 단거리, 중·단거리 비접촉식 3D 스캐닝 방식으로 분류한다. 장거리 비접촉식 3D 스캔 방식은 레이저 방식 3D 스캐닝 측정 방식으로는 TOF(Time of Flight) 방식, 위상 변이(Phase-shift) 방식, 온라인 웨이브폼 분석(Online Waveform Analysis) 방식이 있다. TOF 방식 스캐너의 핵심 기술은 레이저 거리 측정기(Laser Range Finder)라고 불리는 레이저를 물체 표면에 조사하여, 그 빛이 돌아오는 시간을 측정해서, 물체와 측정 원점 사이의 거리를 구하는 기술로 토목 측정이나, 건물 등 대형물 측정에 많이 활용된다. 단거리 비접촉식 3D 스캐닝은 첫째, 광 삼각법(Laser Triangulation) 방식을 사용하는 레이저 방식, 둘째, 백색광, 변조광 방식을 사용하는 광학 방식, 셋째, 휴대용 실시간(Handheld Real Time) 방식, 넷째, 패턴 투사(Pattern Projection) 방식과 라인 스캐닝(Line Scanning) 방식이 있다. 중·단거리 비접촉식 3D 스캐닝으로 고고학(Archaeology), 엔터테인먼트 산업과 지리 정보 시스템(Geographic information system)에 적용 가능한 포토그래메트리 측량 방식과 실시간 방식으로 키넥트 융합(Kinect Convergence) 방식이 있다[10,11,12]. 디지털 장소성 구현을 위한 기술적 접근법으로서, 최근 NeRF와 3D Gaussian Splatting 기술이 주목받고 있다. 특히 Gaussian Splatting은 NeRF의 고질적인 실시간 처리 문제를 극복하기 위한 대안으로 개발된 기술로, 훈련된 장면의 이미지 샘플을 바탕으로 즉각적인 렌더링이 가능하다는 점에서 실시간성 측면에서 NeRF보다 현저히 우수한 성능을 보인다. 즉, NeRF는 희소한 입력 이미지로부터 연속적이고 입체감 있는 장면을 고품질로 합성할 수 있는 기술로, 연산량 측면에서 다층 퍼셉트론(MLP: Multi-Layer Perceptron)을 수백 번 쿼리해야 하는 복잡한 구조를 갖는다[13][14]. 이로 인해 30 FPS 이상의 실시간 렌더링을 요구하는 방송 제작 환경에서는 처리 지연 문제가 발생할 수밖에 없다[15][16].

반면, 3D Gaussian Splatting은 실시간 렌더링에 있어 획기적인 성능을 보이나, 완전한 3D 메시 기반이 아닌 점에서 호환성 및 라이팅 등 환경 설정의 한계가 존재하며, 특히 재조명(Re-Lighting) 기능의 제약이 실용화를 저해하는 요소로 지적된다. 그러나 최근에는 Gaussian 기반 재조명 기법에 대한 연구가 활발히 진행되고 있어, 이러한 제약은 점진적으로 해소될 가능성이 있다[17][18]. 그러나 여전히 UHD 방송 수준의 고품질 실시간 렌더링, 다중 카메라 연동, 방송 표준 부합 등 실제 방송 현장의 요구 조건을 충족하기에는 기술적 성숙도가 미비하다는 평가가 지배적이다. 이러한 기술적 한계를 해결하기 위해 포토그래메트리와 라이다의 상호 보완적 특성을 활용한 융합 방식이 주목받고 있다. 특히 포토그래메트리의 시각적 정보와 라이다의 구조적 정확성을 결합함으로써 디지털 장소성 구현에 필요한 정합 성능 향상이 기대된다. 따라서 본 연구는 이러한 융합 방식의 정합 성능을 실증적으로 검증하고자 한다.

2. 3D 스캔 에셋 최적화 기술의 실제 적용 사례 분석

3D 스캐닝 기술은 물리적 공간의 문화적·역사적 맥락을 디지털 환경으로 전이시키는 핵심 기술로, 문화유산 복원, 게임 제작, 시각효과(VFX), 건축 시뮬레이션 등 다양한 분야에서 디지털 장소성 구현의 기반이 되고 있다. 대표적인 해외 사례로는 고대 이집트 스핑크스 조각상의 복원 프로젝트가 있으며, 이는 포토그래메트리 방식과 라이다 스캐닝 방식을 융합하여 고해상도 3D 모델을 구현한 대표적 사례로 기록된다[19][20]. 또한, 2019년 화재 피해를 입은 노트르담 대성당의 복원 프로젝트는 3D 스캐닝 기술의 문화유산 보존 분야 적용에서 중요한 이정표가 되었다. 고딕 건축의 상징이자 프랑스 파리의 문화적 정체성을 대표하는 노트르담 대성당은 빅토르 위고의 소설 『노트르담의 꼽추』를 비롯한 다양한 문화예술 작품의 영감의 원천이 되어 왔다. 복원 과정에서 레이저 스캐닝을 통해 획득된 3D 포인트 클라우드 데이터(3D Point Cloud Data)는 정밀한 구조 분석과 손상 부위 파악을 가능하게 하였으며, 이를 기반으로 원형에 가까운 복원 계획이 수립되었다[21]. 3D 스캐닝 기술은 또한 글로벌 시각효과 및 영화 산업에서도 중요한 역할을 수행하고 있다. 특히 헐리우드의 시각효과 분야에서는 실제 공간 스캔 데이터를 활용하여 고해상도 디지털 세트를 구성하고 있으며, 이는 몰입도 높은 시각적 경험을 제공하는 데 필수적인 기술로 자리매김하고 있다. 영역 스캔 및 라인 스캔 형식의 카메라 배치와 구성을 활용한 3D 스캐닝 기술과 데이터 처리기술은 아바타 II(Avatar : The Way of Water), 혹성탈출 IV : 새로운 시대(Kingdom of the Planet of the Apes)와 같이 불쾌한 골짜기(Uncanny Valley)를 해소하고 4DX 관람이 가능한 블록버스터(Blockbuster)의 발전을 촉발시키고 있다[22].

국내 대표적인 제작 사례로는 서울의 대표적인 역사 문화 장소인 청계천 일대를 초고화질 3D 스캐닝 기술을 활용하여 디지털 아카이브(Digital Archive)를 구축한 바 있다. 즉, 청계천 지형 기반의 3D 스캐닝 기술을 활용한 디지털 아카이브 사업은 건축물, 문화재 등을 정밀하게 기록함으로써 청계천의 역사와 문화를 보존하고 활성화하는 데 기여하고 있다[23]. 이러한 사례들은 3D 스캐닝 기술이 단순한 형상 복제를 넘어 공간에 내재된 문화적 정체성을 디지털 환경으로 전이시키는 디지털 장소성 구현의 핵심 수단임을 시사한다.

3. 디지털 장소성 구현을 위한 이론적 프레임 워크

장소성은 단순히 지리적 좌표나 물리적 위치를 의미하는 것이 아니라, 인간의 기억, 경험, 문화와 정체성이 축적된 장소(Place)를 의미한다. 이는 디지털 환경에서도 동일하게 적용될 수 있으며, 특히 몰입형 가상 공간 구현에서는 기술적 표현 이상의 사회적·감각적 맥락을 동반하는 장소 구현이 요구된다. 이러한 장소 개념에 대해, 많은 이론가들이 장소성과 비 장소성(Non-Placeness)의 특성을 다른 관점에서 정의한 바 있다. 다음 표 1은 디지털 장소성의 개념적 정의와 함의를 중심으로 학자들의 논의를 비교 분석한 것이다. 이러한 논의는 3D 스캐닝 기반 실감 콘텐츠 제작은 단순한 형상 복원이 아닌, 기억, 경험과 정체성이 투영된 장소성 구현의 매개 과정임을 시사한다. 가령, UHD 방송 스튜디오, 종합 촬영 스튜디오, 그리고 K-POP 공연홀로 구성되어 있는 동아방송예술대학교 캠퍼스는 방송예술 교육의 역사적 맥락과 창작 활동의 기억이 축적된 장소적 정체성을 보유한다. 이러한 장소성 요소의 디지털 전이를 위해서는 공간에 내재된 의미와 감성적 경험을 보존하는 기술적 정합성이 요구된다.

이를 바탕으로 본 연구는 Edward Relph의 장소성 이론에서 제시된 ‘내재적 장소성(Authentic Placeness)’과 Zook 및 Graham의 ‘코드화된 공간(Coded Space)’ 개념을 디지털 환경에 적용하여 기술적 정합성을 다음의 세 가지 핵심 요소로 정의한다. 첫째, 물리적 공간의 3D 구조와 형태가 디지털 공간에서 정확히 재현되는 정도, 측정 오차 범위, 포인트 클라우드 밀도, 메시 정밀도 등으로 평가될 수 있는 기하학적 정합성(Geometric Consistency)이다. 둘째, 실제 공간의 색상, 질감, 조명 조건이 디지털 환경에서 사실적으로 표현되는 정도, 텍스처 해상도, 색상 정확도, 광학적 특성 재현성으로 측정될 수 있는 시각적 정합성(Visual Consistency)이다. 셋째, 언리얼 엔진(Unreal Engine)과 리얼리티 캡처(Reality Capture) 등 제작 플랫폼과의 호환성, 다중 방송 카메라를 활용한 UHD 제작 환경 대응력을 포함하는 플랫폼 정합성(Platform Consistency)이다. 이는 Relph의 장소-인간 감성적 결속 개념을 디지털 공간에서 재현하고, Zook 및 Graham의 공간 정보 코드화 방법론을 3D 스캐닝 데이터 처리 과정에 적용하여 기술적 구현과 감성적 경험을 디지털 구현 맥락에서 통합한 것이다.

제3장에서는 Relph의 장소성 이론에서 제시된 ‘장소 정체성(Place Identity)’ 보존 원칙과 Zook 및 Graham의 공간 데이터 코드화 방법론을 적용하여 3D 스캐닝 기반 배경 에셋 제작과 최적화 처리 과정을 구체적으로 논의한다.

Ⅲ. 3D 스캐닝 기반 배경 에셋 제작 및 최적화(경량화) 처리 과정

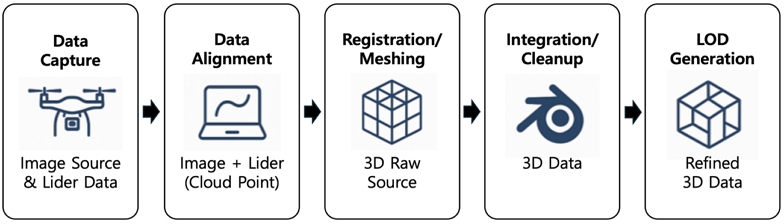

본 연구에서는 디지털 장소성 구현을 위한 3D 에셋 제작방법론으로서 포토그래메트리와 라이다 기반 융합 스캐닝 기법을 통해 재해석하고, 이를 바탕으로 고품질 3D 배경 에셋 제작 과정을 제시한다. 특히 데이터 획득부터 최종 출력까지의 전체 파이프라인을 통해 실제 공간의 문화적 맥락과 감성적 요소를 보존하면서 실시간 렌더링이 가능한 최적화된 3D 에셋 제작 과정을 제시하였다.

1. 데이터 수집 및 전처리

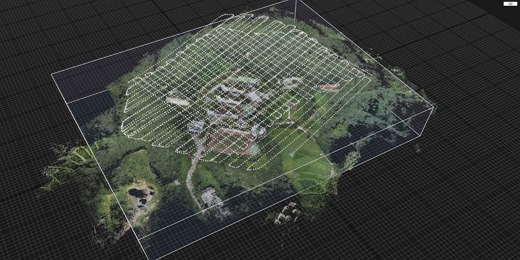

Relph의 장소성 이론에서 강조하는 ‘장소의 물리적 환경(Physical Setting)’과 ‘활동(Activities)’, ‘의미(Meanings)’를 디지털 공간에 전이하기 위한 기초 데이터 수집 과정을 제시한다. 특히 Zook 및 Graham의 공간 정보 코드화 방법론에 따라 공간의 문화적 정체성과 물리적 특성을 정량적 데이터로 변환하기 위해 드론 기반 항공 촬영을 통한 이미지 및 라이다 데이터 수집 전략을 수립하였다. 데이터 수집 대상 공간은 동아방송예술대학교 캠퍼스 전체로 설정하여 방송예술 특성화 교육 기관의 고유한 공간적 특성을 반영하였다. 수집 장비로는 DJI Matrice 350 RT 드론에 Zenmuse P1 45MP 카메라와 Zenmuse L2 라이다 센서를 장착하여 정밀한 3D 공간 정보와 고해상도 이미지 데이터를 동시에 수집하였다. 수집 결과 총 4,000장의 항공 이미지와 1.2억 개의 라이다 기반의 포인트 클라우드 데이터를 획득하여 캠퍼스 전체 공간의 고밀도 3D 정보를 확보하였다. 본 연구에서는 디지털 장소성 구현을 위해 대상 공간의 구성 요소를 세 가지 범주로 분류하고 각각에 적합한 데이터 수집 방식을 적용하였다. 물리적 환경 요소는 포토그래메트리를 통해 색상과 텍스처 정보를 추출하였으며, 공간 구조 요소는 라이다 측정으로 기하학적 형상을 기록하였다. 마지막으로, 시각적 의미 요소는 텍스처 보존 기법을 통해 사용자 경험을 디지털 환경으로 전이하였다.

2. 데이터 정합 및 공간 해석

디지털 장소성 구현을 위한 3D 에셋 제작에서는 수집된 원본 데이터의 정확한 공간 정합이 필수적이다. 포토그래메트리와 라이다 데이터는 각각 고유한 장단점을 가지고 있어 단독 사용 시 한계가 존재한다. 포토그래메트리는 풍부한 색상 정보와 텍스처를 제공하나 그림자 영역이나 저조도 환경에서 정확도가 낮고, 라이다는 정밀한 기하학적 정보를 확보할 수 있으나 색상 정보가 부족하다는 한계가 있다. 이러한 상호 보완적 특성을 활용하여 본 연구에서는 두 데이터의 융합을 통한 통합 포인트 클라우드 생성 방법론을 제안한다. 본 연구에서는 포토그래메트리와 라이다 데이터의 효과적인 융합을 위해 4단계 정합 프로세스를 개발하여 적용하였다. 각 단계별 상세 과정은 다음과 같다.

첫째, RTK-GPS 기반 12개 기준점을 통해 포토그래메트리와 라이다 데이터의 좌표계를 통일하였다. 둘째, ICP(Iterative Closest Point) 알고리즘을 활용한 정밀 정합을 통해 평균 오차 ±2.3cm, RMSE(Root Mean Square Error) 1.8cm의 기하학적 정확성을 달성하였다.

셋째, 영역별 적응적 가중치(그림자 영역 라이다 0.8, 고텍스처 영역 포토그래메트리 0.7)를 적용하여 데이터 신뢰도를 향상시켰다. 넷째, SOR(Statistical Outlier Removal) 필터를 통해 전체 포인트의 3.2%에 해당하는 노이즈(Noise)를 제거하여 데이터 품질을 확보하였다.

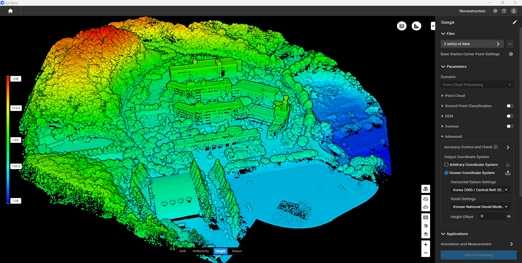

그림 2와 그림 3에 제시된 바와 같이, 상기 4단계 프로세스를 통해 이미지 기반 조밀 재구성(Dense Reconstruction)결과와 라이다 스캐닝 결과가 도출되었으며, 두 결과는 상호보완적으로 활용되었다. Relph의 ‘감각적 경험(Sensory Experience)1)’ 이론을 3D 스캔 데이터 품질 평가에 적용하기 위해 포토그래메트리의 색상 정확도와 텍스처 해상도를 시각적 정합성의 정량적 지표로 설정하였다.

또한, Zook 및 Graham의 디지털 공간 결합 방식을 LOD 최적화 과정에 적용하여 거리별 계층적 구조화를 통한 기하학적 정합성 관리 체계를 구축하였다. 이를 바탕으로 ICP 알고리즘 기반 정밀 정합(평균 오차 ±2.3cm)과 고해상도 텍스처 보존을 통해 디지털 장소성의 삼차원적 정합성을 확보하였다.

3. 3D 메시 생성 및 텍스처링 전략

정합된 포인트 클라우드 데이터를 기반으로 디지털 장소성 구현에 필요한 3D 메시 생성 및 텍스처링 과정을 구축하였다. 공간의 물리적 구조와 시각적 특성을 정확히 재현하기 위해 UDIM(U-Dimension Tile Mapping) 기반의 텍스처 맵 구성과 실시간 렌더링 호환성을 고려한 최적화 전략을 적용하였다. 또한 실시간 렌더링의 효율성 극대화를 위하여 디퓨즈 맵(Diffuse Map)을 중심으로 한 텍스처링 기법을 활용하였다. 향후 디지털 장소성의 시각적 사실감을 한층 강화하기 위해서는 노멀 맵(Normal Map), 환경 음영 맵(Ambient Occlusion Map), 러프니스 맵(Roughness map), 변위 맵(Displacement Map) 등의 멀티 맵 소스를 기반으로 한 물리적 속성 기반 렌더링(PBR: Physically Based Rendering) 기법의 도입이 요구된다. 이는 시각적 정합성 고도화와 플랫폼 정합성을 동시에 달성하는 전략이다.

Ⅳ. 에셋 최적화 및 파이프라인 구축을 위한 성능 분석

1. 정합 성능 분석

본 장에서는 2.3절에서 정의한 디지털 장소성 구현을 위한 정합성 기준을 바탕으로, 포토그래메트리 단독 방식 대비 융합 방식의 성능 우수성을 실증적으로 검증하였다. 특히 기하학적 정합성과 시각적 정합성 측면에서의 정량적 성능 비교를 통해 디지털 장소성 구현에 적합한 데이터 융합 방법론의 타당성을 입증하고자 한다. 본 연구의 실험은 동아방송예술대학교 캠퍼스 5개 구역이며, 2024년 8월부터 10월까지 월 간 1회차 테스트 측정, 2회차 본 측정, 3회차 추가 측정을 실시하여 데이터의 일관성을 검증하였다.

측정 장비는 DJI Matrice 350 RTK, Zenmuse P1(45MP), Zenmuse L2 라이다를 사용하였고, 데이터 처리는 AMD Ryzen 9 5950X, RTX 4090 환경에서 리얼리티 캡처와 클라우드 컴페어(Cloud Compare)로 수행하였다. 수준별 인식률은 구역별 20개 검증 평면 대비 ±5cm 이내 포인트 비율로, 포인트 정밀도는 RTK-GPS 기준 모델 대비 RMSE로 측정하였다. 주요 비교 지표는 수준별 인식률(Level Recognition Rate)과 포인트 정밀도(Point Accuracy)로 설정하였다. 이 두 지표는 각각 3D 재구성된 디지털 공간의 구조적 식별률과 기준 평면 대비 포인트의 기하학적 일치 정도를 반영한다. 단차 인식률은 기준 구조물 평면에 대해 ±5cm 이내의 편차를 유지하는 포인트 비율로 정의하였으며, 포인트 정렬도는 클라우드 컴페어의 점-평면 거리(Point-to-Plane Distance) 기능을 활용하여 산출하였다. 모든 측정 공간에서 포토그래메트리-라이다 융합 방식은 포토그래메트리 단독 방식 대비 수준별 최소 26% 포인트의 인식률 향상을 나타냈다. 이는 라이다 기반 깊이 정보가 기하학적 정합성 확보에 유의미하게 기여함을 의미하며, 특히 구조적 복잡성이 높은 환경에서 정합성의 핵심 요소인 3D 구조 식별 정확도가 향상되었음을 검증한다. 또한, 포인트 정밀도 역시 포토그래메트리와 라이다 융합 방식에서 평균적으로 약 15~18% 포인트 개선된 것으로 나타났다. 이는 라이다의 고정밀 거리 측정 기능이 포토그래메트리 기반 포인트 클라우드의 왜곡 및 노이즈를 효과적으로 보완함을 입증한다. 특히 그림자, 반복 패턴, 텍스처 부족 등 이미지 정합이 취약한 조건에서도 라이다 데이터는 구조 보정 효과를 제공함으로써 정합 품질 향상에 기여할 수 있다. 그러나 두 센서 기반 데이터 간의 정합성이 완전하지 않을 경우 특정 영역에서 노이즈가 잔존할 수 있으며, 이를 보정하기 위한 후처리 과정에서는 상당한 리소스와 시간이 요구되는 기술적 한계도 있다. 포토그래메트리와 라이다 융합 방식은 단순 시각화 목적을 넘어 정량적 정합 성능 향상, 기하학적 정확도 확보, 복잡 구조 해상도 증대 측면에서 현저한 이점을 제공할 수 있다. 이는 향후 디지털 장소성 구현 및 버추얼 프로덕션(Virtual Production)용 3D 배경 구축 분야에서 중요한 기술적 함의를 지닌다. 특히 실시간 렌더링 품질 유지와 에셋 신뢰도 확보를 위한 핵심 전략으로 활용될 수 있을 것으로 기대된다.

2. LOD 최적화 성능 분석

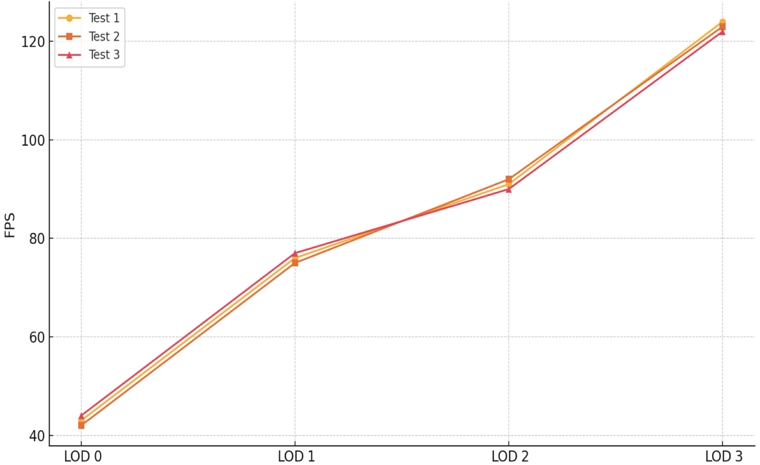

디지털 장소성 구현을 위한 3D 에셋의 실시간 활용 가능성 검증을 위해 Zook 및 Graham의 디지털 공간 결합 방식을 LOD 최적화에 적용하고 성능 개선 효과를 정량적으로 분석하였다. 이를 위해 QEM(Quadric Error Metrics) 기반 메시 간소화 알고리즘의 에지 붕괴(Edge Collapse) 기법을 적용하여, 대학 본관 모델(LOD 0, 500만 폴리곤)을 기준으로 LOD 1(50%), LOD 2(20%), LOD 3(5%)의 총 4단계 LOD를 자동 축소 방식으로 생성하였다. 표 3은 각 단계별 모델에 대해 평가한 결과를 제시하였다. 그러나 정밀한 LOD 구현을 위해서는 단순 자동 축소에 그치지 않고, 메시 라인을 원형 구조에 맞게 재배치한 뒤 폴리곤을 축소하는 방식이 요구된다. 이러한 접근은 시점 거리에 따른 적응적 렌더링을 가능하게 함으로써, 실시간 성능을 확보하면서도 디지털 장소성의 시각적 품질을 유지하기 위한 핵심 전략이라 할 수 있다. 시각적 품질 평가 결과, LOD 1의 경우 원본 대비 50% 폴리곤 감소에도 불구하고 주요 구조적 특징과 장소적 정체성이 효과적으로 유지되었음을 나타낸다. LOD 2는 중거리 관찰에서 양호한 장소 인식이 가능한 수준이며, LOD 3은 원거리 렌더링에서 기본적인 장소 식별이 가능한 최소 임계값을 나타낸다.

3. 실시간 렌더링 성능 분석

디지털 장소성 구현을 위한 3D 에셋의 실용성을 검증하기 위해 언리얼 엔진 5.3 환경에서 LOD별 렌더링 성능을 측정하였다. 표 3에서 비교한 LOD 0을 기준으로 각 LOD 단계별 GPU 활용률과 프레임률(Frame Rate)을 각 LOD 레벨별 3회 반복 측정을 통해 데이터의 일관성을 확보하였다. 다음 표 4는 제시된 LOD 수준별 프레임률 측정 결과를 기반으로 한 실험 결과 분석을 보여준다. 본 실험은 RTX 4090 GPU 환경에서 LOD 수준에 따른 프레임률 변화를 측정하여, 메시 단순화가 실시간 렌더링 성능에 미치는 영향을 정량적으로 검증하였다. 그림 5는 LOD 수준별 실시간 성능지표의 변화를 나타낸 것이다. 측정 데이터 분석 결과, LOD 0 대비 LOD 3에서 평균 프레임률은 약 183% 향상되었다. 이는 LOD 구조상 폴리곤 수 500만개에서 250만개의 감소에 따른 렌더링 부하 경감의 결과로 해석된다. 즉, 성능 대비 품질 효율성 분석에서 LOD 0을 원본으로 간주한 기준 하에, LOD 1이 76%의 성능 향상을 달성하면서도 시각적 품질 저하를 최소화하는 최적 균형점으로 도출되었다. 그러나 본 연구에서는 LOD 0을 후처리를 거치지 않은 데이터로 설정하였다. 일반적으로 LOD 0은 원본 대비 정제된 데이터로 간주되므로, 이를 기준으로 성능을 평가할 경우 향상도가 과대 평가될 가능성이 있다. 이는 Zook 및 Graham의 코드화된 공간 개념의 계층적 구조화 원리를 구현한 결과로서, 디지털 공간의 정보 체계화가 기술적 효율성과 감성적 경험을 동시에 확보할 수 있음을 시사한다. 그러나 QEM 기반 자동 메시 단순화 과정에서는 디지털 장소성 구현에 중요한 미세 구조의 표현 한계와 공간의 특징적 윤곽 손실 문제가 확인되었다. 이는 단순한 폴리곤 수 감소를 넘어 공간의 고유한 정체성을 보존하는 최적화 전략이 요구됨을 시사한다.

4. 성능 분석을 통한 최적화 전략

디지털 장소성 구현에서 중요한 공간적 요소를 보존하기 위해 다음과 같은 최적화 전략을 수립하였다. 첫째, 거리 기반 LOD 전환 임계값(0-50m: LOD 0, 50-150m: LOD 1, 150-300m: LOD 2, 300m 이상: LOD 3)과 장소성 중요도 기반 가중치(핵심 공간 1.5, 일반 공간 1.0, 외부 공간 0.7)를 적용한 적응적 시스템을 구현하였다. 특히 사용자 시점과 공간의 문화적 중요도를 고려한 적응적 LOD 전환 알고리즘을 통해 렌더링 효율성과 장소성 재현 간의 균형을 달성하였다.

둘째, 향후 디지털 장소성 구현의 품질 향상을 위해 노멀 맵 베이킹(Normal Map Baking), 가림 처리 최적화(Occlusion Culling), 재질 인스턴싱(Material Instancing) 등의 고급 렌더링 기법 적용 방안을 제시하였다. 특히 AI(Artificial Intelligence) 기반 자동 메시 재구성(Automatic Retopology) 기술과 스트리밍 기반 지오메트리 관리 시스템의 도입을 통해 대규모 디지털 공간의 실시간 처리 성능 향상의 가능성을 제시하였다.

셋째, Relph의 ‘내재적 장소성’ 원칙과 Zook 및 Graham의 코드화된 공간 개념을 적용한 3D 에셋 최적화 파이프라인을 통해 실제 공간의 문화적 맥락과 물리적 특성을 디지털 환경으로 전이할 수 있음을 실증하였다. 이를 통해 장소와 인간의 감성적 결속을 기술적으로 재현하고, 공간 정보 체계화 방법론을 LOD 기반 최적화에 적용하여 이론과 실무의 통합 가능성을 확인하였다. 특히 포토그래메트리와 라이다 융합 기법을 활용한 데이터 수집부터 LOD 기반 최적화까지의 전체 과정을 통해 실시간 렌더링 환경에서의 실용성을 확보하면서도 공간의 고유한 특성을 보존하는 방법론을 제시하였다. 이러한 결과는 방송 제작, 버추얼 프로덕션, 디지털 트윈(Digital Twin) 등 다양한 실감형 콘텐츠 제작 분야에서 활용 가능한 기술적 기반을 제공할 것이다.

Ⅴ. 결 론

본 연구는 Edward Relph의 장소성 이론과 Zook 및 Graham의 코드화된 공간 개념을 디지털 설계 관점에서 재해석하고, 디지털 장소성을 구현하기 위한 3D 스캔 에셋 최적화 전략을 제시하였다. 연구 결과를 다음과 같이 요약할 수 있다. 첫째, 기술적 정합성 측면에서 동아방송예술대학교 캠퍼스를 대상으로 한 실증 연구를 통해 포토그래메트리와 라이다 융합 기법의 효과를 검증하였다. 특히 단독 방식에 비해 수준별 인식률 26% 포인트, 포인트 정밀도 15~18% 포인트의 향상을 달성하여 디지털 공간 구현의 기하학적 정확성을 확보하였다. 둘째, QEM 기반 LOD 최적화를 통해 원본 대비 약 5% 수준으로 폴리곤 수를 효과적으로 축소하였다. 또한, 정확하게 맵핑 된 텍스처와 후처리 기법을 병행하여 시각적 품질을 유지하면서도 평균 프레임률을 183% 향상시켜, 실시간 렌더링 환경에서의 실용성과 기술적 타당성을 입증하였다.

셋째, 삼차원적 정합성 기준을 정의하고 이를 적용함으로써 Relph의 내재적 장소성과 Zook 및 Graham의 코드화된 공간 개념을 기술적으로 구현하였다. 이는 디지털 장소성이 단순한 기술적 복원이 아니라, 공간의 의미와 정체성을 디지털 코드로 번역하는 과정임을 시사한다.

본 연구는 단일 대학 캠퍼스를 대상으로 한 제한적 사례 연구라는 한계를 지닌다. 향후 연구에서는 첫째, AI 기반 자동 메시 재구성을 통한 대규모 디지털 공간 처리 성능 향상, 둘째, 사용자 경험 기반 디지털 장소성 평가 지표의 개발과 실증적 검증, 셋째, 생성형 AI 기반 메타버스 환경에서의 인터랙션 설계와 공간 경험 최적화, 그리고 넷째, 역사적 장소 적용을 통한 장소성 보존과 재구성 가능성 탐구가 필요하다. 본 연구에서 제안한 3D 스캔 에셋 최적화 전략은 인문학적 함의와 기술적 가치를 통합함으로써, 실감형 콘텐츠 제작 분야에 새로운 방향성을 제시한다.

Notes

References

-

K. Choromański, J. Łobodecki, K. Puchała, W. Ostrowski, “Development Of Virtual Reality Application For Cultural Heritage Visualization From Multi-Source 3D Data”, The International Archives of the Photogrammetry Remote Sensing and Spatial Information Sciences, Vol. XLII-2/W9, pp.264-266, 2019. (accessed on May 21, 2024)

[https://doi.org/10.5194/isprs-archives-XLII-2-W9-261-2019]

- P. Milgram, F. Kishino, “A taxonomy of mixed reality visual displays,” IEICE Transactions on Information Systems, E77-D(12), p.1321, 1994. (accessed on May 22, 2024)

-

T. Kohler, J. Fueller, K. Matzler, D. Stieger, J. Fuller, “Co-creation in Virtual Worlds: The Design of The User Experience”, MIS Quarterly, Vol. 35, No. 3, pp.773-788, Sep. 2011. (accessed on May 23, 2024)

[https://doi.org/10.2307/23042808]

-

R. Grande, et al., “Performance Evaluation and Optimization of 3D Models from Low-Cost 3D Scanning Technologies for Virtual Reality and Metaverse E-Commerce”, Appl. Sci., Vol.14, 2024. (accessed on May 23, 2025)

[https://doi.org/10.3390/app14146037]

-

L. Zhang, H. Wang, and M. Chen, “A real 3D scene rendering optimization method based on region of interest and viewing frustum prediction in virtual reality,” Int. J. Digital Earth, Vol. 15, no. 1, pp. 1089-1108, 2022. (accessed on May 28, 2025)

[https://doi.org/10.1080/17538947.2022.2080878]

-

A. Yu, V. Ye, M. Tancik, and A. Kanazawa, “pixelNeRF: Neural radiance fields from one or few images,” in Proc. IEEE/CVF Conf. Comput. Vis. Pattern Recognit. (CVPR), pp.4578-4587, 2021. (accessed on Jun 21, 2025)

[https://doi.org/10.1109/CVPR46437.2021.00455]

-

B. Kerbl, G. Kopanas, T. Leimkühler, and G. Drettakis, “3D Gaussian splatting for real-time radiance field rendering,” ACM Trans. Graph., Vol. 42, No. 4, pp.1-14, Jul. 2023. (accessed on Jun 22, 2025)

[https://doi.org/10.1145/3592433]

- OQTON, https://www.3dscanning.co.kr/3dscanners, (accessed on May 24, 2024)

-

T. Tóth, J. Živčák, “A Comparison of the Outputs of 3D Scanners”, Procedia Engineering, Vol.69, pp.393–401, 2014. (accessed on Jun 7, 2024)

[https://doi.org/10.1016/j.proeng.2014.03.004]

- PROTOTECH, https://www.prototech.co.kr:40007/product/3d_scanners/scanning_method1.asp, (accessed on May 24, 2024)

- 3D SYSTEMS, https://ko.3dsystems.com/3d-scanner/scanner-guide, (accessed on May 24, 2024)

- Artec 3D, https://www.artec3d.com/ko, (accessed on May 24, 2024)

-

B. Mildenhall, P. P. Srinivasan, M. Tancik, J. T. Barron, R. Ramamoorthi, and R. Ng, “NeRF: Representing scenes as neural radiance fields for view synthesis,” in Proc. Eur. Conf. Comput. Vis. (ECCV), pp. 405–421, 2020. (accessed on Jun 22, 2025)

[https://doi.org/10.1007/978-3-030-58452-8_24]

-

P. Hedman, P. P. Srinivasan, B. Mildenhall, J. T. Barron, and P. Debevec, “Baking neural radiance fields for real-time view synthesis,” in Proc. IEEE/CVF Int. Conf. Comput. Vis. (ICCV), pp.5875–5884, 2021.(accessed on Jun 23, 2025)

[https://doi.org/10.1109/ICCV48922.2021.00582]

-

J. T. Barron, B. Mildenhall, M. Tancik, P. Hedman, R. Martin-Brualla, and P. P. Srinivasan, “Mip-NeRF: A multiscale representation for anti-aliasing neural radiance fields,” in Proc. IEEE/CVF Int. Conf. Comput. Vis. (ICCV), pp.5855–5864, 2021. (accessed on Jun 24, 2025)

[https://doi.org/10.1109/ICCV48922.2021.00580]

-

T. Müller, A. Evans, C. Schied, and A. Keller, “Instant neural graphics primitives with a multiresolution hash encoding,” ACM Trans. Graph., Vol.41, No.4, pp.1–15, Jul. 2022. (accessed on Jun 21, 2025)

[https://doi.org/10.1145/3528223.3530127]

-

B. Kerbl, G. Kopanas, T. Leimkühler, and G. Drettakis, “3D Gaussian splatting for real-time radiance field rendering,” ACM Trans. Graph.,Vol. 42, No. 4, Article 102, pp.1–15, Jul. 2023. (accessed on Jun 22, 2025)

[https://doi.org/10.1145/3592433]

-

Y. Chen, R. Wang, and L. Zhang, “Performance evaluation and optimization of 3D Gaussian splatting in indoor scene generation and rendering,” ISPRS Int. J. Geo-Inf., Vol.14, No.1, Article 21, 2025. (accessed on Jun 22, 2025)

[https://doi.org/10.3390/ijgi14010021]

-

N.J. Shih, P. H. Diao and Y. Chen, “ARTS, an AR Tourism System, for the Integration of 3D Scanning and Smartphone AR in Cultural Heritage Tourism and Pedagogy”, Sensors, Vol.19, No.17, pp.1-3, 2019. (accessed on May 21, 2024)

[https://doi.org/10.3390/s19173725]

-

A. T. Hassan, D. Fritsch, Integration of Laser Scanning and Photogrammetry in 3D/4D Cultural Heritage Preservation – A Review, International Journal of Applied Science and Technology, Vol. 9, No. 4, pp.81-83, 2019. (accessed on May 19, 2024)

[https://doi.org/10.30845/ijast.v9n4p9]

- Can 3D Data Save Notre Dame Cathedral? https://www.3dsystems.com/blog/2019/2019-04/can-3d-data-save-notre-dame-cathedral, (accessed on May 19, 2024)

- Emergent vision technologies, https://www.emergentvisiontec.com/ko/case-study-3d-scanni, (accessed on May 24, 2024)

- Sewoon District in Seoul/3DSCAN DATA, https://www.youtube.com/watch?v=ShJebFGNoDg, (accessed on May 21, 2025)

- Relph, E., Place and Placelessness, London: Pion, pp.143-156, 1976.

- Lefebvre, H., The Production of Space. Oxford: Blackwell, pp.38-42, 1991.

- Augé, M., Non-Places: Introduction to an Anthropology of Supermodernity, London: Verso. pp.143-156, 1995.

-

Zook, M., Graham, M., “Mapping DigiPlace: geocoded Internet data and the representation of place”, Environment and Planning B: Planning and Design, Vol.34, pp.466-482, 2007. (accessed on Jun 27, 2025)

[https://doi.org/10.1068/b3311]

- 2004년 : 광운대학교 전자공학과 공학박사

- 2019년 : 고려대학교 영상문화학과 문학박사

- 2002년 ~ 현재 : 동아방송예술대학교 콘텐츠학부 교수

- 2019년 ~ 현재 : 한국방송·미디어공학회 상임이사

- 2022년 ~ 현재 : 메타버스미래포럼 콘텐츠 분과위원장

- ORCID : https://orcid.org/0000-0002-4552-1534

- 주관심분야 : Technology Policy, Technical Aesthetics, Art & Technology, XR, AI Ethics

- 2020년 : 서울과학기술대학교 방송통신정책전공 정책학박사

- 1991년 ~ 2022년 : KBS 영상제작국 총감독

- 2023년 ~ 현재 : 동아방송예술대학교 콘텐츠학부 교수

- ORCID : https://orcid.org/0009-0002-5791-3954

- 주관심분야 : Advanced Video Production, Aerial & Stabilization Technologies: Drone and Gimbal Studio and Outside Broadcasting Production Systems, Artificial Intelligence in Media Creation

- 1998년 : 한양대학교 기계공학과 학사

- 2000년 ~ 2005년 : 현대 데이터넷

- 2005년 ~ 2008년 : 스토리지밸리

- 2008년 ~ 2010년 : IMA

- 2011년 ~ 현재 : 쓰리디스튜디오모아

- ORCID : https://orcid.org/0009-0001-3047-0500

- 주관심분야 : 3D Scanning and Photogrammetry, Virtual Production and Digital Asset Optimization, Immersive Content and Digital Place-Making