참여자의 콘텐츠 인지 몰입을 위한 키넥트 센서 기반의 실감형 콘텐츠 설계 방법에 관한 연구 : 사용자의 실시간 행동 데이터를 이용한 전시 기획 구현

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

본 연구는 키넥트 센서를 활용해 참여자의 실시간 행동 데이터를 반영, 사회적 메시지를 효과적으로 전달하는 실감형 콘텐츠 설계 방법을 제안한다. 이를 위해 ‘유희-비판 전환(Play-to-Critique Transition)’ 프레임워크를 개발, 참여자를 유희적 참여에서 비판적 인식으로 점진적으로 전환시킨다. ‘감시 사회’를 주제로 한 인터랙티브 전시를 설계하고, 40명을 대상으로 파일럿 연구를 진행한 결과, 본 프레임워크가 정서적 몰입과 메시지 이해도를 유의미하게 향상시켰음을 통계적으로 입증하였다. 해외 전시 사례와의 비교 분석을 통해 사회적 서사를 다루는 실감형 콘텐츠의 디자인 패턴으로서의 활용 가능성을 확인하였다. 결과적으로 본 연구는 스마트 시티, 교육, 엔터테인먼트 등 다양한 분야로의 확장 가능성을 제안하며, 지속 가능한 실감형 콘텐츠 설계의 이론적·방법론적 토대를 제시한다.

Abstract

This study introduces a design methodology for immersive content that delivers social/public messages through real-time interaction. It utilizes a Kinect sensor for the real-time data processing of user behavior, which drives interactive, real-time rendering. The core ‘Play-to-Critique Transition’ framework shifts participants from playful engagement to critique awareness. A pilot study statistically verified this approach enhances emotional immersion and message comprehension. This research provides a foundation for sustainable design, with potential applications in smart cities, education, and entertainment.

Keywords:

Kinect sensors, Real-time technology, Interaction design, Immersive media, Exhibition spaceⅠ. 서 론

최근 실감형 콘텐츠는 가상과 현실의 경계를 허물며 가상의 요소를 실제처럼 경험하게 하는 공간 확장 미디어로 주목받고 있다. 이러한 콘텐츠[1]는 첨단 기술과의 융합으로, 사용자(참여자)의 몰입을 극대화하고 제작 의도에 따른 경험을 효과적으로 유도한다. 실감형 콘텐츠는 주어진 상황에 맞춰 의사결정과 행동을 이끌어내는 전략적인 몰입 요소와 단계별 설계[2]가 필수적이다.

실감형 기술은 초기 VR(Virtual Reality)과 AR (Augmented Reality) 기반 게임 분야에서 주로 기술 시연(Tech Demo) 형태로 탐구되었다[3]. 기술이 성숙함에 따라, 전시 공간의 경계를 허물고 참여자의 경험을 근본적으로 재구성하려는 시도가 이어졌다[4][5]. 미디어 아트 그룹 팀랩(teamLab)은 센서와 프로젝터를 활용해 관람객의 움직임에 실시간으로 반응하는 몰입형 공간을 구현했다[6]. 이 공간은 관객의 행동이 작품의 핵심 변수로 작용하는 새로운 경험을 창출한다. 최근에는 Memo Akten, Refik Anadol 등과 같이 Generative AI(Generative Artificial Intelligence)를 결합한 시도들[7]이 이어지고 있다.

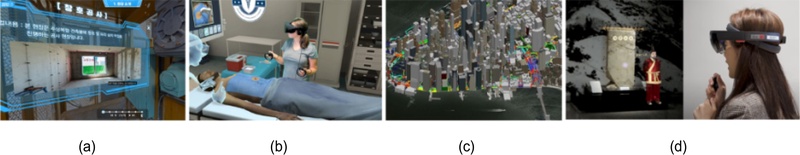

한편, VR의 높은 몰입감과 안전성은 교육 및 훈련 분야에서 그 가치를 입증했다. 안전교육에서는 중대 재해 시나리오[8]를 가상으로 체험하며 대응 능력을 기르는 훈련이 가능하다[9]. 박물관과 전시 공간에서는 관람객의 동선과 시선에 반응하는 개인화된 AR 도슨트[10]나 소실된 유물의 디지털 재현이 지능화된 경험을 제공한다.

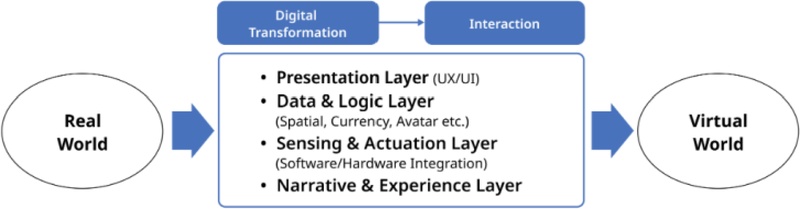

점차 가속화된 디지털 전환(Digital Transformation)의 흐름은 5G 통신 및 하드웨어의 발전과 맞물려, ‘메타버스’로 대변되던 가상 공간의 개념을 한 단계 진화시켰다[11]. 현실 공간에 디지털 정보를 융합하고 상호작용하는 ‘공간 컴퓨팅(Spatial Computing)’ 시대가 본격적으로 도래하였다. 그 기술적 파급력은 인류가 직면한 거시적 과제들을 해결하는 데까지 이르고 있다[12]. 도시 재생 분야에서는 디지털트윈을 활용하여 정책 및 인프라 개선, 탄소중립(Net Zero) 목표 달성에 기여하고 있다[13][14]. 그림 1은 다양한 분야의 응용 사례, 그림 2는 현실세계와 가상세계의 상호작용에 필요한 요소들을 나타낸다.

Various Application Cases Using Extended Reality (XR) Technology (a) Korea Occupational Safety and Health Agency’s VR Content for Accident Prevention[15] (b) Advanced Medicine & Healthcare Workshop at Johns Hopkins University[16] (c) Digital Synergy Project, Helsinki, Finland[17] (d) AR Docent Program at the National Museum of Korea[18]

실감형 미디어는 단순히 정보를 재현하여 보여주는 것을 넘어, 사용자가 가상 환경 속에서 직접 행동하고 느끼는 ‘체화(Enaction)’ 모델[19]을 기반으로 작동한다. 사용자는 더 이상 수동적인 관찰자가 아니라, 능동적 참여자로서 자신의 신체적 움직임과 감각을 통해 의미를 구성한다. 이는 HCI(Human-Computer Interaction)에서 주목하는 체화된 인지(Embodied Cognition) 이론[20][21]에 근거한다. 이러한 이론은 인지 과정이 뇌의 활동에만 국한되지 않고 신체와 환경의 역동적인 상호작용을 통해 구성된다고 본다.

본 연구는 실감형 미디어의 잠재력을 활용하여 기후 변화, 감시 사회와 같은 거시적 사회 문제를 개인의 체감 가능한 경험으로 전환하는 설계 방법론을 제안한다. 이를 위해 키넥트 센서(Kinect Sensor) 기반의 대화형 기술을 활용한 ‘유희-비판 전환(Play-to-Critique Transition)’ 프레임워크를 설계하였다. 이 프레임워크는 참여자의 심리 상태를 유희적 몰입에서 비판적 성찰로 점진적으로 전환시키는 서사적 구조를 제공하며, 실시간 행동 데이터를 반영하여 몰입형 상호작용 경험을 극대화한다. ‘감시 사회’를 주제로 한 파일럿 프로젝트 ‘Big Brother(빅 브라더)’ 전시를 통해 이 프레임워크의 효과를 검증하고, 미래 전시 설계에 적용 가능한 시사점을 도출하고자 한다.

구체적인 연구 목표는 다음과 같다. 첫째, 전시 경험을 통해 나타나는 참여자의 심리적 경계 전환 과정을 분석하고, 물리적·인지적·가상적 요소의 결합을 통한 점진적 몰입 방법을 도출한다. 둘째, 동적 센서 기반의 실시간 상호작용이 참여자의 행동과 인지 프레임, 그리고 메시지 수용에 미치는 영향을 탐구한다. 셋째, 참여자의 정서적 반응과 메시지 전달 과정의 한계를 분석하고, 이를 보완하기 위한 개선 방향을 제안한다.

Ⅱ. 키넥트 센서 기반 실감형 콘텐츠 시스템 구현

본 연구는 키넥트 센서를 활용해 디지털 콘텐츠의 전시 및 관람 공간을 설계함으로써, 공간과 스토리텔링(Space & Storytelling)을 연결하는 몰입 알고리즘을 핵심 디자인 전략으로 제안한다. 이는 거시적 사회 문제를 개인의 실존적 체험으로 전환하기 위한 것으로, 참여자의 심리적 경계를 완화하고 점진적 몰입을 통해 메시지를 직관적·체험적으로 전달하고자 한다.

1. 키넥트 센서 기반의 동작 인식 기술

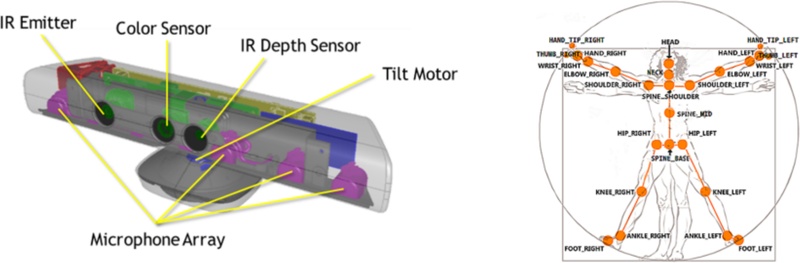

본 연구에서 제안하는 시스템의 목표는 참여자의 신체적 행위를 통해 서사를 전개하고 메시지를 전달하는, 즉 ‘체화된 상호작용’을 구현하는 것이다. 이를 위해 Microsoft Kinect v2 센서의 골격 추적(Skeletal Tracking) 기술을 핵심적으로 활용하였다. 키넥트 센서는 별도의 컨트롤러 없이 센서에 내장된 컬러 카메라와 적외선(IR) 프로젝터를 통해 인체의 주요 관절 25개를 실시간으로 인식하고 그 움직임을 추적[22]한다. 그림 3은 키넥트 센서의 구조와 추적 관절 부위를 나타낸다.

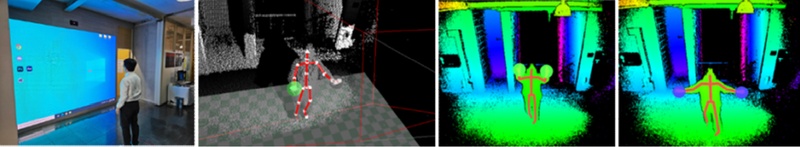

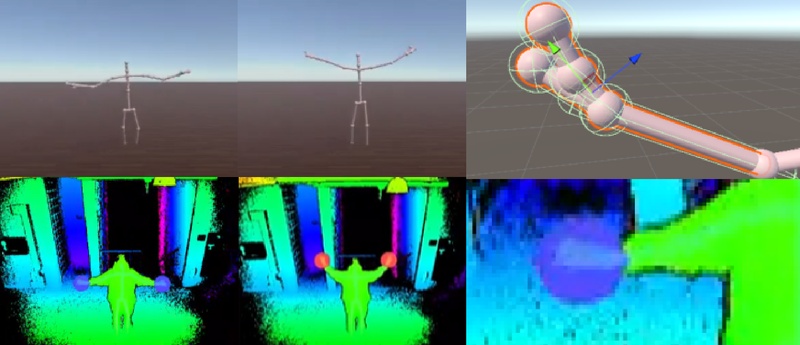

해당 센서는 초당 30프레임(FPS)의 속도로 참여자의 위치, 깊이, 관절 정보를 포함한 3차원 행동 데이터를 생성한다. 그림 4는 전시 참여자의 실시간 골격 추적 과정을 보여준다. 참여자의 미세한 제스처부터 큰 신체 움직임까지를 정밀하게 인식하여 디지털 콘텐츠에 즉각 반영할 수 있는 기반을 제공한다[25]. 표 1은 전시에 사용된 키넥트 V2 센서의 기술 사양[26]을 나타낸다.

2. 실감형 콘텐츠의 설계

본 연구에서 ‘실감형 콘텐츠’는 ‘참여자의 능동적 행위가 서사의 핵심 변수가 되어 특정 사회적 메시지에 대한 인지적, 정서적 상태 변화를 유도하는 체험’으로 설계된다. 이를 바탕으로 설계 방법론인 ‘유희-비판 전환 프레임워크’는 세 가지 가정을 기반으로 구현한다.

첫째, 행위 기반 참여이다. 이는 참여자가 자신의 신체적 행위를 통해 직접 콘텐츠와 자발적 참여(Engagement)를 유도한다는 것이다. 작품과 관객을 분리하지 않고, 관객의 적극적인 행위를 통하여 인터랙티브 미디어 아트의 주요 전제[27]와 일치한다.

둘째, 인지 부조화 기반 메시지 강화이다. 이는 ‘유희’에서 ‘감시’로의 전환 과정을 통해 인지 부조화가 메시지에 대한 이해도를 높인다. 참여자의 심리적 불편함은 기존의 태도나 믿음을 통해 전달하고자 하는 메시지에 대한 깊은 내면화를 유도한다.

셋째, 자기 참조 기반 당사자성 강화이다. 자신의 경험적인 행동 데이터가 당사자(Self-relevance) 인식을 강화하고, 보다 더 정서적 몰입을 유발한다. 이는 가상현실 연구에서 관찰되는 신체 전이(Body Transfer) 현상[28]과 유사하게, 자신의 신체 정보가 직접적으로 반영될 때 사용자가 가상 경험을 자신의 것으로 강하게 내재화하는 경향에 기반한다.

3. 인터렉티브 공간 디자인 구현

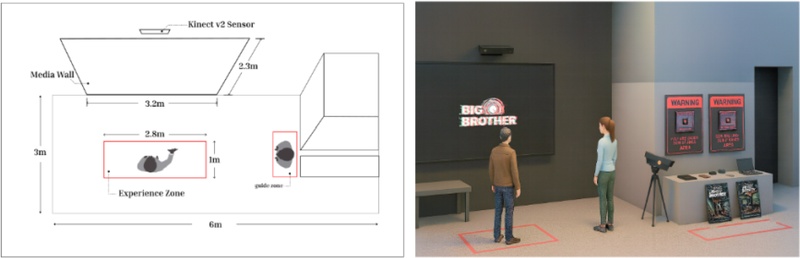

그림 5는 키넥트 센서 기술을 기반으로 참여자의 몰입을 극대화하기 위해 물리적 요소와 디지털 요소가 유기적으로 결합되도록 공간을 디자인(Space Design)한다. 체화된 경험의 몰입도를 극대화하기 위해, 물리적 공간은 참여자의 행동을 유도하고 제약하는 ‘무대’로서 설계된다. 전시 공간은 약 6m(l) × 3m(w) 크기로 설정한다. 공간 전면에 설치된 가로 320cm, 세로 230cm의 대형 미디어월은 참여자의 행동을 시각적으로 반사하는 ‘디지털 거울’ 역할을 한다. 이는 참여자가 자신의 신체적 행위와 결과를 즉각적으로 연결하여 인식하도록 돕는 요소이다. 상단에 키넥트 v2 센서가 위치하고, 바닥에는 키넥트 센서의 최적 인식 범위(1m~2.8m)를 고려한 체험 존(Experience Zone)을 표시(Marking)한다. 이는 기술적 제약을 안내하는 동시에, 참여자에게 이곳이 상호작용이 일어나는 지정된 ‘무대’임을 암시하여 경험에 더욱 몰입하도록 유도한다.

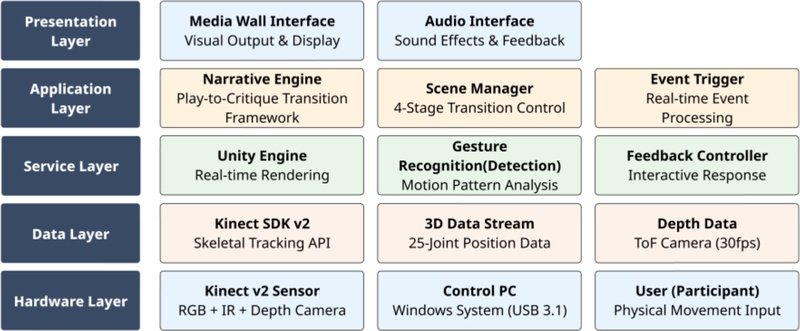

공간 디자인을 통해 구축한 시스템의 상호작용 모델은 한 번에 한 명의 주요 참여자를 중심으로 설계되었다. 동작 인식의 경우, 사전에 정의된 제한적인 동작에 의해서만 상호작용이 이루어지는 것을 전제로 하고, 환경 제어 측면에서는 키넥트 센서의 ToF(Time-of-Flight) 기술이 외부 적외선 광원에 의해 간섭받지 않도록 실내조명 환경에서 수행한다[29]. 그림 6은 각 레이어(Layer) 요소와 그에 따른 시스템-UML 컴포넌트를 나타낸다.

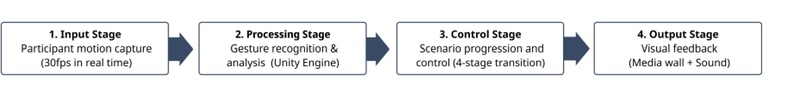

그림 7은 그림 6을 기반으로 전체 시스템의 데이터 흐름을 개괄적으로 보여준다. 이를 보다 구체적인 프로세스 단위로 세분화하면, 제안된 시스템은 크게 순서대로 입력 계층(사용자 동작 센싱), 처리 계층(제스처 인식 및 시나리오 제어), 출력 계층(시청각 피드백 렌더링) 세 계층으로 구분하여 설명한다.

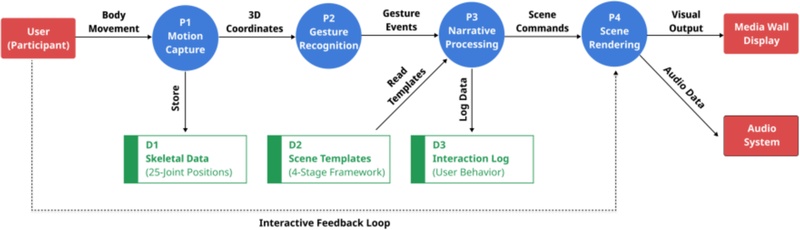

그림 8은 그림 6과 그림 7을 기반으로 한 전체 데이터 흐름을 세부적으로 도식화한 것이다. 4절에서 설명할 ‘유희-비판 전환’ 프레임워크의 특정 단계를 통하여 데이터 흐름과 상호작용 로직이 어떻게 기술적으로 구현되는지 구체적으로 설명한다.

입력 계층(Input Layer)에서 참여자의 신체 움직임이 키넥트 센서를 통해 초당 30fps로 포착되며, Motion Capture 프로세스(P1)가 25개 관절점의 3차원 골격 데이터를 실시간 생성하여 데이터베이스(D1)에 저장된다. 그림 9는 골격 데이터를 수집하고 Unity 내부에서 제스처를 처리하는 모습을 설명한다.

처리 계층(Processing Layer)에서는 Unity 엔진 기반의 제어 PC가 골격 데이터를 분석한 후, 제스처 인식(Gesture Recognition) 모듈(P2)이 손 상태 감지(Hand State Detection) SDK를 통해 손 상태를 열림(Open)/닫힘(Closed)으로 분류한다. 주먹 쥔 손의 손목 관절이 어깨 관절 기준점에서 Z축 방향으로 1초 내에 25cm 이상의 깊이 변화를 보일 때 ‘펀치’ 제스처로 분류한다. 인식된 제스처는 내러티브 처리(Narrative Processing) 엔진(P3)으로 전달되어 데이터 D2의 유희-비판 전환 프레임워크를 참조한다.

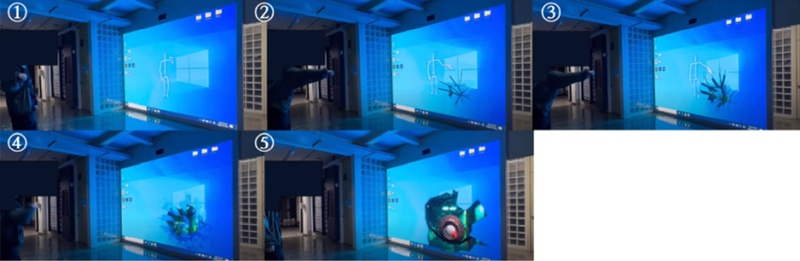

펀치 제스처(주먹을 정면으로 뻗는 행위) 감지 시 시스템은 3단계 시각적 전환 시퀀스를 실행한다. 1단계에서는 윈도우 바탕화면에 균열이 나타나고, 2단계에서는 균열이 확장되며, 3단계에서는 화면 일부가 완전히 파괴되어 그 너머로 감시자의 모습이 드러난다. 이를 통해 일상적 컴퓨터 인터페이스에서 감시 사회의 은밀한 관찰 환경으로의 점진적 시각적 전환이 구현된다. 각 단계별 참여자 반응 시간, 제스처 정확도, 시각적 전환 완료 시점 등의 상호작용 데이터는 연구 분석을 위해 로그 데이터(D3)로 기록된다.

출력 계층(Output Layer)에서는 장면 렌더링(Scene Rendering) 프로세스(P4)가 시나리오 명령(P3)을 받아 앞서 설명한 3단계 시각적 전환을 미디어월 디스플레이를 통해 실시간 렌더링한다. 동시에 오디오 시스템을 통해 불쾌한 기계음의 음향 효과가 시각적 전환과 동기화되어 제공된다. 이러한 과정은 참여자 행동 → 감지 → 신호처리 → 시청각 피드백의 체화된 상호작용의 순환 고리(Interactive Feedback Loop)를 완성한다. 그림 10은 골격 데이터를 가시처리한 후 녹화한 실시간 참여자 행동 → 센싱 → 처리 → 시청각 피드백 과정을 나타낸다.

4. ‘유희-비판 전환’ 프레임워크의 단계별 설계

앞서 기술한 시스템 구성을 바탕으로, 본 연구는 참여자의 심리 상태를 점진적으로 전환시켜 특정 사회적 메시지에 대한 비판적 성찰을 유도하는 것을 목표로 ‘유희-비판 전환(Play-to-Critique Transition)’ 프레임워크를 설계한다. 이 프레임워크는 사회 비판적 메시지를 전달하기 위한 의도적인 심리적 여정을 설계하는 하나의 디자인 패턴(design pattern)이다. 표 2는 프레임워크를 구성하는 네 가지 주요 장면을 나타낸다.

1단계는 ‘참여 및 유인’이다. 참여자는 친숙한 원도우 인터페이스가 나타난 미디어월 앞에서 상호작용을 시작한다. 참여자의 심리적 중압감을 낮추고, 자연스러운 접근을 유도하여 초기 심리적 경계를 완화하고 몰입을 준비시키는 것을 목표로 한다. 참여자는 화면 밝기를 조정하거나 화면을 두드리는 등 자신의 행동이 콘텐츠에 미치는 영향을 즉각적으로 체감하며 수동적 관찰자에서 능동적 참여자로 전환한다. 이 과정에서 나타나는 잔상은 참여자의 호기심을 자극하고 콘텐츠에 대한 통제감을 느끼게 하여, 이후 단계의 비판적 메시지 수용도를 높이는 전략적 준비 과정으로 작용한다. 이때 참여자는 자신의 행동이 시스템에 즉각적으로 영향을 미치는 것을 보며 즐거움과 함께 강력한 주체성(agency)을 느끼게 된다.

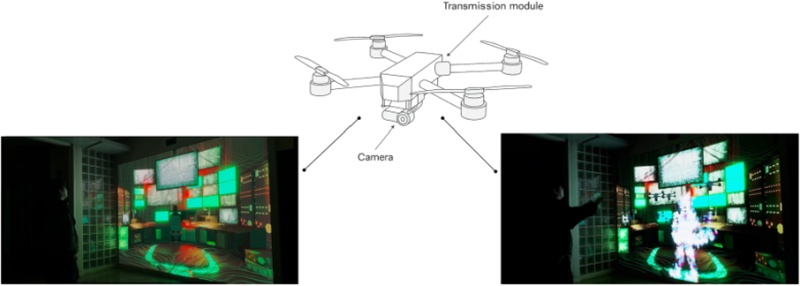

2단계는 ‘침입 및 부조화’이다. 그림 11과 같이 참여자의 행동을 따라 움직이는 다수의 감시 카메라(CCTV) 시선의 연출을 통해, 초기 유희 상태와 상충하는 ‘감시’라는 이질적 요소를 도입한다. 자신의 행동이 타자의 시선에 의해 포착되고 있음을 인지하는 인지 부조화를 경험하게 된다. 이 과정은 참여자 스스로 메시지 전달 당사자임을 인지하도록 유도하는 중요한 역할을 한다. 초기 단계에서 형성된 ‘즐거운 놀이’라는 인식과 ‘감시당하는 불편함’이라는 부조화를 해소하기 위해 상황을 재해석하려는 인지적 노력을 시작하게 된다.

3단계는 ‘폭로 및 종속’이다. 그림 11에서 감시자는 다수의 모니터와 감시 드론을 통해 참여자를 지켜보는 장면을 나타낸다. 실시간 스트리밍 데이터가 데이터베이스에 저장되고, API(Application Programming Interface) 서버를 통해 통제되는 과정을 암시함으로써 정보 통제 과정에서 감시 사회의 본질적 억압과 비대칭성을 체험하게 된다. 이 단계는 참여자가 시스템의 주인이 아니라, 보이지 않는 권력 구조에 의해 분석되고 통제되는 대상임을 명확히 밝힘으로써, 감시 사회의 비대칭적 권력 관계를 체감한다.

4단계는 ‘성찰 및 직면’이다. 그림 12는 CCTV(Closed-Circuit Television)의 REC(Recording) 프레임을 통해 참여자 자신의 모습이 포획된 객체로서 모니터에 비추어지는 상호 연출이 이루어진다. 참여자는 자신이 몰입했던 관절과 골격이 데이터로서 감시 속에 있음을 인지하며, 개인의 프라이버시 문제에 대해 성찰하게 된다. 체험 후 진행되는 가상의 설문조사는 개인정보 제공의 위험성을 다시 한번 자각하고, 자신의 경험을 비판적으로 반추하도록 유도한다. 이러한 일련의 과정은 단순한 정보 전달을 넘어, 참여자가 감시 사회라는 메시지를 체험적으로 내재화하도록 설계된다.

Ⅲ. 실감 데이터 분석 및 평가 방법

본 연구는 ‘유희-비판 전환’ 프레임워크가 참여자의 인지 몰입과 메시지 수용에 미치는 영향을 다각적으로 분석하고 평가하는 것을 목표로 한다. ‘체화된 경험’은 단순한 정보 습득을 넘어 참여자의 신체적, 인지적, 정서적 상태 변화를 포괄한다. 따라서 다층적 경험을 온전히 포착하기 위해 참여자의 주관적 보고와 객관적 행동 패턴을 함께 분석하는 혼합 연구(Mixed Methods) 방식을 채택한다.

1. 연구 설계 및 데이터 분석 방법

본 연구의 설계와 분석은 참여자의 체험 과정을 단계적으로 추적하고, 수집된 데이터를 다각적으로 분석하는 데 초점을 맞춘다. 데이터 분석은 다음과 같은 세 가지 접근법을 통해 수행한다. 첫째, 설문 및 관찰 데이터 분석을 통하여 참여자의 주관적 경험과 심리적 변화를 심층적으로 이해하기 위해 정량적, 정성적 분석을 병행한다. 둘째, 행위자-네트워크 이론(ANT)[30] 기반 분석을 통하여 참여자(인간 행위자)와 기술 및 공간(비인간 행위자) 간의 상호작용이 어떻게 경험을 구성하는지 분석한다. 셋째, 비교 사례 연구를 통하여 분석 결과를 국내외 유사 몰입형 전시 사례와 비교하고, 발견점의 의의를 맥락화하고 일반화 가능성을 탐색한다.

실험 참여자는 총 40명을 대상으로 하였으며, 연령 분포는 대부분(약 83%, n=33) 20대의 대학생으로 구성되었고, 나머지 약 17%(n=7)는 40대에서 50대의 성인으로 분포된다. 성별 분포는 여성 21명(52.5%)과 남성 19명(47.5%)이 참여한다. 20대 대학생의 모션 인식 콘텐츠에 대한 경험과 숙련도가 상대적으로 높을 것으로 예상되나, 실제로는 20대와 40-50대 참가자 간 적응도 및 숙련도에 유의미한 차이가 관찰되지 않았다. 따라서 주 관객층의 연령에 관계없이 직관적인 경험을 보장하기 위해 보다 정교한 가이드를 제공하며, 전시 공간 내에서 가이드 역할을 수행하는 안내자가 참여자 옆에서 동작 수행을 유도하도록 구성한다.

2. 실험 대상의 정량적 특성 분석 방법

실험 대상의 정량적 데이터는 5점 리커트 척도로 수집되었으며, N=40의 소규모 표본 특성을 고려하여 분석한다. 데이터의 특성을 파악하기 위해 평균과 표준편차를 이용하며, 소수의 편향된 값보다 중앙값(Median)을 핵심 지표로 활용한다. 또한, 변수들 간의 관계를 탐색하기 위해 데이터의 비모수 검정인 스피어만 순위 상관 분석(Spearman’s Rank Correlation)[31][32]을 사용하여 주요 경험 요소들 간의 연관성을 통계적으로 확인한다.

3. 정성적 데이터 분석 방법

정성적 데이터 분석은 개방형 질문과 현장 관찰을 통해 데이터를 수집하고, 질적 내용 분석(Qualitative Content Analysis)을 통해 분석한다. 모든 텍스트 데이터를 반복적으로 읽으며, 핵심적인 의미 단위를 찾아내고, 이를 바탕으로 ‘기술적 문제’, ‘환경적 제약’, ‘부정적 심리 반응’ 등과 같은 주요 주제와 패턴을 도출하는 귀납적 방식을 사용한다. 분석의 신뢰도를 높이기 위해, 2명의 연구자가 독립적으로 데이터를 코딩한 후 그 일치도를 확인하여 분석 결과의 객관성을 담보한다.

Ⅳ. 분석 결과

본 장에서는 제안된 프레임워크의 가치를 두 가지 방식으로 고찰하고자 한다. 첫째, 질적 비교 분석을 통해 ‘유희-비판 전환’을 체계화가 가능한 디자인 패턴으로 확립한다. 둘째, 파일럿 연구 데이터의 정량 분석을 제시하여 이 프레임워크의 특정 구현에 대한 내부 메커니즘과 효과를 검증한다.

1. 전환의 방법론: 주요 작품 비교 분석

거시적 사회 문제를 미시적 개인 경험으로 전환하는 원리는 본 연구의 파일럿 프로젝트를 넘어 다양한 실감형 콘텐츠에서 발견된다. 본 논문에서 각기 다른 주제와 기술을 통해 비교 분석함으로써 ‘유희-비판 전환’ 프레임워크의 보편성과 유연성을 검증하고, 문제 해결을 위한 다양한 설계 패턴을 도출한다. 본 장에서는 체계적 인종차별, 난민 위기, 기후 변화라는 세 가지 거대 담론을 다루는 대표적인 작품들을 분석하여, 이들이 사용하는 ‘전환의 방법론’을 탐구한다.

‘1000 Cut Journey’는 가상현실(VR)을 통해 사용자가 ‘마이클 스털링’이라는 흑인 남성의 아바타가 되어, 그의 삶의 여러 단계(7세, 15세, 30세)에서 인종차별을 직접 경험하게 하는 시뮬레이션[33][34]이다. 이 작품은 ‘체계적 인종차별’이라는 거대하고 추상적인 개념을 교실에서의 부당한 훈계, 길거리에서의 경찰 검문, 직장에서의 미묘한 차별과 같은 일련의 구체적이고 개인적인 미세 공격(Microaggression)과 불의의 경험으로 전환한다. 이 작품의 핵심 메커니즘은 VR 기술이 제공하는 ‘신체 전이(Body Transfer)’와 ‘관점 채택(Perspective-taking)’ 능력을 극대화하여, 인종차별을 경험해 보지 않은 사용자와 경험한 사용자 사이의 경험적 격차를 메우는 것이다. 사용자는 단순히 영상을 보는 것이 아니라, 마이클의 신체에 동기화되고, 그의 시선으로 세상을 보며, 부당한 상황에 직접 반응하게 된다. 제작팀은 실제 인물들의 경험담, 사회과학 연구, 미디어 보도 등 방대한 자료를 바탕으로 시나리오를 구성하여 경험의 진정성을 확보한다.

이러한 설계는 ‘유희-비판 전환’ 프레임워크의 구조와 거의 완벽하게 일치한다. 1단계(참여 및 유인)는 VR이라는 신기술이 주는 초기 신기함과 몰입감에 해당한다. 그러나 이내 교실에서 억울한 비난을 받는 2단계(침입 및 부조화)를 겪으며 즐거움은 깨지고 불편한 감정이 싹튼다. 경찰 검문과 면접 차별을 겪으며 이것이 일회성 사건이 아닌, 삶 전반에 걸친 체계적 편견의 패턴임을 깨닫는 3단계(폭로 및 종속)에 이른다. 마지막으로, 이 모든 경험의 누적된 정서적 무게를 통해 인종차별 문제의 심각성을 내면화하는 4단계(성찰 및 직면)로 마무리된다.

‘Clouds Over Sidra’는 360도 영상을 통해 관객을 요르단의 자타리(Za'atari) 난민 캠프로 데려가는 프로젝트[35]이다. 하지만 ‘1000 Cut Journey’와 달리, 관객은 특정 인물의 아바타가 되지 않는다. 대신, 관객은 그곳에 존재하는 보이지 않는 ‘목격자’가 된다. 서사는 시드라(Sidra)라는 12세 소녀의 목소리로 진행되며, 그녀의 일상을 따라가면서 강력하고 개인적인 유대감을 형성한다. 이 작품의 공감 메커니즘은 시뮬레이션된 행동이 아닌 ‘현존감(presence)’과 ‘시선 맞춤(eye contact)’에서 비롯된다. 360도 환경은 관객이 자유롭게 주변을 둘러보며 공간을 탐색하게 함으로써, 마치 그녀와 함께 그곳에 있는 듯한 느낌을 준다. 이 작품의 영향력은 학교에 가고, 축구를 하고, 친구들과 어울리는 보편적인 어린 시절의 모습이 ‘난민’이라는 거대한 비극의 배경과 병치되는 데서 나온다[36]. 관객은 시드라의 눈을 통해 평범한 일상과 희망을 발견하고, 동시에 그녀가 처한 현실의 무게를 느끼며 깊은 공감을 경험한다.

‘유희-비판 전환’ 프레임워크는 이 작품에서 더 세심한 형태로 적용된다. 1단계(참여 및 유인)는 360도 영상이라는 새로운 매체가 주는 실존 감각의 경이로움이다. 2단계(침입 및 부조화)는 시드라의 밝고 희망적인 태도와 그녀가 처한 절망적인 현실 사이의 극명한 대조에서 발생한다. 3단계(폭로 및 종속)는 이 캠프가 한 소녀의 이야기가 아니라, 전쟁으로 인해 삶의 터전을 잃은 수많은 사람들의 실제 도시라는 사실을 깨닫는 순간이다. 마지막 4단계(성찰 및 직면)는 시드라와의 개인적인 정서적 연결을 통해 난민 문제에 대한 새로운 관점을 얻고, 실제 행동으로 이어질 수 있는 동기를 부여받는 과정이다. 실제로 이 작품은 UN의 기금 모금 활동에 효과적으로 활용되었다[37].

예술가 이자벨 비버스는 해빙으로 인한 빛의 변화, 심해 채굴의 영향과 같은 복잡하고 방대한 기후 변화 과학 데이터를 영상, 애니메이션, 사운드, 조각을 활용한 감각적이고 몰입적인 설치 작품으로 변환한다[38]. 그녀의 작업은 현실을 직접적으로 시뮬레이션하는 대신, 과학적 사실을 ‘정서적이고 주관적인 경험’으로 추상화하여 ‘과학적 보고서만으로는 불가능한 미묘한 대화’를 촉발하는 것을 목표로 한다. 비버스의 방법론은 깊이 있는 과학 연구, 현장 답사, 그리고 데이터 과학, 구술사, 과학 소설 등 다양한 인식론을 통합하는 데 기반한다. 그녀는 거대하고 비인격적인 데이터를 정서적으로 공명하도록 만드는 미학적 환경을 창조한다. 예를 들어. ‘Arctic Lab’[39]에서는 북극 하늘의 빛을 재현한 공간에서 해빙이 해조류에 미치는 영향을 시각화하고, ‘Tomb Keepers(Rise)’[40]에서는 심해의 환경을 모방한 공간을 통해 심해 채굴의 사회적, 정치적, 영적인 함의에 대해 질문을 던진다. 이러한 접근 방식에서 프레임워크는 추상적인 형태로 적용되고, 관객의 ‘인식을 전환’시키는 것이다. 1단계(참여 및 유인)는 설치 작품이 지닌 순수한 미학적 아름다움과 호기심이다. 2단계(침입 및 부조화)는 그 아름다운 형태 뒤에 숨겨진 불편한 과학적 진실과 마주하는 순간에 발생한다. 3단계(폭로 및 종속)는 기후 위기를 초래하는 식민주의, 자원 착취와 같은 거대한 시스템적 동력을 이해하는 과정이다. 마지막 4단계(성찰 및 직면)는 작품이 의도한 대로, 관객이 기존의 생각을 넘어 새로운 질문을 던지고 ‘미묘한 대화’를 시작하게 되는 것이다.

표 3은 본 연구의 ‘유희-비판 전환’ 프레임워크를 각 사례 연구에 적용하여, 서로 다른 기술과 서사 전략에도 불구하고 어떻게 참여자의 심리적 여정이 네 가지 핵심 단계(참여 유도 → 부조화 발생 → 본질 폭로 → 성찰 직면)로 수렴되는지를 비교 및 분석한다. 이 분석은 프레임워크의 타당성에 대한 논리적 기반을 제공한다. 나아가, 문제의 특성에 따라 체화된 시뮬레이션, 공감적 목격, 감각적 추상화와 같은 전환 방법론을 선택하고, 이 원칙들을 적용하여 참여자의 인지적, 정서적 관여를 효과적으로 유도할 수 있다.

2. 설문조사 결과 요약

표 4는 2024년 11월 20일부터 24일까지 40명의 참여자가 참여한 설문조사 및 분석을 나타낸다. 설문은 전시 경험의 4단계로 동작 초기 진입 및 접촉, 상호작용 설계와 메시지 전달, 내러티브 전환과 심리적 변화, 체험 후 메시지 수용으로 구성된다. 각 단계는 폐쇄형 질문 2개(5점 리커트 척도: 1점 “전혀 그렇지 않음” ~ 5점 “매우 그렇다”)와 개방형 질문 1개로 이루어진 총 12개 질문으로 구성되었다.

표 5는 개방형 설문 응답에 대한 주제 분석 결과를 요약한 것이다.

수집된 데이터 분석 결과, 참여자 경험은 설계 의도가 성공적으로 구현된 측면과 기술적·환경적 한계로 인해 발생한 부정적 측면이 복합적으로 나타난다. 초기 진입 및 상호작용 단계에서는 가이드의 안내(25%)와 콘텐츠의 자연스러운 노출(“자연스럽게 눈에 띄었다”, 30%)이 참여자의 초기 몰입을 긍정적으로 유도한다. 그러나 동시에 센서의 ‘좁은 인식 범위’(“범위 좁아 인식 안돼 다소 답답”, 20%)와 같은 기술적 한계가 일부 참여자의 경험을 저해하는 요인으로 작용한다.

상호작용 및 메시지 전달 단계에서 참여자들(평균 3.40)은 자신의 움직임이 콘텐츠에 반영되는 것을 통해 ‘감시 사회’라는 주제를 효과적으로 이해했다고 평가한다. 하지만 많은 참여 인원으로 인한 혼잡함(“사람 많아서 부끄럽고 방해됐다”, 15%)과 센서의 기술적 제약(“범위 좁아서 움직이기 힘들었다”, 20%)이 상호작용의 흥미를 반감시키는(평균 3.03) 요소로 지적된다.

서사 전환 및 심리적 변화 단계에서는 설계 의도에 부합하는 결과가 뚜렷하게 나타난다. 다수의 참여자가 “따라오는 시선이 불편하고 꺼림칙했다”(30%)고 응답하여, 감시 상황이 주는 심리적 압박감이 의도대로 전달된다. 반면, 일부 참여자는 이를 ‘게임처럼’ 인식하며 즐기는 상반된 반응을 보이기도 했으며, 과도한 움직임 요구는 기술적 피로감(“점점 많이 움직여야 해서 힘들었다”, 20%)을 유발하여 몰입을 방해하는 요인으로 작용한다.

마지막으로 체험 후 메시지 수용 단계에서 참여자들은 전시의 메시지가 기억에 오래 남을 것이라고 긍정적으로 평가했으나(평균 3.25), 경험 전반에 걸쳐 지속적으로 제기된 기술적 문제(반응 속도 지연 30%, 인식 범위 제한 20%)와 공간의 제약(협소함 20%, 어두운 조명 10%)이 개선 과제로 지적되었다. 다음 절에서는 이러한 질적 경향을 뒷받침하는 구체적인 정량적 데이터를 분석한다.

설문조사의 양적 데이터에 대한 기술 통계 분석 결과는 표 6과 같다. 모든 문항에서 평균값이 척도의 중앙값인 3.0을 상회하여 전반적으로 긍정적인 경험을 제공했음을 알 수 있다. 특히 ‘주제 이해도 향상(Q3)’ 문항의 평균이 3.40으로 가장 높게 나타나, 상호작용적 경험이 ‘감시 사회’라는 추상적 주제에 대한 참여자의 이해를 돕는 데 효과적이었음을 시사한다. 반면, ‘테마 구역의 흥미도(Q4)’와 ‘감정적 몰입 심화(Q5)’ 문항의 표준편차가 각각 1.22와 1.24로 다른 문항에 비해 다소 크게 나타나, 해당 경험에 대한 참여자의 반응이 개인별로 편차가 컸음을 보여준다.

주요 변수 간의 관계를 탐색하기 위해 스피어만 순위 상관 분석을 실시한 결과는 표 7과 같다. 분석 결과, 통계적으로 유의미한 몇 가지 관계가 발견되었다. 첫째, ‘동작 인식의 직관성(Q1)’과 ‘주제 이해도 향상(Q3)’ 사이에 중간 정도의 양의 상관관계(rs = .48, p<.01)를 보였다. 이는 기술적 완성도가 단순히 경험의 ‘쾌적함’을 넘어서, 메시지 전달의 ‘효과성’에 직접적인 영향을 미친다는 것을 의미한다. 질적 데이터에서 나타난 ‘인식 범위 제한’이나 ‘반응 속도 지연’과 같은 기술적 마찰은 단순한 불만이 아니라는 것을 시사한다. 또한, ‘주제 이해도 향상(Q3)’은 ‘메시지 기억 지속성(Q7)’과 강한 양의 상관관계(rs = .62, p<.001)를 나타난다. 이는 인터페이스가 직관적이라고 느낄수록 전시 주제를 더 잘 이해하는 경향이 있으며, 이에 메시지를 장기간 지속적으로 기억할 가능성이 높음을 보여준다.

개방형 질문에 대한 응답을 귀납적 내용 분석 방법으로 분석하여 표 8과 같이 주요 주제를 도출한다. 분석 결과, ‘기술적 문제’(30%)와 ‘부정적 심리 반응’(30%)이 가장 높은 빈도를 차지한다. ‘기술적 문제’는 주로 센서의 인식 범위 제한과 반응 속도에 대한 불만으로 나타났으며, ‘부정적 심리 반응’은 의도된 ‘감시로 인한 불편함’이 성공적으로 전달되었음을 보여준다. 이는 양적 데이터만으로는 파악하기 어려운 구체적인 경험의 맥락을 제공한다.

정량적 및 정성적 분석 결과를 종합하면, 제안된 시스템은 ‘감시 사회’ 메시지를 효과적으로 전달했으나, 기술적 및 환경적 제약이 사용자 경험의 질을 저하시켰다. 설문 결과, 메시지 이해도(Q3)는 평균 3.40을 기록했으며, 참여자의 30%가 감시로 인한 불편함을 체감했다고 응답했다. 그러나 동작 인식의 직관성(Q1)은 평균 3.08에 머물렀다. 이는 질적 데이터에서 지적된 인식 범위 제한(20%)과 반응 속도 지연(30%) 문제로 설명된다. 이러한 기술적 한계는 참여자가 메시지 몰입(본유적 인지 부하)에 집중하기보다 인터페이스 조작 방법을 파악하는 데(외재적 인지 부하) 정신적 자원을 소모하게 만든다. 인지 부하 이론(Cognitive Load Theory)[41]에 따르면, 불필요한 외재적 인지 부하의 증가는 학습 및 정보 처리의 효율성을 저해하므로, 이는 본 연구의 핵심 목표인 메시지 전달과 직접적으로 상충된다.

의도와 실제 체험 간의 간극 발견은 행위자-네트워크 이론(ANT)의 관점에서 더 깊이 이해될 수 있다. ANT는 참여자(인간 행위자)와 기술 시스템(비인간 행위자)을 분리된 요소가 아닌, 상호 연결된 네트워크로 본다. 이 네트워크에서 키넥트 센서는 수동적 도구가 아니라, 참여자의 물리적 움직임을 데이터로 ‘번역(Translate)’하는 능동적 행위자이다. 소프트웨어는 이 데이터를 시각적 표현으로 다시 번역하는 또 다른 행위자이며, 참여자는 이 네트워크에 ‘등록(enroll)’된다. ‘감시받는 경험’은 바로 이 네트워크의 효과이다. 따라서 ‘반응 속도 지연’이나 ‘인식 오류’와 같은 기술적 한계는 단순한 결함이 아니라, 최종 경험을 능동적으로 형성하는 키넥트 행위자의 속성이며, 네트워크 내에서 마찰 또는 ‘적대적 관계(Antagonistic Relationships)’를 생성하여 메시지 전달을 방해하는 요인으로 작용한다. 이는 기술적 성능이 체험의 질을 넘어 메시지 전달의 효과성과 분리될 수 없음을 보여준다.

3. 종합 제언 및 향후 연구 방향

향후 몰입형 콘텐츠는 기술적 안정성을 확보하여 사용자의 행동에 즉각적이고 직관적인 피드백을 제공함으로써 몰입감을 극대화해야 한다. 또한, 주제가 주는 심리적 긴장감은 유머와 같은 요소를 활용해 완화하고, 간단한 미션이나 동작 기반 질문(넛지 포인트)으로 참여를 자연스럽게 유도하는 전략이 효과적이다.

이러한 콘텐츠는 개인의 공감을 사회적 행동으로 연결해야 한다. 이를 위해 다수가 참여하는 협력형 과제를 도입하고 체험 후 토론을 유도하여 ‘집단적 의미 구성’을 촉진해야 한다. 나아가 ‘기후 박물관(The Climate Museum)’[42]의 사례처럼, 문제의식을 구체적인 실천으로 연결하는 ‘생태계 모델’을 구축하는 것이 중요하다.

설계 제언의 효과는 엄밀한 방법론으로 검증되어야 한다. 통제 집단과의 비교 연구(A/B 테스트), 장기적 효과를 추적하는 종단 연구를 진행하고, 설문뿐 아니라 심박수, 피부전도반응(GSR) 등 객관적인 생체 신호를 통합 분석하여 참여자의 심리 변화를 정밀하게 측정해야 한다. 더불어, 최신 AI 동작 인식 기술을 적극적으로 활용하여 상호작용의 완성도를 높이고 개인 맞춤형 서사를 구현하는 방안을 탐구하되, AI 윤리 문제를 신중히 고려해야 한다.

Ⅴ. 결 론

본 연구는 키넥트 센서 기반의 인터랙티브 기술을 활용하여, 사회적 메시지를 전달하는 실감형 콘텐츠의 설계 방법론을 탐구하고 그 효과를 실증적으로 분석하였다. 연구의 핵심 기여는 참여자의 심리 상태를 ‘유희적 참여’에서 ‘비판적 인식’으로 점진적으로 전환시키는 ‘유희-비판 전환(Play-to-Critique Transition)’ 프레임워크를 제안하고, 파일럿 연구를 통해 그 가능성을 조명하였다.

연구 내용을 요약하면 다음과 같다. 첫째, 사회적 메시지를 담은 실감형 콘텐츠 설계를 위한 구체적인 방법론으로 ‘유희-비판 전환’ 프레임워크를 제안하고, 파일럿 연구를 통해 그 효과와 가능성을 조명하였다. 둘째, 프레임워크의 효과는 참여자의 상호작용에 대해 유의미한 상관관계가 있음을 통계적으로 도출하였다. 셋째, 키넥트 센서에 대해 참여자의 불필요한 인지 부하를 유발하였으며, 인터랙티브 경험 설계에 있어 핵심적인 도전 과제임을 시사한다.

본 연구를 통하여 실감형 콘텐츠 디자인에 중요한 학술적, 실용적 시사점을 제공한다. 기술적 완성도가 메시지 전달 효과에 직접적인 영향을 미친다는 상관관계 분석 결과는, 향후 관련 연구에서 사용자 경험의 기술적 측면과 내용적 측면을 통합적으로 고려해야 함을 의미한다. 또한, 제시한 설계 프레임워크와 ‘너지 포인트’와 같은 세부 전략들은 감시 사회를 넘어 기후 변화, 데이터 윤리 등 다양한 사회적 이슈를 다루는 교육 및 공공 캠페인 콘텐츠 개발에 직접적으로 응용될 수 있다. 이는 실감형 콘텐츠가 단순한 오락을 넘어, 사회적 담론을 형성하고 참여를 유도하는 강력한 도구가 될 수 있음을 시사한다.

향후 본 연구에서 제안된 방법론이 더욱 정교하게 발전하고 다양한 분야로 확장되어, 기술이 인간의 성찰과 사회적 소통을 촉진하는데 기여할 수 있기를 기대한다.

References

-

D. Kim, and S. Kim, “Immersive Interactive Content Design for Immersion of the Audience”, Journal of Digital Design Research, Vol.15, No.1, pp.245-253, 2015, March, (accessed Apr. 15, 2025).

[https://doi.org/10.17280/jdd.2015.15.1.024]

-

J. Kang, “A Case Study on Application of Realistic Content to Space Design”, Journal of Digital Convergence, Vol.15, No.6, pp.369-376, 2017, June, (accessed Apr. 15, 2025).

[https://doi.org/10.14400/JDC.2017.15.6.369]

- C. Pruett, The Past, Present, and Future of Developing VR and MR with Meta, Meta Horizon OS, Meta Horizon, March, 2025, https://developers.meta.com/horizon/blog/gdc-2025-past-present-future-developing-vr-mr-meta-audience-insights/, (accessed June 30, 2025).

-

S. Jeong, and S. Chang, “Production of Fusion-type Realistic Contents Using 3D Motion Control Technology”, Journal of Convergence Information Technology, Vol.9, No.4, pp.146-151, 2019, April, (accessed Apr. 15, 2025).

[https://doi.org/10.22156/CS4SMB.2019.9.4.146]

-

M. Byun, and J. Lee, “Case study on application of personalized recommendation system in online exhibition event: Focusing on industry-academic cooperation EXPO”, Journal of the Digital Content Society, Vol.22, No.4, pp.655-666, 2021, April, (accessed June 30, 2025).

[https://doi.org/10.9728/dcs.2021.22.4.655]

-

S. Senda, Mori Building and Teamlab to Launch Mori Building Digital Art Museum in Tokyo this Summer, Designboom, 2018, https://www.designboom.com/art/mori-building-teamlab-digital-art-museum-tokyo-05-01-2018/, (accessed Apr. 23, 2025).

[https://doi.org/10.1093/jaac/kpad042]

- Serpentine Galleries, Refik Anadol: Echoes of the Earth: Living Archive, 2024, https://www.serpentinegalleries.org/whats-on/refik-anadol-echoes-of-the-earth-living-archive/, (accessed June 30, 2025).

-

J. Yoon, Y. Joo, and D. Yoon, “Implementation of AIoT-based CCTV 3D Video and Augmented Reality Design Technology to Build a Safe Environment for Shipyards”, Korea Safety Culture Society, Vol.31, pp.127-147, 2024, June.

[https://doi.org/10.52902/kjsc.2024.31.127]

- S. Likens, and A. Mower, What Does Virtual Reality and the Metaverse Mean for Training?, PwC US, 2022, https://www.pwc.com/us/en/tech-effect/emerging-tech/virtual-reality-study.html, (accessed June 30, 2025).

- National Museum of Korea, Launch of Customized AR Exhibition Guide App Service, 2024, https://www.museum.go.kr/MUSEUM/contents/M0701040000.do?catCustomType=post&catId=93&schM=view&arcId=21060, (accessed Jun. 30, 2025).

- C. O’Toole, J. Schenider, K. Smaje, and L. Laberge, How COVID-19 has Pushed Companies Over the Technology Tipping Point—and Transformed Business Forever, McKinsey & Company, 2020, https://www.mckinsey.com/capabilities/strategy-and-corporate-finance/our-insights/how-covid-19-has-pushed-companies-over-the-technology-tipping-point-and-transformed-business-forever, (accessed June 30, 2025).

- GOV.UK, Department for Environment, Food & Rural Affairs, Connecting nature and technology - reflections from COP16, London, 2024, https://sustainableict.blog.gov.uk/2024/11/07/connecting-nature-and-technology-reflections-from-cop16/, (accessed June 30, 2025).

- City of Helsinki, Helsinki 3D - Maps & Geospatial Data, ND, https://www.hel.fi/en/decision-making/information-on-helsinki/maps-and-geospatial-data/helsinki-3d, (accessed June 30, 2025).

- S. Baxter, Helsinki’s Huge VR Gig Hints at the Potential of Virtual Tourism, The Guardian, May, 2020, https://www.theguardian.com/travel/2020/may/05/helsinki-huge-vr-virtual-reality-gig-potential-virtual-tourism, (accessed June 30, 2025).

- Korea Occupational Safety and Health Agency, Korea Occupational Safety and Health Agency Accident Prevention VR Content, Online Video, ND, https://360vr.kosha.or.kr/contentDetail?contSq=1285&cateSq=8, (accessed June 30, 2025).

- J. Sikorsky, Virtual Reality – Revolutionary or Revolting, National Youth Leadership Forum: Advanced Medicine & Health Care at at Johns Hopkins University, Image 2018, https://www.envisionexperience.com/blog/virtual-reality-revolutionary-or-revolting, (accessed June 30, 2025).

- WGIC Secretariat, Digital Synergy Project, World Geospatial Industry Council (WGIC), Image, 2024, https://wgicouncil.org/digital-synergy-project-helsinki-finland/, (accessed June 30, 2025).

- VIRNECT, National Museum of Korea AR Docent Pilot Service, Online Video, 2019, https://www.youtube.com/watch?v=DHiTt0z2RxA&t=1s, (accessed June 30, 2025).

-

Clark. A, Surfing Uncertainty: Prediction, Action, and the Embodied Mind, Oxford: Oxford University Press, pp.111-138, October, 2015.

[https://doi.org/10.1093/acprof:oso/9780190217013.003.0005]

-

P. Dourish, Where the Action Is: The Foundations of Embodied Interaction, The MIT Press, pp.99-126, October, 2001.

[https://doi.org/10.7551/mitpress/7221.001.0001]

-

L.Shapiro, Embodied Cognition, Routledge, Taylor & Francis Group, pp.51-69, 2010.

[https://doi.org/10.4324/9781315180380]

- Microsoft, Kinect for Windows SDK 2.0 Documentation, Microsoft Corporation, pp.7-10, 2014, https://download.microsoft.com/download/6/7/6/676611b4-1982-47a4-a42e-4cf84e1095a8/kinecthig.2.0.pdf, (accessed July 2, 2025).

- Microsoft, Kinect for Windows Sensor Components and Specifications, Image, Microsoft Corporation, 2018, https://learn.microsoft.com/en-us/previous-versions/windows/kinect-1.8/jj131033(v=ieb.10) (accessed July 16, 2025).

- L. Jamhoury, Understanding Kinect V2 Joints and Coordinate System, Image, Medium, https://lisajamhoury.medium.com/understanding-kinect-v2-joints-and-coordinate-system-4f4b90b9df16, (accessed June 30, 2025).

- Microsoft, Kinect for Windows SDK 2.0 Documentation, Microsoft Corporation,pp.77-90, 2014, https://download.microsoft.com/download/6/7/6/676611b4-1982-47a4-a42e-4cf84e1095a8/kinecthig.2.0.pdf, (accessed July 4, 2025).

- Microsoft Learn, “Azure Kinect and Kinect Windows v2 comparison”, https://learn.microsoft.com/en-us/previous-versions/azure/kinect-dk/windows-comparison, (accessed Jun. 30, 2025).

-

R. Ascott, Telematic Embrace. Visionary Theories of Art, Technology, and Consciousness, University of California Press, Vol.38, No.2, pp.34-35, April, 2005.

[https://doi.org/10.1162/leon.2005.38.2.162a]

-

M. Slater, D. Perez-Marcos, H.Ehrsson, and M. Sanchez-Vives, “Towards a Digital Body: The Virtual Arm Illusion”, Frontiers in Human Neuroscience, Vol.2, No.6, 2008. (accessed July 4, 2025).

[https://doi.org/10.3389/neuro.09.006.2008]

-

D. Pagliari, and L. Pinto, “Calibration of Kinect for Xbox One and Comparison between the Two Generations of Microsoft Sensors”, MDPI, Vol.15, No.11, 27569-27589, 2015. (accessed Apr. 15, 2025)

[https://doi.org/10.3390/s151127569]

-

B. Latour, On the Difficulty of Being an ANT: An Interlude in the Form of a Dialog, Oxford University Press, pp.141-156, 2005.

[https://doi.org/10.1093/oso/9780199256044.003.0008]

-

C. Spearman, “General Intelligence, Objectively Determined and Measured”, American Journal of Psychology, Vol.15, No.2, pp.201-293, 1904.

[https://doi.org/10.2307/1412107]

-

S. Siegel, Castellan, and N. J. Castellan Jr, Nonparametric Statistics for the Behavioral Sciences (2nd ed.), Mcgraw-Hill Book Company, pp.13-19, 1988.

[https://doi.org/10.1177/014662168901300212]

- Cogburn Research Group, 1000 Cut Journey, Columbia University, 2019, https://cogburnresearchgroup.socialwork.columbia.edu/research-projects/1000-cut-journey, (accessed June 30, 2025).

- J. Rabinovitz, Virtual Reality Experience Aims to Raise Personal Awareness of Racism’s Effects, Digital Education, Standford University, 2023, https://digitaleducation.stanford.edu/news/virtual-reality-experience-aims-raise-personal-awareness-racisms-effects, (accessed June 30, 2025).

- J. Wakefield, Virtual Reality Looks for a Role in Journalism, BBC, 2015, https://www.bbc.com/news/technology-32052296, (accessed June 30, 2025).

- C. Milk, How virtual reality can create the ultimate empathy machine, TED, 2015, https://www.ted.com/talks/chris_milk_how_virtual_reality_can_create_the_ultimate_empathy_machine, (accessed July 2, 2025).

- United Nations, United Nations Virtual Reality(UNVR), SDG Action Zone, 2015, https://sdgactionzone.org/vr/, (accessed Jul. 2, 2025).

- I. Beavers, About Isabel Beavers, ND, https://www.isabelbeavers.com/about, (accessed July 2, 2025).

- I. Beavers, Arctic Lab 2017, 2017, https://www.isabelbeavers.com/arctic-lab, (accessed July 2, 2025).

- I. Beavers, Tomb Keepers(Rise), 2024, https://www.isabelbeavers.com/tomb-keepers-rise, (accessed July 2, 2025).

-

J. Sweller, “Cognitive Load During Problem Solving: Effects on Learning”, Cognitive Science, Vol.12, No.2, pp.257-285, 1988.

[https://doi.org/10.1016/0364-0213(88)90023-7]

- The Climate Museum, Our Vision, ND, https://www.climatemuseum.org/vision, (accessed Apr. 15, 2025).

- 홍익대학교 디자인컨버전스 학과

- ORCID : https://orcid.org/0009-0000-5041-2706

- 주관심분야 : Immersive Media, Physical UX, Service Design

- 2019년 8월 : Goldsmiths, University of London, BA Design

- 2021년 8월 : Royal College of Art, MA Design Products

- 2021년 10월 ~ 2024년 4월 : (주)더퀘스트 디자인 R&D 디렉터

- 2024년 5월 ~ 현재 : 계원예술대학교 실감미디어 혁신융합대학(COSS) 특임교수

- ORCID : https://orcid.org/0009-0007-6775-7613

- 주관심분야 : ESG, Public Health & Safety, Digital Twin, Immersive Media