ATSC 3.0을 위한 햅틱: ATSC A/380 권고안 소개 및 도전과제

Copyright © 2024 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

ATSC A/380 권고안은 ATSC 3.0 방송 콘텐츠에 햅틱 피드백을 통합하기 위한 프레임워크를 제공하여 시청각 경험에 촉각적 차원을 추가하여 시청자 참여를 향상시킨다. 본 논문에서는 ATSC A/380 권고안에서 소개하는 통합 프로세스, 기술 워크플로우, 방송에서 햅틱 기반 콘텐츠의 이점 등을 소개하며 추가적인 도전과제에 대해 설명한다.

Abstract

The ATSC A/380 recommendation provides a framework for integrating haptic feedback into ATSC 3.0 broadcast content to enhance viewer engagement by adding a tactile dimension to the audiovisual experience. This paper introduces the integration process, technical workflow, and benefits of haptic-based content in broadcast as outlined in the ATSC A/380 recommendation, and discusses additional implications.

Keywords:

Haptics, ATSC 3.0, BroadcastingⅠ. 서 론

사용자에게 촉각 피드백을 제공하는 햅틱 기술은 최근 다양한 가전제품에 널리 보급되어 모바일 장치, 게임 및 가상 현실에서 사용자 상호 작용을 풍부하게 한다. 또한, 햅틱을 통한 광고는 소비자의 관심을 끌고 브랜드에 대한 호감도를 높여 구매 의도를 유도하는 데 효과적인 것으로 알려져 있다. 이에 발맞춰 ATSC A/380 권고안(Recommended Practice)[1]에서는 보다 몰입감 있고 매력적인 시청 경험을 제공하는 것을 목표로 ATSC 3.0에 햅틱을 통합하는 방법을 다룬다. 햅틱 피드백 사용을 표준화함으로써 ATSC A/380 문서는 방송사, 콘텐츠 제작자 및 장치 제조업체를 위한 지침을 제공한다. ATSC A/380 권고안은 햅틱을 ATSC 3.0 방송 스트림의 일부로 만드는 것을 목표로 하며 이를 위해 ATSC 3.0에서 사용하는 전송 프로토콜인 DASH/ROUTE 및 MPEG MMT 표준에서 햅틱의 표준화 과정을 거쳐야 한다[2,3]. 그래서 표준화가 이루어지기 전까지 햅틱을 이벤트 스트림의 일부로 보내거나 별도의 클라우드에 저장하여 A/V와 함께 동기화를 진행하여 재생하는 방법을 사용한다. 따라서 본 논문에서는 ATSC 3.0 방송의 햅틱 피드백 통합에 중점을 두고 ATSC A/380 권고안에 대해 이해하기 쉬운 개요를 제공한다. 이는 독자들에게 ATSC 3.0 프레임워크 내에서 햅틱 기술의 잠재력, 기술적 작업 흐름, 실제 구현 방안, 권장 사례 등에 대한 정보를 더욱 쉽게 제공할 수 있을 것으로 기대한다. 더 나아가 권고안에서 다루는 단일 Actuator뿐만 아니라 최근 다양한 햅틱 수신 장비의 증가에 따라, 이러한 다중 Actuator 환경에서의 햅틱 전달 방식에 대해서도 다룬다. 특히 다중 Actuator의 동기화와 상호작용 방식, 다양한 지점에서의 정밀한 촉각 표현을 위한 제어 기법 등은 보다 현실감 있고 몰입적인 경험을 제공하는 데 중요한 요소가 된다. 본 논문에서는 이러한 다중 Actuator 환경에서의 구현 방안과 기술적 도전에 대해서도 다루며 사용자 경험을 최대화하기 위한 권장 접근 방법을 제안한다.

Ⅱ. ATSC A/380 권고안 소개

1. 햅틱의 정의

햅틱 기술은 스마트폰과 태블릿 같은 모바일 기기에서 터치 기반 피드백을 제공할 뿐만 아니라, 별도의 장비를 통해서도 햅틱 피드백을 느낄 수 있다[4]. 예를 들어, 스마트폰이나 인터페이스를 조작할 때 사용자에게 진동과 같은 피드백을 제공할 수 있다. 이러한 햅틱 기술은 다양한 상황에서 경험할 수 있다. 라이브로 진행하는 스포츠 경기에서 선수들의 동작과 관련한 햅틱을 별도의 장비를 통해 제공받을 수 있다. 야구 경기에서는 선수가 안타를 치거나 공을 잡았을 때 햅틱 피드백을 제공함으로써 경기에 대한 전반적인 몰입감을 높일 수 있다. 액션 영화에서는 추격전이나 폭발 장면에서 햅틱 피드백을 의자 같은 환경에 적용하여 관객에게 생동감 있는 경험을 제공하며 광고에서도 햅틱을 활용해 소비자의 이목을 끌고 구매율을 상승시키는 데 효과적이다.

2. 장치 특성에 따른 햅틱 시나리오

햅틱을 재생하는 물리적 장치인 Actuator는 모바일 기기뿐만 아니라 게임 컨트롤러, 대형 스크린 등 다양한 기기에 내장되어 각각의 방식으로 햅틱을 재생한다. Actuator가 내장된 기기와 아닌 기기로 분류할 수 있으며, 최근에는 여러 Actuator가 내장된 기기가 점차 늘어나고 있다. ATSC A/380 권고안에 따르면 기기는 방송 스트림을 방송사가 직접 수신할 수 있는지 여부에 따라 PD(Primary Device) 또는 CD(Companion Device)로 분류된다. PD는 ATSC 3.0 수신기능을 내장하여 방송 스트림을 직접 받을 수 있는 기기이며, CD는 이러한 기능이 없는 보조 기기이다. 이에 따라 발생하는 두 가지 시나리오를 고려한다.

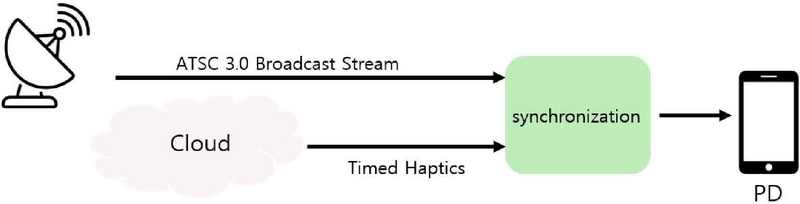

그림 1과 같이 Actuator가 내장된 모바일 기기를 PD로 사용하는 경우 ATSC 3.0 Broadcast를 통해 제공되는 A/V 콘텐츠와 별도의 클라우드에 저장된 햅틱 파일을 동기화 과정을 거쳐 모바일 기기(PD)에서 A/V 콘텐츠와 햅틱을 경험할 수 있다.

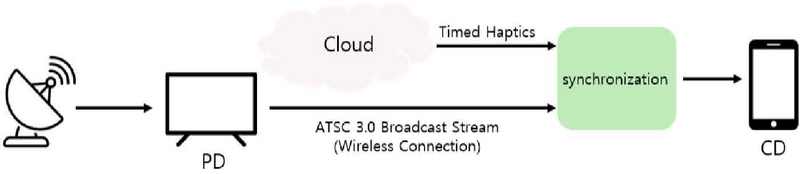

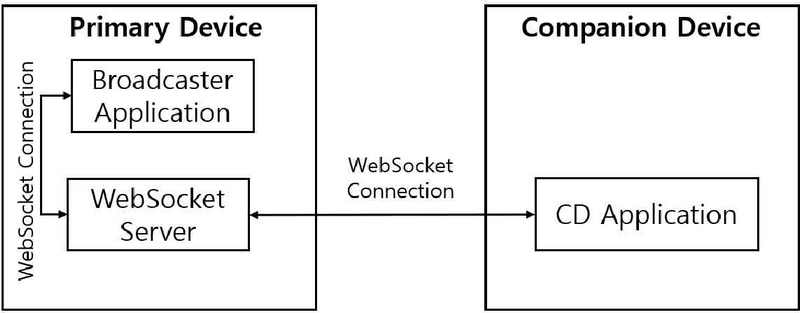

Actuator가 내장되지 않은 TV를 PD로 사용하는 경우 TV는 ATSC 3.0 Broadcast에서 제공하는 A/V만 송출할 수 있다. 그래서 그림 2와 같이 햅틱 기능이 지원되는 모바일 기기(CD)를 별도로 사용한다. 그 후 그림 3과 같이 PD에 존재하는 웹 소켓 서버를 통해 CD로 무선 연결되어 A/V 콘텐츠가 전달되고 별도의 클라우드에 저장된 햅틱 파일과 동기화 과정을 통해 모바일 기기(CD)로 재생할 수 있다[5].

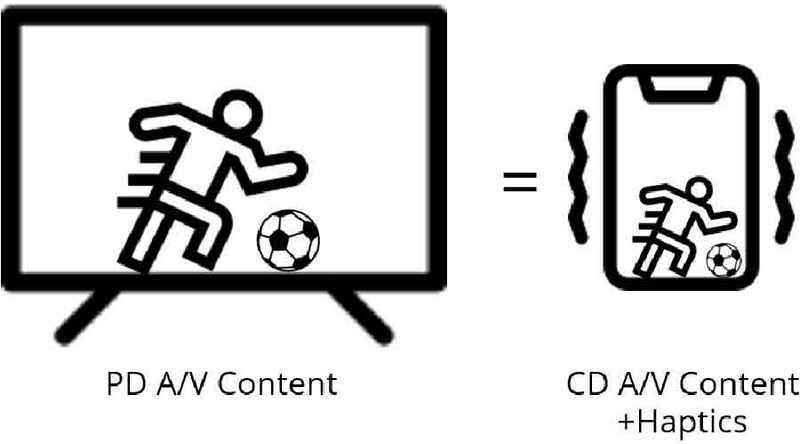

PD에서 제공하는 A/V 콘텐츠와 CD에서 제공하는 A/V 콘텐츠는 서로 같을 수도 있고 다를 수도 있다. 예를 들어 그림 4와 같이 콘텐츠가 동일한 경우, 거실에서 TV(PD)를 통해 축구 경기를 시청하고 있다고 가정한다면 이 TV는 Actuator가 내장되어 있지 않기 때문에 시청자는 A/V 콘텐츠만 제공받게 된다. 그러나 다른 방에서는 CD 애플리케이션을 통해 모바일 기기(CD)에서도 동일한 축구 경기를 시청할 수 있으며, 이 모바일 기기에는 Actuator가 내장되어 있어 시청자가 축구 경기와 관련된 촉각 피드백을 경험할 수 있다. 이러한 경우, 같은 콘텐츠가 두 기기에서 재생되지만, 햅틱 경험은 CD를 통해서만 가능하다.

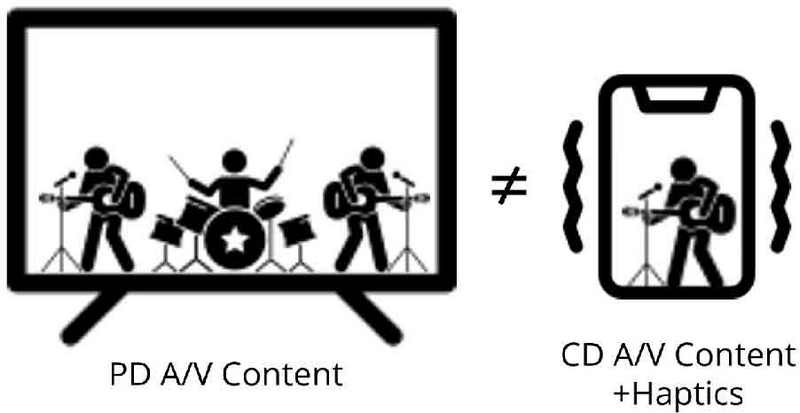

반면, 그림 5와 같이 콘텐츠가 서로 다른 경우도 존재한다. 예를 들어, TV(PD)를 통해 밴드 공연을 시청할 때, TV에는 Actuator가 없어 A/V 콘텐츠만 제공된다. 그러나 모바일 기기(CD)에서는 CD Application을 통해 밴드 공연의 특정 사람에 집중한 개인화된 콘텐츠를 시청하며, 동시에 이 모바일 기기의 Actuator를 통해 공연 중의 진동이나 리듬과 같은 햅틱 피드백을 경험할 수 있다. 이처럼 동일한 공연을 다르게 소비할 수 있는 옵션이 제공되며, PD와 CD의 역할에 따라 사용자 경험이 차별화될 수 있다. 본 논문에서는 TV를 PD로, 모바일 기기를 CD로 사용하는 시나리오에 중점을 두며, 이러한 설정을 통해 ATSC 3.0 방송에서의 햅틱 경험 통합을 구체적으로 다룬다.

3. 햅틱 파일 크기에 따른 흐름도

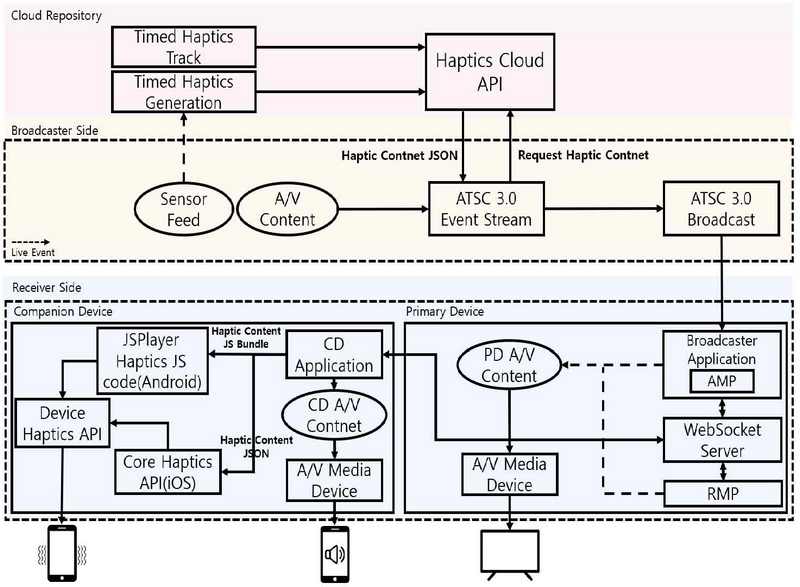

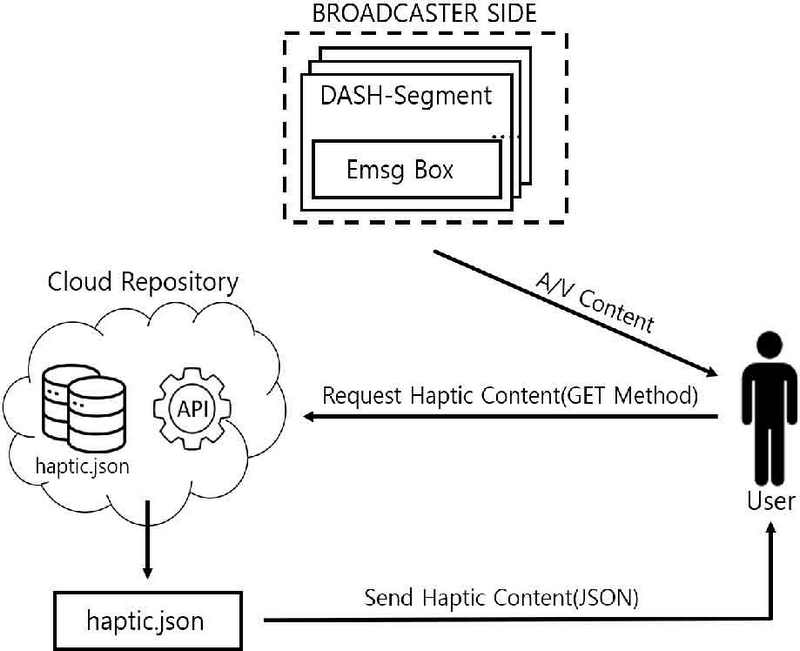

햅틱 파일 크기는 콘텐츠에 따라 다르게 존재한다. 주변의 소음이나 사소한 잡음 등 간헐적인 액션만 있는 콘텐츠의 햅틱 파일 크기는 작고, 격렬한 액션이 있는 콘텐츠의 햅틱 파일 크기는 더 크게 존재한다. ATSC 3.0에서는 그러한 햅틱 파일 크기에 따라 전송 방식에 차이를 두고 있다. 햅틱 파일 크기가 작은 경우, 그림 6과 같이 Broadcaster 측에서는 해당 콘텐츠에 대한 content ID를 사용하여 별도의 클라우드에 저장된 햅틱 JSON 파일을 ATSC 3.0 Event Stream에 담아 ATSC 3.0 Broadcast로 전송이 이루어진다. 그때 사용되는 GET 메서드는 아래와 같이 사용하여 요청할 수 있다.

GEThttps://<user>:<password>@<server>:<contentport>/query?contentID=<content_id>

여기서 <user>는 저장소에 알려진 broadcaster ID, <password>는 broadcaster 암호, <server>는 햅틱 클라우드 저장소 URL, <contentport>는 햅틱 콘텐츠를 제공하는 REST 서버의 포트 번호, <contentID>는 햅틱 콘텐츠 ID를 의미한다.

Receiver 측은 PD에서 AMP(Application Media Player)와 RMP(Receiver Media Player)를 통해 PD A/V Content가 A/V Media Device로 재생된다. 그리고 웹 소켓 연결을 통해 CD Application을 거쳐 CD A/V Content가 A/V Media Device로 재생된다. 햅틱 재생을 위해서는 CD Application에서 Android와 iOS 또는 별도의 수신 장치 환경에 맞춰 개발자가 애플리케이션에 맞춤형 햅틱 피드백을 통합할 수 있다. 수신 장치가 Android인 경우 전용 자바스크립트 플레이어 코드인 JSPlayer Haptice Code를 사용하며, iOS의 경우 CoreHaptice API를 사용해 기기별 API를 통해 Device Haptics API에서 렌더링을 거쳐 햅틱을 재생한다[6].

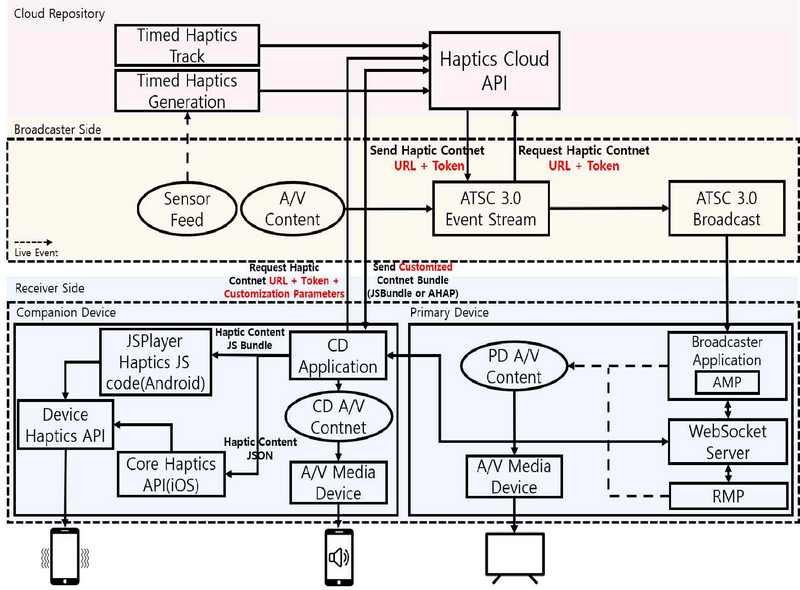

햅틱 파일 크기가 클 경우, 클라우드에서 JSON 햅틱 파일을 직접적으로 불러오기 어려울 수 있다. 따라서 그림 7과 같이 Broadcaster 측에서는 햅틱 파일의 URL과 인증 토큰을 이용해 ATSC 3.0 Event Stream에 포함시켜 ATSC 3.0 Broadcast로 전송한다. 이때 GET 메서드는 <contentport> 대신에 <URLport>를 사용하여 URL을 받는다.

GEThttps://<user>:<password>@<server>:<URLport>/query?contentID=<content_id>

여기서 <URLport>는 햅틱 콘텐츠 URL을 제공하는 REST 서버 포트 번호를 의미한다.

Receiver 측 PD의 경우 햅틱 파일 크기가 작은 경우와 같다. CD Application에서는 햅틱 파일의 URL과 인증 토큰을 가지고 아래와 같이 클라우드에 있는 햅틱 파일을 불러오는 역할을 수행한다.

GEThttps://<server>:<contentport>/query?fileID=<fileURL>&auth=<authtoken>

여기서 <fileURL>는 햅틱 파일 URL, <authtoken>는 인증 토큰을 의미한다.

사용자는 햅틱에 대한 맞춤화를 진행할 수 있다. GET 메서드에 <userpref>와 <actuator_type>을 추가해 사용자가 경험할 햅틱의 선호도 값과 Actuator의 유형 등을 설정할 수 있으며, 이를 통해 같은 햅틱을 제공받더라도 사용자가 원하는 정도로 조정할 수 있다.

GEThttps://<server>:<contentport>/query?fileID=<fileURL>&auth=<authtoken>&userpref=<userpref>&acttype=<actuator_type>

여기서 <userpref>는 사용자 선호도 값, <actuator_type>는 Actuator 유형을 의미하며, 모두 선택사항이다. 사용자 맞춤화 과정은 그림 7과 같이 파일 크기가 큰 경우에 이루어진다. 맞춤화 정보들을 CD Application에서 URL과 인증 토큰을 바탕으로 햅틱 파일에 접근해야 하는데 파일 크기가 작은 경우에는 CD Application에서 URL 또는 인증 토큰을 주고받지 않기 때문에 이러한 맞춤화 과정이 불가능하다.

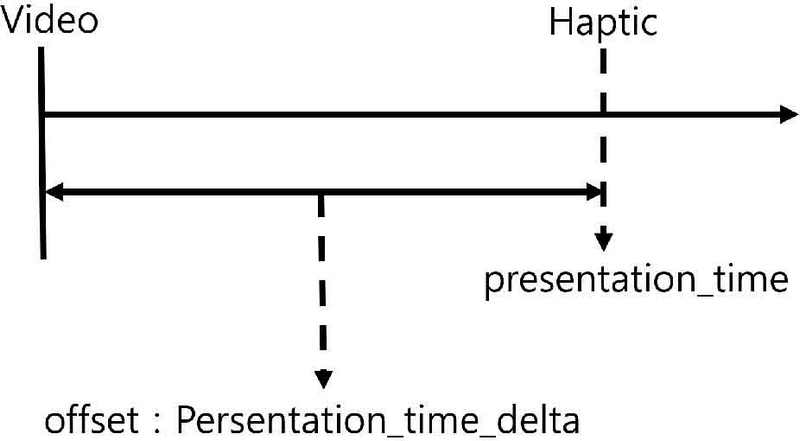

CD Application은 햅틱 파일이나 URL을 불러오는 역할뿐만 아니라 그림 8과 같이 A/V와 햅틱의 동기화 작업도 수행한다. 이 동기화 작업은 햅틱 재생 시간을 나타내는 Presentation_time 필드와 햅틱 재생 시간과 영상 재생 간의 오프셋을 나타내는 Presentation_time_delta 필드를 기반으로 이루어진다[3].

4. 사용자 맞춤화

앞서 설명한 것처럼, 사용자마다 햅틱 경험에 대한 선호도가 다를 수 있다. 어떤 사용자는 햅틱을 충분히 즐기고 싶을 수 있고 반면 최소한의 햅틱만을 원할 수도 있다. 이러한 다양한 요구를 반영하기 위해 CD Application에서는 값을 조절할 수 있다. <userpref>는 minimum, typical, maximum으로 선택 가능하며, 이 중에서 minimum과 maximum은 라이브 스포츠 시청 시 선택할 수 있다. minimum은 경기에서 주요 이벤트만 경험하고 싶을 때나 라이브 스포츠 중 광고에서 햅틱을 지원받고 싶지 않을 때 설정할 수 있다. 반면 maximum은 경기 중 발생하는 모든 이벤트를 경험하고 싶을 때 설정한다. typical은 일반적인 비디오 콘텐츠에 사용되며, 스포츠 콘텐츠에는 적용되지 않는다.

또한 사용자마다 보유한 Actuator의 종류가 다를 수 있기 때문에 <actuator_type>은 SD, HD로 구분되며 Actuator의 성능에 따라 구분된다. SD에는 대표적으로 ERM과 Narrowband LRA가 있으며, HD에는 Wideband LRA, VCM, Piezoelectric이 포함된다. 각각의 Actuator는 서로 다른 방식으로 햅틱을 생성하며 <actuator_type>의 기본값은 SD로 설정한다.

5. MPD(Media Presentation Description) 시그널링

햅틱 콘텐츠의 전달 및 동기화를 위해 MPD(Media Presentation Description) 시그널링이 필요하다. MPD는 MPEG-DASH의 핵심 요소로, 미디어 콘텐츠의 구조와 속성을 기술하며 콘텐츠의 URL, 기간, 대역폭 등 다양한 정보를 제공하여 재생의 정확한 타이밍을 제어한다. 본 논문에서는 MPD를 통해 햅틱 파일의 타이밍 정보를 제공함으로써 A/V 콘텐츠와 햅틱 피드백이 동기화된 재생이 가능하도록 한다. 보다 구체적으로는 MPD에 존재하는 EventStream 또는 InbandEventStream을 통해 전달된다. EventStream은 MPD 내의 Period에 위치하며, 주로 이벤트의 타이밍이 이미 알려진 정적 이벤트를 전달하는 데 사용된다[2]. 그러나 대부분의 햅틱은 라이브 스포츠와 같이 동적인 특성을 가지므로 정적 이벤트를 전달하는 EventStream은 햅틱 파일을 전송하기에 적합하지 않다. 반면 MPD 내부의 Representaion 또는 Adaptaion Set에 위치한 InbandEventStream은 동적 이벤트를 전달하는 데 사용되므로 햅틱 파일을 전송할 때는 MPD 내의 EventStream보다 InbandEventStream을 사용하는 것이 적합하다. 전송 방식의 일관성을 유지하기 위해 햅틱 파일은 InbandEventStream을 사용한다. 따라서 정적 이벤트와 동적 이벤트 모두 InbandEventStream을 통해 전달되며, 식별자를 통해 이벤트를 구분해야 한다. 정적 이벤트의 경우 emsg box의 상위식별자인 @schemeIdUri 값은 “tag:atsc.org,2016:event”이며 하위 식별자 값은 “hpe”이다. 동적 이벤트의 emsg box 상위 식별자는 정적 이벤트와 동일하며 하위 식별자 값은 “hpf”로 구분된다.

Ⅲ. 도전과제

1. 다중 Actuator 시그널링

앞선 ATSC A/380 내용은 Actuator가 하나인 경우의 시그널링 방법을 고려한다. 하지만 햅틱을 제공하는 장비 중에는 단일 Actuator가 아닌 여러 Actuator가 내장된 장비도 존재한다. 따라서 다중 Actuator를 사용할 때의 햅틱 전송 방안과 시그널링 방법이 필요하다. 다중 Actuator가 존재한다면 어느 위치의 Actuator를 작동시킬지에 대한 정확한 위치 정보가 필요하다. 사용자 맞춤화 과정에서 사용된 GET 메소드를 활용하여 다중 Actuator에 대한 추가 정보를 서버에 전송하는 방법을 사용한다. 그림 9는 ATSC 3.0에서 다중 Actuator가 있는 경우에 정보를 어떻게 전송할 것인지 시각화한 그림이다. ROUTE/DASH 기반에서 햅틱 데이터는 각 DASH 세그먼트에 포함된 emsg box에 햅틱 데이터를 받을 수 있는 클라우드 URL과 토큰 형태로 저장된다. 이후 사용자는 emsg box가 포함된 데이터를 수신하고 emsg box에 있는 URL과 토큰을 획득한 뒤 Actuator에 대한 정보가 담긴 <body_prat>을 포함하여 클라우드에 요청한다. 신호를 받은 클라우드는 API를 통해 해당 JSON 파일에서 사용자의 <body_part>에 따른 정보를 반환한다. 마지막으로 사용자는 수신한 데이터를 바탕으로 다중 Actuator가 내장된 장비에서 햅틱과 비디오를 재생한다.

GEThttps://<server>:<contentport>/query?fileID=<fileURL>&auth=<authtoken>&userpref=<userpref>&acttype=<actuator_type>&bodytype=6&bodytype=7

여기서 <server>는 햅틱 클라우드 저장소 URL, <content-port>는 햅틱 콘텐츠를 제공하는 REST 서버의 포트 번호, <fileURL>은 햅틱 파일 URL, <authtoken>는 인증 토큰, <userpref>는 사용자 선호도 값(선택사항), <actuator_type>는 Actuator 유형(선택사항), <body_part>는 Actuator 값(선택사항)을 의미한다.

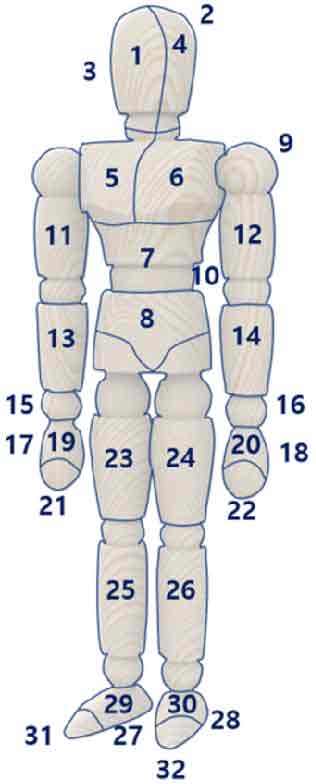

<body_part>는 신체 부위별 번호를 지정하여 어떤 Actuator를 작동시킬지 사용자가 제공하는 정보이다. 표 1은 각 신체 부위의 위치에 대한 정보를 보여준다.

그림 10은 <body_part>를 시각화한 것으로 표와 함께 다양한 신체 부위를 쉽게 표현할 수 있다. 또한 값을 추가하여 더 세부적인 신체 부위를 표현하는 것도 가능하다.

Ⅳ. 결 론

본 논문은 ATSC 3.0 방송에서 햅틱 피드백을 통합하기 위한 ATSC A/380 권고안의 개요와 관련 도전과제를 제시하였다. ATSC A/380 권고안은 방송 콘텐츠에 촉각적 요소를 추가하여 시청자에게 보다 몰입적이고 생동감 있는 경험을 제공하기 위해 설계되었으며 이를 구현하기 위한 기술적 작업 흐름과 햅틱 통합 방식을 구체적으로 설명하였다. 또한, 다중 Actuator 환경에서의 햅틱 전달 방식과 사용자 맞춤형 햅틱 경험을 제공하기 위한 기술적 도전과제를 다루어 다양한 시나리오에서의 햅틱 통합 방안을 탐구하였다. 본 논문을 통해 독자들은 ATSC 3.0 프레임워크 내에서 햅틱 기술의 잠재력과 이를 구현하기 위한 구체적 접근 방법을 이해할 수 있을 것으로 기대한다. 이를 바탕으로 방송사와 콘텐츠 제작자들이 ATSC 3.0 방송을 활용하여 더 몰입감 있는 시청 경험을 제공하고, 방송 콘텐츠의 가치를 높이는 데 기여할 수 있을 것이다.

Acknowledgments

이 논문의 연구 결과 중 일부는 한국방송·미디어공학회 2024년 하계학술대회에서 발표한 바 있음.

This work was supported by the Electronics and Telecommunications Research Institute (ETRI) grant funded by the Korean government. [24ZC1100, The Research of The Basic Media Contents Technologies].

References

- ATSC, Haptics for ATSC 3.0, ATSC Recommended Practices A/380:2024-04, 3 April 2024.

- ATSC, Signaling, Delivery, Synchronization and Error Protection, ATSC Standard A/331:2024-04, Advanced Television Systems Committee, Washington, DC, 3 April 2024.

- ISO/IEC, Information technology – Dynamic adaptive streaming over HTTP (DASH) – Part 1: Media presentation description and segment formats, ISO/IEC FDIS 23009-1:2019(E), August 2019.

- ATSC, ATSC 3.0 System, ATSC Standard A/300:2024-04, Advanced Television Systems Committee, Washington, DC, 3 April 2024.

- ATSC, Companion Device, ATSC Standard A/338:2024-04, Advanced Television Systems Committee, Washington, DC, 3 April 2024.

- ATSC, ATSC 3.0 Interactive Content, ATSC Standard A/344:2024-04, Advanced Television Systems Committee, Washington, DC, 3 April 2024.

- 2019년 ~ 현재 : 한남대학교 정보통신공학과 학·석사통합과정

- ORCID : https://orcid.org/0009-0009-2798-7662

- 주관심분야 : 실감미디어 통신, ATSC 3.0 방송 시스템

- 2019년 ~ 현재 : 한남대학교 정보통신공학과 학·석사통합과정

- ORCID : https://orcid.org/0009-0005-7924-6445

- 주관심분야 : 실감미디어 통신, 저지연 스트리밍, 3차원 스트리밍

- 2017년 ~ 현재 : 한남대학교 정보통신공학과 학·석사통합과정

- ORCID : https://orcid.org/0009-0005-5152-5856

- 주관심분야 : 실감미디어 통신, 데이터 캡슐화, 미디어 스트리밍

- 1994년 : 국민대학교 전자공학 졸업

- 1996년 : 국민대학교 전자공학 공학석사

- 2008년 : 국민대학교 전자공학 공학박사

- 2008년 ~ 현재 : 한국전자통신연구원(ETRI) 책임연구원

- ORCID : https://orcid.org/0000-0001-5052-3844

- 주관심분야 : 지상파 및 모바일 DTV, 3DTV 및 UHD 방송 시스템

- 2012년 : 서울과학기술대학교 매체공학 졸업

- 2014년 : 서울과학기술대학교 미디어IT공학 공학석사

- 2018년 : 서울과학기술대학교 방송정보통신융합공학 공학박사

- 2018년 ~ 2021년 : 독일 드레스덴공과대학교 도이치텔레콤연구그룹 선임연구원

- 2021년 ~ 현재 : 한남대학교 정보통신공학과 조교수

- ORCID : https://orcid.org/0000-0003-3724-3244

- 주관심분야 : 실감미디어 통신, 다중감각 통신, 저지연 통신 네트워크