RUnet : U-Net 기반 각도 분해 광전자 방출 분광법 영상 디노이징

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

본 논문에서는 각도 분해 광전자 방출 분광법(Angle-Resolved Photoemission Spectroscopy, ARPES) 데이터 디노이징에 특화된 RUnet을 제안한다. U-Net 기반의 디노이징 네트워크는 디노이징 성능이 뛰어나지만, 광범위 노이즈 구간에서 일관성 있는 성능을 내기 어렵다. 반면 오토인코더 기반 ARPESNet은 전 노이즈 구간에서 일관성 있는 디노이징 성능을 보이지만 세밀한 특징의 복원 성능이 떨어지는 단점이 있다. 따라서 제안하는 RUnet은 학습 영상의 노이즈 강도를 강, 중, 약으로 구분하여 학습을 수행할 뿐만 아니라, 압축-활성화(Squeeze-and-Excitation) 기법을 디코더 단 합성곱 층(Convolution layer)의 끝단에 적용하여 디노이징 성능을 획기적으로 개선한다. 그 결과 제안 방법은 ARPES 영상 데이터의 노이즈 특성을 기존 방법 대비 세밀하게 추출하며 최신 기법 대비 PSNR 및 MS-SSIM 기준 평균 4.79dB 및 평균 0.0217의 개선 결과를 보인다.

Abstract

This paper proposes an RUnet, specialized for Angle-Resolved Photoemission Spectroscopy (ARPES) data denoising. A U-Net based denoising network exhibits excellent performance, however it is difficult to consistently maintain denoising performance for a wide range of noise levels. An autoencoder network maintains consistent denoising performance for all ranges of noise levels, yet it performs lower denoising performance than the U-Net based method. In order to increase the denoising performance for all ranges of noise levels, the proposed RUnet makes some categories such as high-, medium-, and low-range in accordance with the noise intensity for training. In addition, by applying the squeeze-and-excitation technique at the end of convolution layers in the decoder parts to efficiently gather the noise features, the proposed RUnet can significantly improve the denoising performance. As a result, the proposed RUnet can extract noise characteristics of ARPES image data in greater detail, thus it achieves average improvements of 4.79 dB in PSNR and 0.0217 in MS-SSIM compared to the state-of-the-art methods.

Keywords:

Denoising, Angle-Resolved Photoemission Spectroscopy (ARPES), U-Net, Attention MechanismⅠ. 서 론

각도 분해 광전자 방출 분광법(Angle-Resolved Photoemission Spectroscopy, ARPES)은 물질 내 전자의 에너지와 운동량을 측정하는 실험 기법으로서, 고체 물질의 밴드구조와 전자 상태를 조사하는 방법이다[1]. 이는 빛을 물질 표면에 분사하여 방출된 광전자를 검출함으로써 전자의 결합에너지와 2차원 운동량 분포를 측정할 수 있으며, 이를 바탕으로 다양한 물질의 전자구조를 분석하는데 활용된다[2-3]. 하지만 ARPES 영상 데이터를 수집하는 과정에서 푸아송(Poisson) 분포 형태의 노이즈가 발생한다고 알려져 있다[4-6]. 이는 광전자 검출 과정에서 전자가 통계적 확률분포를 따르기 때문인데, 노이즈가 심할수록 신호 대 잡음비(Signal-to-Noise Ratio, SNR)가 낮아져 데이터를 해석하기가 어렵다. 따라서 이를 해결하기 위해서는 광전자 방출 측정시간을 증가시켜 전자를 충분히 집계함으로써 통계적 잡음을 줄이는 방법이 있다. 그러나 이를 위해서는 광전자 방출 장치의 운용 시간 증대에 따른 비용 부담이 증가된다.

최근에는 이러한 문제를 해결하기 위해 딥러닝 기반 영상 처리 기법이 ARPES 영상 데이터 분석에 도입되고 있다[6-7]. 특히 심층 신경망 구조를 활용하면서 데이터의 특징을 학습하여 데이터의 노이즈 성분과 물리적 신호 성분을 효율적으로 구분해 낼 수 있다. 오토인코더 기반의 ARPESNet은 ARPES 영상 데이터를 낮은 잠재공간으로 압축하고, 해당 정보를 복원하는 과정을 통해 노이즈를 제거함으로써 실시간으로 정보를 처리하였다[7]. 이러한 방식을 사용하면 광전자 방출 측정시간을 증가시키지 않아도 되는 장점이 있으므로 시간과 자원 측면에서 효율성이 높다. 하지만 ARPESNet은 단순 오토인코더 구조의 모델이므로 강한 노이즈 영상이나 높은 해상도 영상의 노이즈 제거에 한계가 있다. 따라서 고정밀 물성분석을 위해서는 고해상도 저노이즈 영상이 필수적이기 때문에 노이즈 제거 효율이 큰 새로운 모델의 적용이 필요하다. 본 논문의 구성은 다음과 같다. 제 2장에서는 ARPES 데이터의 노이즈 특성과 제안 모델의 기반이 되는 U-Net 구조, 채널 어텐션 매커니즘, 데이터 생성 및 증강 방법에 대해 설명한다. 제 3장에서는 제 2장에서 기술한 내용을 바탕으로 ARPES 영상 디노이징 성능을 향상시키기 위한 제안 RUnet 모델의 구체적인 설계와 학습 전략을 기술한다. 제 4장에서는 제안 모델의 성능을 기존 방법들과 비교하고, 마지막으로 제 5장에서는 본 연구의 결론을 제시한다.

Ⅱ. 관련 연구

딥러닝 기반 노이즈 제거 기술은 다양한 네트워크 모델 구조를 통해 발전해 왔다[8]. 초기에는 기본적인 합성곱 신경망(Convolutional Neural Network, CNN) 구조를 많이 이용하였는데, 이는 각 레이어에 합성곱 연산을 수행하며 국소적인 영역의 특징을 추출하는 방식이다. 즉, CNN 네트워크 모델의 출력 영상을 노이즈가 없는 원본 영상과 비교하여 오차를 줄여가는 방식으로 디노이징 네트워크를 구성하였다[9]. 디노이징 합성곱 신경망(Denoising Convolutional Neural Network, DnCNN)은 네트워크가 직접 깨끗한 이미지를 예측하기 보다는 노이즈를 직접 예측하도록 학습하는 잔차학습(Residual learning) 방식을 이용하였다[10]. 이를 통하여 학습 시의 기울기 소실문제를 완화하여 학습 성능을 개선하였다.

입력데이터를 저차원의 잠재 표현으로 압축하였다가 다시 복원하는 과정을 학습하는 신경망 구조인 디노이징 오토인코더(Denoising AutoEncoder, DAE)가 디노이징에 사용되었다[11]. DAE에는 두 가지 방법이 사용되는데, 첫 번째 방법은 오토인코더의 입력에 노이즈 영상을 넣어 출력된 영상과 노이즈가 없는 원본 영상을 비교하는 Noisy-Clean 방법이다. 두 번째 방법은 오토인코더 출력 영상과 노이즈 영상을 비교하는 Noisy-Noisy 방법이다[12]. 적대적 생성 신경망(Generative Adversarial Network, GAN) 구조도 디노이징에 사용되었는데, GAN은 이미지 생성, 변환, 복원 등 다양한 응용에 사용되는 신경망 구조로서, 적대적 신경망이라는 이름처럼 생성기(Generator)와 판별기(Discriminator)의 두 모델이 경쟁하는 방식으로 학습을 수행한다. 특히 적대적 디노이징 오토인코더(Denoising Adversarial Autoencoder, DAA)의 생성기는 노이즈 영상을 입력받아 노이즈가 제거된 영상을 생성하려고 시도한다. 반면 판별기는 입력된 영상이 실제 영상인지 노이즈가 제거된 가짜 영상인지를 구분하려고 한다[13]. 판별기는 가짜 영상을 잘 식별하고자 학습하고 생성기는 판별기를 속일 수 있도록 학습하면서 원본 영상에 근접한 노이즈 제거 영상을 만들어낸다.

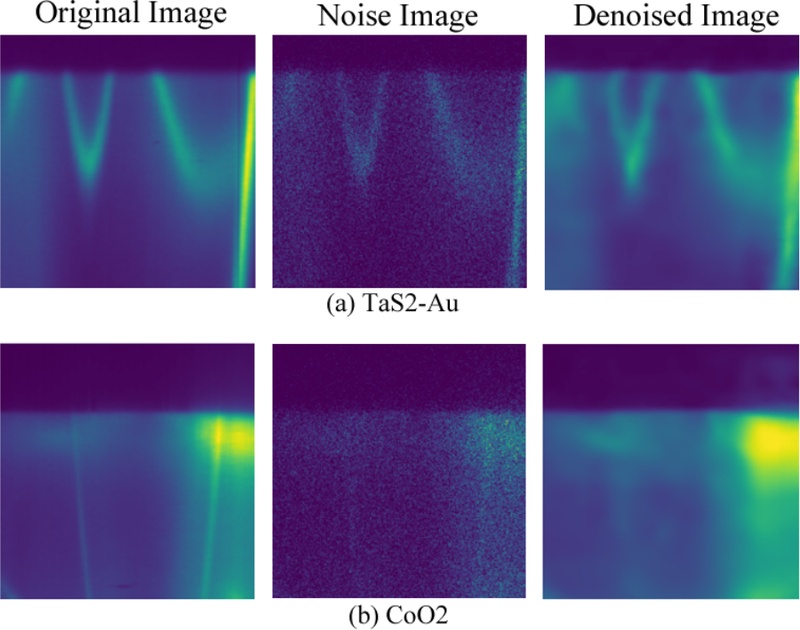

딥러닝 기술의 발전과 함께 영상 노이즈 제거를 위한 다양한 네트워크 구조가 제안되었다. 하지만 특징맵을 추출하는 과정이나 잠재표현으로 변환하는 네트워크의 특성상 영상의 원 정보가 소실되어 노이즈 제거 효율성이 떨어질 수 있다. 그림 1은 기존 오토인코더 방식의 디노이징 결과를 보여준다[7]. 그림 1에서 볼 수 있듯이, 기존의 방법은 디노이징 결과 ARPES 영상 데이터 분석에 중요한 정보인 전자 밴드구조 및 에지 성분 정보가 손실되는 현상이 발생하였다. 따라서 ARPES 영상 데이터의 정밀 분석을 위해 중요 에지 정보를 보존하면서도 그 외 영역을 효과적으로 디노이징 할 수 있는 새로운 노이즈 제거 기법의 연구가 절실히 필요하다.

U-Net 구조는 기존의 오토인코더에 스킵 연결(Skip-Connection)을 통하여 원본의 특징 정보를 전달해 주기 때문에 기존의 노이즈 제거 신경망 모델 구조와 달리 원본 특징 정보를 더 잘 보존하는 장점이 있다. 따라서 본 논문에서는 U-Net 구조의 네크워크를 기반으로 ARPES 데이터의 디노이징 성능을 개선하는 몇 가지 방법을 제안한다. 먼저, ARPES 영상 데이터 특성에 적합한 디노이징 기법 설명을 위하여 ① U-Net의 기본 구조, ② 푸아송 확률분포를 이용한 APRES 영상 노이즈 모델링, ③ 채널 어텐션 기법을 이용한 중요 정보 특징 보존 방법을 다음의 하부절에 설명한다.

1. U-Net

U-Net은 의료 영상 분할(Segmentation)에 특화된 인코더-디코더 형태의 신경망이다[14]. U-Net의 인코더 부분은 다수의 합성곱 연산, 활성화 함수, 최대 풀링(Max pooling) 계층으로 구성되어 있는데, 인코더는 입력 영상을 점진적으로 다운샘플링 하면서 중요한 특징을 추출하는 역할을 한다. 반면 디코더는 업샘플링과 합성곱 연산을 이용하여 점진적으로 해상도를 복원하는 구성으로 이루어져 있다. 즉, 업컨볼루션 과정을 통해 특징맵의 해상도를 증가시켜 최종적으로 입력과 같은 크기의 출력 이미지를 생성한다. 특히, 인코더와 디코더 사이를 스킵 연결로 직접 연결함으로써, 인코더 단계에서 추출된 특징맵을 디코더 단계에 직접 전달한다. 이를 통해 단순 압축-복원 구조에서 발생할 수 있는 원본 정보의 손실을 방지하고, 세밀한 특징을 유지할 수 있다.

2. 푸아송 잡음 (Poisson noise)

검출기에 닿을 때 측정되는 방출 광전자로 ARPES 영상 데이터를 생성할 수 있는데 이 데이터는 푸아송 분포를 따른다[5,7]. 식 (1)은 푸아송 이산확률분포를 나타낸다. 여기서 λ는 화소별 검출되는 광전자의 평균 개수(=기댓값), n은 실화소에서 검출되는 광전자의 수, e는 오일러 상수이다.

| (1) |

하지만 실화소에서 검출되는 광전자의 수(n)를 화소마다 정확히 계측할 수 없으므로, 화소 마다의 ARPES 영상 데이터의 분포를 추정하기 어렵다. 따라서 ARPES 영상에서 각 화소를 중심으로 한 확률을 근사화하여 추정할 필요가 있다. 식 (2)는 각 화소별 확률을 근사화 추정한 값이며 이는 푸아송 분포를 근사한다.

| (2) |

여기서 N은 총 광전자 수, ij는 영상의 가로, 세로 위치정보, nij는 ij에서 검출된 광전자의 수, Pij는 ij에서의 푸아송 분포를 나타낸다. 즉, 식 (2)는 노이즈가 거의 없는 원본 ARPES 영상(=측정된 방출 광전자의 수가 충분히 큰 영상)의 각 화소에 측정된 강도 정보로부터 각 화소의 푸아송 확률을 추정할 수 있음을 의미한다. 즉, 이는 총 광전자 수를 조정하면 다양한 강도의 ARPES 영상 데이터를 생성할 수 있음을 의미한다. 따라서 본 논문에서는 높은 SNR의 고품질 ARPES 영상 데이터에서 추정한 푸아송 분포를 이용하였고 여기에 총 광전자 수를 조정하여 다양한 강도의 ARPES 영상 데이터 노이즈를 모델링하였다.

3. 채널 어텐션 (Channel attention)

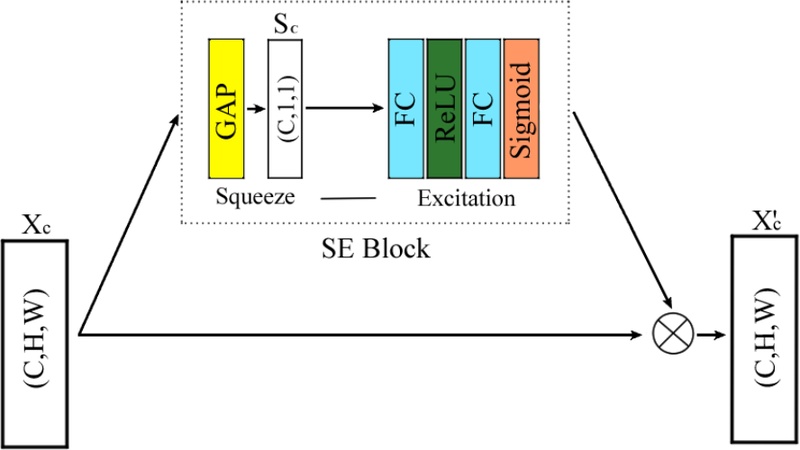

어텐션 메커니즘은 자연어 처리 분야에서 처음 제안된 방법으로 입력데이터의 중요한 부분에 가중치를 더 할당하여 학습하는 방식이다[15]. 논문에서 사용된 채널 어텐션은 합성곱 과정에서 얻어지는 특징맵들 중 ARPES 영상 데이터의 중요한 정보에 높은 가중치를 부여하여 학습 과정에서 데이터의 중요한 특징이 더욱 잘 보존되도록 한다. 그림 2는 채널 어텐션 기법의 전체적인 구조를 보여준다. 그림 2에서 볼 수 있듯이, 채널 어텐션은 압축-활성화(Squeeze-and-Excitation, SE) 블록에서 수행된다. 압축(Squeeze) 단계에서는 전역 평균 풀링(Global Average Pooling, GAP) 연산을 통하여 각 채널에 대하여 해당 채널의 모든 공간 위치 값의 평균을 구한다. 즉, 각각의 채널이 전역적으로 얼마나 활성화되어 있는지를 나타내는 스칼라 값을 얻는다[16]. 식 (3)은 채널별 전역 활성화 정도를 나타낸다.

| (3) |

An overall architecture of channel attention mechanism for channel-wise feature enhancement and suppression

여기서 H, W는 영상의 세로 및 가로 크기, XC는 입력특징맵이 c번째 필터를 통과하여 얻어진 출력특징맵이다. 활성화(Excitation) 단계에서는 압축 단계에서 계산된 SC 값을 두 개의 완전 연결(Fully connected, FC) 층으로 학습하여 각 채널의 전역 활성화 정도가 반영된 중요도를 얻어낸다. 이렇게 얻어낸 중요도 값을 기존의 입력특징맵(XC)에 채널별 곱셈연산(⊗)을 적용하여 중요도에 따라 채널 특성이 강조된 출력특징맵()을 얻는다.

Ⅲ. 제안 방법

서론에서 언급하였듯이 오토인코더 기반의 ARPESNet은 특징 데이터의 압축을 통한 실시간 정보복원 및 노이즈 제거에 장점이 있다. 하지만 강한 노이즈 제거나 높은 해상도 영상의 노이즈 제거에 한계를 보인다. 스킵 연결 기반의 U-Net은 에지나 세밀한 특징 정보를 보존하는 데 유리하다. 따라서 본 논문에서는 ARPES 영상의 중요 전자구조에 발생한 노이즈를 효과적으로 제거하는데 U-Net 기반의 모델을 적용하고자 한다. 아울러, U-Net 구조에 어텐션(Attention) 모듈을 결합하여 고강도 노이즈 영역에 더 높은 가중치를 부여한다. 따라서 본 제안 방법은 ARPES 영상에 발생하는 푸아송 노이즈를 효과적으로 제거할 수 있는 방법이다. 다음의 하부절에서는 본 제안 방법의 모델 구조 및 핵심기법을 소개한다.

1. RUnet 구조

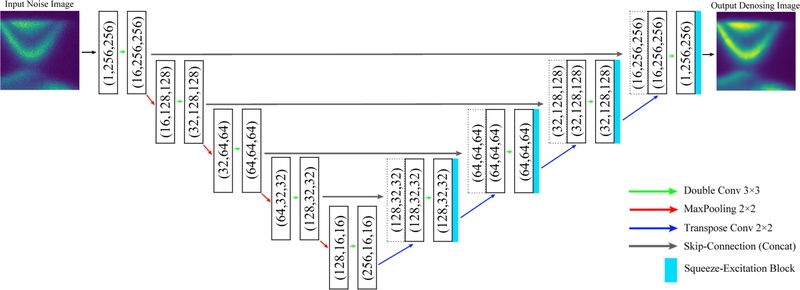

본 제안의 RUnet은 U-Net 구조에서 디코딩 영역에 압축-활성화 블록을 추가 적용하여 디노이징 성능을 향상시키는 구조이다. 본 제안의 RUnet의 구조는 인코더와 디코더 그리고 그 사이를 연결하는 스킵 연결로 구성되며, 이러한 구조는 특징을 추출하며 세부정보를 결합하여 복원성능을 극대화하는 특징이 있다.

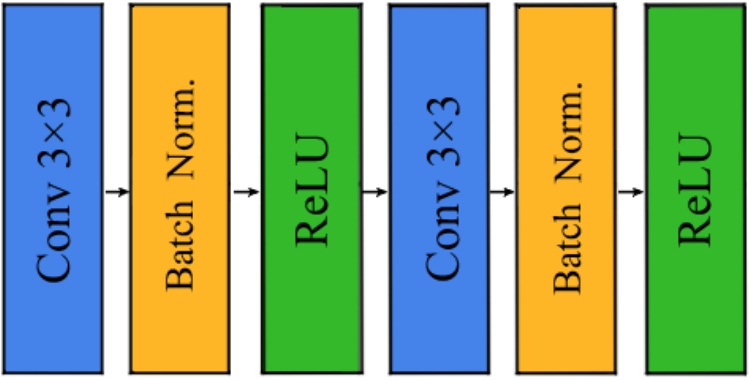

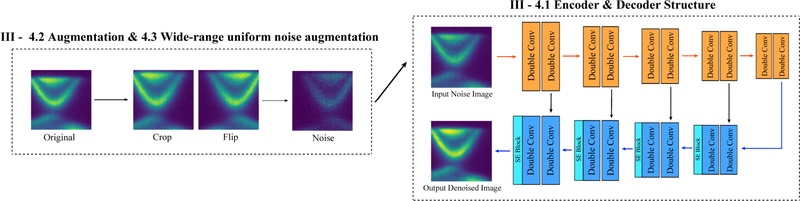

RUnet의 인코더를 이용하여 심층 특징을 얻기 위하여, 먼저 256×256 해상도의 단일 채널 영상을 신경망 모델에 입력한다. 이 입력 영상은 두 겹 합성곱(Conv-BN-ReLU) 블록을 거치며 16 채널의 특징맵(16, 256, 256)이 만들어진다. 그림 3은 두 겹 합성곱 블록의 구조를 보여준다. 이후 2×2 맥스 풀링을 사용하는 다운샘플링과 두 겹 합성곱 연산이 4회 반복 적용되어 최종 블록에서는 크기가 16×16이고, 채널의 수가 256인 특징맵(256, 16, 16)이 생성된다. RUnet의 디코더에서는 인코더에서 추출된 특징을 전치 합성곱(Transpose convolution)을 통해 단계적으로 2배씩 업샘플링된 특징맵을 생성하고 이를 해당 단계의 인코더 출력특징맵과 스킵 연결로 이어준다. 즉, 인코더의 마지막 계층에서 얻은 특징맵(256, 16, 16)은 상기 과정을 거쳐 원본 해상도로 복원된다.

본 제안의 RUnet은 특징 채널별 중요도 학습을 통한 디노이징 성능을 향상시키기 위해 디코더 영역에 압축-활성화 블록을 적용하였다. 즉, 본 제안에서는 디코더의 업샘플링 단계마다 압축-활성화 블록을 총 4회 적용하는 특징이 있다. 단계를 거칠 때마다 특징맵의 해상도는 커지고((64,64) → (128,128) → (256,256)), 채널 수는 줄어든다(128 → 64 → 32 → 16). 마지막 단계의 특징맵(16, 256, 256)에 1×1 합성곱을 적용하여 최종 영상(1, 256, 256)을 복원한다. 특히, 본 제안의 RUnet에서는 인코더 영역에 압축-활성화 블록의 적용을 배제하여 특징 표현력을 효율적으로 축적할 수 있게 하였다. 반면에 디코더 영역에는 해당 블록을 적용하여 다수의 특징에서 채널의 중요도 가중치를 효과적으로 계산함으로써 디노이징 성능이 향상 되도록 설계하였다.

그림 4는 제안하는 RUnet의 전체 네트워크 구조를 보여준다. 그림 4에서 보는 것과 같이, RUnet은 기본 U-Net과 유사한 인코더-디코더 구조의 형식을 가지고 있다. 하지만, 디코더 단의 특징맵에 두 겹 합성곱을 거친 후 압축-활성화 블록을 적용하여 채널 중요도 가중치를 효과적으로 계산하는 특징이 있다. 각 블록 괄호 안의 수치는 특징 데이터의 채널 및 해상도를 의미한다.

2. 데이터셋 생성 및 증강

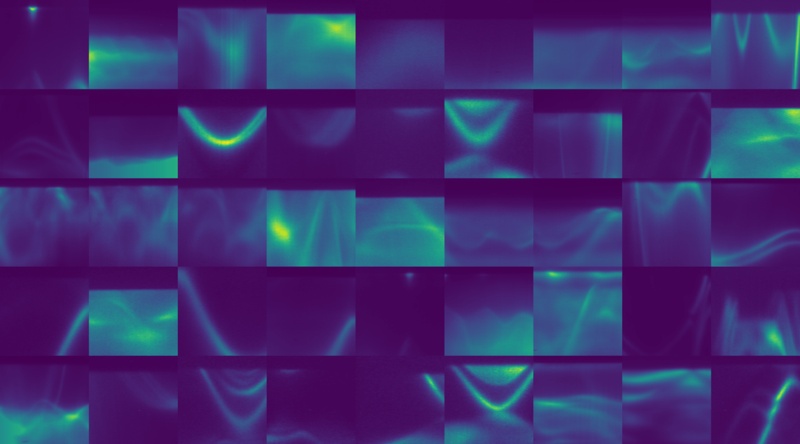

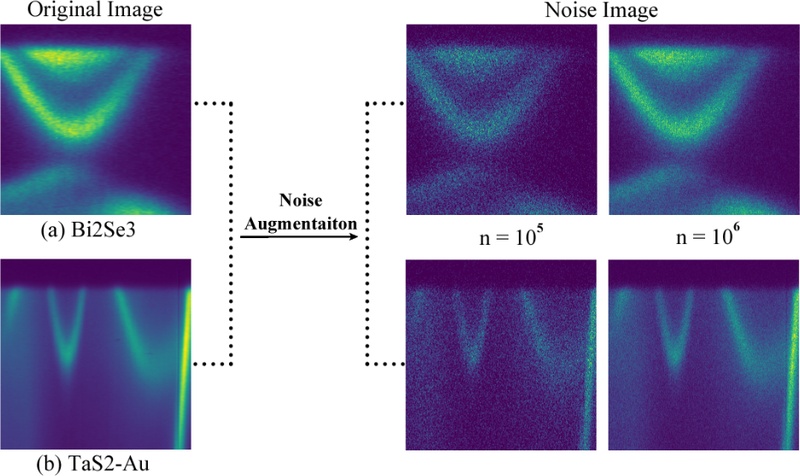

그림 5는 실험에 사용된 ARPES 원본 영상의 예시를 보여준다[17]. 그림 5에서와 같이, RUnet 모델의 학습 및 테스트에 사용되는 ARPES 영상은 3D ARPES 영상 데이터 28개 및 17개로부터 각 3D 영상을 500번 무작위 절단하여 얻었다. 따라서 학습과 테스트에 사용된 영상은 총 22,500장이며 각 영상의 크기는 256×256이다. 학습 데이터 14,000장의 영상을 80:20의 비율로 나누어 학습데이터와 검증데이터로 사용하였다. 또한, 학습데이터의 다양성을 증가시키기 위하여 원 영상의 일부를 잘라 증강하였다. 즉, 매 에폭(epoch)마다 무작위로 증강된 14,000장의 학습데이터를 학습에 사용하였다. 영상 증강을 위하여 영상 크기의 범위를 원 영상의 80%~100%의 크기로, 종횡비는 80%~120%의 범위로 조정했다. 마지막으로 크기와 종횡비가 조정된 영상을 50%의 확률로 좌우반전시켜 증강을 완료했다. 단, 회전이나 상하반전은 영상의 축 정보를 손실할 수 있으므로 증강영상 생성에 적용하지 않았다[7]. 식 (4)는 노이즈 영상 생성에 사용되는 푸아송 평균 값이다.

| (4) |

여기서 Pij는 식 (2)의 푸아송 분포, nexpose는 광전자 노출값을 나타낸다. 푸아송 노이즈가 추가된 영상은 원본 영상의 정보를 이용하여 푸아송 분포 Pij를 계산하고, 추정한 푸아송 분포에 전체 광전자 노출 값을 곱한 값으로 새로운 평균 값 λij을 계산한다. 이 λij로 ij 위치 화소의 푸아송 분포를 추정할 수 있고, 이 분포를 바탕으로 샘플링을 수행하여 새로운 화소 값을 생성한다. 즉, 이렇게 생성된 모든 영상 위치에서의 화소 값이 최종 노이즈 영상이다.

그림 6은 광전자 노출 값 조정을 통하여 생성된 ARPES 노이즈 영상의 예시이다. 학습 데이터의 총 광전자 노출량 n의 범위는 5×104~1×108으로 설정하여 사용하였다. 그림 6에서 보는 것과 같이 광전자 노출량이 많아질수록 노이즈 강도가 적은 것을 알 수 있다.

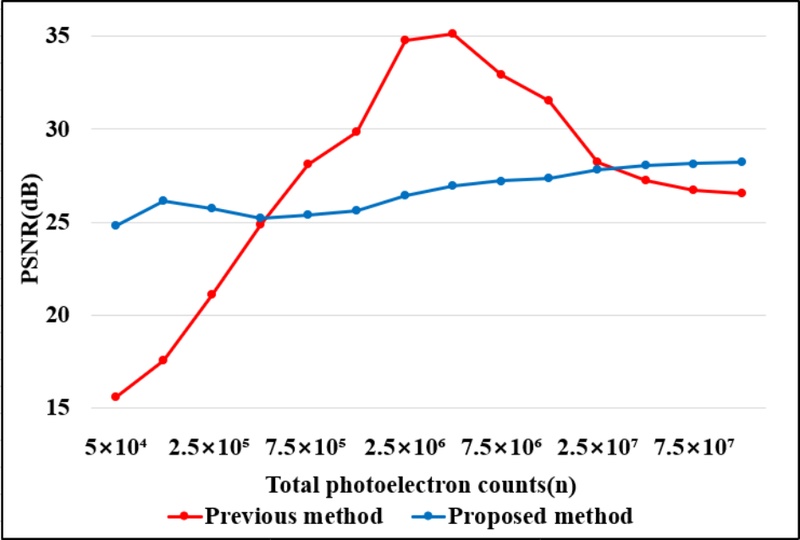

3. 제안하는 광범위 균등학습을 통한 안정적 디노이징 기법

기존의 노이즈 증강법은 노이즈 노출 범위가 하나로 고정된 특징이 있다. 즉, 고정된 노이즈 구간(ex. n=5×105~10×108)에서 임의로 노출량을 샘플링하여 노이즈를 증강하였다. 하지만 기존의 방식은 학습 시에 특정 노이즈 강도 구간으로 노이즈가 편중되는 현상이 발생할 수 있다. 그 결과, 특정 구간에서의 성능은 우수하지만 다른 구간에서는 성능이 열화되게 학습된다. 그림 7은 기존의 노이즈 증강법 및 제안하는 노이즈 증강법을 이용하여 U-Net 구조에서 학습한 모델의 디노이징 성능 비교를 나타낸다. 그림 7에서 확인할 수 있듯이 기존 노이즈 증강법을 이용하면 특정 노이즈 구간에서만 디노이징 성능이 보장되는 것을 볼 수 있다. 즉, 강한 노이즈 부분(n≤5×105)에서의 디노이징 성능은 노이즈 강도에 비례하여 떨어지는 것을 알 수 있다. 반면에 제안하는 광범위 균등학습 기법을 적용한 디노이징 성능 결과를 보면, 제안 방법은 기존의 디노이징 증강 방법 대비 전 구간의 노이즈 범위에서 일관적인 디노이징 성능을 보임을 확인할 수 있다. 이는 광전자 노출량(노이즈 강도)의 범위를 균등하게 설정하여 표본을 추출할 경우 상대적으로 노이즈 강도가 낮은 표본이 선택될 확률이 높아지기 때문에 균형적인 학습이 어렵게 된다는 의미이다.

Comparison of denoising performance of U-Net model by the previous and the proposed noise augmentation methods

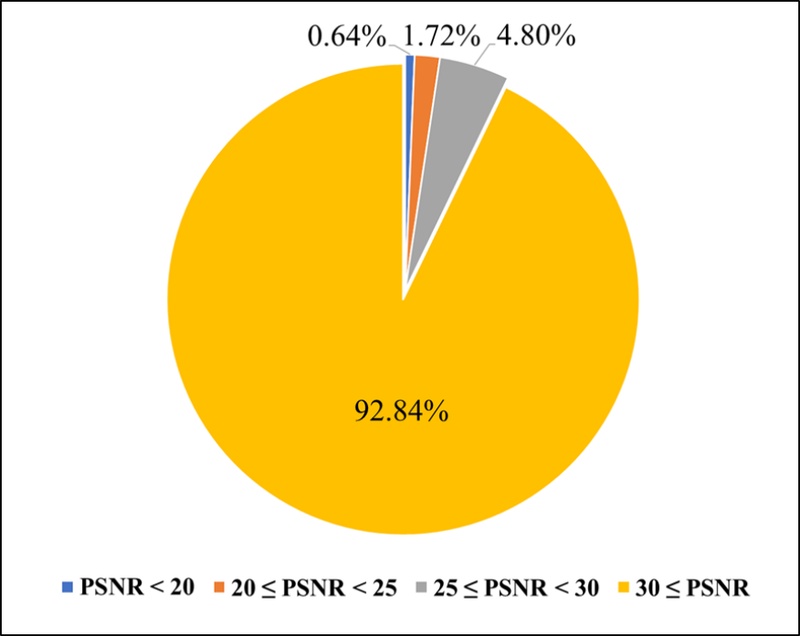

그림 8은 학습에 사용되는 노이즈 영상 표본의 선택 비율을 보여준다. 그림 8에서 볼 수 있듯이, 전체 노이즈 증강 범위(n=5×105~10×108) 중 강한 노이즈 부분(PSNR≤20dB)의 범위가 차지하는 비율은 0.64%에 불과하다. 따라서 강한 노이즈 표본이 선택될 확률이 희박하다. 아래의 식 (5)~식 (8)은 제안하는 광범위 균등학습을 위한 노이즈 영상 생성방법을 보여준다. 식 (5)는 광범위 균등학습 노이즈 영상 생성을 위한 ARPES 원본 영상데이터를 집합으로 표현한다.

| (5) |

여기서 식 (5)의 X를 세 개의 미니배치로 분할하면 식 (6)으로 표현된다.

| (6) |

여기서 b1과 b2는 X를 세 개의 미니배치로 분할하기 위한 분할 비이며 동일한 크기(=B/3)를 가진다. 또한, B는 배치 크기를 의미한다. 식 (7)은 식 (6)에서 미니배치로 분할된 영상별로 서로 다른 총 광전자 노출 값 범위를 적용하여 생성된 노이즈가 추가된 영상을 표현한다.

| (7) |

여기서 Ngen(x)은 노이즈 생성을 위한 증강함수이고, 원본 영상이 포함된 미니배치에 따라 노이즈 강도를 다르게 설정할 수 있다. 본 논문에서는 X1, X2, X3의 집합별로 각각 107~108, 106~107, 5×104~106 범위의 노이즈 강도를 사용하였다. 식 (8)은 서로 다른 총 광전자 노출 값 범위를 적용하여 생성한 총 노이즈 영상 집합이다.

| (8) |

따라서, 본 논문에서 제안하는 RUnet은 식 (5)~식 (8)로 얻어진 노이즈 영상을 매 학습마다 적용하므로 광범위의 노이즈를 균형 학습할 수 있다.

그림 9는 제안하는 RUnet의 전체 학습과정을 나타낸다. 먼저 원본 ARPES 영상 데이터는 크기 자르기(crop), 좌우반전(flip), 균등 노이즈 증강법(강, 중, 약 구간 설정)이 적용되어 RUnet으로 입력된다. 그 다음, 증강된 노이즈 영상이 U-Net 구조의 인코더-디코더 스킵 연결 기반 이중 합성곱 블록 구조를 통과하여 에지와 특징 정보를 세밀하게 추출한다. 또한, 디코더 영역에서는 압축-활성화 블록(SE block)을 적용하여 다수의 특징에서 채널 중요도 가중치 계산의 효율성을 높인다. 이러한 일련의 ARPES 영상 데이터 증강, 이중 합성곱 및 스킵 연결 구조를 이용한 세부 정보 추출, 디코더 단 압축-활성화 블록 적용을 통한 다수 특징의 중요도 가중치 계산 과정을 통하여 ARPES 영상 데이터 디노이징 성능을 향상하게 된다.

Ⅳ. 실험 결과

1. 학습 조건

본 실험을 위해 학습에는 14,000장, 테스트에는 8,500장의 ARPES 영상을 사용하였다[17]. 제안 RUnet 모델의 성능 비교 평가를 위해 ARPESNet[7], FFDNet[18]과 U-Net[14]을 사용하였으며, U-Net에는 어텐션과 광범위 균등학습이 포함되지 않은 기본 구조를 사용하였다. 제안 RUnet의 학습을 위한 파라미터 값으로 총 에폭은 100, 학습률은 0.001, 손실함수는 평균 제곱 오차(Mean Squared Error, MSE)를 사용하였고 총 학습시간은 대략 1시간이 소요되었다. 학습에 사용된 하드웨어는 NVIDIA RTX 4080 SUPER GPU, Intel Core i9-14900K CPU, 64GB RAM이고, 소프트웨어는 Windows 11, Python 3.11.11, CUDA 12.1 버전이다.

2. 정량적 디노이징 성능 결과 비교

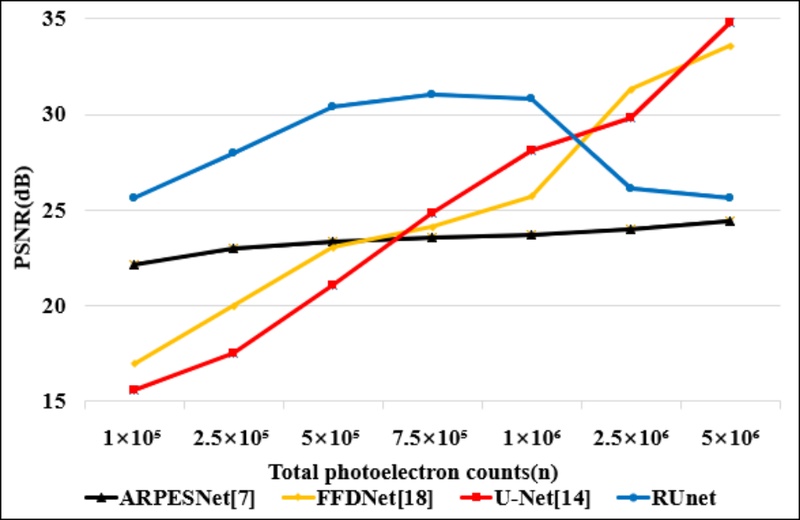

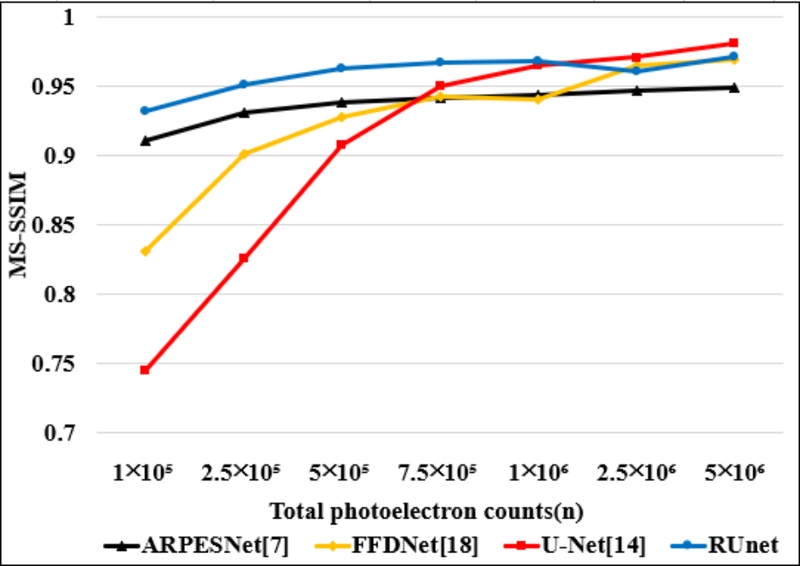

표 1은 제안하는 RUnet을 사용하여 디노이징을 수행한 정량적인 성능 결과 중 총 광전자 노출량 대비 PSNR(Peak Signal to Noise Ratio) 비교 결과를, 표 2는 총 광전자 노출량 대비 MS-SSIM(Multi Scale-Structural Similarity Index Measure) 비교 결과를 보여준다. 표 1에서 알 수 있듯이, 제안 RUnet이 기존의 모델 대비 더 넓은 노이즈 구간에서 높은 PSNR 값을 갖는 것을 알 수 있었다. 제안 RUnet은 모든 노이즈 구간(총 7개 구간)의 실험에서 평균 28.24dB의 결과를 나타냈고, 이는 기존의 U-Net 대비 4.3dB, ARPESNet 대비 4.79dB, FFDNet 대비 3.27dB 향상된 수치이다. 또한, 표 2에서 알 수 있듯이 제안 RUnet이 기존의 모델 대비 더 넓은 노이즈 구간에서 높은 MS-SSIM 값을 갖는 것을 알 수 있었다. 제안 RUnet은 모든 노이즈 구간(총 7개 구간)의 실험에서 평균 0.9590의 결과를 나타냈고, 이는 기존의 U-Net 대비 0.0571, ARPESNet 대비 0.0217, FFDNet 대비 0.0336 향상된 수치이다.

그림 10은 표 1의 PSNR 정량결과를 그래프로 나타낸 것이다. 그림 10에서 볼 수 있듯이, U-Net은 강한 노이즈 영상의 디노이징 성능이 떨어짐을 알 수 있다. ARPESNet은 실험에 사용된 전 노이즈 구간에 대하여 일관성있는 디노이징 성능을 나타낸다. 하지만 본 제안 방법의 RUnet은 강한 노이즈 구간의 영상에서도 디노이징 성능을 U-Net 대비 향상시켰고, 전 노이즈 구간의 영상에서도 일관성이 있고 향상된 디노이징 성능을 보여줌을 알 수 있다.

그림 11은 표 2의 MS-SSIM 정량결과를 그래프로 나타낸 것이다. 그림 11에서 볼 수 있듯이, 제안 RUnet, U-Net, FFDNet 및 ARPESNet 등 모든 방법에서 노이즈가 강한 영상일수록 디노이징 성능이 저하되고, 노이즈가 약해질수록 디노이징 성능이 향상되는 경향이 있음을 알 수 있다. 그럼에도 불구하고 제안 RUnet은 기존 방법들보다 광범위 노이즈 강도 구간에서 향상된 MS-SSIM 결과를 나타내었다.

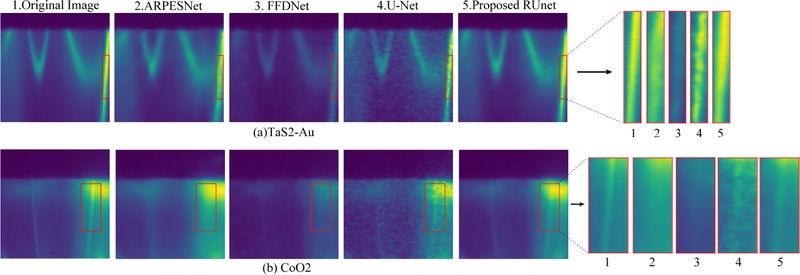

그림 12는 제안 RUnet과 기존의 U-Net, FFDNet 및 ARPESNet의 디노이징 결과를 시각화한 것이다. 그림 12-(a)에서 볼 수 있듯이, 제안 RUnet은 ARPES 영상(TaS2-Au)의 에지 부분을 보존하면서도 노이즈 제거 성능이 향상됨을 알 수 있다. 또한, 그림 12-(b)의 ARPES 영상(CoO2)에서도 제안 RUnet이 더욱 선명한 에지 복원을 하고 있음을 알 수 있다. 이렇듯 본 제안 RUnet이 주관적인 화질 평가에서도 기존의 방법보다 에지 등의 세밀한 특징을 더욱 잘 복원하는 것을 확인할 수 있었다.

A visual quality comparison between the proposed RUnet and the previous methods (total photoelectron counts n=105 )

표 1, 표 2, 그림 10, 그림 11 및 그림 12의 정량적 실험수치 및 시각적 화질평가 결과에서 알 수 있듯이, 제안하는 RUnet의 광범위 균등학습 기법이 효과적으로 학습에 적용되어 강한 노이즈 구간에서뿐만 아니라 전 구간의 노이즈 영상에서도 일관성 있는 디노이징 성능 결과를 나타냄을 확인할 수 있었다.

Ⅴ. 결 론

본 논문에서는 ARPES 데이터 디노이징에 특화된 ARPESUnet(RUnet)을 제안하였다. RUnet은 U-Net 기반의 네트워크 구조로서 모든 노이즈 영상 구간에서 일관성 있는 디노이징 성능을 유지하기 위하여 광범위 균등학습 기법을 적용하였다. 즉, 제안 RUnet은 학습 영상의 노이즈 강도를 강, 중, 약으로 구분하여 학습에 적용하였을 뿐만 아니라, 디코더 단에 압축-활성화 기법을 적용하여 중요 특징을 더욱 효과적으로 학습할 수 있도록 설계한 특징이 있다. 실험 결과에서 알 수 있듯이 제안 RUnet은 기존 디노이징 모델 대비 강한 노이즈 영상뿐만 아니라 실험 노이즈 영상의 전 구간에 대하여 디노이징 성능을 향상하였다. 특히 제안 RUnet은 기존 ARPESNet 및 U-Net 대비 PSNR은 최대 7.51dB 및 최대 10.81dB 상승, 평균 4.79dB 및 평균 4.30dB 상승, MS-SSIM은 최대 0.0252 및 최대 0.1941 상승, 평균 0.0217 및 평균 0.0570 상승시켰다.

Acknowledgments

Learning & Academic research institution for Master's·PhD students, and Postdocs (LAMP) Program of the National Research Foundation of Korea (NRF) grant funded by the Ministry of Education (No. RS-2023-00301974)

References

-

J. A. Sobota, Y. He, and Z.-X. Shen, “Angle-resolved photoemission studies of quantum materials,” Reviews of Modern Physics, Vol. 93, No. 2, pp. 1-72, May 2021.

[https://doi.org/10.1103/RevModPhys.93.025006]

-

A. Damascelli, Z. Hussain, and Z.-X. Shen, “Angle-resolved photoemission studies of the cuprate superconductors,” Reviews of Modern Physics, Vol. 75, No. 2, pp. 473–541, Apr. 2003.

[https://doi.org/10.1103/RevModPhys.75.473]

-

W. Eberhardt and E. W. Plummer, “Angle-resolved photoemission determination of the band structure and multielectron excitations in Ni”, Physical Review B, Vol. 21, No. 8, pp. 3245-3255, Jun. 1979.

[https://doi.org/10.1103/PhysRevB.21.3245]

-

Y. He, Y. Wang, and Z.-X. Shen, “Visualizing dispersive features in 2D image via minimum gradient method,” Review of Scientific Instruments, Vol. 88, No. 7, 073903, Jul. 2017.

[https://doi.org/10.1063/1.4993919]

-

Y. Kim et al., “Deep learning-based statistical noise reduction for multidimensional spectral data,” Review of Scientific Instruments, Vol. 92, No. 7, 073901, Jul. 2021.

[https://doi.org/10.1063/5.0054920]

-

F. Restrepo, J. Zhao, and U. Chatterjee, “Denoising and feature extraction in photoemission spectra with variational auto-encoder neural networks,” Review of Scientific Instruments, Vol. 93, No. 6, 065106, Jun. 2022.

[https://doi.org/10.1063/5.0090051]

-

S. Ý. Ágústsson et al., “An autoencoder for compressing angle-resolved photoemission spectroscopy data,” Machine Learning: Science and Technology, Vol. 6, 015019, Jan. 2025.

[https://doi.org/10.1088/2632-2153/ada8f2]

-

C. Tian et al,, “Deep Learning on Image Denoising: An Overview,” Neural Networks, Vol. 131, pp. 251-275, Nov. 2020.

[https://doi.org/10.1016/j.neunet.2020.07.025]

-

Y. LeCun et al., “Gradient-based learning applied to document recognition,” Proceedings of the IEEE, Vol. 86, No. 11, pp. 2278–2324, Nov. 1998.

[https://doi.org/10.1109/5.726791]

-

K. Zhang et al., “Beyond a Gaussian Denoiser: Residual learning of deep CNN for image denoising,” IEEE Trans. Image Process., Vol. 26, No. 7, pp. 3142-3155, Feb. 2017.

[https://doi.org/10.1109/TIP.2017.2662206]

-

P. Vincent et al., “Extracting and composing robust features with denoising autoencoders” Proceedings of the 25th International Conference on Machine Learning (ICML), Helsinki, Finland, pp. 1096–1103, Jul. 2008.

[https://doi.org/10.1145/1390156.1390294]

-

J. Lehtinen et al., “Noise2Noise: learning image restoration without clean data,” Proceedings of Machine Learning Research, Vol. 80, pp. 2695-2974, Mar. 2018.

[https://doi.org/10.48550/arXiv.1803.04189]

-

A. Creswell and A. A. Bharath “Denoising adversarial autoencoders,” IEEE Trans. Neural Networks and Learning Systems, Vol. 30, No. 4, pp. 968-984, Apr. 2019.

[https://doi.org/10.48550/arXiv.1703.01220]

-

O. Ronneberger, P. Fischer, and T. Brox, “U-Net: convolutional networks for biomedical image segmentation,” Lecture Notes in Computer Science, Vol. 9351, pp. 234–241, Nov. 2015.

[https://doi.org/10.1007/978-3-319-24574-4_28]

-

A. Vaswani et al., “Attention is all you need,” International Conference on Neural Information Processing Systems, Long Beach, CA, USA, pp. 6000–6010, Dec. 2017.

[https://doi.org/10.48550/arXiv.1706.03762]

-

J. Hu, L. Shen, and G. Sun, “Squeeze-and-Excitation networks,” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Salt Lake City, USA, pp. 7132–7141, Dec. 2018.

[https://doi.org/10.1109/CVPR.2018.00745]

- “ARPES Datasets,” https://zenodo.org/records/12648783

-

K. Zhang, W. Zuo, and L. Zhang, “FFDNet: Toward a Fast and Flexible Solution for CNN based Image Denoising,” IEEE Transactions on Image Processing, Vol. 27, No. 9, pp. 4608-4622, 2018.

[https://doi.org/10.1109/TIP.2018.2839891]

- 2020년 3월 ~ 현재 : 경상국립대학교 IT공과대학 제어로봇공학과 학석사과정

- ORCID : https://orcid.org/0009-0009-1896-3503

- 주관심분야 : Deep Learning, Image Processing, Computer Vision, Denoising

- 2000년 3월 ~ 2005년 8월 : 인하대학교 정보통신공학부 학사

- 2004년 2월 ~ 2004년 7월 : City University of New York at Queens College, Flushing, New York 국가장학교환학생

- 2006년 3월 ~ 2008년 2월 : 광주과학기술원 정보기전공학부 석사

- 2008년 2월 ~ 2024년 2월 : 국방과학연구소(ADD) 미사일연구원 연구원/선임연구원/책임연구원

- 2016년 3월 ~ 2021년 2월 : 한국과학기술원 전기및전자공학부 박사

- 2024년 3월 ~ 현재 : 경상국립대학교 IT공과대학 제어로봇공학과 조교수

- ORCID : https://orcid.org/0000-0002-8364-6127

- 주관심분야 : 비디오 부호화, 비디오 비트율-제어, 영상처리, 컴퓨터비전, 인공지능기반 국방 및 항공우주 영상 시스템