다중 교사 지식 증류와 불확실성 모듈을 활용한 SAR 객체 분류 연구

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

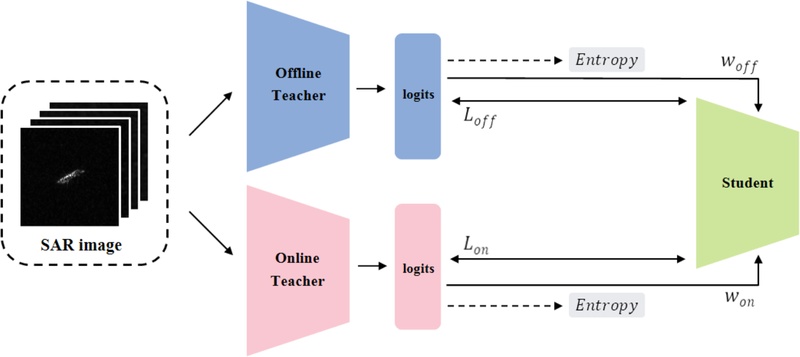

합성 개구 레이더(Synthetic Aperture Radar) 영상은 원격 탐사 분야에서 핵심적인 역할을 수행하지만, 복잡한 구조적 특성으로 인해 정확한 분류에 어려움이 있다. 이에 본 논문에서는 SAR 영상 분류의 정확도와 강건성을 향상시키기 위해 Adaptive Uncertainty-Responsive Aggregation for Knowledge Distillation (AURA-KD)라는 새로운 프레임워크를 제안한다. 제안된 프레임워크는 사전 학습된 오프라인 교사 모델과 이전 배치의 예측을 활용하는 온라인 교사 모델을 결합하여 학생 모델에 지식을 증류하는 학습 방식을 채택한다. 특히, 각 교사 모델의 예측에 대한 엔트로피를 계산하여 불확실성을 평가하고, 이를 기반으로 신뢰도 높은 교사의 지식을 우선적으로 반영하는 Uncertainty 모듈을 도입하였다. 이 모듈은 오프라인 및 온라인 교사 모델의 예측 엔트로피와 손실 간의 관계를 종합적으로 분석하여, 불확실성이 높은 정보에 과도하게 의존하는 문제를 효과적으로 완화한다. 제안한 방법은 OpenSARShip과 MSTAR 데이터셋을 대상으로 한 실험에서 기존 베이스라인 모델 대비 우수한 정확도를 나타냈다.

Abstract

Synthetic Aperture Radar (SAR) images are of key importance in the field of remote sensing. However, the complex structural characteristics of these images pose significant challenges for accurate classification. In this paper, we propose a novel framework, Adaptive Uncertainty-Responsive Aggregation for Knowledge Distillation (AURA-KD), with the aim of improving the accuracy and robustness of SAR image classification. The proposed framework adopts a learning approach to distill knowledge into student models by combining pre-trained offline teacher models and online teacher models that utilize the predictions of previous batches. In particular, the present study introduces an Uncertainty module that evaluates uncertainty by calculating the entropy of each teacher model's prediction and prioritises the knowledge of more reliable teachers. This module undertakes a comprehensive analysis of the relationship between the prediction entropy and the loss of offline and online teacher models, thereby providing an effective solution to the problem of over-relying on information with a high degree of uncertainty. In experiments on the OpenSARShip and MSTAR datasets, the proposed method has been shown to outperform the existing baseline model.

Keywords:

Synthetic aperture radar, SAR object classification, Knowledge distillation, Self distillation, Entropy-basedⅠ. 서 론

합성 개구 레이더(Synthetic Aperture Rader, SAR)는 마이크로파 펄스를 안테나에서 발사하여 대상에 반사되어 돌아오는 시간차를 합성해 이미지를 생성하는 레이다 시스템이다[1]. 대기 조건이나 해양 환경에 영향을 받지 않는다는 점에서 SAR 영상은 군사, 재난 관리, 해양 모니터링 등 다양한 분야에서 활용되고 있다. 그러나 SAR 영상의 높은 노이즈와 낮은 해상도로 인해 전통적인 컴퓨터 비전 기술이나 심층 신경망 기반 분류 모델에 있어 도전과제로 남아있다[2].

최근 대규모 모델이 많아지면서 모델의 성능을 유지하면서도 경량화된 모델을 생성하는 데 효과적인 방법인 지식 증류 기법(Knowledge distillation)이 주목받고 있다[3]. 이는 대규모 교사 모델(Teacher model)이 예측한 소프트 타겟(Soft target)을 활용하여 학생 모델(Student model)을 지도함으로써 성능을 개선한다. 그러나 대부분의 기존 연구들은 오프라인 교사 모델의 일관된 신뢰성을 전제하며, 교사의 예측이 항상 정확할 것이라는 가정을 기반으로 한다. 이러한 접근은 특히 SAR 영상처럼 높은 불확실성과 클래스 간 경계가 모호한 데이터셋에서는 오히려 잘못된 지도 신호를 증폭시켜 학생 모델의 일반화 성능을 저하시킬 수 있다.

이에 본 연구에서는, SAR 영상 분류를 위한 Adaptive Uncertainty-Responsive Aggregation for Knowledge Distillation (AURA-KD) 방법을 제안한다. 제안하는 프레임워크는 다음과 같은 특징을 가진다. 첫째, 오프라인 교사(Offline teacher) 모델뿐만 아니라, 직전 배치에서의 학생 모델 출력을 온라인 교사(Online teacher)로 활용하여 학생 모델에 추가적인 지식을 증류한다. 둘째, 각 교사 예측의 엔트로피(Entropy)를 실시간으로 추정하여, 신뢰도가 높은 교사로부터 더 많은 정보를 전이하도록 가중치를 동적으로 조정한다. 이를 통해, 불확실한 지도 신호의 영향을 최소화하고 학생 모델의 강건성과 일반화 능력을 동시에 향상시킬 수 있다.

Ⅱ. 관련 연구

1. 지식 증류

지식 증류는 대규모 교사 모델로부터 학습된 지식을 더 작고 효율적인 학생 모델로 전달하는 기법으로, Hinton et al.에 의해 처음 제안되었다[4]. 교사 모델은 일반적으로 높은 성능을 가지지만 계산 비용이 크고, 학생 모델은 경량화된 구조로 빠른 추론이 가능하도록 설계된다. 초기 연구에서는 교사 모델의 로짓(logits)에 온도 파라미터(Temperature)를 적용한 Softmax를 통해 소프트 타겟을 생성하고, KL(Kullback-Leibler) Divergence를 손실 함수로 사용하여 학생 모델을 최적화하였다. 이후, Romero et al.은 중간 레이어의 특성 지도(Feature map)를 증류하는 “FitNets”를 제안하며, 지식 증류의 범위를 확장하였다[5]. FitNets는 교사의 깊은 레이어에서 추출된 특징을 학생 모델에 맞추도록 하여, 단순한 출력 증류를 넘어선 성능 향상을 달성하였다. 또한, Yim et al.은 Flow of Solution Procedure (FSP) 매트릭스를 통해 Teacher와 Student 간의 관계를 모델링 하는 기법을 소개하였고[6], Zagoruyko and Komodakis는 어텐션 전이(Attention transfer)를 통해 공간적 주의 메커니즘을 증류하는 방법을 제안하여 다양한 응용 분야에서 성공적으로 적용되었다[7].

일반적인 지식 증류의 장점은 대규모 모델의 성능을 유지하면서도 연산 비용과 메모리 사용을 크게 줄일 수 있다는 점이다. 그러나 단점으로는 교사 모델의 품질에 크게 의존하며, 초기 교사 모델이 불완전할 경우 학생 모델의 성능이 제한될 수 있다는 점이 지적된다. 또한, 단일 교사를 사용하는 전통적인 접근법은 동적 환경이나 데이터 분포 변화에 대한 적응성이 부족하다는 한계가 있다.

2. 온라인 증류

온라인 증류는 학습 과정에서 교사 모델을 동적으로 업데이트하거나, 여러 모델 간의 동시 학습(co-training)을 통해 실시간으로 지식을 교환하는 기법이다. 전통적인 오프라인 지식 증류가 사전 학습된 교사에 의존하는 반면, 온라인 증류는 학습 중인 모델의 예측을 교사로 활용하여 유연성과 적응성을 강조한다. 이 개념은 Anil et al.에 의해 “Large-Scale Distributed Deep Networks”에서 처음 소개되었으며, 여러 GPU에서 병렬 학습 중 서로 다른 모델의 출력을 공유하여 성능을 향상시키는 방식으로 제안되었다[8].

온라인 증류는 Deep Mutual Learning (DML)을 통해 확장되었는데, DML에서는 동일한 데이터셋에서 학습 중인 여러 학생 모델이 서로의 소프트 타겟을 교환하며 상호 학습을 수행한다[9]. 각 모델은 독립적으로 예측을 생성하고, 다른 모델의 출력과의 KL Divergence 손실을 최소화하도록 최적화된다. 자기 증류(Self distillation)는 단일 모델이 자신의 지식을 활용하여 학습을 개선하는 기법으로, 별도의 교사 모델 없이도 성능 향상을 도모한다. 2019년 “Your Own Teacher: Self-Knowledge Distillation”에서 처음 도입되었으며, 모델의 초기 예측이나 중간 레이어 출력을 소프트 타겟으로 사용하여 예측을 개선하는 방식으로 정의되었다[10]. 자기 증류는 온라인 증류와 유사하게 동적 지식 전달을 강조하지만, 외부 모델과의 상호작용 대신 단일 모델 내부의 피드백 루프에 초점을 맞춘다.

자기 증류의 장점은 별도의 교사 모델이 필요 없으므로 학습 비용이 낮고, 모델의 자체 피드백을 통해 성능을 점진적으로 개선할 수 있다는 점이다. 그러나 초기 모델의 품질에 크게 의존하며, 잘못된 예측이 증폭될 가능성이 있다는 단점이 있다. 본 연구에서는 자기 증류의 개념을 확장하여, 이전 배치의 학생 모델 예측(Last batch logits)을 온라인 교사로 활용함으로써 자기 피드백 메커니즘을 도입하였다. 이는 오프라인 교사와 결합된 하이브리드 접근법으로, 자기 증류의 효율성과 일반적인 지식 증류의 안정성을 동시에 활용한다.

Ⅲ. 제안 방법

1. Architecture

본 논문에서 제안하는 모델은 AURA-KD라는 구조로서 CNN 기반 백본 네트워크(Backbone network)인 ResNet18[11], VGG11[12]를 기반으로 하며, 두 가지 교사 모델(오프라인 교사와 온라인 교사)을 동시에 활용한다. 오프라인 교사는 사전 학습된 모델로서 학습 초기의 안정적인 지식 전이를 담당하고, 온라인 교사는 이전 배치에서 학습된 학생 모델을 기반으로 동적이고 점진적인 지식 전이를 수행한다. 제안된 방법의 핵심은 다음과 같은 엔트로피 기반의 불확실성 평가 모듈이다.

각 교사 모델의 예측 결과에서 계산한 엔트로피를 사용하여 교사의 불확실성을 평가한다.

오프라인 교사와 온라인 교사의 예측 결과 간의 KL Divergence 손실을 기반으로 손실 차이를 계산하며, 엔트로피를 추가적으로 고려하여 최종적으로 각 교사 모델의 가중치를 동적으로 조정한다.

엔트로피는 예측의 불확실성을 측정하는 지표로, 이를 통해 각 교사 모델의 신뢰도를 평가하고, 학습 과정에서 적절한 가중치를 부여한다. 이로써, 학생 모델은 오프라인 교사의 안정적인 지식과 온라인 교사의 동적인 지식을 모두 활용하여 더 높은 분류 정확도를 달성할 수 있다.

AURA-KD의 학습은 두 단계로 진행된다. 첫 번째 단계에서 오프라인 교사 모델을 Cross-Entropy 손실을 사용하여 사전 학습시키고, 가중치를 고정한다. 두 번째 단계에서는 학생 모델을 학습시키며, 오프라인 교사와 온라인 교사의 지식을 결합한다.

2. 엔트로피

엔트로피는 주어진 확률 분포의 불확실성을 나타내는 측정 지표로, 모델의 예측 확률 분포의 확신 정도를 정량적으로 나타낸다[13]. 모델의 출력 로짓을 라 할 때, 각 클래스 c에 대한 예측 확률은 Softmax를 통해 다음과 같이 계산된다.

| (1) |

여기서 Pc는 c클래스 에 대한 예측 확률이며, C는 클래스의 총 개수이다. 이때, 예측 확률 분포의 엔트로피 H(p)는 다음과 같이 정의된다.

| (2) |

엔트로피가 높을수록 모델의 예측 확률 분포가 불확실하며, 낮을수록 확실한 예측을 나타낸다.

3. 불확실성 모듈 (Uncertainty module)

불확실성 모듈은 오프라인 교사와 온라인 교사의 지식 전이 과정에서 각 모델의 신뢰도를 평가하여 동적으로 가중치를 할당하는 역할을 수행한다. 본 논문에서는 모델의 불확실성을 다음 두 가지 요소로 나누어 정량적으로 평가한다.

엔트로피 기반 불확실성: 두 교사 모델의 샘플별 엔트로피 값을 비교하여 평가한다.

| (3) |

손실 기반 불확실성: 오프라인 및 온라인 교사 각각의 KL Divergence 손실을 비교하여 평가한다.

| (4) |

여기서 Loff와 Lon은 각각 오프라인 교사와 온라인 교사에 대한 KL Divergence 손실을 나타내며, 다음과 같이 정의된다.

| (5) |

| (6) |

지식 증류 과정에서 소프트 타깃을 생성하기 위해 사용되는 온도 파라미터 τ는 모델의 로짓 분포를 부드럽게 만드는 역할을 한다. τ는 소프트 타깃의 정보량을 조절하여 학생 모델이 교사 모델의 풍부한 분포 정보를 학습할 수 있도록 돕는다.

오프라인 교사는 사전 학습된 모델로, 지정된 epoch 동안 학습된 후 가중치가 고정된다. 오프라인 교사는 학생 모델의 학습 중에 업데이트되지 않으므로 안정적인 지식을 제공한다.

Loff는 사전 학습된 오프라인 교사 모델의 출력 로짓인 zT와 학생 모델의 출력인 zθt 간의 차이를 측정하여, 학생이 오프라인 교사의 출력을 모방하도록 유도한다.

오프라인 교사와 달리 온라인 교사는 학생 모델의 학습 중에 동적으로 업데이트된다. 구체적으로, 온라인 교사는 이전 배치의 학생 모델 예측값인 zθt-1으로 표현되며, 이는 학생 자신의 진화하는 지식을 학습할 수 있게 하여 자기 증류 형태를 띠고 배치 간 시간적 일관성을 도입한다.

| (7) |

| (8) |

결과적으로, 불확실성 모듈은 오프라인 교사와 학생의 예측에 대해 엔트로피를 계산한 후 손실 차이와 엔트로피 차이를 결합하여 가중치를 결정한다.

| (9) |

| (10) |

LCE는 학생 모델의 예측과 실제 라벨 간의 차이를 측정하며, 지도 학습의 기본 손실 항목으로 사용된다. 마지막으로, 최종 손실 함수는 세 가지 손실 항목, 즉 Cross-Entropy 손실, 오프라인 손실, 그리고 온라인 손실의 가중합으로 구성된다. won과 woff는 각 손실 항목의 기여도를 동적으로 조정하여 학생 모델이 오프라인 교사, 온라인 교사로부터 효과적으로 지식을 학습하도록 유도한다.

Ⅳ. 실험 및 결과

1. 데이터셋

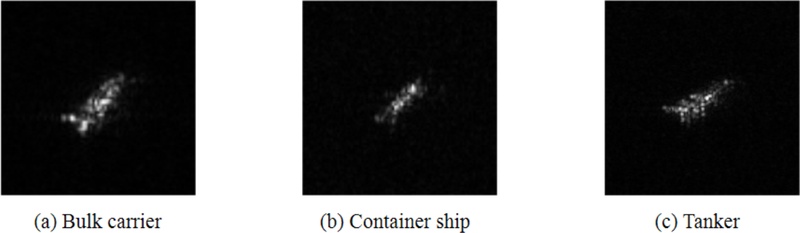

본 연구에서는 실험을 위해 OpenSARShip 데이터셋과 MSTAR 데이터셋을 사용하였다. OpenSARShip은 SAR 영상 기반의 선박 분류 연구를 지원하기 위해 공개된 데이터셋으로 Sentinel-1 저장소에서 수집된 두 가지 제품(Single Look Complex와 Ground Range Detected)을 기반으로, Interferometric Wide Swath 모드에서 수집되었다[14].

이는 총 16개의 선박 클래스로 구성되어 있으며 Cargo(화물선), Tanker(유조선), Fishing(어선), Tug(예인선), Dredging(준설선) 등 다양한 종류를 포함한다. 그러나 OpenSARShip은 클래스 간 데이터 불균형이 심각하게 나타나고 있어, 특정 클래스의 이미지 수가 다른 클래스에 비해 현저히 많은 문제를 가지고 있다. 본 연구에서는 이러한 클래스 불균형 문제를 해결하고 신뢰성 높은 성능 평가를 위해 데이터 양이 충분하며 특성이 뚜렷한 세 가지 클래스(Bulk carrier, Container ship, Tanker)만을 선정하여 실험을 진행하였다.

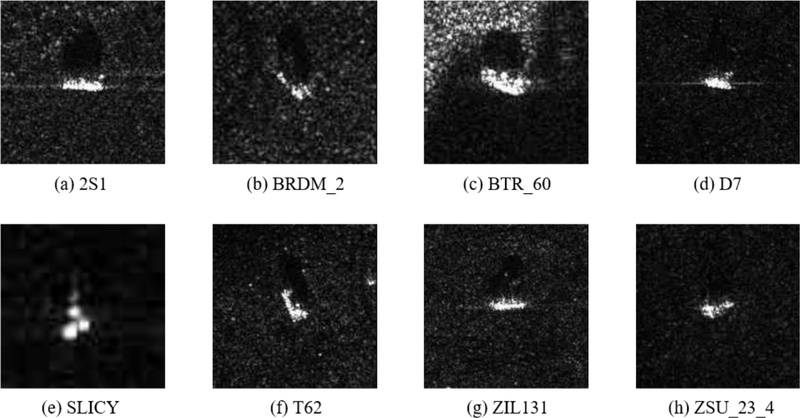

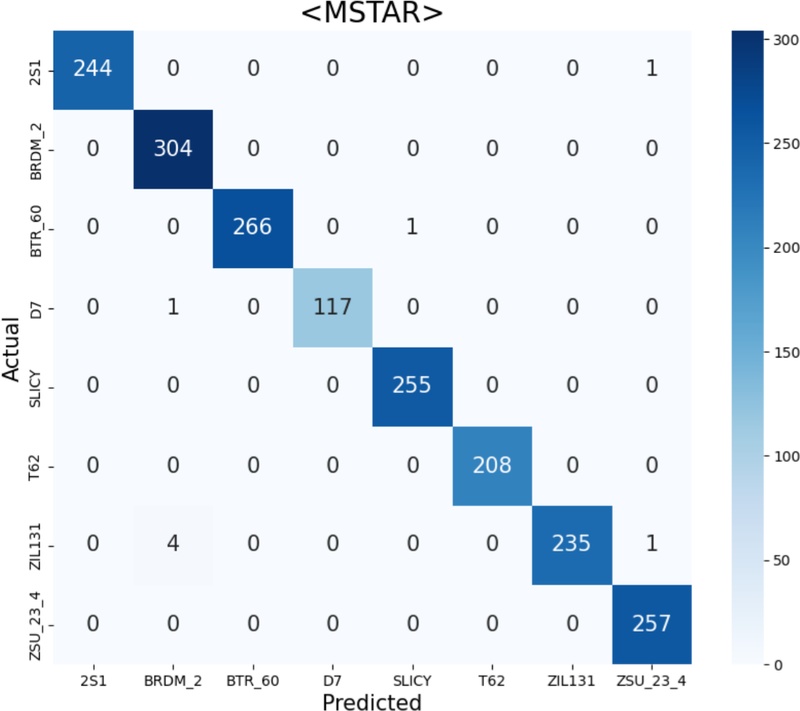

MSTAR 데이터셋은 X-밴드 SAR 이미지를 기반으로 하며, 군사 차량 및 기타 목표물의 정지 및 이동 상태를 포함하는 데이터셋이다[15]. 이는 2S1, BRDM, BTR-60을 포함한 총 8가지 전차 클래스로 구성되어 있다.

2. 실험 환경 및 평가

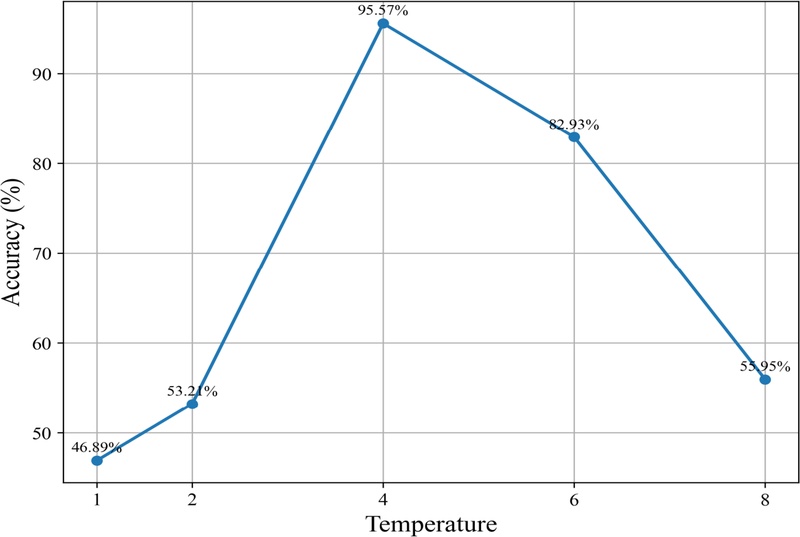

모델의 학습 및 추론을 위해 Nvidia RTX 4080 SUPER를 사용하였다. 실험은 백본 네트워크를 ResNet18, VGG11로 나누어서 진행하였고, 오프라인 교사 모델은 10 epoch 동안 Cross Entropy 손실로 사전 학습 후 가중치를 고정, 학생 모델은 15 epoch로 학습시켰다. 모델의 옵티마이저는 Adam, weight_decay=1e-2, learning rate=0.0001, 온도 파라미터는 4.0으로 설정하였다. 성능 평가는 테스트 데이터셋에 대해 예측이 실제 라벨과 일치하는 비율인 Accuracy와 클래스별 예측 결과를 시각화 한 Confusion matrix로 진행하였다.

조사된 모델에는 전통적인 아키텍처인 ResNet50, ResNet18, VGG11과 표준 KD, Self-KD, 그리고 제안된 AURA-KD와 같은 KD 변형이 포함되었다.

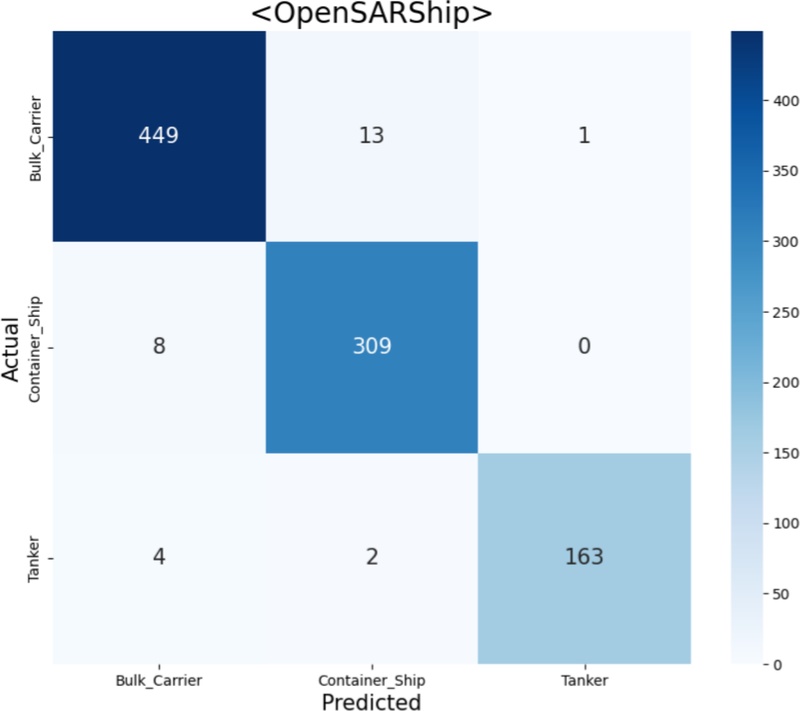

ResNet18을 백본 아키텍쳐로 사용한 AURA-KD 모델은 95.57%의 최고 정확도를 달성하여 ResNet50(84.51%), ResNet18(80.19%), VGG11(82.72%)과 같은 전통적인 모델을 크게 능가했다. 표준 KD 접근법은 84.83%를 기록한 반면, Self-KD는 71.65%로 뒤처져 제한된 효과를 나타냈다. VGG11 백본을 사용한 AURA-KD도 91.36%로 강력한 성능을 보였으며, 이는 제안된 방법이 다양한 백본 아키텍처에서 효과적임을 강화한다.

MSTAR 데이터셋에서 ResNet18 백본을 사용한 AURA-KD는 99.84%의 정확도로 우수한 성능을 보였으며, VGG11 백본을 사용한 AURA-KD가 99.79%로 근소한 차이로 뒤를 이었다. 이러한 결과는 ResNet50(91.18%), ResNet18 (88.86%), VGG11(95.14%)를 크게 능가한다. 표준 KD 방법은 95.88%를 달성한 반면, Self-KD는 82.73%로 다시 저조한 성능을 보였으며, 이는 OpenSARship에서의 추세와 일치한다.

모델의 분류 성능을 더 깊이 있게 평가하기 위해, 학생 모델의 Confusion matrix를 분석하였다. Confusion matrix는 실제 클래스와 예측 클래스 간의 관계를 시각적으로 표현하여, 모델이 특정 클래스에서 어떤 오류를 범하는지 파악할 수 있게 한다. Confusion matrix는 대각선에 높은 값을 가지며, 이는 각 클래스에 대해 높은 정확도를 나타낸다.

OpenSARShip 데이터셋에 대한 Confusion matrix에서 일부 오분류가 발생했으나 전반적인 분류 성능이 우수한 것을 확인할 수 있었다. MSTAR 데이터셋의 Confusion matrix 분석 결과 역시 클래스 간 오분류가 최소화되어, 클래스 간 분류가 효과적으로 이루어졌음을 보여주었다.

3. 온도 파라미터 값에 따른 성능 평가

지식 증류에서의 주요 하이퍼파라미터 중 하나인 온도는 교사 모델의 출력 확률 분포를 부드럽게 만드는 데 핵심적인 역할을 수행한다. 이 파라미터는 Softmax에 적용되기 전 로짓을 조절하여, 학생 모델이 교사 모델로부터 전달받는 소프트 라벨(Soft label)의 분포 특성을 결정한다. 일반적으로 온도 값이 커질수록 분포가 완만해져 클래스 간 유사성이 강조되고, 작을수록 분포가 날카로워져 원-핫 라벨(One-hot label)과 유사해진다. 본 연구에서는 온도가 AURA-KD의 성능에 미치는 영향을 확인하고자, τ ∈ {1,2,4,6,8} 값에 대해 실험을 진행하였다. 다른 모든 하이퍼파라미터는 고정한 채로 온도만을 변경하여 학생 모델의 분류 정확도를 측정하였다. 실험 결과는 온도 값에 따라 AURA-KD의 성능이 크게 달라진다는 점을 명확히 보여준다. 특히 τ=4일 때 가장 높은 정확도(95.57%)를 기록하였으며, 이보다 작거나 큰 온도 값에서는 성능이 현저히 감소하였다, 이는 기존 연구들과 일치하는 경향으로, 적절히 부드러워진 확률 분포가 교사 모델의 정보를 효과적으로 학생 모델에게 전달할 수 있음을 시사한다.

구체적으로는, τ=1일 경우 소프트 라벨이 너무 확신을 가지게 되어 일반적인 원-핫 라벨과 크게 다르지 않으며, τ=8과 같이 과도하게 높은 값은 분포를 지나치게 평탄하게 만들어 클래스 경계를 모호하게 함으로써 학습을 방해할 수 있다. 반면, τ=4는 학습의 안정성과 정보 전달의 균형을 잘 맞춘 값으로 판단된다. 결론적으로 본 추가 실험에서는 AURA-KD에서의 온도 파라미터 조정이 중요한 요소임을 실험적으로 검증하였다. 본 논문에서 이루어지는 모든 실험은 최적의 온도 값으로 확인된 τ=4를 기본 설정값으로 사용하였다.

Ⅴ. 결 론

본 연구에서는 제안된 AURA-KD 프레임워크를 통해 SAR 이미지 분류 작업에서 지식 증류를 활용한 성능 향상을 입증하였다. 제안된 프레임워크는 오프라인 교사 모델과 온라인 교사 모델의 지식을 동시에 활용하고, 두 교사 모델의 예측 불확실성을 엔트로피를 통해 정량화하여 동적으로 가중치를 부여하는 방식을 사용하였다. 특히, 각 교사의 예측 결과에서 계산된 엔트로피를 기반으로 손실의 상대적 중요도를 평가하고, 이를 통해 오프라인과 온라인 교사 모델의 장점을 효과적으로 결합하였다. 실험 결과, 제안된 방법은 기존의 단일 교사 모델 기반 지식 증류 기법이나 변형 모델에 비해 우수한 정확도와 안정적인 학습 성능을 보였다. 이는 SAR 영상이 가지는 복잡한 배경과 높은 노이즈 수준에서도 모델의 일반화 성능을 효과적으로 향상시킬 수 있음을 의미한다.

현재 연구는 SAR 데이터셋에 특화된 이미지 분류 작업에 초점을 맞추었으며, 데이터 전처리 단계가 특정 도메인 특성에 맞춰 설계되었다. 또한 OpenSARShip 데이터셋에서의 심각한 클래스 불균형을 피하고자 데이터가 풍부한 특정 클래스(Bulk carrier, Container ship, Tanker)에 집중하여 실험을 수행했다. 이러한 설정은 학습 안정성에는 기여하지만, 전체 데이터셋을 포괄하지 않아 빈도가 낮은 소수 클래스까지 성능 향상이 그대로 확장된다는 보장을 제공하지 못하며, 일반화 성능의 한계 또한 존재할 수 있다. 향후 연구에서는 다양한 데이터셋과 작업에 대한 실험을 통해 제안된 프레임워크를 발전시켜 일반화 성능을 향상시킬 예정이다. 이러한 노력은 지식 증류 및 가중치 조절 기반 학습의 발전에 기여할 뿐만 아니라, 관련 작업에서 더 넓은 응용 가능성을 가속화할 것으로 기대된다.

Acknowledgments

이 논문은 한국항공대학교 교내 연구비의 지원을 받아 수행된 연구임

References

-

J.C. Curlander and R.N. McDonough, Synthetic Aperture Radar: Systems and Signal Processing, Wiley, New York, pp.1-15, 1991.

[https://doi.org/10.1016/0165-1684(92)90103-4]

-

H. Choi and J. Jeong, “Speckle Noise Reduction Technique for SAR Images Using Statistical Characteristics of Speckle Noise and Discrete Wavelet Transform,” Remote Sensing, Vol. 11, No. 10, pp. 1184, 2019.

[https://doi.org/10.3390/rs11101184]

-

J. Gou, B. Yu, S. J. Maybank, and D. Tao, “Knowledge Distillation: A Survey,” International Journal of Computer Vision, Vol. 129, No. 6, pp. 1789–1819, June 2021.

[https://doi.org/10.1007/s11263-021-01453-z]

-

G. Hinton, O. Vinyals, and J. Dean, “Distilling the Knowledge in a Neural Network,” Proceedings of the NIPS Deep Learning and Representation Learning Workshop, Montreal, Canada, pp. 1–9, 2015.

[https://doi.org/10.48550/arXiv.1503.02531]

-

A. Romero, N. Ballas, S. E. Kahou, A. Chassang, C. Gatta, and Y.Bengio, “FitNets: Hints for Thin Deep Nets,” International Conference on Learning Representations (ICLR), 2015.

[https://doi.org/10.48550/arXiv.1412.6550]

-

J. Yim, D. Joo, J. Bae, and J. Kim, “A Gift from Knowledge Distillation: Fast Optimization, Network Minimization and Transfer Learning,” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp. 4133–4142, July 2017.

[https://doi.org/10.1109/CVPR.2017.754]

-

S. Zagoruyko and N. Komodakis, “Paying More Attention to Attention:Improving the Performance of Convolutional Neural Networks via Attention Transfer,” International Conference on Learning Representations (ICLR), 2017.

[https://doi.org/10.48550/arXiv.1612.03928]

-

R. Anil, G. Pereyra, A. Passos, R. Ormandi, G. E. Dahl, and G. E. Hinton, “Large Scale Distributed Neural Network Training through Online Distillation,” International Conference on Learning Representations (ICLR), pp.1223-1234, 2018.

[https://doi.org/10.48550/arXiv.1804.03235]

-

Y. Zhang, T. Xiang, T. M. Hospedales, and H. Lu, “Deep Mutual Learning,” Proceedings ozf the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp. 4320–4328, June 2018.

[https://doi.org/10.1109/CVPR.2018.00454]

-

L. Zhang, J. Song, A. Gao, J. Chen, C. Bao, and K. Ma, “Be Your Own Teacher: Improve the Performance of Convolutional Neural Networks via Self Distillation,” Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV), pp. 3713–3722, October 2019.

[https://doi.org/10.1109/ICCV.2019.00381]

-

K. He, X. Zhang, S. Ren, and J. Sun, “Deep Residual Learning for Image Recognition,” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, USA, pp. 770–778, 2016.

[https://doi.org/10.1109/CVPR.2016.90]

-

K. Simonyan and A. Zisserman, “Very Deep Convolutional Networks for Large-Scale Image Recognition,” Proceedings of the International Conference on Learning Representations (ICLR), San Diego, USA, pp. 1–14, 2015.

[https://doi.org/10.48550/arXiv.1409.1556]

-

K. Kwon, H. Na, H. Lee and N. S. Kim, “Adaptive Knowledge Distillation Based on Entropy,” ICASSP 2020 - 2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), Barcelona, Spain, 2020.

[https://doi.org/10.1109/ICASSP40776.2020.9054698]

-

B. Li, B. Liu, L. Huang, W. Guo, Z. Zhang and W. Yu, “OpenSARShip 2.0: A large-volume dataset for deeper interpretation of ship targets in Sentinel-1 imagery,” 2017 SAR in Big Data Era: Models, Methods and Applications (BIGSARDATA), Beijing, China, 2017.

[https://doi.org/10.1109/JSTARS.2017.2755672]

- AFRL and DARPA, “Sensor data management system website, MSTAR database,” 1995. https://www.sdms.afrl.af.mil/index.php?collection=mstar, (accessed: 13-May-2020).

- 2024년 8월 : 한국항공대학교 소프트웨어학과 학사

- 2024년 ~ 현재 : 한국항공대학교 인공지능학과 석사

- ORCID : https://orcid.org/0009-0000-9117-7917

- 주관심분야 : 컴퓨터비전, 영상처리, 지식증류

- 2004년 : RMC Physics and Mathematics B.S

- 2007년 : The State University of New York at Stony Brook Physics Ph.D. Candidate

- 2007년 : The State University of New York at Stony Brook Computer Science Ph.D

- 2021년 ~ 현재 : 한국항공대학교 조교수

- ORCID : https://orcid.org/0000-0002-9495-0693

- 주관심분야 : 인공지능의 원리, 양자 인공지능, 양자 알고리즘