에너지 효율적인 스파이킹 신경망과 양방향 특징 피라미드 네트워크를 결합한 개선된 객체 탐지 모델

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

합성 개구 레이더(Synthetic Aperture Radar, SAR) 영상에서의 정확한 선박 탐지는 해양 분야에 필수적이다. 그러나 SAR 영상의 데이터 복잡성과 효율성 요구로 인해 기존의 딥러닝 모델은 한계에 봉착하고 있다. 본 연구에서는 스파이킹 신경망(Spiking Neural Network, SNN) 백본 EMS-ResNet과 양방향 특징 피라미드 네트워크(Bidirectional Feature Pyramid Network, BiFPN)를 결합한 새로운 모델을 제안한다. EMS-ResNet은 스파이킹 뉴런으로 효율성을 높여 고해상도 SAR 영상 처리에 적합하며, BiFPN은 다중 스케일 특징 융합으로 선박 탐지 성능을 향상시킨다. High-Resolution SAR Images Dataset(HRSID)을 이용해 실험한 결과, 제안 모델은 우수한 탐지 성능을 보였고, 특히 파라미터 수를 크게 감소시켜 기존 모델들에 비해 에너지 소비 측면에서 뛰어난 결과를 보였다.

Abstract

Accurate ship detection in Synthetic Aperture Radar (SAR) imagery is essential for the maritime sector. However, existing deep learning models encounter limitations due to the complexity of SAR data and the demands for computational efficiency. In this study, we propose a novel model that integrates the Spiking Neural Network (SNN) backbone EMS-ResNet with the Bidirectional Feature Pyramid Network (BiFPN). EMS-ResNet enhances efficiency through spiking neurons, making it well-suited for processing high-resolution SAR images, while BiFPN improves ship detection performance through multi-scale feature fusion. Experimental results utilizing the High-Resolution SAR Images Dataset (HRSID) demonstrate that the proposed model achieves superior detection performance and, notably, significantly reduces the number of parameters, resulting in outstanding energy efficiency compared to existing models.

Keywords:

Synthetic aperture radar (SAR) image, Ship detection, Deep learning, Spiking neural network (SNN)Ⅰ. 서 론

인공신경망(Artificial Neural Network, ANN)의 발전으로 인공지능은 다양한 분야에서 활용되고 있다. 특히 객체 탐지 기술은 이미지나 비디오에서 객체를 식별하고 위치를 파악하는 데 중요한 역할을 하며[1], 해양 분야에서도 그 중요성이 커지고 있다[2]. 해상 운송은 전 세계 무역과 경제 발전에 핵심적인 역할을 하며, 해상 운영의 안전과 보안을 보장하는 것이 매우 중요하다[3]. 해상 교통량의 증가와 다양한 해상 활동의 복잡성으로 인해 효율적인 선박 탐지의 필요성은 더욱 커지고 있다. 그러나 기존의 선박 탐지 방법은 날씨나 조명 조건에 따라 성능이 크게 좌우되는 한계에 직면했다[4]. 이를 해결하기 위해 합성 개구 레이더(Synthetic Aperture Radar, SAR) 영상 기술이 주목받고 있다. SAR은 날씨 조건이나 주야 구분 없이 고해상도 이미지를 제공할 수 있어, 해상 감시에 필수적인 도구로 부상했다. SAR는 전파 기반 센서로, 다양한 환경에 제약받지 않고 정밀한 탐지가 가능하다는 장점이 있다[5]. SAR 영상에서의 정확한 선박 탐지는 해상 교통 관리, 불법 어업 방지, 밀수 차단, 환경 모니터링 등 다양한 응용 분야에 필수적이다[6]. 그러나 SAR 영상은 스펙클 노이즈, 복잡한 해양 클러터, 그리고 선박 크기와 방향의 광범위한 변화 등으로 인한 여러 도전 과제를 안고 있다. 이러한 문제를 해결하기 위해 딥러닝 기반의 방법들이 도입되었고, 특히 You Only Look Once(YOLO)[7]와 같은 모델들이 SAR 선박 탐지에서 좋은 성능을 보였다. 최근 Yu와 Shin은 양방향 특징 피라미드 네트워크(Bidirectional Feature Pyramid Network, BiFPN)와 통합된 개선된 YOLOv5 모델을 제안하여 다중 스케일 특징 융합을 강화하고, SAR 영상에서 다양한 크기의 선박을 더 잘 탐지할 수 있게 했다[8]. 그러나 이러한 모델들은 여전히 계산 집약적이고 에너지 소비가 많아 실시간 또는 자원 제약 환경에서의 적용에 한계가 있다. 이러한 에너지 효율성 문제를 해결하기 위해, 스파이킹 신경망(Spiking Neural Networks, SNN)이 주목받고 있다. SNN은 실제 생물의 뇌의 신경 세포가 작동하는 방식과 유사하게 동작하도록 설계하였기 때문에 높은 생물학적 타당성을 가진다[9]. 또한, 뉴런이 특정 이벤트가 발생했을 때만 활동하는 이벤트 기반 특성을 가지고 있어 신경망이 지속적으로 활성화되지 않고 필요한 경우에만 활성화된다. 이러한 이벤트 기반 특성은 에너지 효율성을 높이고, 전력 소비를 줄이는 데 큰 역할을 한다. 이와 같은 특성들로 인해 현재 SNN은 ANN의 잠재적 대안으로 연구되고 있다. 특히, EMS-YOLO 모델은 SNN 기반 객체 탐지에서 뛰어난 에너지 효율성과 성능을 보여주었다[10]. 본 연구에서는 SNN의 에너지 효율성과 BiFPN의 강력한 특징 융합 능력을 결합한 새로운 SAR 선박 탐지 프레임워크를 제안한다. 구체적으로, EMS-ResNet(Energy-efficient Membrane-Shortcut ResNet) 백본과 BiFPN 헤드를 통합하여 에너지 효율성을 극대화하면서도 다양한 크기의 선박을 효과적으로 탐지할 수 있는 모델을 개발했다. 이 접근 방식은 SAR 영상의 복잡한 특성을 효과적으로 처리하면서도 실시간, 자원 제약 환경에서의 적용 가능성을 높일 것으로 기대된다.

Ⅱ. 본 론

1. 관련연구

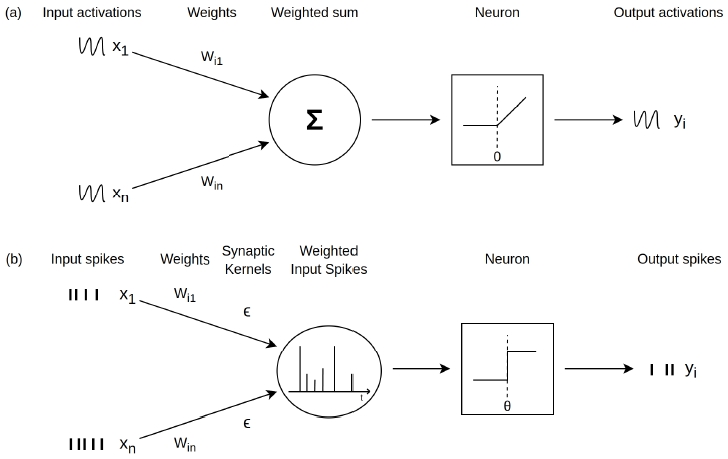

스파이킹 신경망(SNN)은 에너지 효율성과 시간 정보 처리 능력으로 인해 전통적인 인공 신경망(ANN)의 유망한 대안으로 부상하고 있다[9]. 연속적인 활성화 함수를 사용하는 ANN과 달리, SNN은 이산적인 스파이크를 통해 통신함으로써 생물학적 뉴런의 이벤트 기반 특성을 모방한다(그림 1).

ANN(a) vs SNN(b): This figure compares the structural differences and operational mechanisms between traditional artificial neural networks (ANN) and spiking neural networks (SNN). While ANN uses continuous activation functions, SNN processes information using discrete and asynchronous spikes

SNN에서 뉴런의 막전위는 시간에 따라 입력 신호를 통합하고, 이 전위가 특정 임계값을 초과하면 뉴런은 스파이크를 발생시키고 전위를 리셋한다[11]. 이 메커니즘은 유의미한 입력이 있을 때만 뉴런이 활성화되므로 불필요한 연산을 줄여 SNN이 효율적으로 작동할 수 있게 한다.

SNN의 이벤트 기반 처리 방식은 시간적 정보를 효과적으로 활용할 수 있게 한다. 이미지나 센서 신호 등의 입력 데이터는 스파이크 열로 변환되는데, 이 과정에서 입력의 세기와 시간 정보가 함께 인코딩된다. 이러한 시간적 인코딩 덕분에 SNN은 데이터의 시공간적 패턴을 정확히 포착할 수 있다. 이러한 특성으로 인해 SNN은 실시간 처리가 필요하거나 저전력 동작이 요구되는 응용 분야에 특히 적합하다.

심층 SNN을 개발하는 것은 스파이크 생성의 미분 불가능한 특성으로 인해 도전적이다. 이는 그래디언트 기반 훈련 방법의 사용을 복잡하게 만든다. 심층 SNN을 훈련시키기 위해 두 가지 주요 접근 방식이 탐구되었다[12].

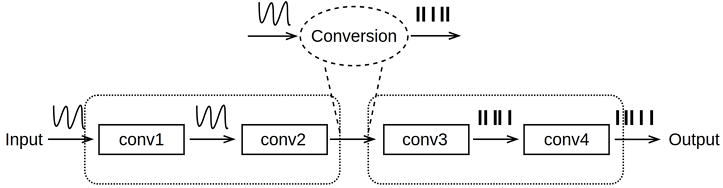

첫째, ANN-to-SNN 변환 방법은 기존 ANN의 훈련 용이성과 SNN의 에너지 효율성을 결합하는 접근법이다[13](그림 2). 이 방법은 먼저 ReLU 활성화 함수를 사용하여 표준적인 방식으로 ANN을 훈련한다. 이 단계에서는 역전파 알고리즘을 통해 네트워크의 가중치를 최적화한다. 훈련이 완료된 후, ANN의 ReLU 뉴런을 스파이킹 뉴런으로 대체한다. 이 과정에서 각 레이어의 활성화 값은 스파이크 발생 빈도로 해석된다. 변환된 네트워크가 원래 ANN의 성능을 유지하도록 여러 기술이 적용된다. 가중치 정규화는 각 레이어의 가중치를 조정하여 스파이크 발생 빈도가 원래 ANN의 활성화 값과 일치하도록 한다. 또한, 임계값 조정을 통해 스파이킹 뉴런의 발화 임계값을 최적화하여 정보 전달을 개선한다. 이 방법의 주요 장점은 기존 ANN 훈련 기법을 활용할 수 있다는 것이다. 그러나 몇 가지 한계점도 존재한다. 변환된 SNN이 ANN과 동등한 성능을 달성하기 위해서는 많은 타임 스탭이 필요할 수 있다. 이는 각 뉴런이 충분한 스파이크를 생성하여 정확한 활성화 수준을 표현해야 하기 때문이다. 또한, 연속적인 활성화 값을 이산적인 스파이크로 변환하는 과정에서 미세한 정보 손실이 발생할 수 있으며, ANN의 넓은 활성화 범위를 제한된 스파이크 주파수로 매핑하는 데 어려움이 있을 수 있다.

ANN to SNN conversion: This figure illustrates the process of converting continuous signals in an ANN into spike-based signals in an SNN. After the conversion, the SNN processes information through spike signals

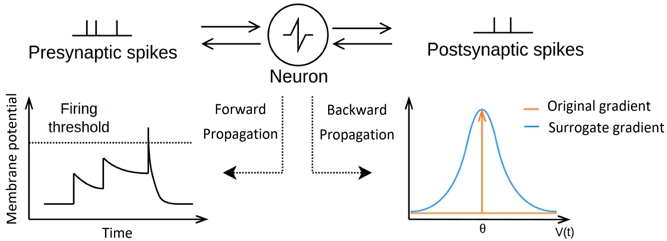

둘째, Surrogate Gradient 방법은 SNN의 직접 훈련을 가능하게 하는 접근법이다[14](그림 3). ANN의 성공이 역전파에 크게 의존한다는 점에 착안하여, 연구자들은 SNN에서도 유사한 방식을 적용하고자 했다. SNN에서 각 뉴런은 막전위를 축적하다가 특정 임계값을 초과하면 스파이크를 발생시키는데, 이 과정은 비연속적이고 미분 불가능하다. 이러한 스파이크의 특성으로 인해 기존의 역전파를 통한 학습이 어렵다. 이 문제를 해결하기 위한 Surrogate Gradient 방법은 스파이크 발생 여부를 연속적인 함수로 근사하여 기울기를 계산한다. 이 방법을 통해 SNN은 시간적 정보를 효과적으로 처리할 수 있게 되며, 스파이크 타이밍에 대한 기울기를 근사하여 학습이 가능해진다. Surrogate Gradient는 SNN의 고유한 특성을 유지하면서도 효율적인 학습을 가능하게 하는 중요한 기술이다.

Surrogate gradient: This figure shows the learning process of the Surrogate Gradient in spiking neural networks (SNN). The neuron's membrane potential changes over time as it integrates input spikes, and when it exceeds a certain threshold, the neuron fires a spike. During backpropagation, the original gradient is non-differentiable, but the surrogate gradient approximates it with a continuous function, allowing backpropagation to proceed

스파이킹 신경망(SNN)을 활용한 객체 탐지 연구는 최근 컴퓨터 비전 분야에서 주목받고 있다. 특히, 에너지 효율성과 실시간 처리 능력이 요구되는 응용 분야에서 SNN의 잠재력이 크게 부각되고 있다[15]. EMS-YOLO 모델[10]은 이 분야의 주요 성과 중 하나로, 기존 ANN 기반 모델들과 비교하여 현저히 향상된 에너지 효율성을 제시했다. 이 모델은 다중 스케일 객체 특징을 효과적으로 처리하기 위해 깊은 네트워크 구조를 채택했으며, 이 과정에서 발생하는 기울기 소실/폭발(gradient vanishing/exploding) 문제를 해결하기 위해 완전 스파이크 잔차 블록(full-spike residual block)인 EMS-ResNet을 도입했다. EMS-ResNet의 핵심은 스파이킹 뉴런 간의 직접적인 연결을 통해 정보 흐름을 최적화하는 것이다. 이를 통해 비스파이킹 합성곱 연산의 필요성을 줄이고, 결과적으로 에너지 소비를 크게 감소시켰다. 최근의 연구들은 SNN 기반 객체 탐지의 성능을 더욱 향상시키기 위해 다양한 접근법을 시도하고 있다[16].

YOLO-BiFPN[8]은 YOLO 시리즈를 활용하여 SAR 이미지 기반 선박 탐지를 수행했으며, SAR Ship Detection Dataset (SSDD)[17]과 High Resolution SAR Images Dataset (HRSID)[18]를 사용하여 실험을 진행하였다. 그러나 SAR 선박 이미지는 선박이 작고 드문드문 분포되어 있어, YOLO 시리즈와 같은 단일 단계 탐지 알고리즘에서 잘못된 탐지나 탐지 누락이 발생하는 한계가 있었다. 이는 SAR 이미지에서 선박의 특징 정보가 제한적이고, 다양한 크기의 선박과 작은 배들이 많아 탐지 모델의 수용 범위가 부족하며, 특징 추출 능력이 제한되기 때문이다. 이러한 문제를 해결하기 위해 YOLO-BiFPN은 BiFPN을 적용하여 SAR 이미지의 다양한 크기 문제와 작은 객체의 탐지 정확도를 개선하고, Coordinate Attention Mechanism을 추가하여 특징 추출 능력을 향상시켰다[19]. 이러한 접근 방식은 SAR 이미지에서의 선박 탐지 성능을 향상시키는 데 기여했으나, 여전히 에너지 효율성과 실시간 처리 능력 면에서 개선의 여지가 있다.

2. 제안 방법

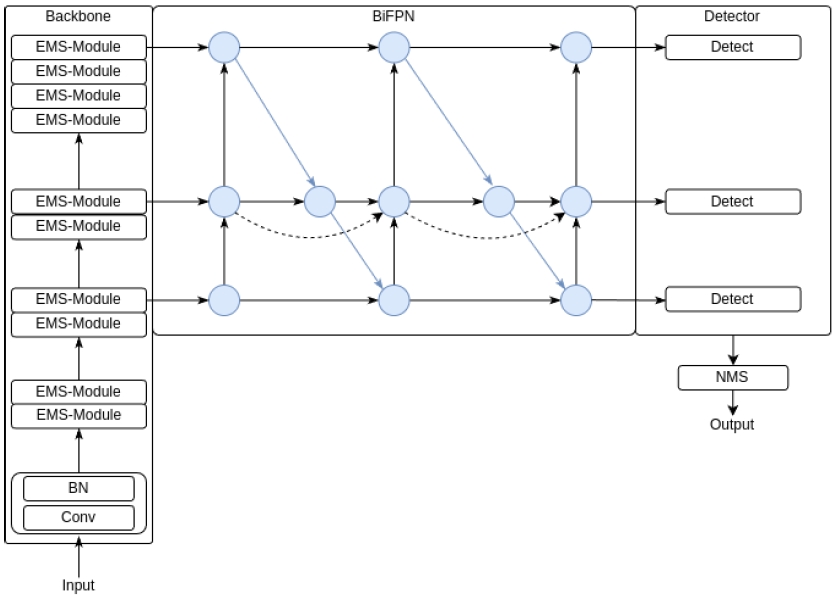

본 연구에서는 에너지 효율적인 스파이킹 신경망(SNN)의 특성과 효과적인 특징 융합 능력을 가진 양방향 특징 피라미드 네트워크(BiFPN)[8]를 결합한 개선된 객체 탐지 모델을 제안한다. 이 방법은 합성 개구 레이더(SAR) 영상에서 작은 목표물의 정확한 위치 추적을 위해 탐지 정확도와 효율성을 향상시키는 것을 목표로 한다. 제안된 방법의 핵심 구성 요소는 다음과 같다.

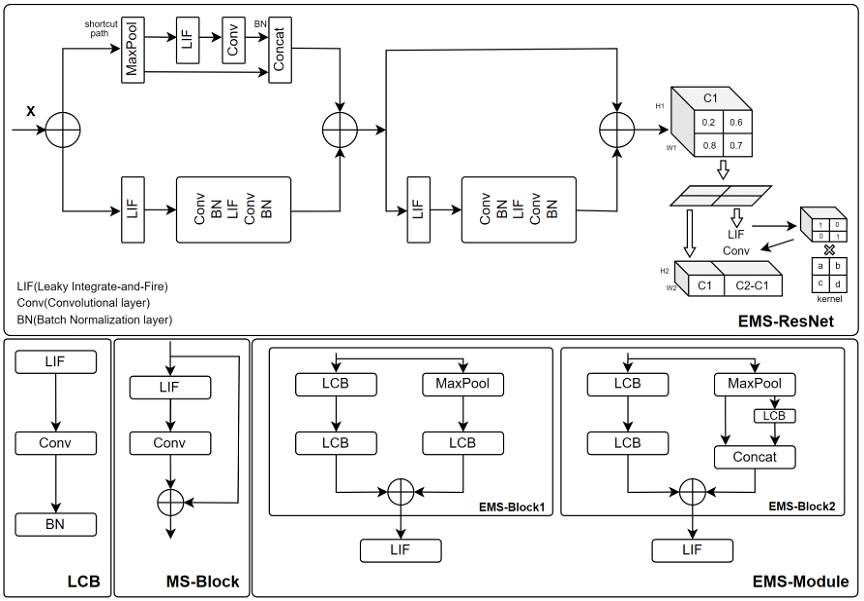

먼저, 효율적인 특징 추출을 위해 EMS-ResNet을 모델의 백본으로 사용한다[10](그림 4).

EMS-ResNet: This figure illustrates the structure of EMS-ResNet. The entire network operates using only spike signals

이는 새로운 직접 학습 스파이킹 신경망으로, 전통적인 신경망의 높은 에너지 소비 문제를 완화하면서도 성능을 유지한다. 이를 통해 본 모델은 적은 타임 스텝으로 높은 탐지 정확도를 유지하며 에너지 소비를 크게 감소시킬 수 있다. EMS-ResNet의 구조는 채널 수와 차원 변화에 따라 특별히 설계되었다. Residual 경로에는 MS-ResNet의 개념을 적용하였으며, Shortcut 경로에서는 채널 수 변화 시 컨볼루션 이전에 추가적인 LIF(Leaky Integrate-and-Fire) 뉴런을 배치하여 정보를 희소 스파이크로 변환한다[20]. 이를 통해 전체 네트워크가 완전히 스파이크 기반으로 동작할 수 있게 된다.

EMS-ResNet의 핵심 구성 요소인 LCB(LIF-Conv-BN)는 LIF 뉴런, 컨볼루션 레이어, 배치 정규화를 순차적으로 결합한 구조로, 스파이크 기반 정보 처리와 특징 추출을 효율적으로 수행한다. EMS-Block은 두 가지 형태로 구현된다. 채널 수가 일정하거나 감소할 때는 EMS-Block1을 사용하고, 채널 수가 증가할 때는 EMS-Block2를 사용한다. EMS-Block2는 파라미터 수를 줄이면서 특징을 재사용하기 위해 연결(concatenation) 연산을 활용한다. 또한, 객체 탐지 작업에서 특징 추출 시 일반적으로 사용되는 일정한 다운샘플링을 고려하여 maxpool을 도입함으로써 파라미터 수를 추가로 감소시켰다. 이러한 구조적 특성으로 인해 EMS-ResNet은 적은 타임 스텝으로도 높은 탐지 정확도를 유지하면서 에너지 소비를 크게 감소시킬 수 있다.

또한, SAR 영상에서 작은 목표물의 탐지와 낮은 재현율 문제를 해결하기 위해 양방향 특징 피라미드 네트워크(BiFPN)를 모델에 통합한다(그림 5).

BiFPN structure: BiFPN integrates not only the downward pathway but also the upward pathway, effectively combining features extracted from multiple scales to detect objects of various sizes more accurately

BiFPN은 다중 스케일 특징 융합을 촉진하여 공간 및 의미 정보를 보다 효과적으로 포착할 수 있게 한다. 해당 접근법을 기반으로 네트워크의 헤드 부분에 BiFPN 구조를 적용하여 SAR 선박 탐지의 특성에 최적화하였다.

마지막으로, Surrogate Gradient 기반의 학습 전략[14]을 사용하여 직접 학습된 심층 SNN 모델을 객체 탐지의 회귀 과제에 적용한다. 모델은 객체 클래스와 경계 상자 좌표를 예측하기 위해 크로스 엔트로피 손실을 사용하여 엔드 투 엔드 방식으로 학습된다. 직접 학습된 SNN 접근법을 통해 기존의 인공 신경망(ANN)과 비교하여 경쟁력 있는 성능을 유지하면서도 에너지 소비를 크게 줄일 수 있다. 인용된 모델들과 제안된 모델의 비교를 표 1에 요약하여 제시하였다.

Ⅲ. 실험 및 결과

1. 실험 설정

본 연구에서는 High-Resolution SAR Images Dataset (HRSID)[18]를 사용하여 모델의 성능을 평가하였다. HRSID는 총 5,601개의 고해상도(800x800 픽셀) SAR 영상으로 구성되어 있으며, 이 중 3,922개의 이미지를 훈련에, 1,120개의 이미지를 검증에 사용하였고, 나머지 이미지는 테스트용으로 남겨두었다. 이 데이터셋은 단일 클래스인 선박에 대한 경계 상자 정보를 제공하며, 다양한 해양 환경과 선박 크기를 포함하고 있어 실제 상황에서의 모델 성능을 평가하기에 적합하다. 모델 훈련 및 평가는 NVIDIA GeForce RTX 3080 GPU 1대를 사용하여 수행되었다. 훈련 과정에서는 SGD(Stochastic Gradient Descent) 옵티마이저를 사용하였으며, 가중치 감쇠는 1e-4로 설정하였다. 모델은 총 300 에폭 동안 훈련되었으며, 최적의 성능을 보이는 파라미터를 선택하여 테스트에 사용하였다. 배치 크기는 4로 설정하였고, NMS(Non-Maximum Suppression) 임계값은 0.45를 사용하였다. 주요 평가 지표로는 평균 정밀도(Average Precision, AP), 정밀도(Precision), 그리고 재현율(Recall)을 사용하였다. AP.5:.95는 IoU 임계값 [0.5:0.05:0.95] 범위에서의 평균 정밀도를 나타낸다. 정밀도는 모든 양성 예측 중 참 양성의 비율을 측정하여 모델 예측의 정확성을 나타내며, 재현율은 모든 실제 양성 중 참 양성의 비율을 측정하여 모델의 관련 인스턴스 식별 능력을 나타낸다. 이러한 지표들은 YOLO 계열 모델을 포함한 객체 탐지 모델의 평가에 널리 사용되며, 연구에서 제안한 EMS-BiFPN 모델의 성능을 기존 모델들과 비교하는 데 활용되었다.

2. 실험 결과

본 연구에서는 제안한 EMS-BiFPN 모델과 기존의 주요 객체 탐지 모델들을 High-Resolution SAR Images Dataset (HRSID)을 사용하여 비교 평가하였다. 실험 결과는 다음 표 2와 같이 요약되었다.

This table compares the energy efficiency and performance metrics of ANN/SNN-based object detection models

제안한 EMS-BiFPN 모델은 Precision이 0.89로 SHIP-YOLO(0.804) 및 EMS-YOLO(0.865)보다 우수한 성능을 보였다. 이는 EMS-ResNet 백본이 에너지 효율적인 스파이킹 뉴런을 활용하여 높은 정확성을 유지하면서도 에너지 소비를 최소화했기 때문이다. 특히, EMS-BiFPN은 YOLOv5+BiFPN 대비 파라미터 수는 줄었으나 높은 Precision을 유지함으로써 모델의 효율성과 정확성 간의 우수한 균형을 달성하였다. 또한, AP.5:.95 지표에서도 기존 SNN 모델인 EMS-YOLO보다 향상된 0.47을 기록하여, BiFPN의 다중 스케일 특징 융합이 탐지 성능에 긍정적인 영향을 미쳤음을 확인할 수 있었다.

EMS-BiFPN 모델은 Time Step을 1로 설정하여 EMS-YOLO의 3단계에 비해 실시간 처리에 더욱 적합한 성능을 보였다. 단일 Time Step으로도 높은 Precision을 유지할 수 있었던 것은 EMS-ResNet과 BiFPN의 효과적인 결합 덕분으로, 이는 실시간 선박 감시 응용에서의 즉각적인 대응 가능성을 높였다. 실시간 처리가 요구되는 환경에서 EMS-BiFPN의 낮은 Time Step은 모델의 응답 속도를 크게 향상시켜, 신속한 의사결정과 대응을 가능하게 한다.

BiFPN 헤드의 도입으로 인해 EMS-BiFPN 모델은 다양한 크기의 선박을 효과적으로 탐지할 수 있었다. BiFPN은 다중 스케일 특징 융합을 강화하여 공간적 및 의미적 정보를 보다 정교하게 통합함으로써, 복잡한 해양 환경에서도 작은 선박을 포함한 다양한 크기의 선박을 정확하게 탐지할 수 있었다. 이는 SAR 영상에서의 선박 탐지 성능을 크게 향상시키는 주요 요인으로 작용하였다.

제안한 EMS-BiFPN 모델은 20M의 파라미터를 사용하여 YOLOv5+BiFPN의 52M에 비해 파라미터 수를 크게 줄이면서도 높은 Precision을 유지하였다. 이는 모델의 경량화와 에너지 효율성 측면에서 큰 장점을 제공하며, 자원 제약이 있는 환경에서도 효과적으로 적용될 수 있음을 시사한다. 또한, SNN 기반의 EMS-BiFPN은 이벤트 기반 특성을 통해 불필요한 연산을 최소화하여 에너지 소비를 더욱 절감할 수 있었다. 이러한 최적화는 실제 배치 환경에서의 전력 소모를 줄이는 데 중요한 역할을 하며, 장기적으로 지속 가능한 해양 감시 시스템 구축에 기여할 수 있다.

EMS-BiFPN 모델은 높은 정확도와 에너지 효율성을 동시에 달성함으로써, SAR 영상 기반 선박 탐지에서 기존 ANN 및 SNN 기반 모델들에 비해 우수한 성능을 입증하였다. 특히, 실시간 처리 능력과 다중 스케일 특징 융합의 강화는 해양 감시와 같은 실시간 응용 분야에서의 실질적인 활용 가능성을 높였다. 이러한 장점들은 EMS-BiFPN이 자원 제약이 있는 환경에서도 효과적으로 동작할 수 있는 강력한 객체 탐지 모델임을 보여준다. 또한, AP.5:.95 지표에서의 향상된 성과는 제안 모델이 복잡한 해양 환경에서도 다양한 크기의 선박을 정확하게 탐지할 수 있음을 나타낸다.

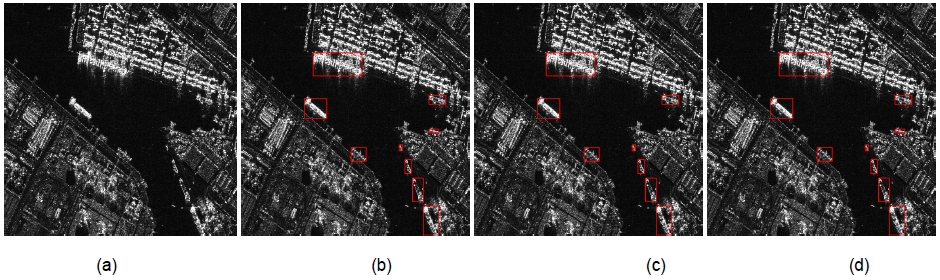

여러 검증 배치에서의 시각화 결과를 통해 SNN 기반의 제안 모델과 EMS-YOLO 모델[10]의 성능을 정성적으로 비교하였다(그림 6). 제안 모델은 높은 신뢰도와 낮은 오탐지 수를 유지함으로써 탐지 결과의 신뢰성과 정확성을 동시에 강화하였다. 반면, EMS-YOLO 모델은 일부 배치에서 오탐지가 많이 발생하였는데, 이는 복잡한 환경이나 데이터의 난이도에 따라 상대적으로 더 많은 오탐지가 발생할 수 있음을 시사한다. 제안 모델은 여러 배치에서 일관된 탐지 성능을 보였으며, 이는 다양한 데이터 조건에서도 안정적으로 동작할 가능성이 높음을 나타낸다. 이러한 결과는 실제 해양 환경에서의 선박 탐지 응용에 있어 제안된 모델의 실용성과 우수성을 뒷받침한다.

Spiking Neural Networks Ship Detection Results: This figure illustrates the ship detection results using spiking neural networks. (a) The original image from the HRSID dataset, (b) the ground truth image from the HRSID dataset, (c) the results from EMS-YOLO, and (d) the results from the proposed method. The proposed method demonstrates superior ship detection performance compared to existing spiking neural network-based models

Ⅳ. 결 론

본 연구에서는 SAR 영상에서의 선박 탐지를 위해 EMS-ResNet과 BiFPN을 결합한 새로운 SNN 기반 탐지 모델인 EMS-BiFPN을 제안하였다. 제안한 모델은 ANN 기반 모델에 비해 훨씬 적은 에너지를 소비하면서도 경쟁력 있는 성능을 유지할 수 있었다. 또한, 다중 스케일 특징 융합을 통해 다양한 크기의 선박을 효과적으로 탐지할 수 있는 구조를 갖추어, SAR 영상에서의 선박 탐지 성능을 향상시켰다. 본 연구의 결과는 선박 탐지를 포함한 자원 제약이 있는 응용 분야에서 효율적이고 경쟁력 있는 성능의 객체 인식을 가능하게 하였으며, 장기적으로는 더 큰 효율성을 기대할 수 있다. 향후 연구에서는 에너지 효율성을 더욱 높이면서 성능도 함께 향상시킬 수 있는 방법에 대한 연구가 필요하다. BiFPN 구조의 최적화와 SNN의 학습 전략 개선을 통해 모델의 AP 지표를 향상시키고, 다양한 환경 조건에서의 적용 가능성을 더욱 넓히는 것이 중요한 과제가 될 것이다. 또한, 실시간 응용 분야에서의 실질적인 배치를 목표로, 하드웨어 최적화와 모델 경량화 기술을 병행하여 연구를 진행할 예정이다. 이러한 연구를 통해 EMS-BiFPN 모델은 더욱 다양한 응용 분야에서 효율적이고 실용적인 객체 탐지 솔루션으로 발전할 것으로 기대된다.

Acknowledgments

This work was supported by the National Research Foundation of Korea(NRF) grant funded by the Korea government(MSIP) (NRF-2021R1C1C2005202). (Corresponding author: Sunok Kim)

References

-

Z. Zhao, P. Zheng, S. Xu, X. Wu, “Object Detection with Deep Learning: A Review,” IEEE Transactions on Neural Networks and Learning Systems, pp.1-21, January 2019.

[https://doi.org/10.1109/TNNLS.2018.2876865]

-

N. Wang, Y. Wang, M J. Er, “Review on deep learning techniques for marine object recognition: Architectures and algorithms,” Control Engineering Practice, Vol.118, pp.104458, May 2020.

[https://doi.org/10.1016/j.conengprac.2020.104458]

-

A. Felski, K. Zwolak, “The Ocean-Going Autonomous Ship—Challenges and Threats,” Journal of Marine Science and Engineering, Vol.8, January 2020.

[https://doi.org/10.3390/jmse8010041]

-

Y. Wang, X. Ning, B. Leng, H. Fu, “Ship Detection Based on Deep Learning,” IEEE International Conference on Mechatronics and Automation, pp.275-279, August 2019.

[https://doi.org/10.1109/ICMA.2019.8816265]

-

Y. Wang, C. Wang, H. Zhang, “Ship Classification in High-Resolution SAR Images Using Deep Learning of Small Datasets,” Sensors, Vol.18, pp.2929, September 2018.

[https://doi.org/10.3390/s18092929]

-

J. Li, C. Xu, H. Su, L. Gao, T. Wang, “Deep learning for SAR ship detection: Past, present and future,” Remote Sensing, Vol. 14, No. 11, 2712, May 2022.

[https://doi.org/10.3390/rs14112712]

-

J. Redmon, S. Divvala, R. Girshick, A. Farhadi, “You only look once: Unified, real-time object detection,” IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp.779–788, June 2016.

[https://doi.org/10.48550/arXiv.1506.02640]

-

C. Yu, Y. Shin, “SAR ship detection based on improved YOLOv5 and BiFPN,” ICT Express, Vol. 10, pp.28-33, March 2024.

[https://doi.org/10.1016/j.icte.2023.03.009]

-

K. Roy, A. Jaiswal, P. Panda, “Towards spike-based machine intelligence with neuromorphic computing,” Nature, Vol.575, No.7784, pp.607–617, November 2019.

[https://doi.org/10.1038/s41586-019-1677-2]

-

Q. Su, Y. Chou, Y. Hu, J. Li, S. Mei, Z. Zhang, G. Li, “Deep Directly-Trained Spiking Neural Networks for Object Detection,” Proceedings of the IEEE/CVF International Conference on Computer Vision, pp. 6555–6565, October 2023.

[https://doi.org/10.48550/arXiv.2307.11411]

-

A. Tavanaei, M. Ghodrati, S. Kheradpisheh, T. Masquelier, A. Maida, “Deep Learning in Spiking Neural Networks,” Neural Networks, Vol.111, pp.47-63, March 2019.

[https://doi.org/10.1016/j.neunet.2018.12.002]

-

M. Dampfhoffer, T. Mesquida, A. Valentian, L. Anghel, “Backpropagation-Based Learning Techniques for Deep Spiking Neural Networks: A Survey,” IEEE transactions on neural networks and learning systems, Vol.35, No.9, pp.11906-11921, April 2023.

[https://doi.org/10.1109/TNNLS.2023.3263008]

-

P. U. Diehl, D. Neil, J. Binas, M. Cook, S. C. Liu, M. Pfeiffer, “Fast-classifying, high-accuracy spiking deep networks through weight and threshold balancing,” International Joint Conference on Neural Networks (IJCNN), pp. 1-8, July 2015.

[https://doi.org/10.1109/IJCNN.2015.7280696]

-

E. O. Neftci, H. Mostafa, F. Zenke, “Surrogate gradient learning in spiking neural networks: Bringing the power of gradient-based optimization to spiking neural networks,” IEEE Signal Processing Magazine, Vol. 36, No. 6, pp. 51-63, November 2019.

[https://doi.org/10.1109/MSP.2019.2931595]

-

L. Cordone, B. Miramond, P. Thierion, “Object Detection with Spiking Neural Networks on Automotive Event Data,” International Joint Conference on Neural Networks (IJCNN), May 2022.

[https://doi.org/10.1109/IJCNN55064.2022.9892618]

-

M. Yuan, C. Zhang, Z Wang, H. Liu, G. Pan, H. Tang, “Trainable Spiking-YOLO for low-latency and high-performance object detection,” Neural Networks Vol.172, April 2024.

[https://doi.org/10.1016/j.neunet.2023.106092]

-

T. Zhang et al, “SAR Ship Detection Dataset (SSDD): Official Release and Comprehensive Data Analysis,” Remote Sensing, Vol.13, pp.3690, September 2021.

[https://doi.org/10.3390/rs13183690]

-

S. Wei, X. Zeng, Q. Qu, M. Wang, H. Su, J. Shi, “HRSID: A high-resolution SAR images dataset for ship detection and instance segmentation,” IEEE Access, Vol. 8, pp. 120234-120254, July 2020.

[https://doi.org/10.1109/ACCESS.2020.3005861]

-

M. Tan, R. Pang, Q. V. Le, “EfficientDet: Scalable and efficient object detection,” Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 10778-10787, June 2020.

[https://doi.org/10.48550/arXiv.1911.09070]

-

L.F. Abbott, “Lapicque’s introduction of the integrate-and-fire model neuron (1907),” Brain Res Bull, Vol.50, pp.303-304, November 1999.

[https://doi.org/10.1016/s0361-9230(99)00161-6]

-

Y. Luo, M. Li, G. Wen, Y. Tan, C. Shi, “SHIP-YOLO: A Lightweight Synthetic Aperture Radar Ship Detection Model based on YOLOv8n Algorithm,” IEEE Access, March 2024.

[https://doi.org/10.1109/ACCESS.2024.3373893]

- 2009년 ~ 2014년 : 연세대학교 전기전자공학과 학사

- 2014년 ~ 2019년 : 연세대학교 전기전자공학과 박사

- 2019년 ~ 2021년 : 연세대학교 박사후연구원

- 2021년 ~ 현재 : 한국항공대학교 소프트웨어학과 조교수

- ORCID : https://orcid.org/0000-0002-9665-4214

- 주관심분야 : 컴퓨터비전, 인공지능, 3차원 영상처리